ECCV 2020 SenseHuman Workshop:人类感知、理解与生成

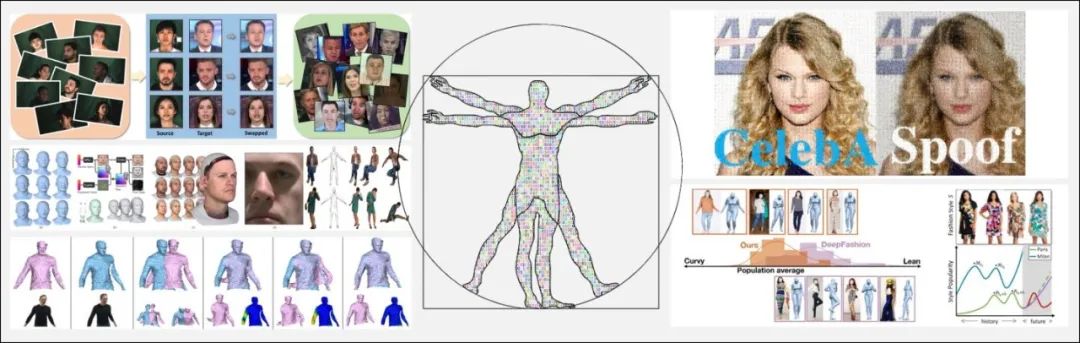

ECCV 2020 Workshop on Sensing, Understanding and Synthesizing Humans 将在周五(08/28)举办。这一 Workshop 关注于计算机视觉中的人类感知、理解和生成。

这次线上 Workshop 不但有业内大佬 Present 相关领域最新进展,更同时宣布两个重量级人脸比赛:检测换脸视频(Face Forgery)的比赛 DeeperForensics,和人脸防伪(反欺诈)的比赛 CelebA-Spoof 的开启。欢迎大家关注!

计算机视觉在人类感知、理解和生成上已经取得了长足的进步。在此基础上,我们进一步指出了未来本领域的三个重要方向:

1. 我们应该从整体出发,用一个统一的框架来处理人类感知、理解和生成问题。并且来探索由这些不同子领域相互交叉而产生的前沿问题。

2. 工业界和学术界应该多交流彼此的经验,教训以及对这个领域的见解。

在 Workshop 上,我们会宣布启动两个“假脸”检测的比赛,届时比赛组织者/论文作者将会对比赛进行介绍,比赛将会有来自 Amazon 赞助的丰厚奖励。

CelebA-Spoof

人脸防伪则是针对目前日益增多的人脸识别相关的安全系统(门禁、支付系统),为了防止人脸识别系统被照片或视频攻破,用以判断系统是否被攻击的任务,其主要内容是活体检测。现有的反欺诈或活体检测数据集存在缺乏多样性等问题。

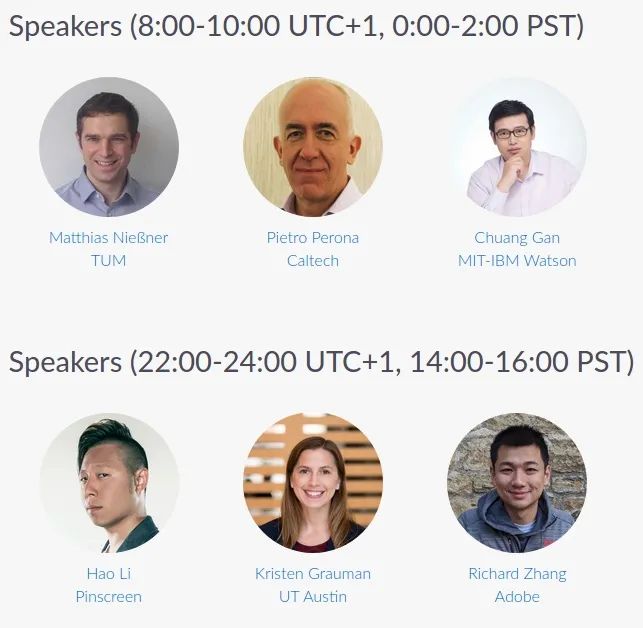

Session 1 (8:00-10:00 UTC+1, 0:00-2:00 PST):

7:55 - 8:00 开幕式

8:00 - 8:40 Invited Talk by Prof. Matthias Nießner

8:40 - 9:00 Challenge 介绍

9:00 - 9:30 Invited Talk by Prof. Pietro Perona

9:30 - 10:00 Invited Talk by Dr. Chuang Gan

10:00 - 10:05 结束语

Session 2 (22:00-24:00 UTC+1, 14:00-16:00 PST):

21:55 - 22:00 开幕式

22:00 - 22:40 Invited Talk by Prof. Hao Li

22:40 - 23:20 Invited Talk by Prof. Kristen Grauman

23:20 - 24:00 Invited Talk by Dr. Richard Zhang

24:00 - 00:05 结束语

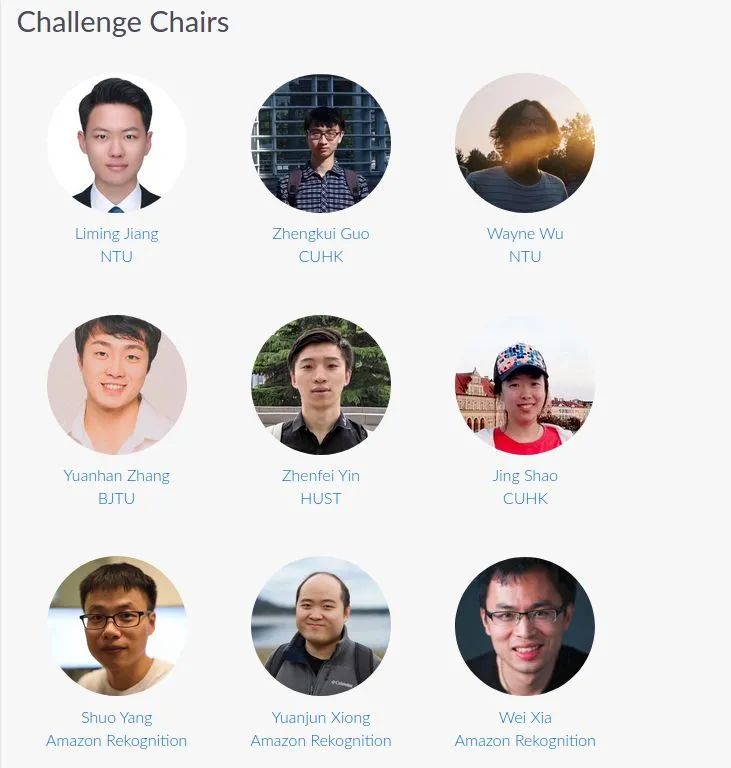

本次 Workshop 的组织者由来自 MMLab(CUHK,NTU)的 Researchers,UCSD 的新晋助理教授王小龙,NVIDIA 的刘思飞,各个 Challenge 的论文作者,以及 Amazon 的 Researchers 组成。

Challenge Chairs 同为 Workshop 的 Organizer,排名不分先后:

更多阅读

#投 稿 通 道#

让你的论文被更多人看到

如何才能让更多的优质内容以更短路径到达读者群体,缩短读者寻找优质内容的成本呢?答案就是:你不认识的人。

总有一些你不认识的人,知道你想知道的东西。PaperWeekly 或许可以成为一座桥梁,促使不同背景、不同方向的学者和学术灵感相互碰撞,迸发出更多的可能性。

PaperWeekly 鼓励高校实验室或个人,在我们的平台上分享各类优质内容,可以是最新论文解读,也可以是学习心得或技术干货。我们的目的只有一个,让知识真正流动起来。

📝 来稿标准:

• 稿件确系个人原创作品,来稿需注明作者个人信息(姓名+学校/工作单位+学历/职位+研究方向)

• 如果文章并非首发,请在投稿时提醒并附上所有已发布链接

• PaperWeekly 默认每篇文章都是首发,均会添加“原创”标志

📬 投稿邮箱:

• 投稿邮箱:hr@paperweekly.site

• 所有文章配图,请单独在附件中发送

• 请留下即时联系方式(微信或手机),以便我们在编辑发布时和作者沟通

🔍

现在,在「知乎」也能找到我们了

进入知乎首页搜索「PaperWeekly」

点击「关注」订阅我们的专栏吧

关于PaperWeekly

PaperWeekly 是一个推荐、解读、讨论、报道人工智能前沿论文成果的学术平台。如果你研究或从事 AI 领域,欢迎在公众号后台点击「交流群」,小助手将把你带入 PaperWeekly 的交流群里。