国科大UCAS胡包钢教授《信息论与机器学习》课程第三讲:信息论基础二

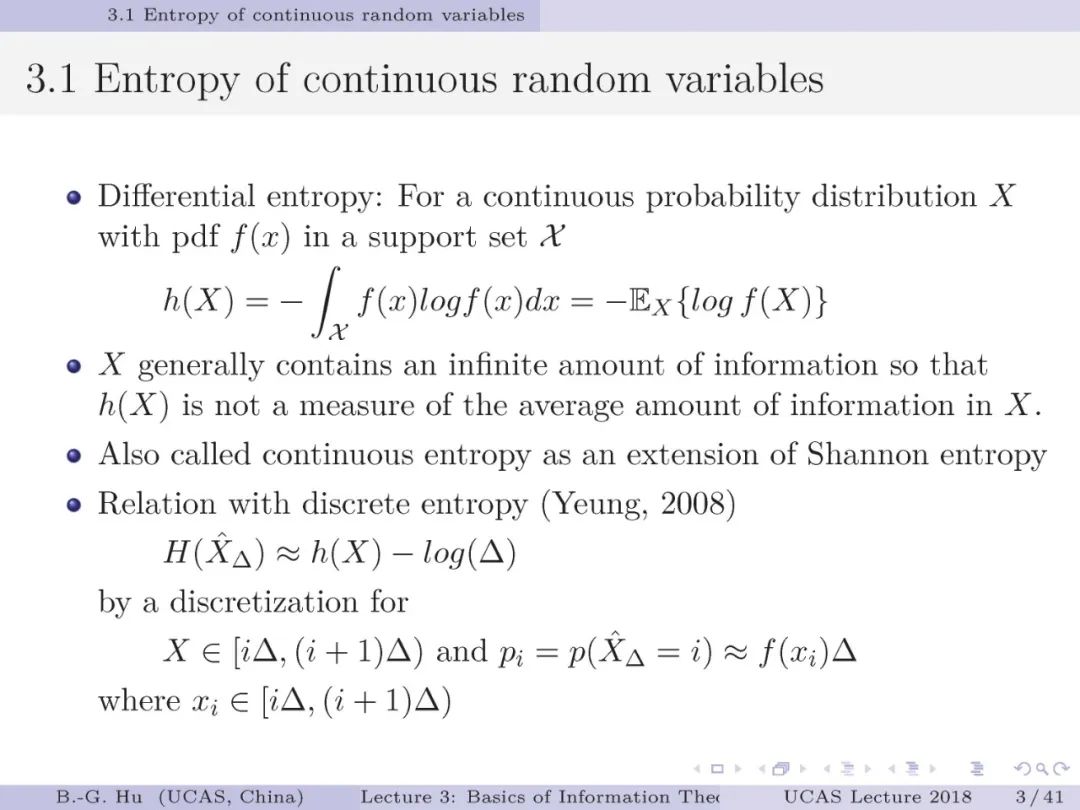

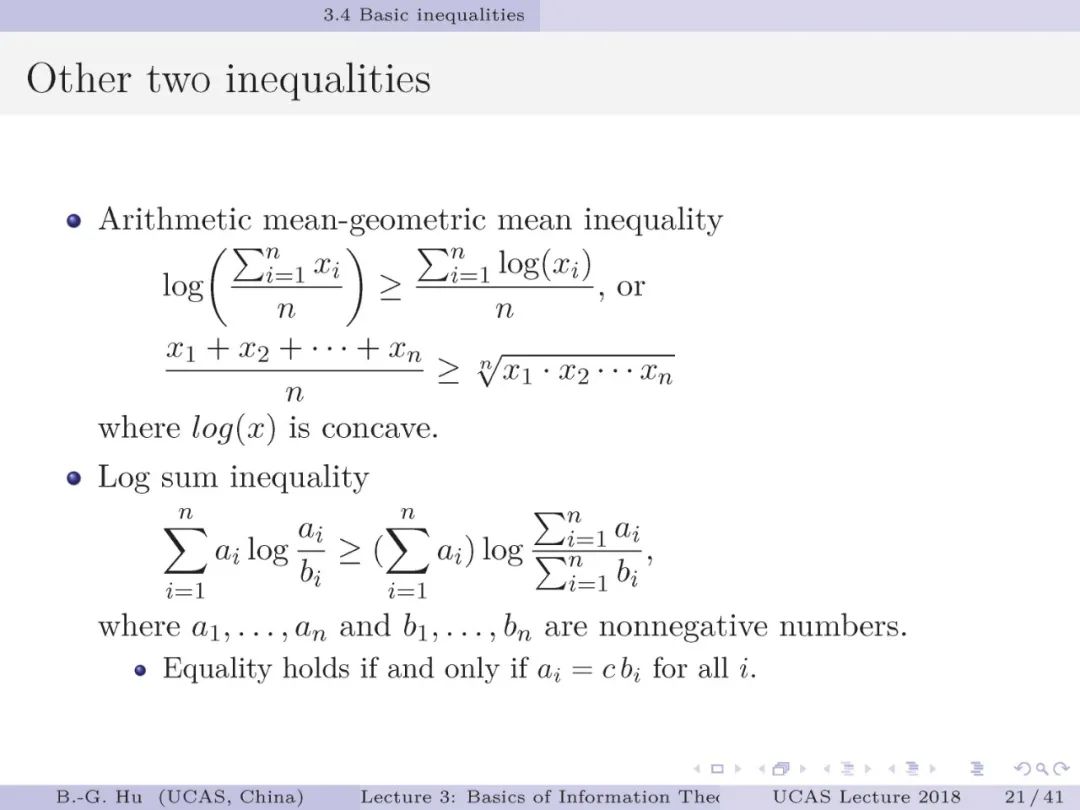

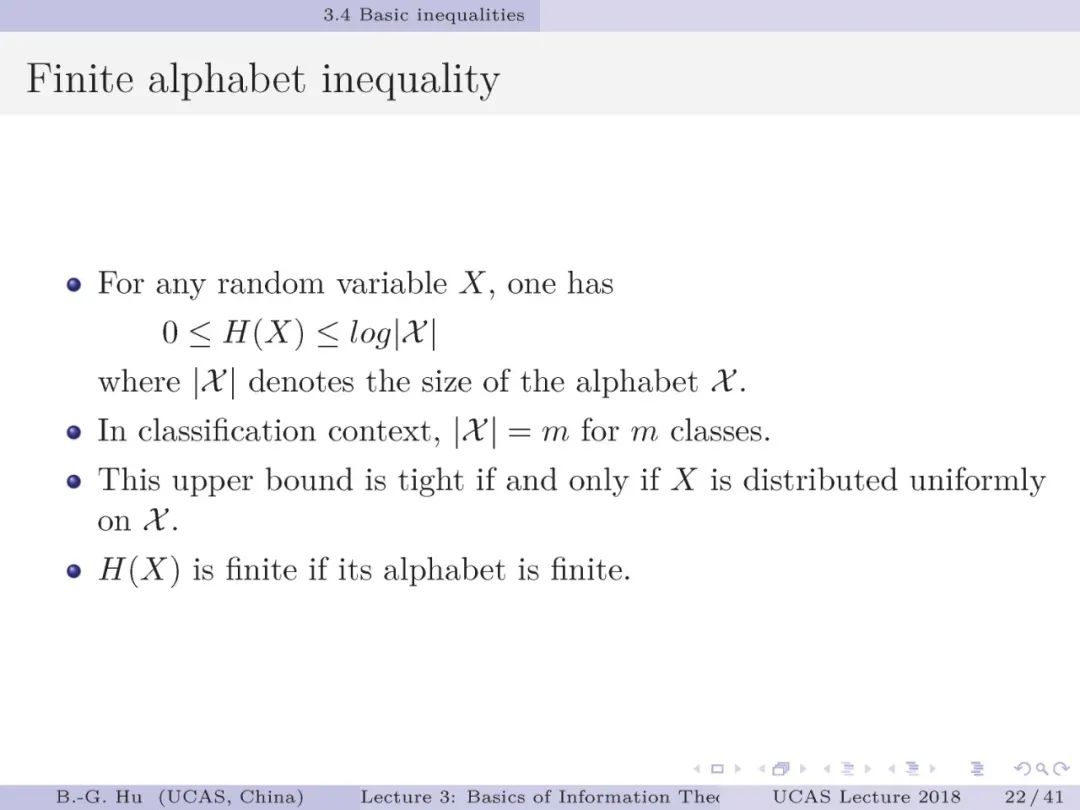

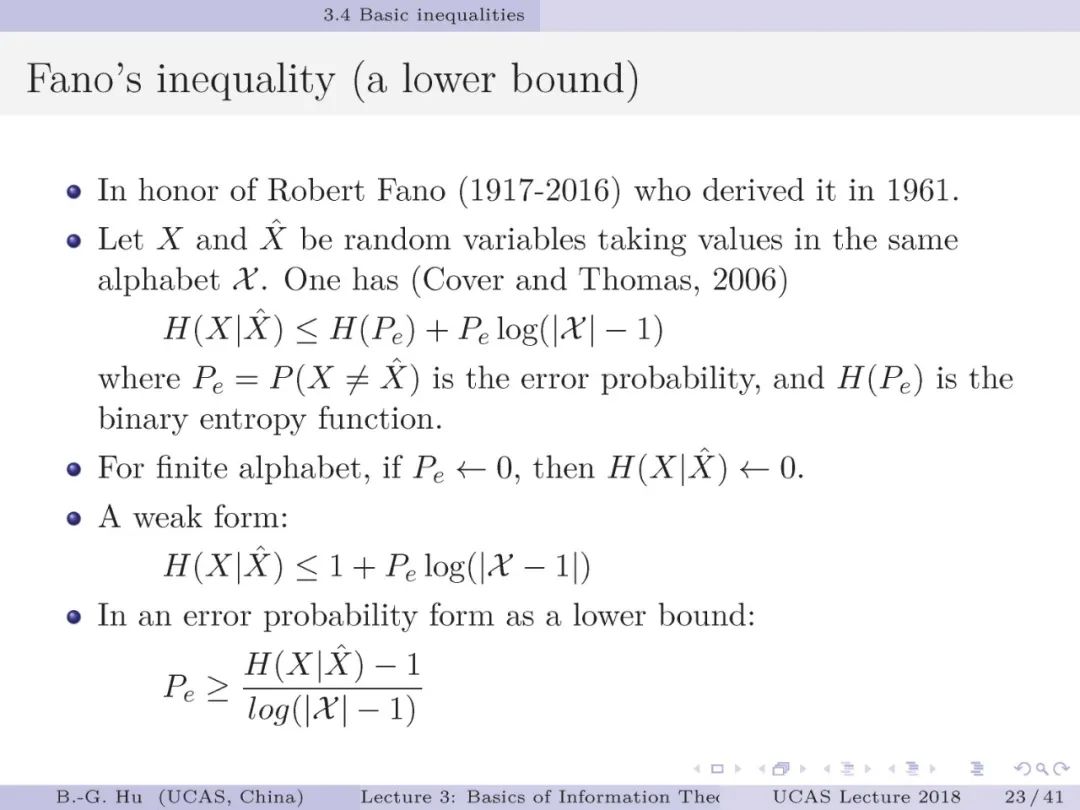

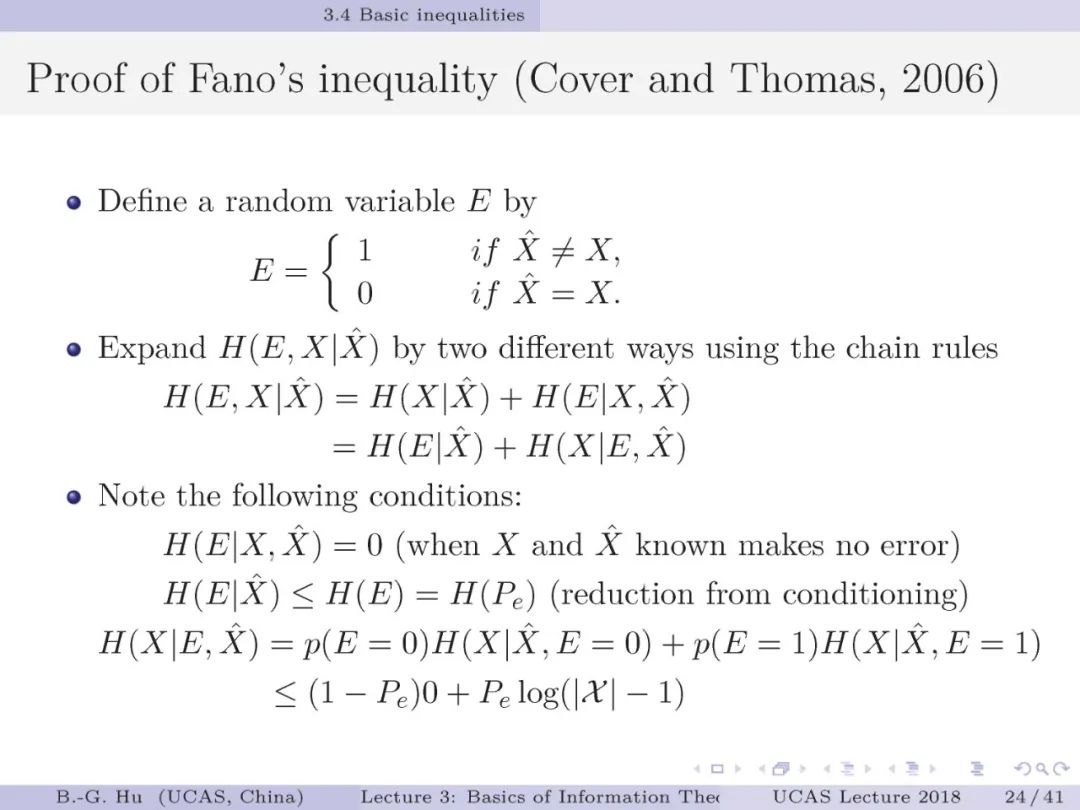

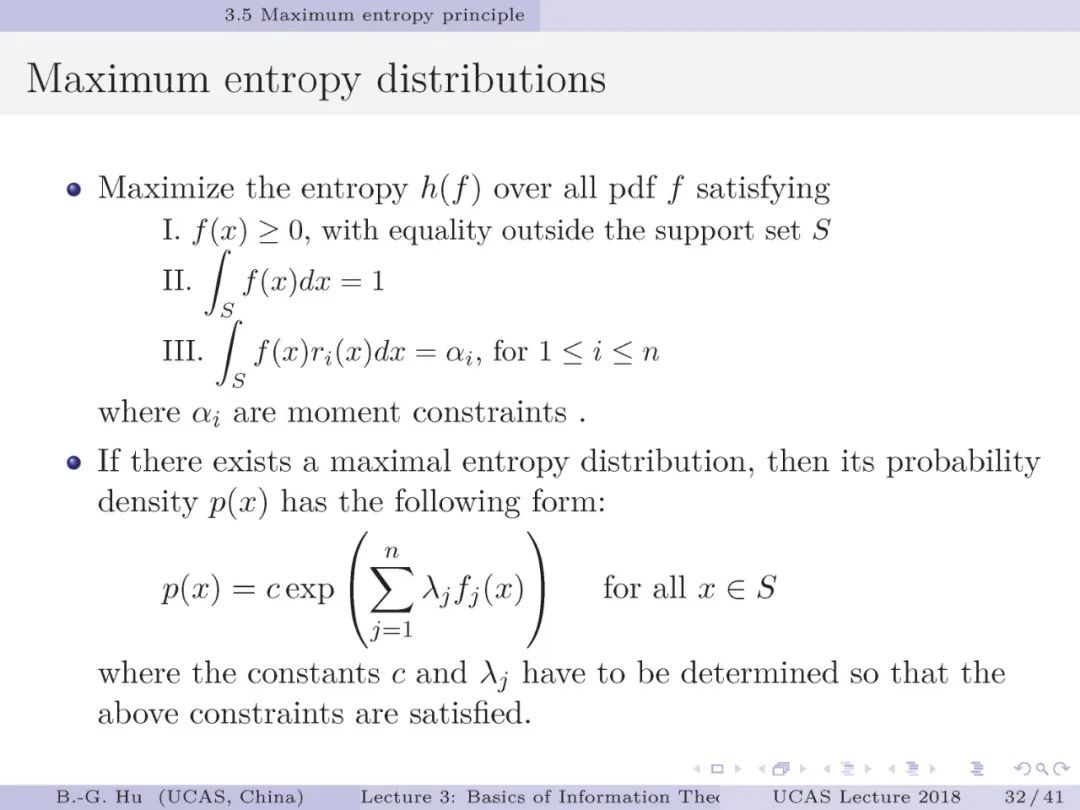

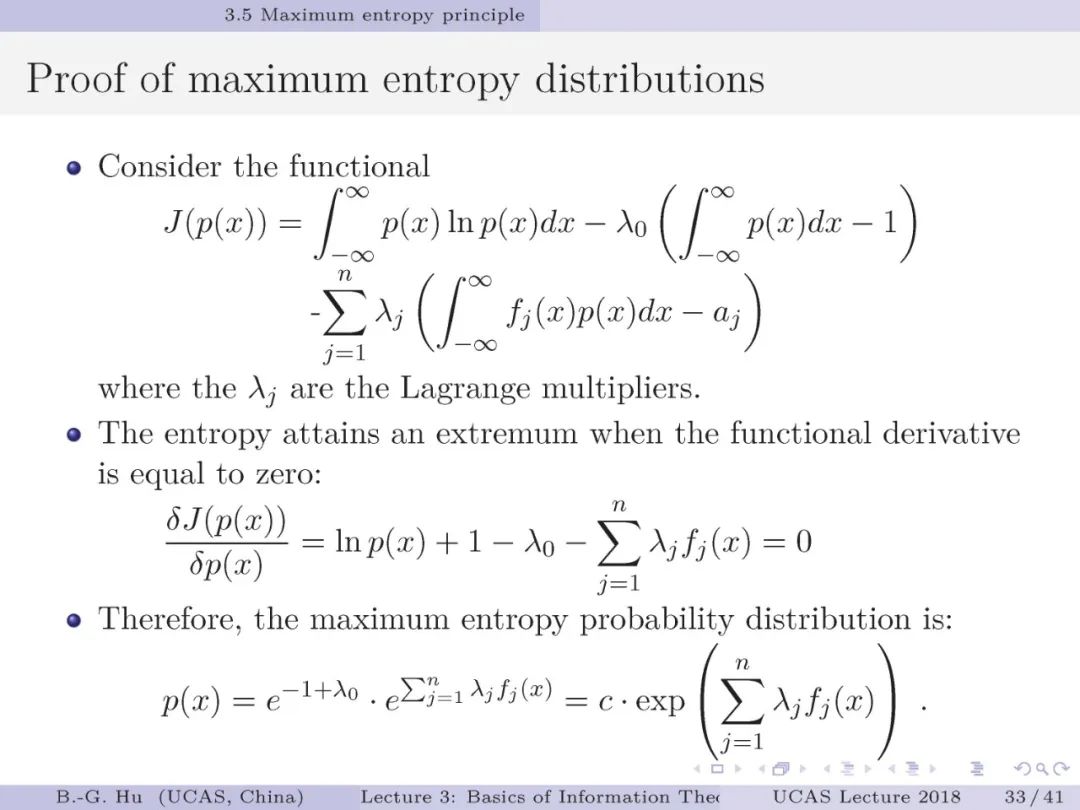

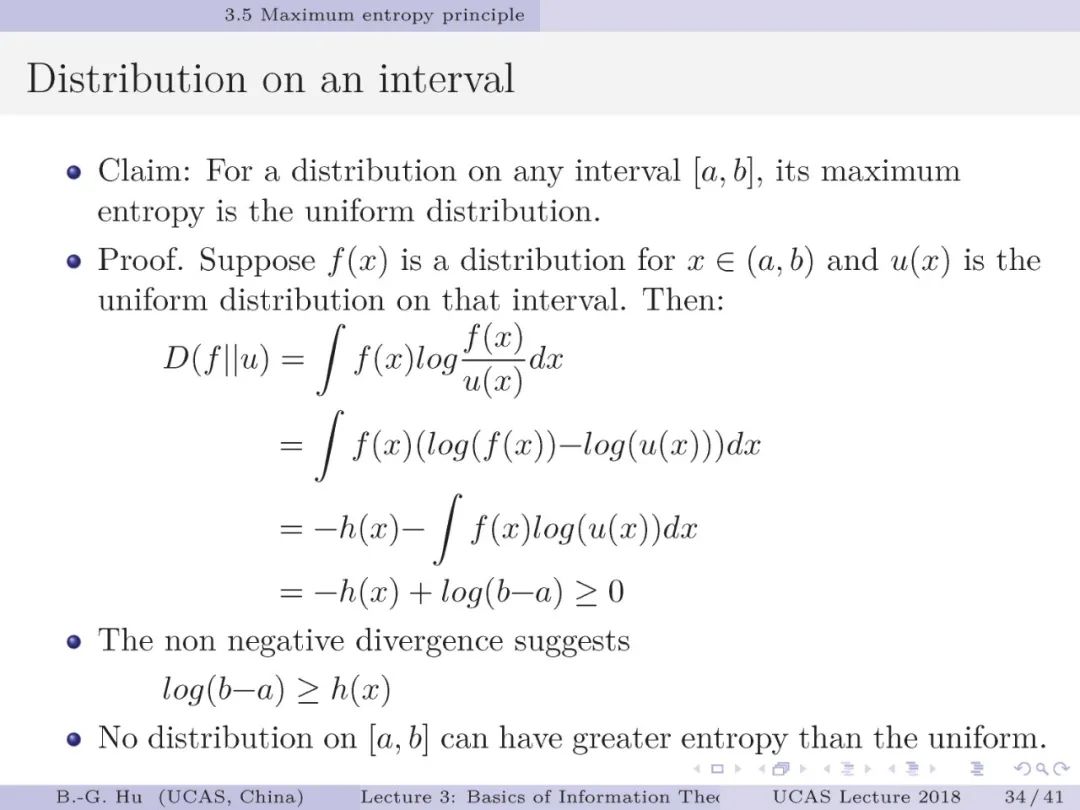

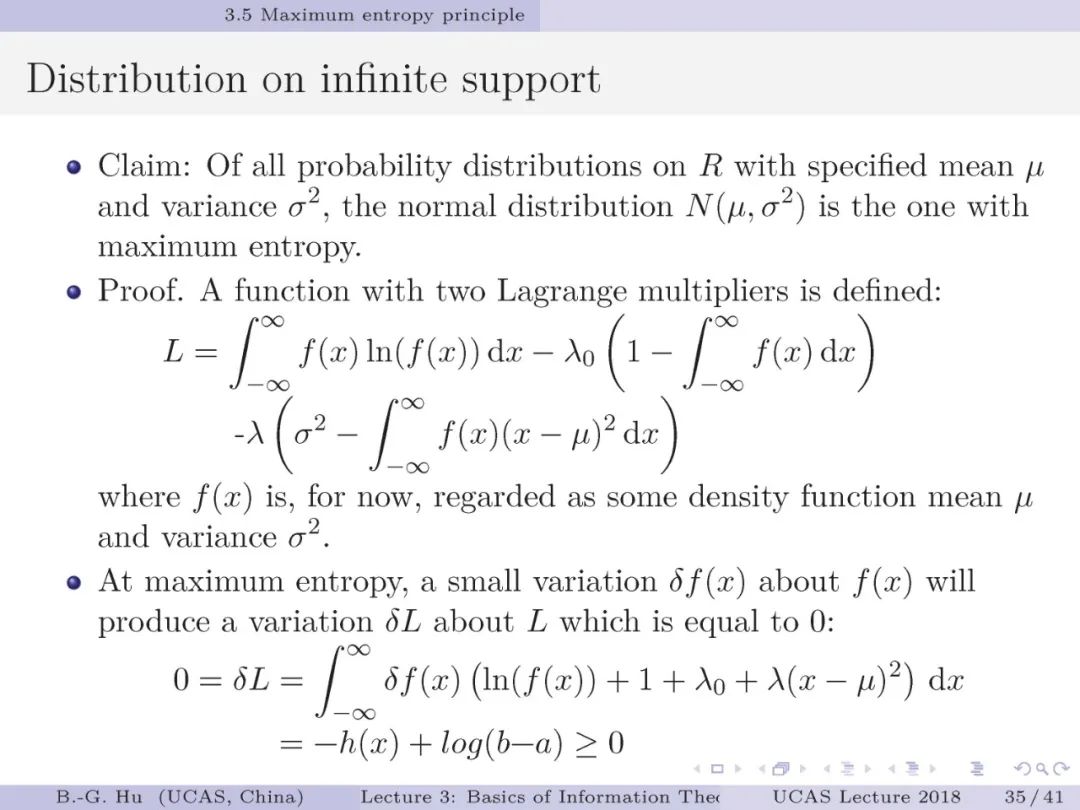

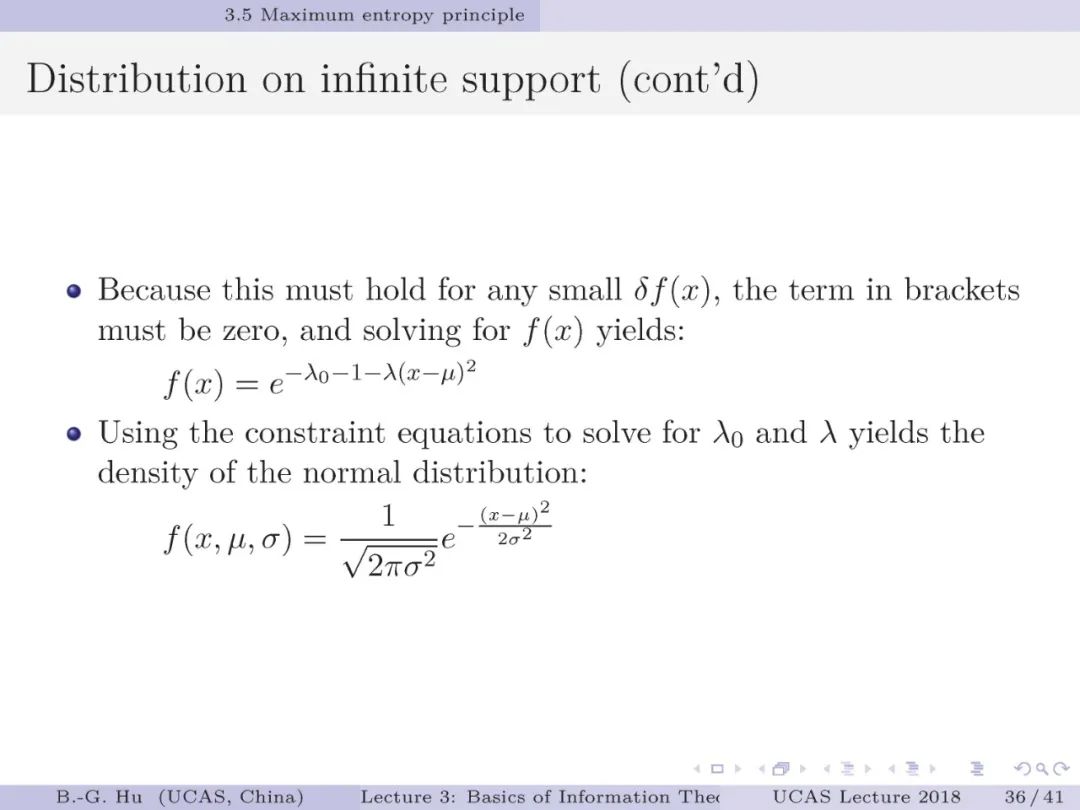

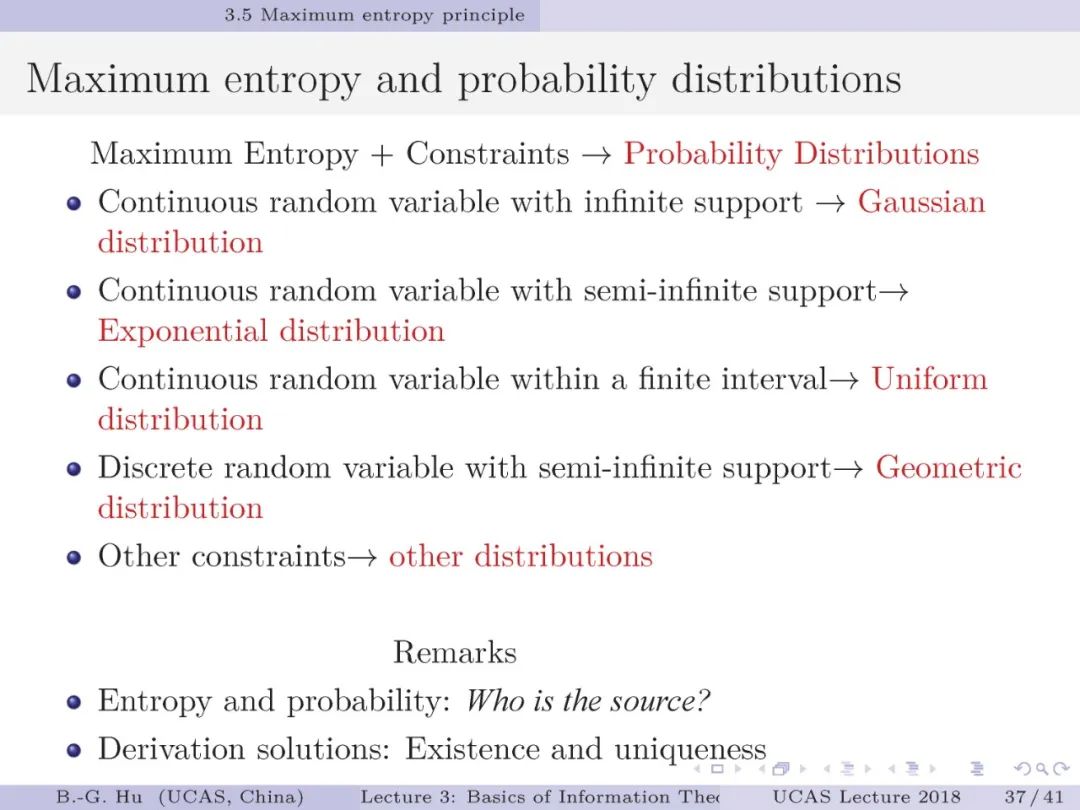

【导读】这章主要是对连续变量熵等相关内容进行了介绍。其中美国物理学家Jaynes教授1957 年提出的最大熵原理是最为核心的理论贡献。该原理特别深刻,要知道它不仅是应用在统计推断方面,在很多领域中都可以成为一种原理给出信息论层面上的解释。基于最大熵原理可以根据不同约束导出各种概率分布函数(第8页)。过去认为熵是基于概率分布为已知而得到的一种结果。而最大熵原理给我的理解熵犹似“源”,因为它可导出概率分布表达。反之则不然,因为计算与导出表达是不同的。本章中另一个重要知识是不等式的学习与理解。如同香港中文大学杨伟豪教授指出的那样(第39页):信息论不等式给出了不可能发生的界,因此这将犹如信息论中的定律。比如其中Fano不等式与Kovalevskij不等式建立了条件熵与误差之间的关系,对机器学习中应用信息论指标有着直接的指导意义,并提供理论解释性。

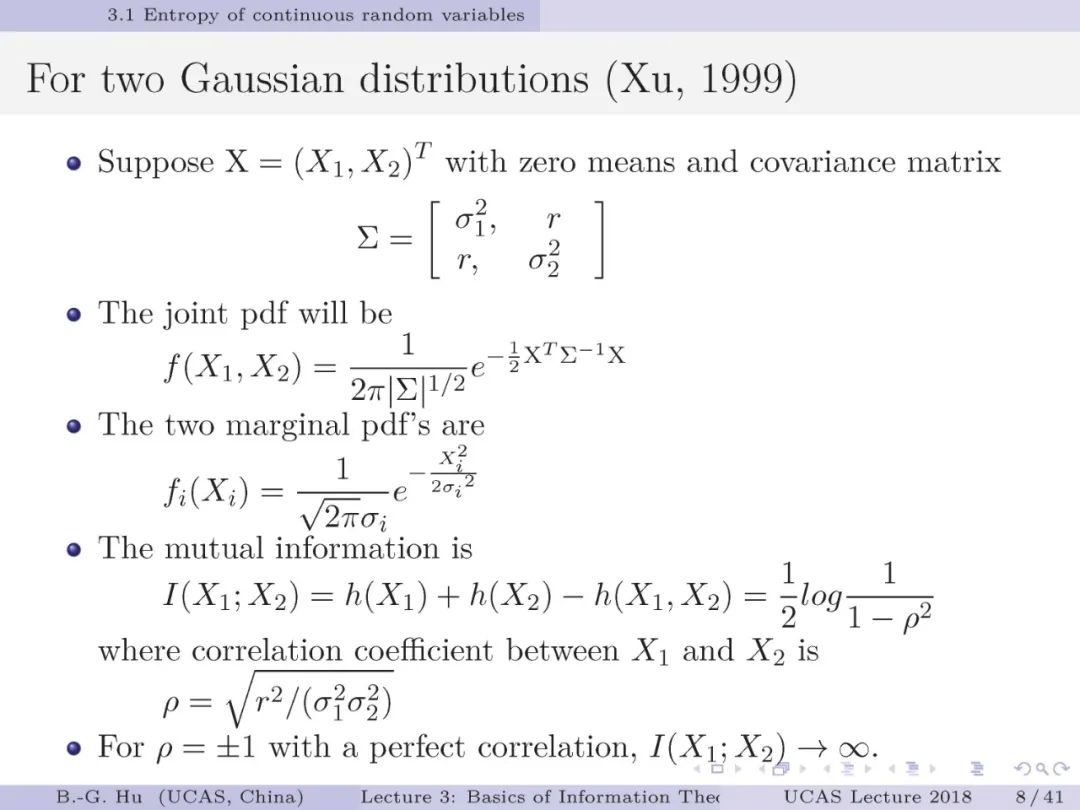

第8页: 该页介绍了最大互信息可以导出经验式定义的相关系数,而其中的约束是随机变量最高阶次统计量只有二阶。由此例子我学到的内涵有:一是信息论指标更是“源”指标(导出其它,而非相反)。二是熵函数优化加约束可以提供更大的理论解释空间。三是熵指标原理上包容高阶统计量。

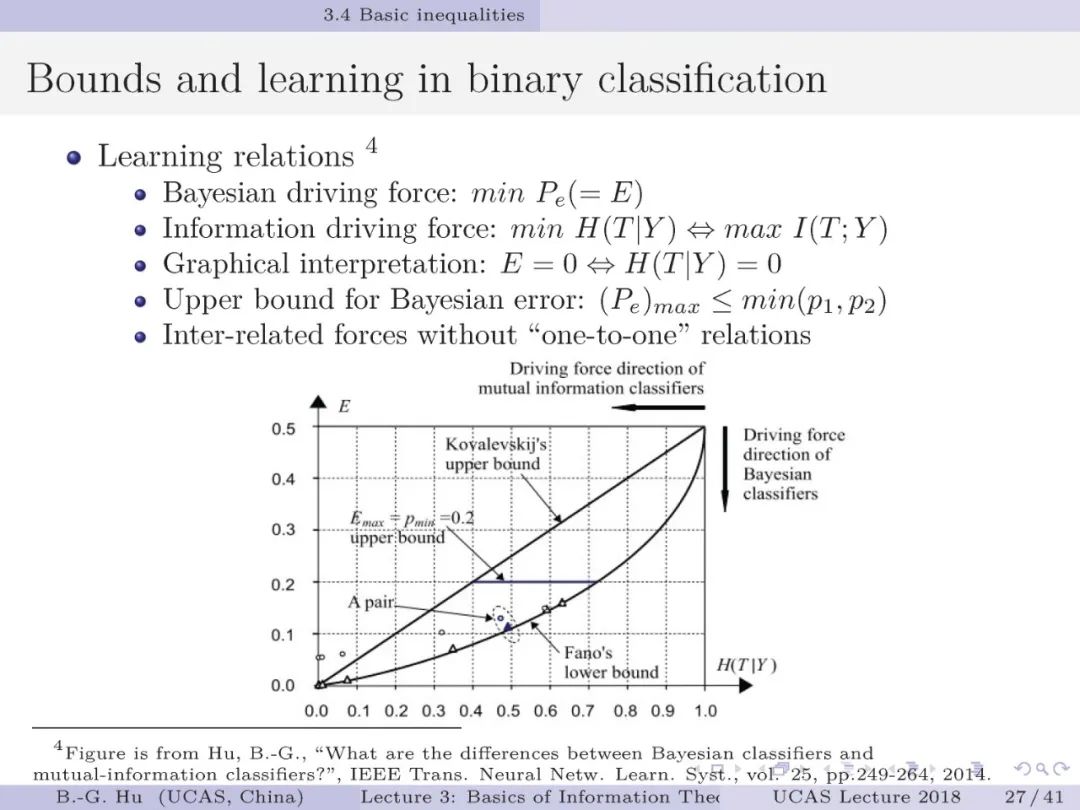

第27页: 这页内容是关于二值分类问题中,条件熵与误差之间界关系的讨论。本人2014年文章中的图给出了Fano下界曲线与Kovalevskij上界曲线。由于该文是讨论贝叶斯分类器,因此两类中的类别分布信息p_1与p_2已知。比如T中100个样本,有20个苹果,有80个鸭梨为标签。则p_1=0.2,p_2=0.8。由贝叶斯误差是分类器中理论上最小值这个知识(见Duda《模式分类》中文版第36页),文章添加了另一个上界,在此是蓝色横线p_min=p_1=0.2表示的。此界说明对于给定类别分布的贝叶斯分类器,不可能出现误差大于0.2的情况。图中三角代表贝叶斯分类器计算结果,而圆圈代表互信息分类器计算结果。可以看到该结果已经超出Kovalevskij上界,这里就引出了我们后来发展的界研究工作。这将是第5章中的内容。

该图示意了贝叶斯误差最小学习目标与条件熵最小学习目标在作用力方面有着等价的内涵。都是趋向原点。但是分类问题中多数情况是无法到达原点。因此两者通常没有一对一的关系。即根据给定样本分布得到的最小贝叶斯误差,其对应的条件熵有多解,可以不是最小条件熵。反之亦然。由此要理解条件熵有误差的近似内涵,但本质上是两个随机变量独立性的指标(第22页)。

作业:

1. 试对第27页图中左下角和右上角的含义给予语义与计算层面上的解释。为什么没有误差大于0.5的图示内容?

2. 对于多个随机变量输入的深度学习方法,它的输出变量是熵增还是熵减?试讨论之?

3. 请问条件熵为零情况下信息论与机器学习分别在语义层面上的解释是什么?在机器学习中它必然对应误差为零吗?

课件之后争取给些开阔思维的创新故事。这次推荐读者阅读百度百科中关于“GNU”自由操作系统的介绍(https://baike.baidu.com/item/GNU/671972)。要知道该操作系统中“Copyleft”这样的创新学术思想造就了目前人工智能研发中的开放生态环境,成为思想改变世界的范例。具体方式是通过GPL软件协议改变知识产权发展模式。本人在一篇科普类文章(“关于‘Copyleft’术语的中文译名建议”)中给出了背景介绍。GNU之后发展出来的各种版权协议已呈“百家争鸣”之势,协议背后体现了商业游戏规则在发生变化。你能够明白具体怎么变的及其原因么?这之中“开放、分享、共创”模式 ,也体现了“人类命运共同体”的理念。希望读者思考一下,这种模式或理念,只是一种意识形态还是有人文科学在支撑?我个人愿意列举的实例是健康与医疗中的数据共享经济,其最大驱动力来源于人类共同利益。这里话好像扯远了,但不要让你的想象受到限制。由此我们还应该追溯孔夫子两千多年前提出的“有教无类”是世界文明宝库中人文思想的首创贡献,得到国际认同和推广。约一千年前北宋范仲淹开启了中国免费基础教育之先河:“义学”。而七百年前宋末元初的黄道婆与黎族同胞则是“开放、分享”纺织技术的先行者,在人类文明历史上可谓独树一帜。

本人特别喜欢斯托曼(R.M. Stallman)1983年创作的GNU名称,他解释语是“GNU's Not Unix”来直接说明GNU不是Unix这样当时最主流的操作系统。这里他诙趣地应用了递归缩写方法来命名[1], 而GNU英文原意为非洲角马,是非洲大草原中一种重要群居动物的代表。斯托曼在命名GNU与应用角马大头像素描为标志方面下了一番功夫。读者可以设想一下斯托曼想表达什么?这是一个很有野性的动物,读者可以在虾米网站聆听关于Gnu相声作品[2]并了解原英文歌词[3]。GNU网站修改歌词后给出新的诠释[4]。就我个人所知,GNU角马标志开创了以动物为软件标志或吉祥物的先河。而乔布斯是1976年与设计家共创了苹果商标,并书写了用产品改变世界的历史。这之中告诉我们创新可期,不论大小,反复推敲,乐在其中。

1. https://baike.baidu.com/item/%E9%80%92%E5%BD%92%E7%BC%A9%E5%86%99/2216444?fr=aladdin

2. https://www.xiami.com/song/xNSrlld8881

3. https://genius.com/Flanders-and-swann-the-gnu-song-lyrics

4. https://www.gnu.org/fun/jokes/gnu-song.html

前期课程链接:

第一讲:

国科大UCAS《信息论与机器学习》课程,中国科学院自动化研究所胡包钢研究员

第二讲:

国科大UCAS胡包钢教授《信息论与机器学习》课程第二讲:信息论基础一

课件文件:

附录文件:

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“ITML2020” 就可以获取《国科大UCAS《信息论与机器学习》课件》专知下载链接