击破“换脸术”,全新大型DeepFake视频数据集来了!

主题词

DeepFake数据集,DeepFake篡改鉴定

AI合成的换脸视频(通常称为DeepFakes)是近两年的新兴问题,它给视频信息的可信度打上了一个大大的问号。开发和评估DeepFake篡改鉴定/检测算法,需要大规模、高质量的数据集,然而现有DeepFake数据集的视觉质量存在较大的问题。

针对该问题,纽约州立大学吕思伟教授团队与中国科学院大学齐洪钢教授团队合作在CVPR2020上发表的论文《Celeb-DF: A Large-scale Challenging Dataset for DeepFake Forensics》提出了一个新的大规模DeepFake视频数据集——Celeb-DF。

该数据集共包含不同名人的5639条DeepFake高质量视频。该文章对现有的DeepFake检测方法和数据集进行了全面评估,以证明提出的Celeb-DF数据集确实给DeepFake检测带来了新的挑战与提升空间。

内含常用DeepFake数据集地址,不要错过哟~

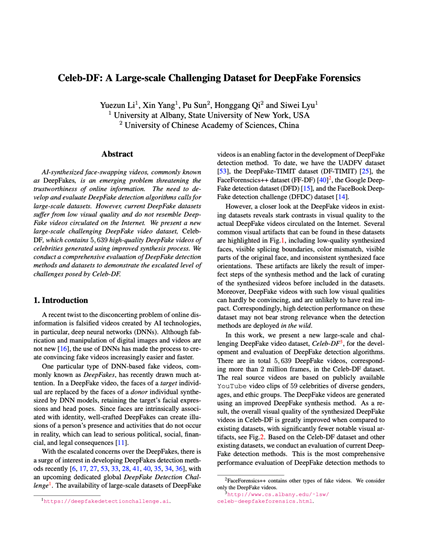

题目:Celeb-DF: A Large-scale Challenging Dataset for DeepFake Forensics

作者:Yuezun Li, Xin Yang, Pu Sun, Honggang Qi and Siwei Lyu

发表会议:CVPR2020

引用格式:Y. Li, P. Sun, H. Qi, and S. Lyu. Celeb-DF: A Large-scale Challenging Dataset for DeepFake Forensics. In IEEE Conference on Computer Vision and Patten Recognition (CVPR), Seattle, WA, United States, 2020.1

网址链接:https://arxiv.org/abs/1909.12962

2017年,Reddit论坛上的一个帖子展示了一项名为“DeepFake”的技术,利用深度学习,将一段视频中一个人的脸换成了另一个人,但是仍保留原来的面部表情动作。自此,各类换脸后的伪造视频在互联网上层出不穷,人们用“DeepFake”一词,来统称这些基于深度学习方法,实现换脸、面部重现的技术。

时至今日,“DeepFake”对社会造成了极大的消极影响,网络安全公司Deeptrace直言:“无论是视频音频,还是文本,我们社会依赖和信任的多个数字通信渠道都已遭到了颠覆。”“DeepFake”所伪造的视频,可以败坏一个人的声誉、改变一个群体的形象,甚至影响政治进程。

因此,如何更精确地检测出这些被篡改后的DeepFake视频、图像,就成了一个亟待解决的热点问题。基于深度学习框架的检测方法,需要大量优质数据来驱动网络的学习。针对当前DeepFake数据集普遍存在的质量问题,论文生成了一种较高质量、对当前检测方法都有显著效果的大规模DeepFake数据集:Celeb-DF。

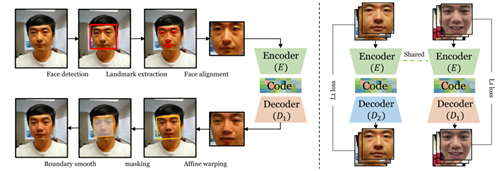

论文所采用的基本框架如下图所示,图中虚线右侧是训练流程,虚线左侧是实际生成DeepFake视频的流程。经过裁剪、对齐后的人脸输入共享的Encoder后,针对每一个人,都训练一个Decoder,经由对应身份的Decoder解码即可得到对应身份的人脸,而后再经过仿射等变换,贴合到输入的图片上,完成合成过程。

针对现存数据集的问题,该文主要从四个方面做了改进,分别是:

1. 通过加深Encoder、Decoder的层数,生成更高分辨率(256×256)的人脸图像;

2. 通过训练时的数据增广和对生成人脸的颜色转换操作,改善合成后人脸颜色不匹配问题;

3. 摒弃矩形的人脸框,根据人脸关键点检测结果生成更贴合人脸形状的多边形人脸框,以改善合成后人脸边缘效果;

4. 在视频连续的图像帧里,根据当前帧关键点检测结果和之前帧的关键点,采用卡尔曼滤波的方式生成更平滑的关键点,以改善最终生成视频人脸抖动的问题。

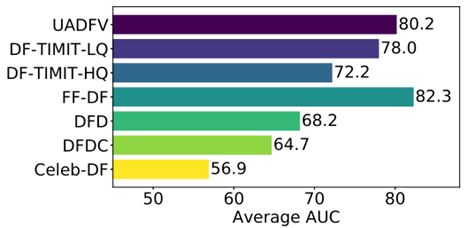

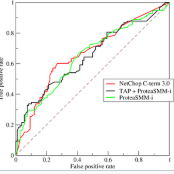

论文比较了9种DeepFake篡改检测方法(包括目前最先进的FWA, Meso4, MesoInception4, Xception-c23, Xception-40和DSP-FWA),在6种DeepFake数据集(包括四种大型数据集:FF-DF, DFD, DFDC和Celeb-DF)上的表现。在AUC这一评判标准下, 大部分方法在Celeb-DF上的表现都有显著下降;最先进的几种检测方法,在Celeb-DF上都取得了最差的AUC值;如下图所示,以各种检测方法检测结果的均值而论,Celeb-DF上的AUC是最低的。

常用DeepFake数据集地址:

1) UADFV:In Ictu Oculi: Exposing AI Generated Fake Face Videos by Detecting Eye Blinking

2)DeepfakeTIMIT: DeepFakes: a New Threat to Face Recognition? Assessment and Detection

3)FaceForensics++ dataset: FaceForensics++: Learning to Detect Manipulated Facial Images

4)DFDC: FaceBook DeepFake detection challenge dataset

实验结果表明,文章所提供的数据集给现有的检测方法带来了不小的挑战,不仅说明该数据集在一定程度上具有较高的篡改质量,同时也说明,现有的DeepFake检测方法仍然具有很大的提升空间。

作者简介

第一作者:李岳尊,博士生,纽约州立大学奥尔巴尼分校,研究领域:计算机视觉,数字鉴伪。Email:yli52@albany.edu

第二作者:杨鑫,现亚马逊126实验室研究员,研究领域:计算机视觉,数字鉴伪,机器人。

通讯作者:吕思伟,教授,纽约州立大学奥尔巴尼分校,研究领域:数字鉴伪,计算机视觉,机器学习。Email:slyu@albany.edu

申明:本文发布的网站内容均不代表本号观点,本号旨在提供参考素材以便学习交流。

下期预告:

往期目录:

汪荣贵——机器学习基本知识体系与入门方法

陈强——从Cell封面论文谈AI研究中的实验数据问题

石争浩——从先验到深度:低见度图像增强

行知论坛——南理工行知论坛&图图Seminar:智能画质增强专题

孙显——遥感图像智能分析:方法与应用

回放平台:

知网在线教学服务平台:

http://k.cnki.net/Room/Home/Index/181822

B站:

https://space.bilibili.com/27032291

看完微推意犹未尽?

加入图图社区,了解更多资讯

专家报告 | 基于图深度学习的网络时空数据建模与预测

专家推荐 | 社交媒体多模态表示学习

专家报告 | 优化抠图:背景去无踪,前景更出众

前沿进展 | 多媒体信号处理的数学理论

中国卫星遥感回首与展望

单目深度估计方法:现状与前瞻

目标跟踪40年,什么才是未来?

算法集锦 | 深度学习如何辅助医疗诊断?

10篇CV综述速览计算机视觉新进展

算法集锦|深度学习在遥感图像处理中的六大应用

专家推荐|高维数据表示:由稀疏先验到深度模型

专家报告 | AI与影像“术”——医学影像在新冠肺炎中的应用

专家推荐|真假难辨还是虚幻迷离,参与介质图形绘制让人惊叹!

学者推荐 | 深度学习与高光谱图像分类【内含PPT 福利】

专家报告|深度学习+图像多模态融合

专家报告 | 类脑智能与类脑计算

实战例题!200+PPT带你看懂监督学习

118页PPT!机器学习模型参数与优化那些事儿~

专家开讲 | 机器学习究竟是什么?

Hinton,吴恩达,李飞飞 !大师深度学习课程集锦

羡慕别人中了顶会?做到这些你也可以!

如何阅读一篇文献?

共享 | SAR图像船舶切片数据集

资源分享| 不知道如何获取最新的算法资讯?快来这里看一看

资源分享|热门IT资讯号推荐

《中国图象图形学报》2020年第4期目次

《中国图象图形学报》2020年第3期目次

《中国图象图形学报》2020年第2期目次

《中国图象图形学报》2020年第1期目次

本文系《中国图象图形学报》独家稿件

内容仅供学习交流

版权属于原作者

欢迎大家关注转发!

编辑:狄 狄

指导:梧桐君

审校:夏薇薇

总编辑:肖 亮

声 明

欢迎转发本号原创内容,任何形式的媒体或机构未经授权,不得转载和摘编。授权请在后台留言“机构名称+文章标题+转载/转发”联系本号。转载需标注原作者和信息来源为《中国图象图形学报》。本号转载信息旨在传播交流,内容为作者观点,不代表本号立场。未经允许,请勿二次转载。如涉及文字、图片等内容、版权和其他问题,请于文章发出20日内联系本号,我们将第一时间处理。《中国图象图形学报》拥有最终解释权。

与你同在

前沿 | 观点 | 资讯 | 独家

电话:010-58887030/7035/7418

网站:www.cjig.cn