美国Rutgers大学最新开源:端到端6D物体姿态跟踪,无需标注数据集!

点击上方“计算机视觉life”,选择“星标”

快速获得最新干货

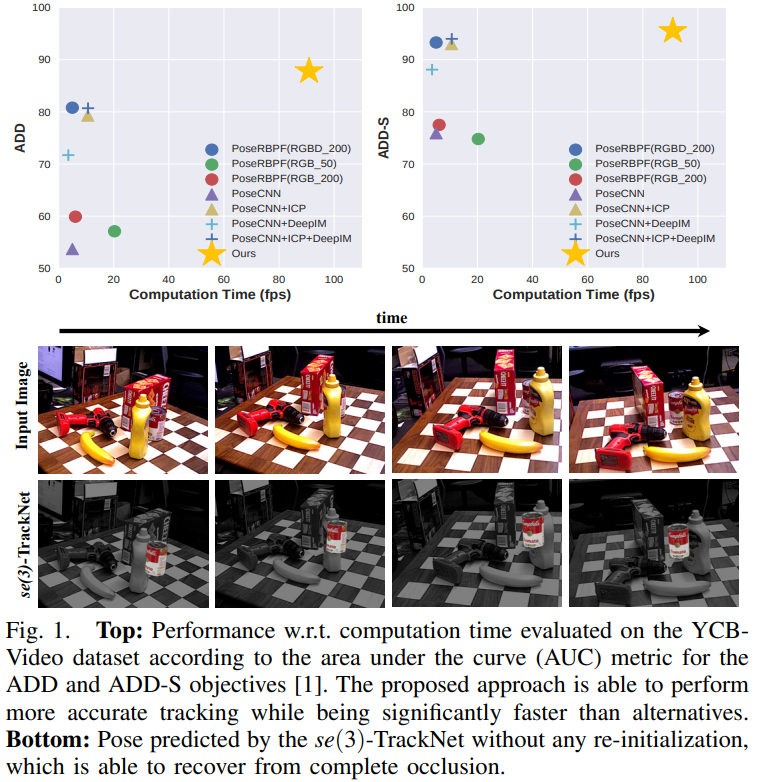

最近,美国Rutgers大学PRACSYS Lab新开源了用于6D物体姿态跟踪的代码Se(3)-TrackNet,该工作已经被IEEE/RSJ International Conference on Intelligent Robots and Systems (IROS)录用。其中第一作者为华人在读博士Bowen Wen,曾在Facebook Reality Labs, Amazon和商汤科技实习。

亮点

该开源项目主要亮点如下

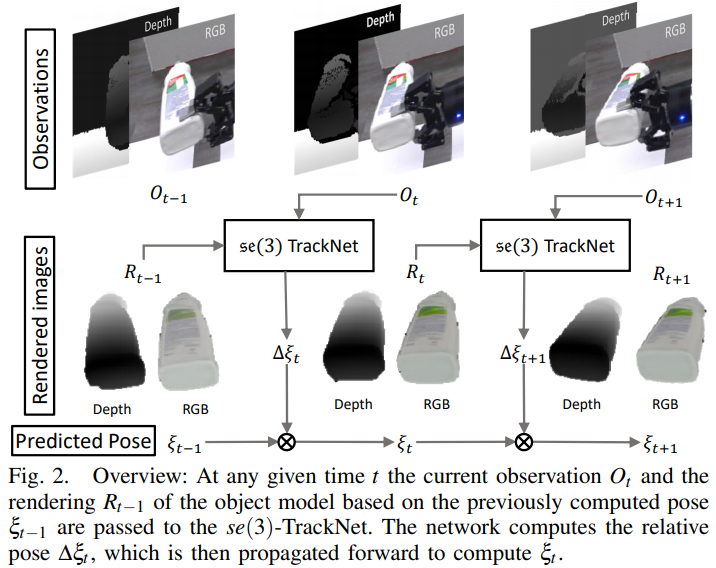

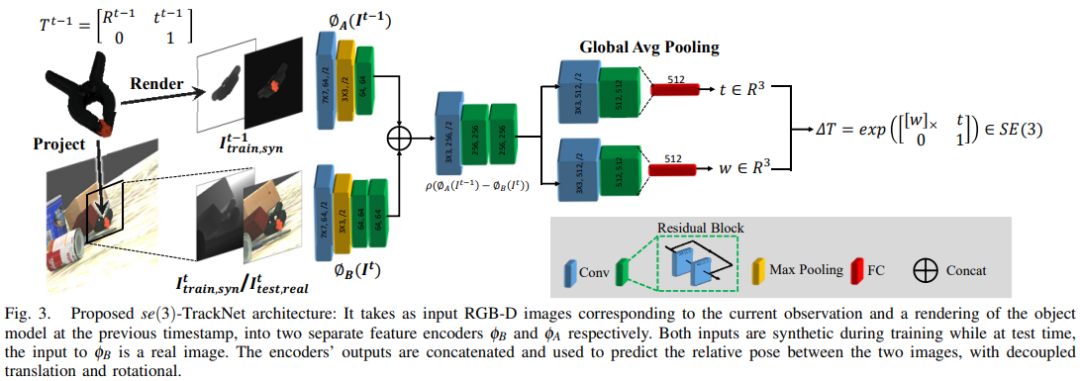

1.提出了全新的端到端的神经网络用于6D物体姿态跟踪。

2.只需要合成的数据进行训练,不需要任何人工标注数据训练,就能在真实世界的视频中表现良好。实现了sim-to-real transfer。

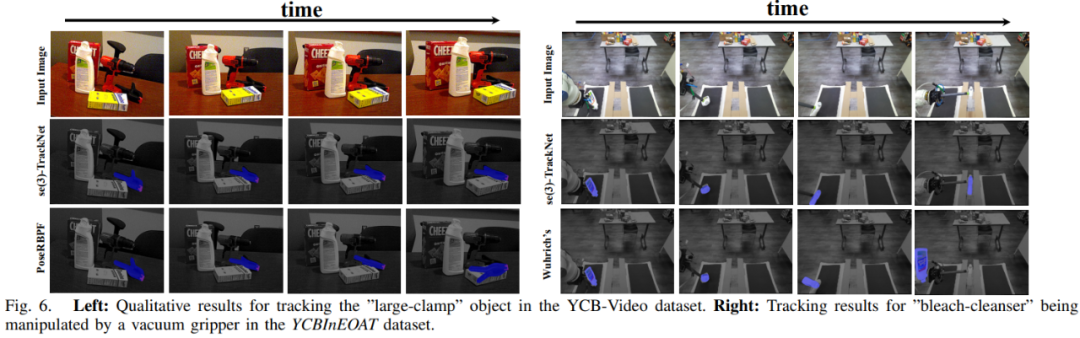

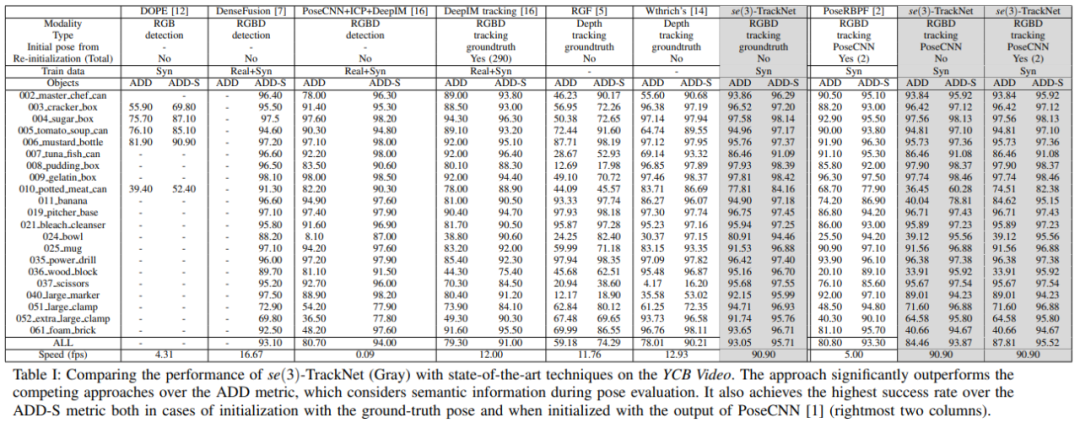

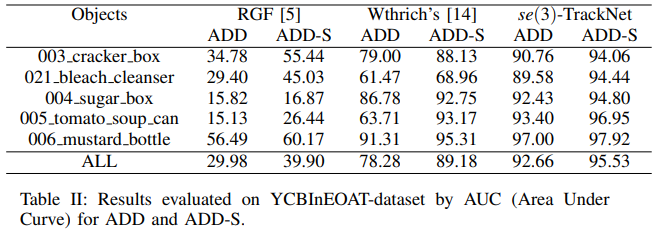

3.在YCB-Video数据集上取得了领先的表现和速度。远远超过其他state of art的方法。

4.此外,作者还发布了一个全新的数据集,名为YCBInEOAT。收集了多个机械臂manipulation过程中的视频并为每一帧提供了6D标注。填补了之前manipulation动态场景中6D物体姿态估计数据集的空白。

开源项目

以下是新开源代码相关的论文、视频、代码、作者个人主页等信息

论文名称:

se(3)-TrackNet: Data-driven 6D Pose Tracking by Calibrating Image Residuals in Synthetic Domains

论文下载:

https://arxiv.org/pdf/2007.13866.pdf

代码链接:

https://github.com/wenbowen123/iros20-6d-pose-tracking

作者个人主页:

https://www.linkedin.com/in/bowen-wen/

先来看下作者介绍的视频,了解一下该工作的主要内容

IROS 2020 报告:

从0到1学习SLAM,戳↓

交流群

欢迎加入公众号读者群一起和同行交流,目前有SLAM、三维视觉、传感器、自动驾驶、计算摄影、检测、分割、识别、医学影像、GAN、算法竞赛等微信群(以后会逐渐细分),请扫描下面微信号加群,备注:”昵称+学校/公司+研究方向“,例如:”张三 + 上海交大 + 视觉SLAM“。请按照格式备注,否则不予通过。添加成功后会根据研究方向邀请进入相关微信群。请勿在群内发送广告,否则会请出群,谢谢理解~

投稿、合作也欢迎联系:simiter@126.com

扫描关注视频号,看最新技术落地及开源方案视频秀 ↓

点击阅读原文到作者个人主页: