工业应用中如何选取合适的损失函数(MAE、MSE、Huber)-Pytorch版

极市导读

本文总结了如何针对应用场景选择合适损失函数、对比不同损失函数的优缺点及相关pytorch代码。>>加入极市CV技术交流群,走在计算机视觉的最前沿

直接上结果:

图片截选自本文末尾

正文:

无论在机器学习还是深度学习领域中,损失函数都是一个非常重要的知识点。损失函数有许多不同的类型,根据具体模型和应用场景需要选择不同的损失函数,如何选择模型的损失函数,是作为算法工程师实践应用中最基础也是最关键的能力之一。最近在学习pytorch的时候,参考了很多说明文档和优秀贴文,总结了如何针对应用场景选择合适损失函数、对比不同损失函数的优缺点及相关pytorch代码,用作学习记录,方便自己回顾。内容包括:

-

基础知识(损失函数、训练目标、训练方法、pytorch) -

回归模型损失函数 (MSE、MAE、Huber损失函数的优缺点,总结应用情形) -

分类模型损失函数 (熵、最大似然)

一.基础知识

在理解各种损失函数的选择原理之前,先回顾一下损失函数、模型训练、训练方法的相关基本概念

损失函数(Loss Function): 用来估量模型的预测值 f(x) 与真实值 y 的偏离程度,以下是选择损失函数的基本要求与高级要求:

-

基本要求:用来衡量模型输出分布和样本标签分布之间的接近程度, -

高级要求:在样本分布不均匀地情况下,精确地描述模型输出分布和样本标签之间的接近程度

模型训练(Training): 训练的过程实质是优化(最小化)损失函数,让 f(x) 与 y 尽量接近。实际上是模型参数拟合的过程(比如使用最小二乘法、梯度下降法求解回归模型中的参数),也可以理解为模型求解的过程(比如使用最大期望法求解概率模型中的参数)。和其他数学建模中的求解参数过程本质上没太大区别。

常用训练方法: 梯度下降算法寻找函数最小值

一般的损失函数的都是直接计算 batch 的数据,因此返回的 loss 结果都是维度为 batch_size的向量, 值得注意的是, pytorch中很多的损失函数都有 size_average 和 reduce 两个布尔类型的参数,具体内容为:

-

如果 reduce = False,那么 size_average 参数失效,直接返回向量形式的 loss;

-

如果 reduce = True,那么 loss 返回的是标量

-

如果 size_average = True,返回 loss.mean(); -

如果 size_average = True,返回 loss.sum();

为了更好地理解损失函数的定义以下代码部分将这两个参数均设置为False

一般来说,工程实践中常用的损失函数大致可以分成两大应用情况:回归(Regression)和分类(Classification)

二.回归模型

1.nn.MSELoss(Mean Square Error)

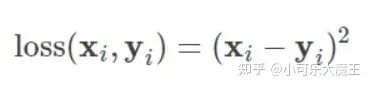

均方损失函数,其数学形式如下:

这里 loss, x, y 的维度是一样的,可以是向量或者矩阵,i 是下标

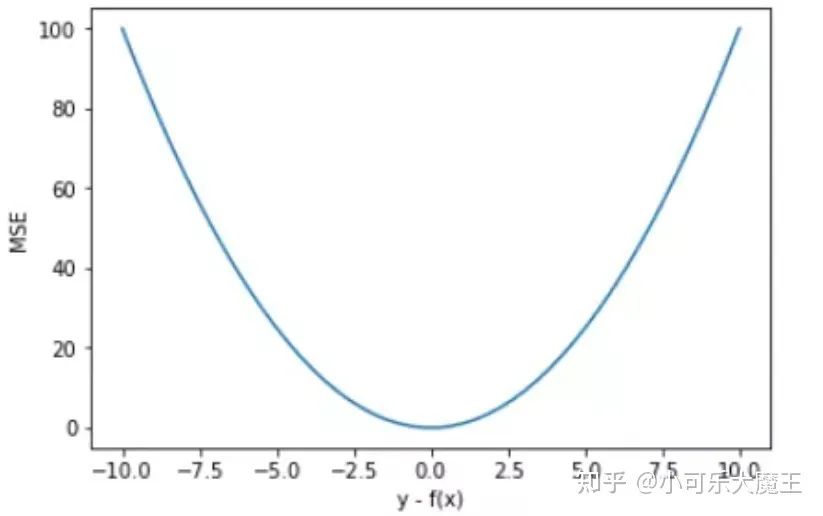

以 y-f(x) 为横坐标,MSE 为纵坐标,绘制其损失函数的图形:

MSE 曲线的特点是光滑连续、可导,便于使用梯度下降算法。平方误差有个特性,就是当 yi 与 f(xi) 的差值大于 1 时,会增大其误差;当 yi 与 f(xi) 的差值小于 1 时,会减小其误差。这是由平方的特性决定的。也就是说, MSE 会对误差较大(>1)的情况给予更大的惩罚,对误差较小(<1)的情况给予更小的惩罚。比如说真实值为1,预测10次,有一次预测值为1000,其余次的预测值为1左右,显然loss值主要由1000决定。

优点:收敛速度快- MSE 随着误差的减小,梯度也在减小,这有利于函数的收敛,即使固定学习率,函数也能较快收敛到最小值。

缺点:离群点影响大从Training的角度来看,模型会更加偏向于惩罚较大的点,赋予其更大的权重,忽略掉较小的点的作用,无法避免离群点可能导致的梯度爆炸问题。如果样本中存在离群点,MSE 会给离群点赋予更高的权重,但是却是以牺牲其他正常数据点的预测效果为代价,因此会导致降低模型的整体性能。

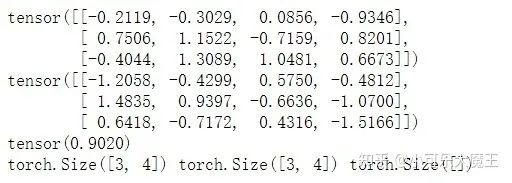

pytorch代码实现:

import torch

from torch.autograd import Variable

import torch.nn as nn

import torch.nn.functional as F

#选择损失函数MSE

loss_func=torch.nn.MSELoss()

#随机生成数据

input=torch.autograd.Variable(torch.randn(3,4))

targets=torch.autograd.Variable(torch.randn(3,4))

#计算loss

loss = loss_func(input, target)

print(input); print(target); print(loss)

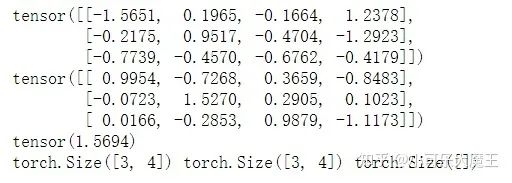

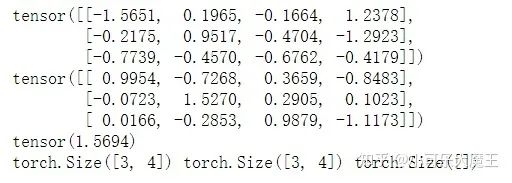

print(input.size(), target.size(), loss.size())输出

2.nn.L1Loss&&MAE(Mean Absolute Error)

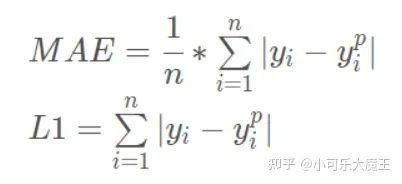

绝对误差与L1误差,两者的误差都是误差指的就是模型预测值 f(x) 与样本真实值 y 之间距离的平均值其公式如下:

要求 x 和 y 的维度要一样(可以是向量或者矩阵),得到的 loss 维度也是对应一样的。这里用下标 i 表示第 i 个元素

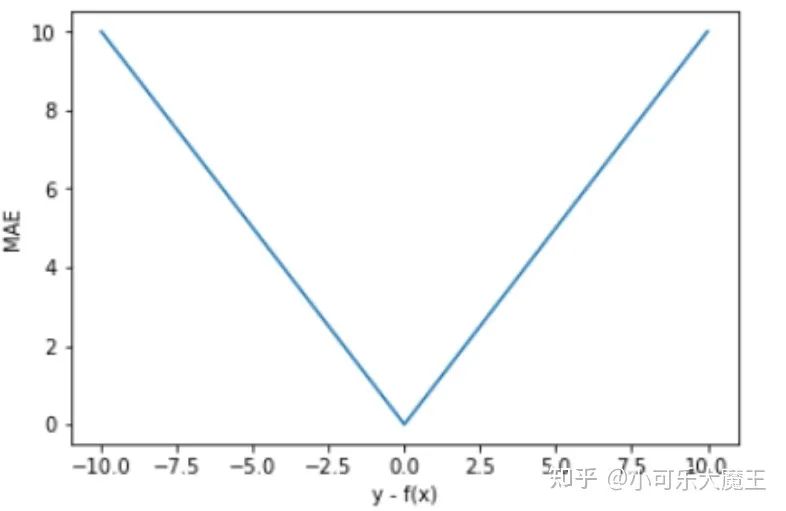

以 y-f(x) 为横坐标,MAE 为纵坐标,绘制其损失函数的图形:

MAE 的曲线呈 V 字型,连续但在 y-f(x)=0 处不可导,计算机求导比较难。且 MAE 大部分情况下梯度相等,这意味着即使对于小的损失值,其梯度也是大的,不利于函数的收敛和模型的学习

优点: 由于MAE 计算的是绝对误差,无论是 y-f(x)>1 还是 y-f(x)<1,没有平方项的作用,惩罚力度相同,因此MAE 相比 MSE 对离群点不过分敏感,拟合直线能够较好地表征正常数据的分布情况,其鲁棒性更好

缺点:MAE训练中梯度始终很大,且在0点连续但不可导,这意味着即使对于小的损失值,其梯度也是大的。这不利于函数的收敛和模型的学习,模型学习速度慢,同时也会导致使用梯度下降训练模型时,在结束时可能会遗漏全局最小值。

MAE曲线连续,但是在(y-f(x)=0)处不可导。

代码实现由torch.nn.L1Loss的参数reduction决定,当参数reduction

-

选择 ‘mean’ 或’none’时,即为MAE, -

选择’sum’时即为L1 loss;

loss_func = torch.nn.L1Loss()

input = torch.autograd.Variable(torch.randn(3,4))

target = torch.autograd.Variable(torch.randn(3,4))

loss = loss_func(input, target)

print(input); print(target); print(loss)

print(input.size(), target.size(), loss.size())输出:

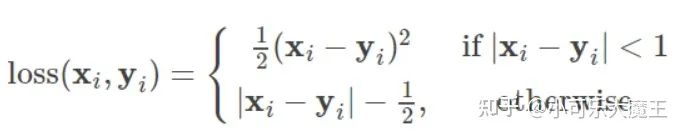

3. nn.SmoothL1Loss(Huber损失函数)

Huber损失函数(平滑平均绝对误差)相比平方误差损失

Huber函数是对MAE和MSE二者的综合,其在函数值为0时,它也是可微分的。,其包含了一个超参数δ,δ 值决定了 Huber侧重于 MSE 还是 MAE 的优秀形式表现

-

当δ~ 0时,Huber损失会趋向于MSE; -

当δ~ ∞(很大的数字),Huber损失会趋向于MAE

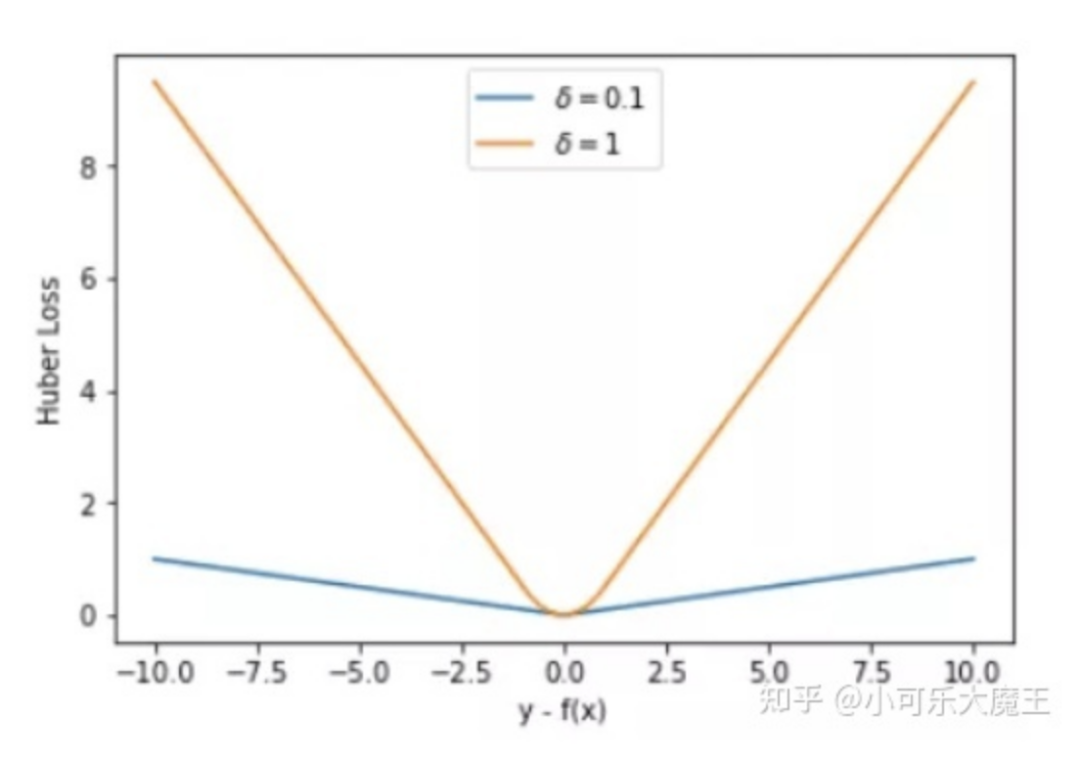

分别取 δ = 0.1、δ = 10,绘制相应的 Huber Loss损失函数的图形::

当 |y−f(x)| > δ 时,梯度一直近似为 δ,能够保证模型以一个较快的速度更新参数

当 |y−f(x)| ≤ δ 时,梯度逐渐减小,也能够保证模型更精确地得到全局最优值该函数实际上就是一个分段函数,在[-1,1]光滑,这样解决了MAE的不光滑问题,在[-∞,1)(1,+∞])区间解决了MSE可能导致的离群点梯度爆炸的问题,即:

Huber 函数它围绕的最小值会减小梯度,且相比MSE,它对异常值更具鲁棒性, Huber 函数同时具备了 MSE 和 MAE 的优点,既弱化了离群点的过度敏感问题,又实现了处处可导的功能

优点: 同时具备了 MSE 和 MAE 的优点,既弱化了离群点的过度敏感问题,又实现了处处可导的功能,收敛速度也快于MAE

-

相比于MAE损失函数,可以收敛得更快; -

相比于MSE损失函数,对离群点、异常值不敏感,梯度变化相对更小,训练时不容易抛出奇怪的结果

注意点: δ超参数需要在训练中选择,常常使用交叉验证法选取合适超参数δ ,超参数的选取直接影响训练的效果的好坏

交叉验证:https://blog.csdn.net/weixin_40475450/article/details/80578943

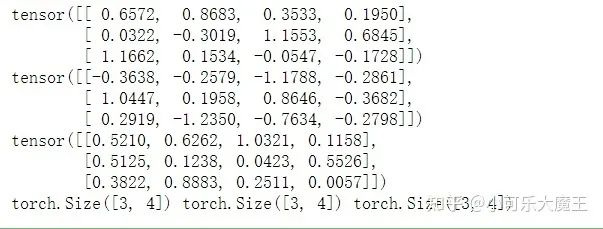

代码实现:

loss_func = torch.nn.SmoothL1Loss(reduce=False, size_average=False)

input = torch.autograd.Variable(torch.randn(3,4))

target = torch.autograd.Variable(torch.randn(3,4))

loss = loss_func(input, target)

print(input); print(target); print(loss)

print(input.size(), target.size(), loss.size())代码结果:

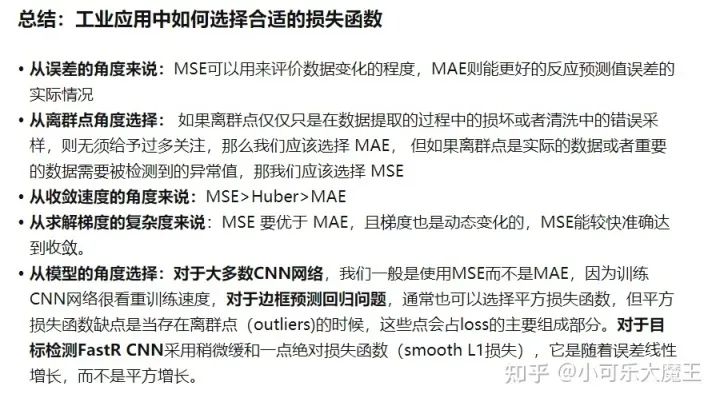

总结:工业应用中如何选择合适的损失函数

-

从误差的角度来说: MSE可以用来评价数据变化的程度,MAE则能更好的反应预测值误差的实际情况 -

从离群点角度选择: 如果离群点仅仅只是在数据提取的过程中的损坏或者清洗中的错误采样,则无须给予过多关注,那么我们应该选择 MAE, 但如果离群点是实际的数据或者重要的数据需要被检测到的异常值,那我们应该选择 MSE -

从收敛速度的角度来说: MSE>Huber>MAE -

从求解梯度的复杂度来说:MSE 要优于 MAE,且梯度也是动态变化的,MSE能较快准确达到收敛。 -

从模型的角度选择:对于大多数CNN网络,我们一般是使用MSE而不是MAE,因为训练CNN网络很看重训练速度, 对于边框预测回归问题,通常也可以选择平方损失函数,但平方损失函数缺点是当存在离群点(outliers)的时候,这些点会占loss的主要组成部分。 对于目标检测FastR CNN采用稍微缓和一点绝对损失函数(smooth L1损失),它是随着误差线性增长,而不是平方增长。

公众号后台回复“项目实践”获取50+CV项目实践机会~

“

点击阅读原文进入CV社区

收获更多技术干货