机器之心 & ArXiv Weekly Radiostation

本周重要论文包括能「造孩子」的机器人以及谷歌公开的裸眼3D全息视频聊天背后的技术。

Why Generalization in RL is Difficult: Epistemic POMDPs and Implicit Partial Observability

AI in Games: Techniques, Challenges and Opportunities

Dynamic Visual Reasoning by Learning Differentiable Physics Models from Video and Language

Kinematic Self-replication in Reconfigurable Organisms

SOFT: Softmax-free Transformer with Linear Complexity

Advancing Mathematics by Guiding Human Intuition with AI

Project Starline: A high-fidelity telepresence system

ArXiv Weekly Radiostation:NLP、CV、ML 更多精选论文(附音频)

论文 1:Why Generalization in RL is Difficult: Epistemic POMDPs and Implicit Partial Observability

摘要:

当今强化学习(RL)的问题很多,诸如收敛效果不好。在偏弱的实验环境里,模型测试结果看起来尚可,许多问题暴露得不明显,但大量实验已经证明深度 RL 泛化很困难:尽管 RL 智能体可以学习执行非常复杂的任务,但它似乎对不同任务的泛化能力较差,相比较而言,监督深度网络具有较好的泛化能力。有研究者认为,对于监督学习来说,发生一次错误只是分类错一张图片。而对于 MDP(马尔可夫决策过程)假设下的 RL,一次识别错误就会导致次优决策,甚至可能一直错误下去,这也是 RL 在现实世界没法用的根源。为什么强化学习的泛化能力从根本上来说很难,甚至从理论的角度来说也很难?

来自加州大学伯克利分校的博士生 Dibya Ghosh 等研究者撰文解释了这一现象,从认知 POMDP(Epistemic POMDP)、隐式部分可观察(Implicit Partial Observability)两个方面进行解释。论文共同一作 Dibya Ghosh 的研究方向是使用强化学习进行决策。之前,他曾在蒙特利尔的 Google Brain 工作。

![]()

推荐:

为何 RL 泛化这么难:UC 伯克利博士从认知 POMDP、隐式部分可观察解读。

论文 2:AI in Games: Techniques, Challenges and Opportunities

摘要:

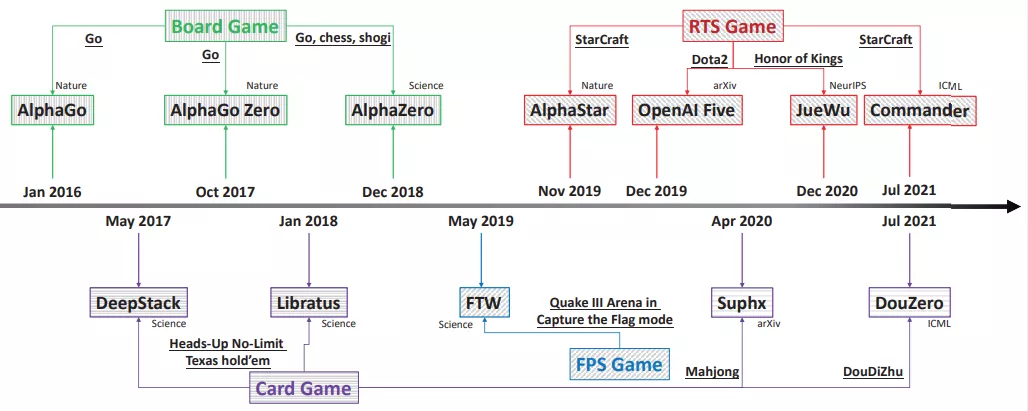

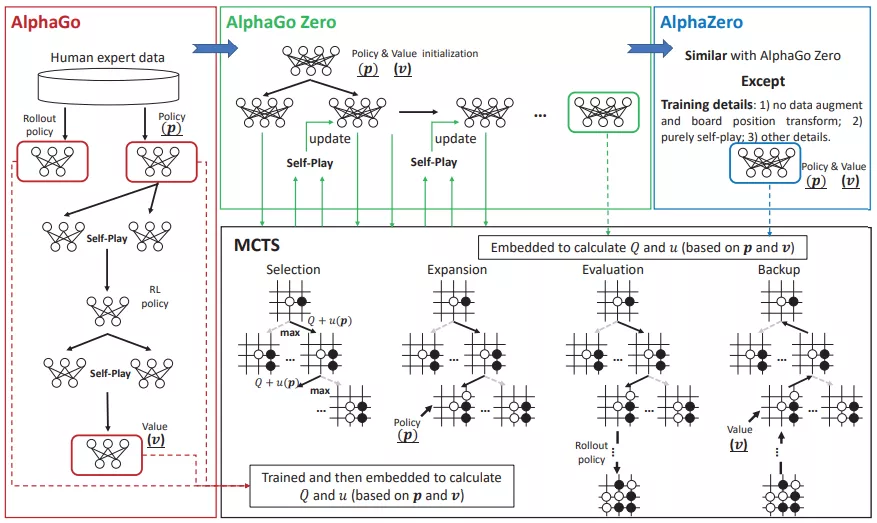

近年来,我们见证了游戏 AI 的快速发展,从 Atari、AlphaGo、Libratus、OpenAI Five 到 AlphaStar 。这些 AI 通过结合现代技术在某些游戏中击败了职业人类玩家,标志着决策智能领域的快速发展。AlphaStar(DeepMind 开发的计算机程序) 和 OpenAI Five(美国人工智能研究和 OpenAI 开发)分别在星际争霸和 Dota2 中达到了专业玩家水平。现在看来,目前的技术可以处理非常复杂的不完美信息游戏,特别是在最近大火的王者荣耀等游戏中的突破,它们都遵循了类似 AlphaStar 和 OpenAI Five 的框架。

我们不禁会问:人机游戏 AI 的未来趋势或挑战是什么?来自中国科学院自动化研究所以及中国科学院大学的研究者撰文回顾了最近典型的人机游戏 AI,并试图通过对当前技术的深入分析来回答这些问题。

![]()

![]()

推荐:

通过这篇文章,研究者希望初学者能够快速熟悉游戏 AI 这个领域的技术、挑战和机遇,并能启发在路上的研究人员进行更深入的研究。

论文 3:Dynamic Visual Reasoning by Learning Differentiable Physics Models from Video and Language

摘要:

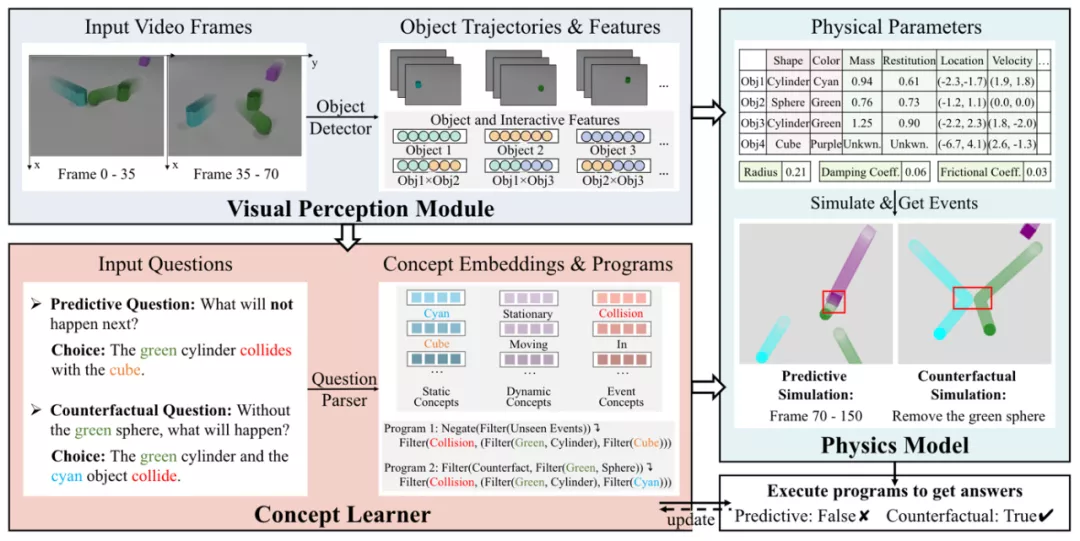

动态视觉推理(Dynamic Visual Reasoning),尤其是涉及到物体间物理关系的推理,是计算机视觉中一个重要且困难的问题。给定一个观测视频,它不仅要求模型根据视频推理出视频中物体的交互过程,还要求对视频的长期未来(Long-term)以及反事实(Counterfactual)情形进行预测,而这两项预测恰好是现有神经网络模型的弱点。现有方法可以大致被分为两类:使用端到端神经网络(如 Vision Transformer)来对物体间关系进行建模的方法 [3],和基于神经符号(Neuro-Symbolic)的推理模型 [2, 4];前者受益于 Transformer 等的强大表征有着不错的性能,但是其依赖大量数据,且推理过程不透明且难以解释;而后者基于神经符号逐步进行推理,模型具有良好的解释性,但是精度受限;此外,现有方案都难以解决长期和反事实预测的难题。

本文提出的基于可微物理模型的神经符号推理框架很好的解决了这个问题,它通过从视频和问题对中学习物理模型,并利用显式的物理模型对物体动力学进行建模,基于准确的动力学预测来回答长期和反事实预测问题。本文的框架透明可解释,并在精度上超过了基于 Transformer 的模型。此外,它显示了良好的数据效率,在只使用 20% 甚至更少的数据即可取得不错的效果。本文作者来自香港大学 (HKU),麻省理工大学 (MIT) 和 MIT-IBM 沃森人工智能实验室,论文已被 NeurIPS 2021 接收。

![]()

VRDP 框架。由三部分组成:视觉感知模块、概念学习器和可微物理模型

![]()

推荐:

精度超越 Transformer,MIT、港大提出基于物理模型的 Neuro-Symbolic 视觉推理框架。

论文 4:Kinematic Self-replication in Reconfigurable Organisms

摘要:

机器人一定要是金属、塑料、木头、混凝土这些材料做的吗?去年,美国佛蒙特大学和塔夫茨大学的研究者给出了一个否定的答案。他们依靠进化算法,利用青蛙的表皮细胞和心肌细胞造出了全球首批活体机器人,并将其命名为「Xenobot」。

「Xenobot」不同于传统机器人,也不是已知的某种动物物种,而是一种新型的、具有生命的、可编程的生物。而且,它们可以自主移动,即使被切开也能够自动愈合。

![]()

![]()

推荐:

机器人也能「造孩子」:全球首个活体机器人创生命繁衍新方式。

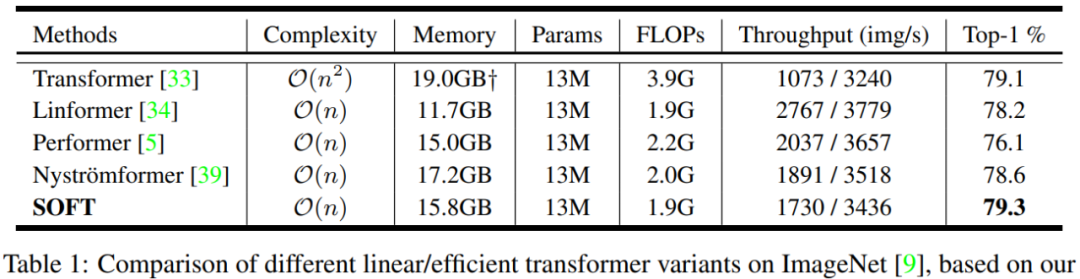

论文 5:SOFT: Softmax-free Transformer with Linear Complexity

摘要:

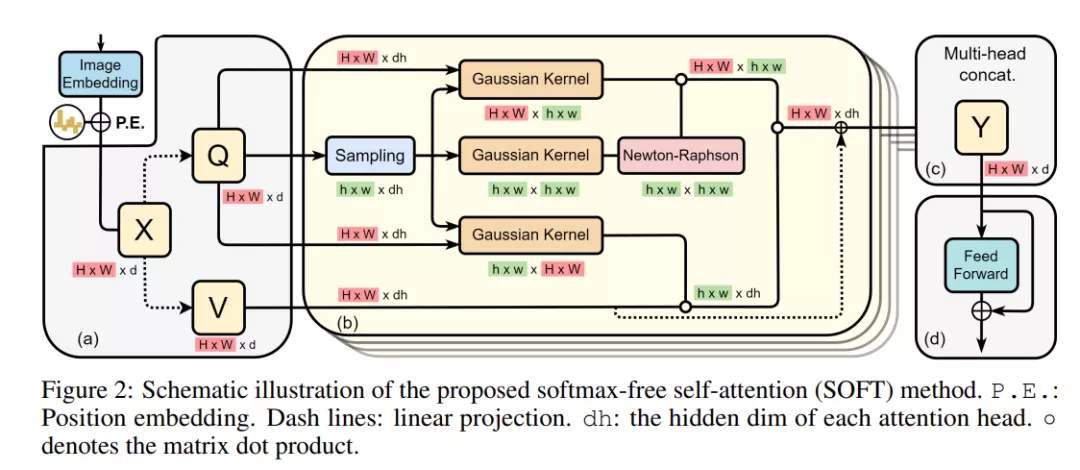

近日,来自复旦大学、萨里大学和华为诺亚方舟实验室的研究者在一项研究中经过深入分析表明,这些尝试要么在理论上存在缺陷,要么在实验中对视觉识别无效,并进一步发现这些方法的局限性在于在近似过程中仍然保持 softmax 自注意力。具体来说,传统的自注意力是通过对标记特征向量之间的缩放点积(scaled dot-product)进行归一化来计算的。保持这种 softmax 操作阻碍了线性化 Transformer 的复杂度。基于此,该研究首次提出了一种无 softmax Transformer(softmax-free transformer,SOFT)。

为了去除 self-attention 中的 softmax,使用高斯核函数(Gaussian kernel function)代替点积相似度,无需进一步归一化。这使得可以通过低秩矩阵分解来近似一个完整的自注意力矩阵。通过使用 Newton-Raphson 方法计算其 Moore-Penrose 逆来实现近似的稳健性。ImageNet 上的大量实验表明,SOFT 显着提高了现有 ViT 变体的计算效率。至关重要的是,对于线性复杂性,SOFT 中允许更长的 token 序列,从而在准确性和复杂性之间实现卓越的权衡。

![]()

所提出的无 softmax 自注意力 (SOFT) 方法的示意图。P.E.:位置嵌入。虚线:线性投影。dh:每个注意力头的隐藏暗淡。◦ 表示矩阵点积。

![]()

推荐:

解决 Transformer 固有缺陷:复旦大学等提出线性复杂度 SOFT。

论文 6:Advancing Mathematics by Guiding Human Intuition with AI

摘要:

DeepMind 作为一家全球领先的人工智能公司,他们探索了机器学习 (ML) 在识别数学结构和模式方面的潜力。现在他们帮助数学家解决了一些数学难题,成为 AI 首次探索纯数学的前沿研究,相关论文今天已在《自然》杂志上发表。

具体来说,DeepMind 与顶级数学家合作,将 AI 应用于纯数学中的两个领域:拓扑和表示论。其中 DeepMind 与牛津大学的 Marc Lackenby 教授和 András Juhász 教授一起,通过研究纽结 (Knot) 的结构发现了不同数学领域之间的意外联系;与悉尼大学的 Geordie Williamson 教授一起,DeepMind 发现了一个关于排列猜想的新公式,该猜想几十年来一直未解决。

![]()

DeepMind 假设在一个纽结的双曲不变量和代数不变量之间存在一种未被发现的关系。监督学习模型能够检测大量几何不变量和 signature σ(K) 之间存在的模式,并用归因技术(attribution technique)确定最相关的特征。下图 3(a) 显示了 cusp 几何的三个不变量,图 3b 中部分地显示了其中的关系。

![]()

推荐:

引导直觉解决数学猜想难题,DeepMind 登上《Nature》封面。

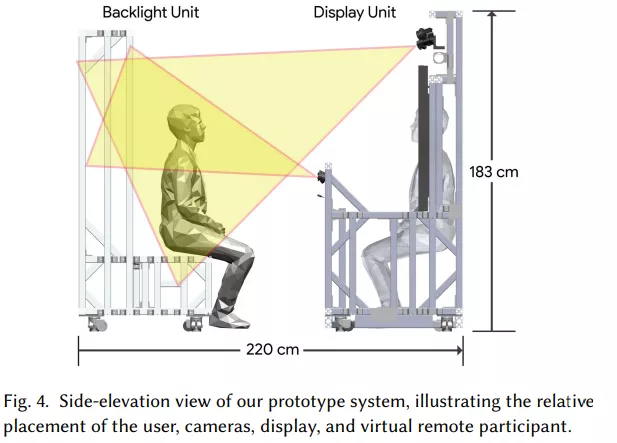

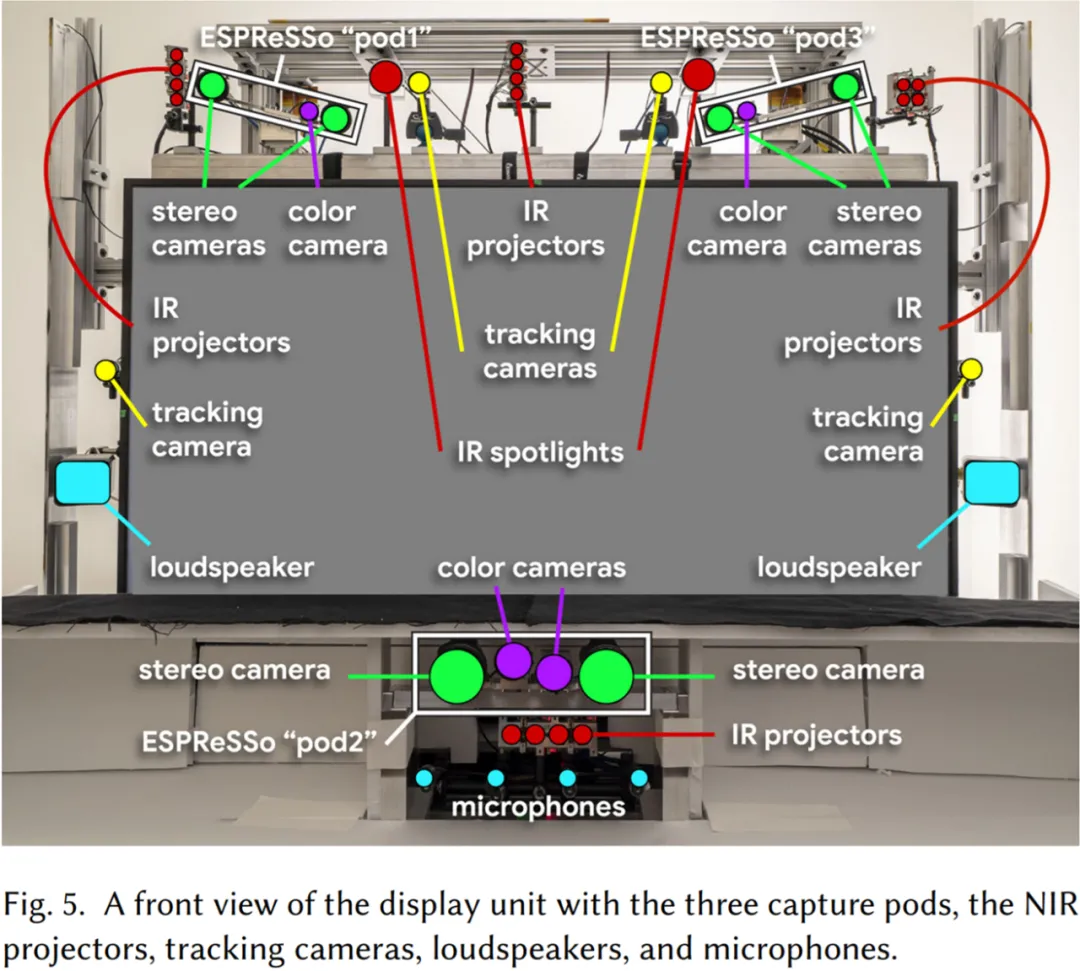

论文 7:Project Starline: A high-fidelity telepresence system

摘要:

今年 5 月举行的谷歌 I/O 大会上,在谷歌园区户外进行的开场 Keynote 上,这家公司发布了一系列引人瞩目的全新产品。在会上,谷歌公布了一个秘密开发多年的黑科技:全息视频聊天技术 Project Starline。Project Starline 本质上是一个 3D 视频聊天室,取代一对一的 2D 视频电话会议,让用户感觉就像坐在真人面前一样。通过 Starline,相互视频的人,不需要佩戴任何眼镜或者头盔,真实的就像坐在对面聊天一样,人物细节饱满。

![]()

![]()

推荐:

论文来了!谷歌公开裸眼 3D 全息视频聊天技术:8k 屏幕、4 块 GPU 和一堆摄像头。

ArXiv Weekly Radiostation

机器之心联合由楚航、罗若天发起的ArXiv Weekly Radiostation,在 7 Papers 的基础上,精选本周更多重要论文,包括NLP、CV、ML领域各10篇精选,并提供音频形式的论文摘要简介,详情如下:

1. Predicting Document Coverage for Relation Extraction. (from Gerhard Weikum)

2. Systematic Generalization with Edge Transformers. (from Dzmitry Bahdanau)

3. CO2Sum:Contrastive Learning for Factual-Consistent Abstractive Summarization. (from Wei Liu)

4. Emergent Graphical Conventions in a Visual Communication Game. (from Song-Chun Zhu)

5. An analysis of document graph construction methods for AMR summarization. (from Kathleen McKeown)

6. SimCLAD: A Simple Framework for Contrastive Learning of Acronym Disambiguation. (from Shutao Li)

7. PSG: Prompt-based Sequence Generation for Acronym Extraction. (from Shutao Li)

8. NLP Research and Resources at DaSciM, Ecole Polytechnique. (from Michalis Vazirgiannis)

9. Enhancing Identification of Structure Function of Academic Articles Using Contextual Information. (from Yuzhuo Wang)

10. Near-Zero-Shot Suggestion Mining with a Little Help from WordNet. (from Sergey Nikolenko)

本周 10 篇 CV 精选论文是:

1. Improved Multiscale Vision Transformers for Classification and Detection. (from Jitendra Malik)

2. SEAL: Self-supervised Embodied Active Learning using Exploration and 3D Consistency. (from Jitendra Malik, Ruslan Salakhutdinov)

3. Equitable modelling of brain imaging by counterfactual augmentation with morphologically constrained 3D deep generative models. (from Sebastien Ourselin, John Ashburner)

4. Multiway Non-rigid Point Cloud Registration via Learned Functional Map Synchronization. (from Leonidas J. Guibas, Shi-Min Hu)

5. MDFM: Multi-Decision Fusing Model for Few-Shot Learning. (from Yan-Jiang Wang)

6. AdaAfford: Learning to Adapt Manipulation Affordance for 3D Articulated Objects via Few-shot Interactions. (from Leonidas Guibas)

7. Semi-Supervised 3D Hand Shape and Pose Estimation with Label Propagation. (from Richard Hartley)

8. Neural Collaborative Graph Machines for Table Structure Recognition. (from Bing Liu)

9. Routing with Self-Attention for Multimodal Capsule Networks. (from Mubarak Shah)

10. OW-DETR: Open-world Detection Transformer. (from Mubarak Shah)

本周 10 篇 ML 精选论文是:

1. Differentiable Spatial Planning using Transformers. (from Jitendra Malik)

2. Towards Principled Disentanglement for Domain Generalization. (from Bernhard Schölkopf, Eric P. Xing)

3. Group equivariant neural posterior estimation. (from Bernhard Schölkopf)

4. Spatio-Temporal Joint Graph Convolutional Networks for Traffic Forecasting. (from Philip S. Yu)

5. Adversarial Factor Models for the Generation of Improved Autism Diagnostic Biomarkers. (from Guillermo Sapiro)

6. Intrinsic Dimension, Persistent Homology and Generalization in Neural Networks. (from Leonidas Guibas)

7. Editing a classifier by rewriting its prediction rules. (from Antonio Torralba)

8. On the Generalization of Agricultural Drought Classification from Climate Data. (from Markus Reichstein)

9. Efficient Online Bayesian Inference for Neural Bandits. (from Kevin Murphy)

10. Hierarchical Prototype Networks for Continual Graph Representation Learning. (from Dacheng Tao)

![]()

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:content@jiqizhixin.com