【大会】还记得Wasserstein GAN吗?不仅有Facebook参与,也果然被 ICML 接收

Wasserstein GAN

来源:AI科技评论

作者:晓凡

Facebook列出了自己的9篇 ICML 2017论文,Wasserstein GAN 赫然位列其中。

ICML 2017 仍然在悉尼火热进行中,Facebook 研究院今天也发文介绍了自己的 ICML 论文。Facebook有9篇论文被 ICML 2017接收,这些论文的主题包括语言建模、优化和图像的无监督学习;另外 Facebook 还会共同参与组织 Video Games and Machine Learning Workshop。

曾掀起研究热潮的 Wasserstein GAN

在9篇接收论文中,Facebook 自己最喜欢的是「Wasserstein Generative Adversarial Networks」(WGAN)这一篇,它也确实对整个机器学习界有巨大的影响力,今年也掀起过一阵 WGAN 的热潮。

Ian Goodfellow 提出的原始的 GAN 大家都非常熟悉了,利用对抗性的训练过程给生成式问题提供了很棒的解决方案,应用空间也非常广泛,从此之后基于 GAN 框架做应用的论文层出不穷,但是 GAN 的训练困难、训练进程难以判断、生成样本缺乏多样性(mode collapse)等问题一直没有得到完善解决。 这篇 Facebook 和纽约大学库朗数学科学研究所的研究员们合作完成的 WGAN 论文就是众多尝试改进 GAN、解决它的问题的论文中具有里程碑意义的一篇。

WGAN 的作者们其实花了整整两篇论文才完全表达了自己的想法。在第一篇「Towards Principled Methods for Training Generative Adversarial Networks」里面推了一堆公式定理,从理论上分析了原始GAN的问题所在,从而针对性地给出了改进要点;在这第二篇「Wasserstein Generative Adversarial Networks」里面,又再从这个改进点出发推了一堆公式定理,最终给出了改进的算法实现流程。

WGAN 成功地做到了以下爆炸性的几点:

彻底解决GAN训练不稳定的问题,不再需要小心平衡生成器和判别器的训练程度

基本解决了collapse mode的问题,确保了生成样本的多样性

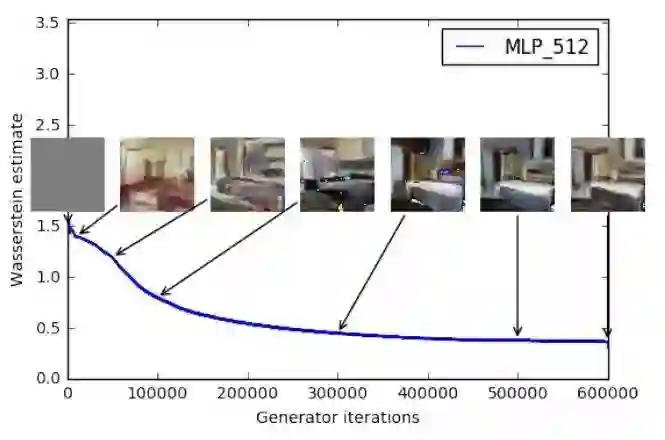

训练过程中终于有一个像交叉熵、准确率这样的数值来指示训练的进程,这个数值越小代表GAN训练得越好,代表生成器产生的图像质量越高(如题图所示)

以上一切好处不需要精心设计的网络架构,最简单的多层全连接网络就可以做到

而改进后相比原始GAN的算法实现流程却只改了四点:

判别器最后一层去掉sigmoid

生成器和判别器的loss不取log

每次更新判别器的参数之后把它们的绝对值截断到不超过一个固定常数c

不要用基于动量的优化算法(包括momentum和Adam),推荐RMSProp,SGD也行

所以数学学得好真的很重要,正是靠着对 GAN 的原理和问题的深入分析,才能够找到针对性的方法改进问题,而且最终的呈现也这么简单。( WGAN详解参见AI科技评论文章 令人拍案叫绝的Wasserstein GAN)

WGAN 论文今年1月公布后马上引起了轰动,Ian Goodfellow 也在 reddit 上和网友们展开了热烈的讨论。不过在讨论中,还是有人反映 WGAN 存在训练困难、收敛速度慢等问题,WGAN 论文一作 Martin Arjovsky 也在 reddit 上表示自己意识到了,然后对 WGAN 做了进一步的改进。

改进后的论文为「Improved Training of Wasserstein GANs」。原来的 WGAN 中采用的 Lipschitz 限制的实现方法需要把判别器参数的绝对值截断到不超过固定常数 c,问题也就来自这里,作者的本意是避免判别器给出的分值区别太大,用较小的梯度配合生成器的学习;但是判别器还是会追求尽量大的分值区别,最后就导致参数的取值总是最大值或者最小值,浪费了网络优秀的拟合能力。改进后的 WGAN-GP 中更换为了梯度惩罚 gradient penalty,判别器参数就能够学到合理的参数取值,从而显著提高训练速度,解决了原始WGAN收敛缓慢的问题,在实验中还第一次成功做到了“纯粹的”的文本GAN训练。(WGAN-GP详解参见AI科技评论文章 掀起热潮的Wasserstein GAN,在近段时间又有哪些研究进展?)

另外八篇论文

Facebook 此次被 ICML 2017 接收的9篇论文里的另外8篇如下,欢迎感兴趣的读者下载阅读。

High-Dimensional Variance-Reduced Stochastic Gradient Expectation-Maximization Algorithm

http://proceedings.mlr.press/v70/zhu17a/zhu17a.pdf

An Analytical Formula of Population Gradient for two-layered ReLU network and its Applications in Convergence and Critical Point Analysis

作者田渊栋

https://arxiv.org/abs/1703.00560v2

Convolutional Sequence to Sequence Learning

http://proceedings.mlr.press/v70/gehring17a/gehring17a.pdf

Efficient softmax approximation for GPUs

http://proceedings.mlr.press/v70/grave17a/grave17a.pdf

Gradient Boosted Decision Trees for High Dimensional Sparse Output

http://proceedings.mlr.press/v70/si17a/si17a.pdf

Language Modeling with Gated Convolutional Networks

http://proceedings.mlr.press/v70/dauphin17a/dauphin17a.pdf

Parseval Networks: Improving Robustness to Adversarial Examples

http://proceedings.mlr.press/v70/cisse17a/cisse17a.pdf

Unsupervised Learning by Predicting Noise

http://proceedings.mlr.press/v70/bojanowski17a/bojanowski17a.pdf

☞ 【学界】邢波团队提出contrast-GAN:实现生成式语义处理

☞ 【专栏】阿里SIGIR 2017论文:GAN在信息检索领域的应用

☞ 【学界】康奈尔大学说对抗样本出门会失效,被OpenAI怼回来了!

☞ 警惕人工智能系统中的木马、病毒 ——深度学习对抗样本简介

☞ 【生成图像】Facebook发布的LR-GAN如何生成图像?这里有一篇Pytorch教程

☞ 【智能自动化学科前沿讲习班第1期】国立台湾大学(位于中国台北)李宏毅教授:Anime Face Generation

☞ 【变狗为猫】伯克利图像迁移cycleGAN,猫狗互换效果感人

☞ 【论文】对抗样本到底会不会对无人驾驶目标检测产生干扰?又有人发文质疑了

☞【智能自动化学科前沿讲习班第1期】王飞跃教授:生成式对抗网络GAN的研究进展与展望

☞【专栏】基于对抗学习的生成式对话模型的坚实第一步 :始于直观思维的曲折探索

☞ 【重磅】平行将成为一种常态:从SimGAN获得CVPR 2017最佳论文奖说起

☞ 【最新】OpenAI:3段视频演示无人驾驶目标检测强大的对抗性样本!

☞ 【论文】CVPR 2017最佳论文出炉,DenseNet和苹果首篇论文获奖

☞ 【深度学习】解析深度学习的局限性与未来,谷歌Keras之父「连发两文」发人深省

☞ 苹果重磅推出AI技术博客,CVPR合成逼真照片论文打响第一枪

☞ 【Ian Goodfellow 五问】GAN、深度学习,如何与谷歌竞争

☞ 【巨头升级寡头】AI产业数据称王,GAN和迁移学习能否突围BAT垄断?

☞ 【高大上的DL】BEGAN: Boundary Equilibrium GAN

☞ 【最详尽的GAN介绍】王飞跃等:生成式对抗网络 GAN 的研究进展与展望

☞ 【最全GAN变体列表】Ian Goodfellow推荐:GAN动物园

☞ 【DCGAN】深度卷积生成对抗网络的无监督学习,补全人脸合成图像匹敌真实照片

☞ 【开源】收敛速度更快更稳定的Wasserstein GAN(WGAN)

☞ 【Valse 2017】生成对抗网络(GAN)研究年度进展评述

☞ 【开源】谷歌新推BEGAN模型用于人脸数据集:效果惊人!

☞ 【深度】Ian Goodfellow AIWTB开发者大会演讲:对抗样本与差分隐私

☞ 论文引介 | StackGAN: Stacked Generative Adversarial Networks

☞ 【纵览】从自编码器到生成对抗网络:一文纵览无监督学习研究现状

☞ 【论文解析】Ian Goodfellow 生成对抗网络GAN论文解析

☞ 【推荐】条条大路通罗马LS-GAN:把GAN建立在Lipschitz密度上

☞【Geometric GAN】引入线性分类器SVM的Geometric GAN

☞ 【GAN for NLP】PaperWeekly 第二十四期 --- GAN for NLP

☞ 【Demo】GAN学习指南:从原理入门到制作生成Demo

☞ 【学界】伯克利与OpenAI整合强化学习与GAN:让智能体学习自动发现目标

☞ 【人物 】Ian Goodfellow亲述GAN简史:人工智能不能理解它无法创造的东西

☞ 【DCGAN】DCGAN:深度卷积生成对抗网络的无监督学习,补全人脸合成图像匹敌真实照片

☞ 带你理解CycleGAN,并用TensorFlow轻松实现

☞ PaperWeekly 第39期 | 从PM到GAN - LSTM之父Schmidhuber横跨22年的怨念

☞ 【CycleGAN】加州大学开源图像处理工具CycleGAN

☞ 【SIGIR2017满分论文】IRGAN:大一统信息检索模型的博弈竞争

☞ 【贝叶斯GAN】贝叶斯生成对抗网络(GAN):当下性能最好的端到端半监督/无监督学习

☞ 【贝叶斯GAN】贝叶斯生成对抗网络(GAN):当下性能最好的端到端半监督/无监督学习

☞ 【GAN X NLP】自然语言对抗生成:加拿大研究员使用GAN生成中国古诗词

☞ ICLR 2017 | GAN Missing Modes 和 GAN

☞ 【学界】CMU新研究试图统一深度生成模型:搭建GAN和VAE之间的桥梁

☞ 【专栏】大漠孤烟,长河落日:面向景深结构的风景照生成技术

☞ 【开发】最简单易懂的 GAN 教程:从理论到实践(附代码)

☞ 【论文访谈】求同存异,共创双赢 - 基于对抗网络的利用不同分词标准语料的中文分词方法

☞ 【LeCun论战Yoav】自然语言GAN惹争议:深度学习远离NLP?

☞ 【争论】从Yoav Goldberg与Yann LeCun争论,看当今的深度学习、NLP与arXiv风气

☞ 【观点】Yoav Goldberg撰文再回应Yann LeCun:「深度学习这群人」不了解NLP(附各方评论)

☞ PaperWeekly 第41期 | 互怼的艺术:从零直达 WGAN-GP

☞ 【谷歌 GAN 生成人脸】对抗创造新艺术风格,128 像素扩展到 4000

☞ 【原理】只知道GAN你就OUT了——VAE背后的哲学思想及数学原理