干货书!最新《现代统计学习导论》简明书,124页pdf精炼阐述统计学习与推理方法

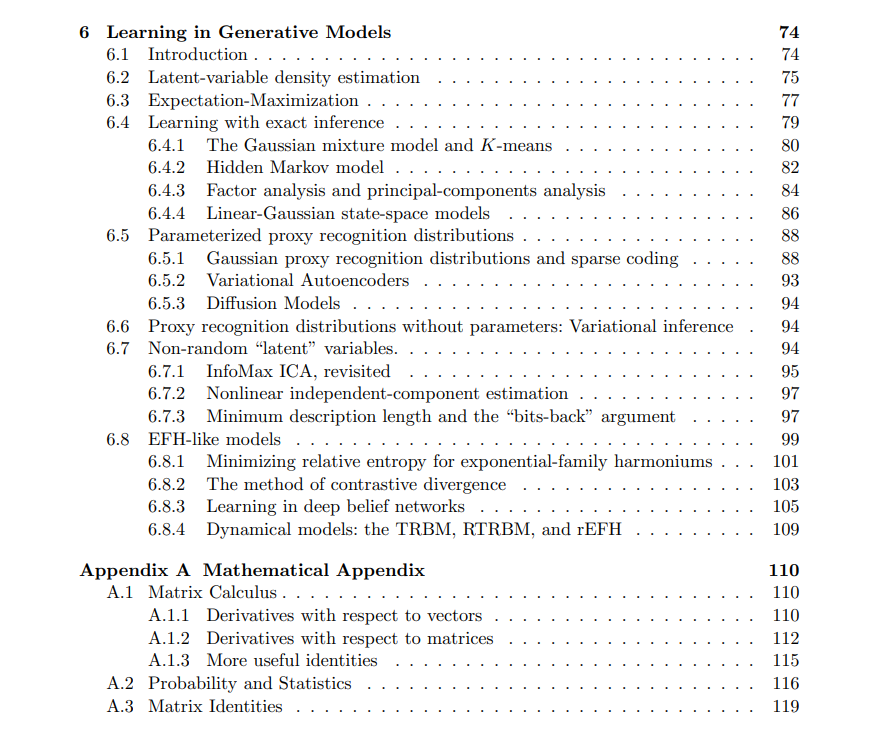

这项正在进行的工作旨在提供统计学习的统一介绍,从经典模型(如GMM和HMM)慢慢构建到现代神经网络(如VAE和扩散模型)。今天,有许多互联网资源单独地解释这个或那个新的机器学习算法,但它们没有(也不能,在这么短的时间内)将这些算法彼此联系起来,或将这些算法与统计模型的经典文献联系起来,现代算法就是从这些文献中产生的。另一个明显缺乏的是单一的符号系统,尽管对于那些已经熟悉材料的人来说(如这些帖子的作者)并不困扰,但这增加了新手进入的巨大障碍。同样,我的目标是尽可能地将各种模型同化为一个单一的框架来进行推理和学习,展示如何(以及为什么)将一个模型转变为另一个模型,而最小化更改(其中一些是新颖的,其他来自文献)。一些背景知识当然是必要的。我假设读者熟悉基本的多变量微积分、概率和统计以及线性代数。这本书的目标当然不是完整的,而是或多或少地从基础知识到过去十年中极其强大的新模型的直线路径。

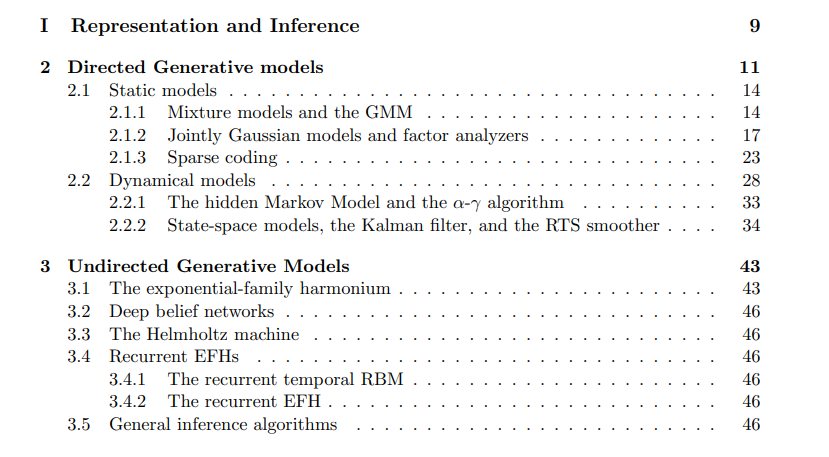

第一部分:表示和推理

我们通常从一组变量和(假设的)它们之间的统计相关性开始我们的综述。注意,这个集合可能包括“潜在”变量,我们还没有观察到这些变量。推理是本书的两个主要操作之一(另一个是学习),它由使用某种模型和对非潜在变量(“观察到的”或“专利的”变量)的观察来估计未观察到的或潜在的变量组成。更准确地说,我们可以根据观测到的变量,推断出其中一些或所有变量的概率分布。相反,学习包括为模型参数寻找最优数值。因此,推理和学习分别是概率和统计领域的问题。尽管如此,学习可以被同化为推理(贝叶斯推理),推理也可以被同化为学习(变分推理)。在接下来的两章中,我们将假设我们的数据模型是“完美的”——尽管我们仍然将通过分别使用p和ˆp对应的概率分布来保持模型生成过程和真实生成过程之间的区别。

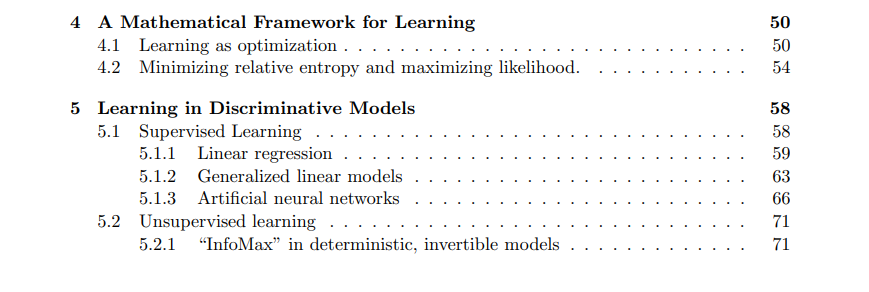

第二部分:学习

对于机器,无论是生物的还是人工的,“学习”意味着什么?模糊地说,它指的是逐渐地改变“参数”的值,从而提高某一特定任务的性能。这些参数可以是人工神经网络的权重和偏差,图模型的统计参数(平均值、方差等),或者生物神经网络的突触强度。任务可能是建立一个从输入到输出的地图(例如,从照片到照片中物体的标签),能够从目标概率分布生成样本,或在某些环境中最大化奖励。

为什么我们只要求“好的”而不是“正确的”表现?从非常广泛的意义上说,统计学习问题出现时,没有单一的解决方案是由数据决定的。解决方案可能是不确定的或过度确定的,但在任何一种情况下,解决方案都是放弃“对或错”,而选择“更好或更坏”。例如,在过度确定的问题中,我们通过为不匹配分配“成本”,(通常)随着与正确解决方案的距离平滑地增加,来指定解决方案的错误程度;然后尝试最小化这个代价或损失(L)。因此,学习问题是典型的优化问题。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“MSL” 就可以获取《干货书!最新《现代统计学习导论》简明书,124页pdf精炼阐述统计学习与推理方法》专知下载链接