多路径多领域通吃!谷歌AI发布多领域学习通用模型MDL

新智元报道

新智元报道

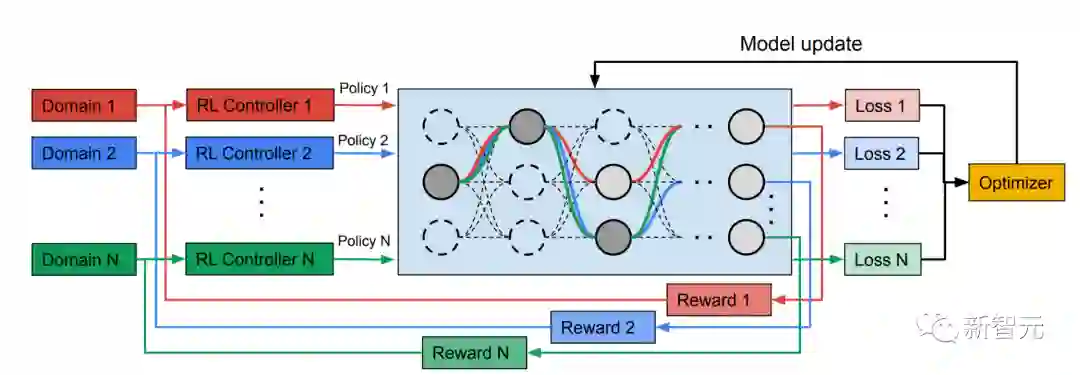

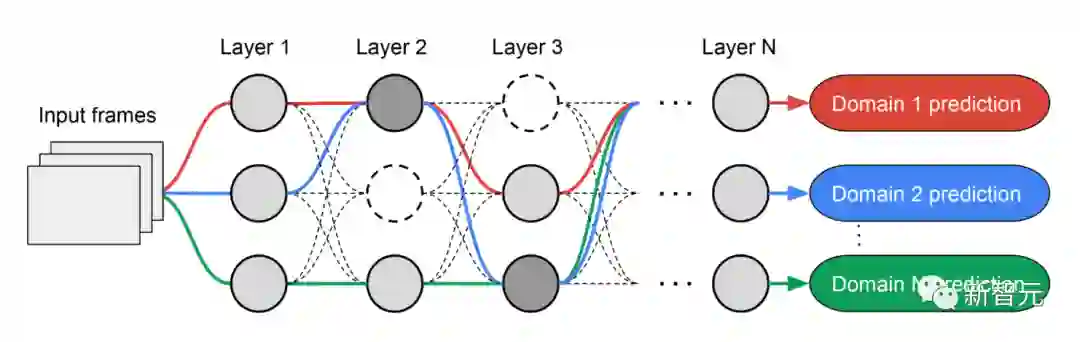

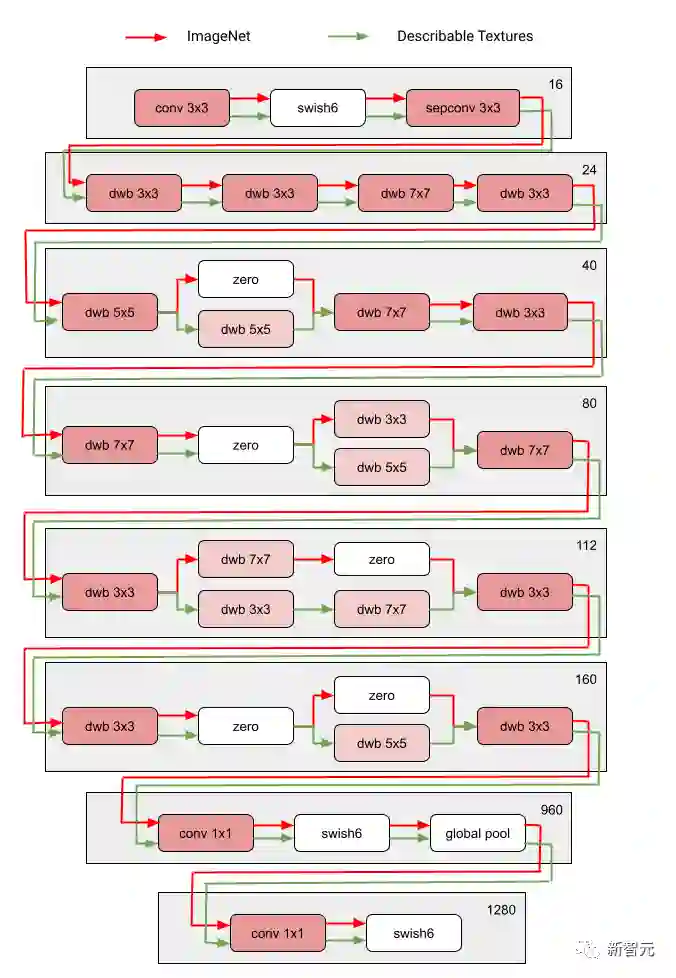

【新智元导读】研究人员提出了一种多路径神经架构搜索(MPNAS)方法,为多领域建立一个具有异质网络架构的统一模型。

多路径神经结构搜索

多路径神经结构搜索

训练异构多域模型

训练异构多域模型

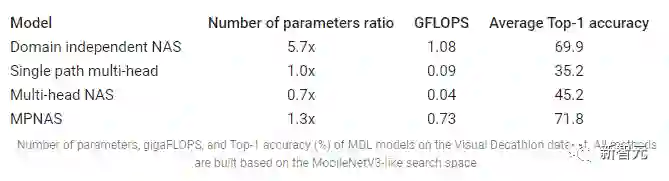

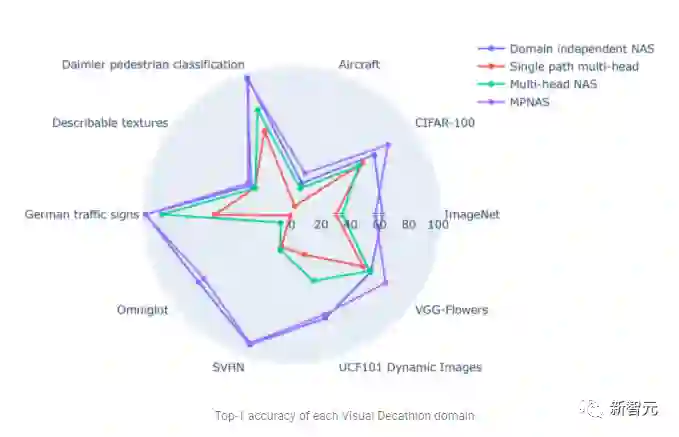

独立于域的 NAS:分别为每个域搜索和训练模型。

单路径多头:使用预训练模型作为所有域的共享主干,每个域都有单独的分类头。

多头 NAS:为所有域搜索统一的骨干架构,每个域都有单独的分类头。

未来方向

未来方向

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年11月25日

Arxiv

16+阅读 · 2020年3月30日