纵览图像语义分割发展史,11篇关键文章简介

纵览图像语义分割发展史

图像语义分割(semantic segmentation),从字面意思上理解就是让计算机将像素按照图像中表达语义含义的不同进行分组/分割。本文由Derrick Mwiti撰写,摘录并解析了近些年来语义分割方向最具有代表性的11篇论文,相信能使读者对语义分割的理解更进一步。

作者:Derrick Mwiti

原文链接:https://heartbeat.fritz.ai/a-2019-guide-to-semantic-segmentation-ca8242f5a7fc

翻译:Jiahao Zhao

绪论

0

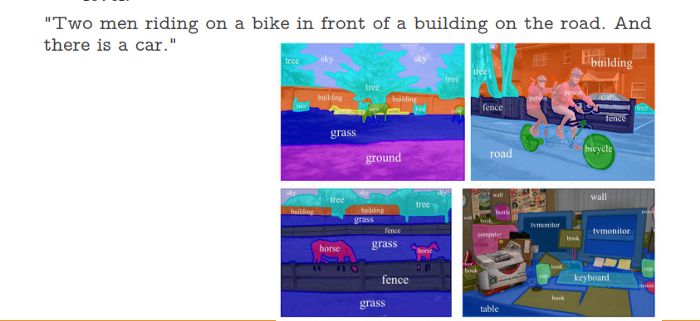

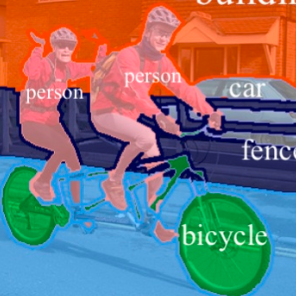

我们可以将语义分割视为像素级别的图像分类。例如,在具有许多汽车的图像中,分割将所有对象标记为汽车对象。但是,称为实例分割的单独一类模型能够标记对象在图像中出现的单独实例。这种分割在用于计算对象数量的应用程序中非常有用,例如计算商场中的步行量。

语义分割的一些主要应用是自动驾驶车辆,人机交互,机器人和照片编辑/创意工具。例如,语义分割在自动驾驶汽车和机器人技术中非常重要,因为对于这些模型来说,理解它们环境上下文是至关重要的。

我们将在下文中展示并简要介绍11篇关于构建语义分割模型的最新方法的研究论文。

Weakly- and Semi-Supervised Learning of a Deep Convolutional Network for Semantic Image Segmentation (ICCV, 2015)

1

本文通过结合标注良好和标注没那么良好的数据,提出了一种解决方案来克服CNN在处理弱标注数据的问题。在本文的模型是CNN与全连接条件随机场的一种组合。

在PASCAL VOC分割基准测试中,该模型给出的(IOU)得分超过70%。但这种模型的主要问题是它在训练期间需要像素级标注的图像。

本文的主要贡献是:

1.引入用于边界框或图像级训练的EM算法,可应用于弱监督和半监督设置。

2.证明结合弱标注和强标注可以提高性能。在合并MS-COCO数据集和PASCAL数据集的标注后,本文的作者在PASCAL VOC 2012上达到了73.9%的IOU性能。

3.通过合并少量像素级标注图像和大量边界框或图像级标注图像,证明了他们的方法实现了更高的性能。

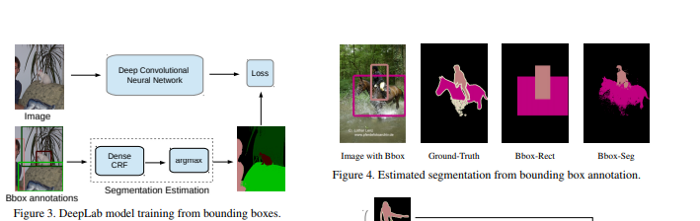

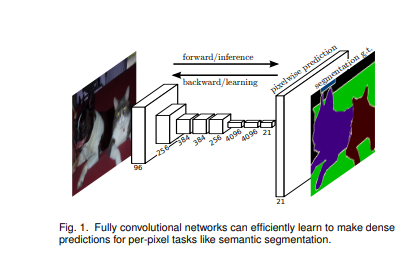

Fully Convolutional Networks for Semantic Segmentation (PAMI, 2016)

2

全连接神经网络能够输入任何大小的图像并生成相应空间维度的输出。在此模型中,ILSVRC分类器被设计成全连接神经网络,并使用pixel-wise loss和网络内的上采样来增强dense预测。然后通过微调来完成对分割的训练。

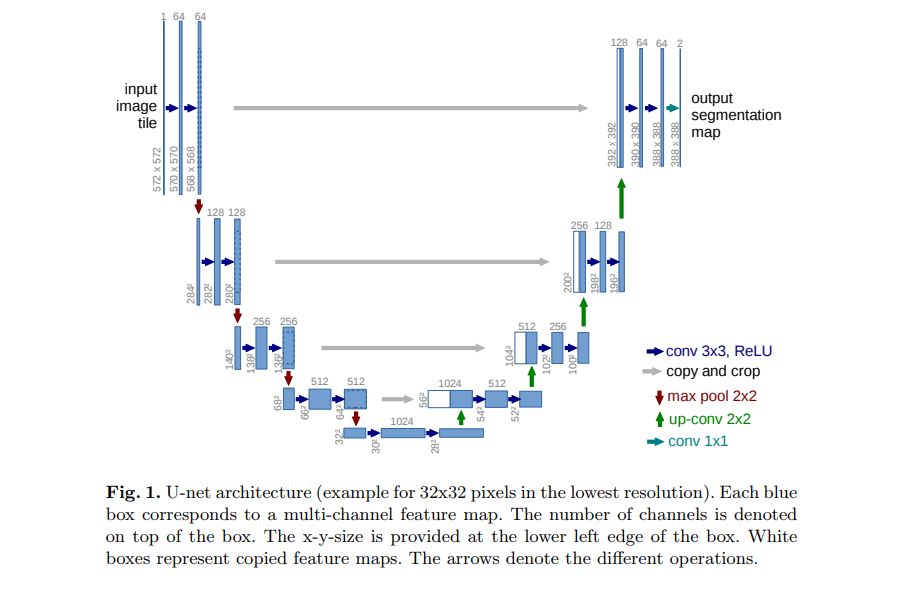

U-Net: Convolutional Networks for Biomedical Image Segmentation (MICCAI,2015)

3

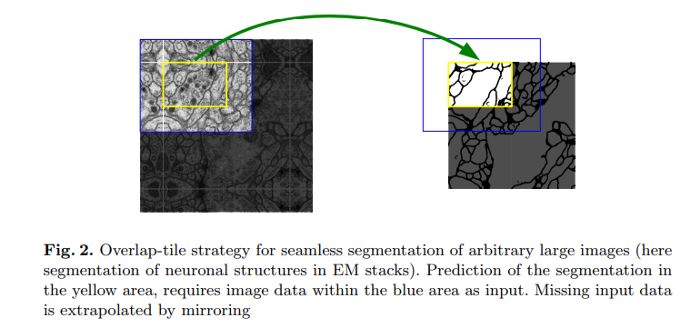

在生物医学图像处理中,为图像中的每个细胞获取类标签至关重要。生物医学任务面临的最大挑战是无法轻易获得数以千计的训练图像。

本文在全卷积的基础上,并对其进行修改以处理让其在较少的训练图像上产生更精确的分割

由于可用的训练数据非常少,因此该模型通过对可用数据应用弹性形变来做数据增强。如上图所示,网络架构由左侧的收缩路径和右侧的扩展路径组成。

收缩路径由两个3x3卷积组成。每个卷积之后跟着一个校正线性单元和一个2x2最大池化操作,用于下采样。每个下采样阶段都会使特征通道的数量增加一倍。扩展路径步骤包括特征通道的上采样。接下来是2x2向上卷积,将特征通道的数量减半。最后一层是1x1卷积,用于将组件特征向量映射到所需的类数。

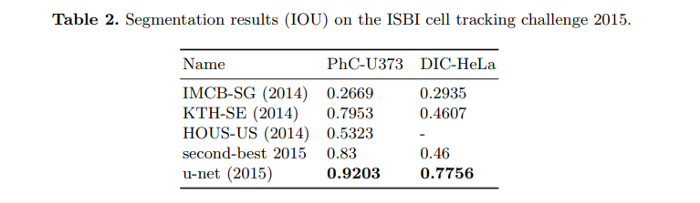

在该模型中,训练时通过输入图像及其分割图,并利用Caffe的随机梯度下降来实现的。当使用非常少的训练数据时,数据增强被用来提升网络的鲁棒性和不变性。在其中一个实验中,该模型的平均交叉过并(IOU)得分为92%。

The One Hundred Layers Tiramisu: Fully Convolutional DenseNets for Semantic Segmentation (2017)

4

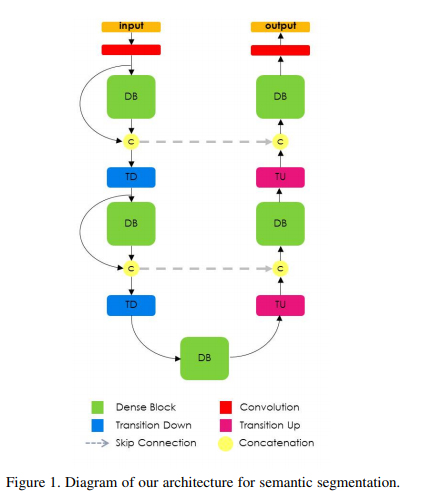

DenseNet 背后的理念是,每个层均以前馈方式连接到其他层,使网络更容易训练,更准确。

该模型的架构采用密集的下采样和上采样路径构建。下采样路径具有2个向下转换(TD),而上采样路径具有2个向上转换(TU)。圆圈和箭头表示网络内的连接方式。

本文的主要贡献有:

1.将密集卷积网络架构扩展到完全卷积网络形式,以用于语义分割。

2.提议从密集卷积网络对路径进行上采样,其性能优于其他上采样路径。

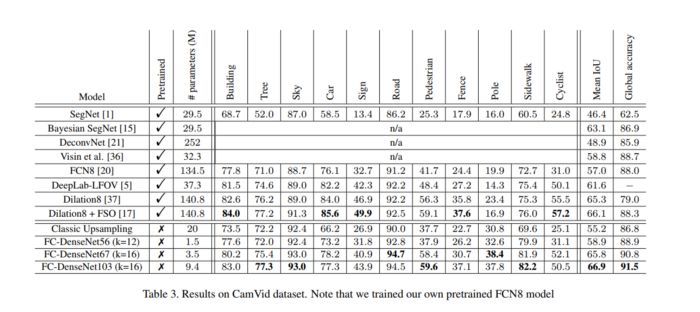

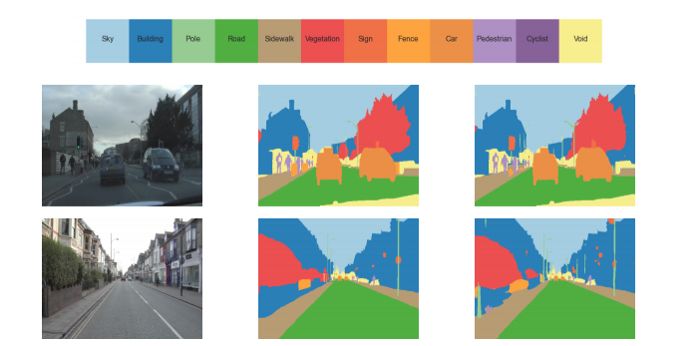

3.证明该网络可以在标准测试中产生最先进的结果。 该模型在CamVid数据集上实现了88%的全局精度。

Multi-Scale Context Aggregation by Dilated Convolutions (ICLR,2016)

5

在本文中作者开发了一种卷积网络模块,它可以在不损失分辨率的情况下融合多尺度的上下文信息。然后,可以以任何分辨率将该模块插入现有的架构。该模块基于空洞卷积。

该模块在Pascal VOC 2012数据集上进行了测试。它证明向现有语义分割体系结构添加上下文模块可提高其准确性。

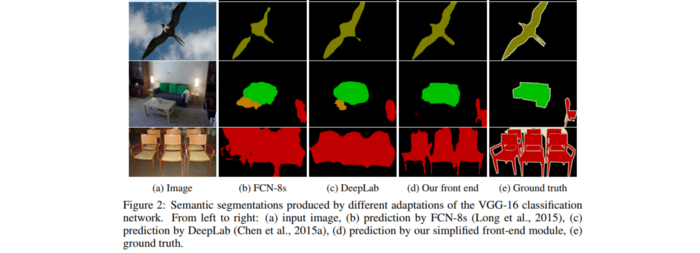

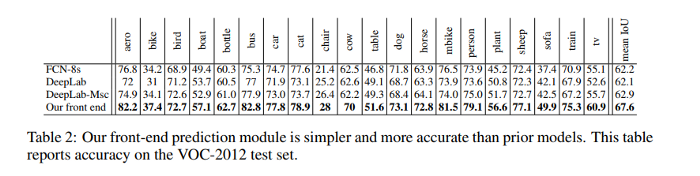

经过实验培训的前端模块在VOC-2012验证集上实现了69.8%的平均IoU,在测试集上实现了71.3%的平均IoU。该模型对不同物体的预测精度如下图所示

DeepLab: Semantic Image Segmentation with Deep Convolutional Nets, Atrous Convolution, and Fully Connected CRFs DeepLab(TPAMI,2017)

6

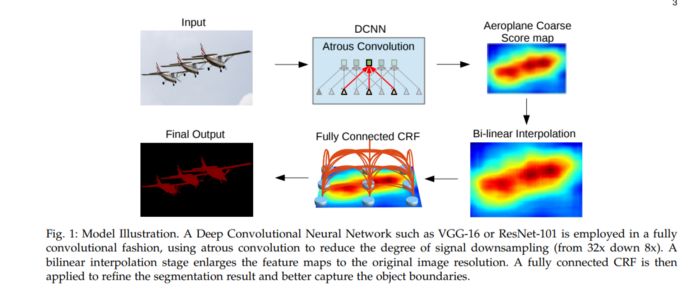

在本文中,作者通过深度学习对语义分割的任务做出了以下贡献:

1.针对密集预测任务的上采样滤波器的卷积

2.用于在多个尺度上分割对象的空洞空间金字塔池化Atrous spatial pyramid pooling(ASPP)

3.使用DCNN改善对象边界的定位。

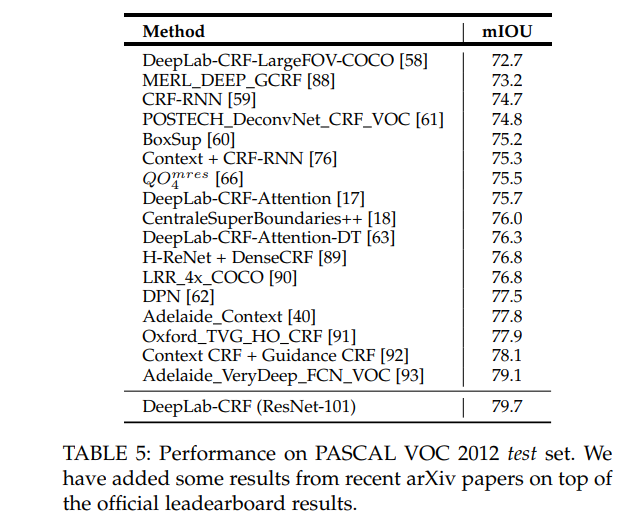

该论文提出的DeepLab系统在PASCAL VOC-2012语义图像分割任务中实现了79.7%的mIOU。

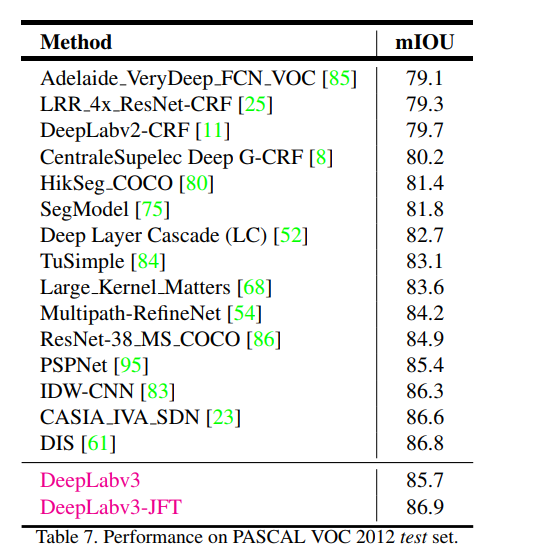

Rethinking Atrous Convolution for Semantic Image Segmentation(2017)

7

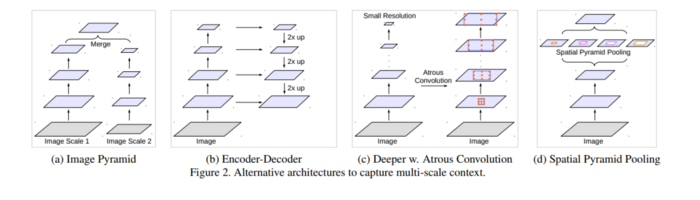

本文讨论了使用DCNN进行语义分割的两个挑战(前面提到过); 应用连续池操作时出现的特征分辨率降低以及多尺度对象的存在。

为了解决第一个问题,本文建议使用空洞卷积(Atrous),也称为带孔卷积(dilated)。它提出使用空洞卷积来解决第二个问题以扩大视野,因此适用于多尺度的对象。

在没有DenseCRF处理的情况下,该论文的'DeepLabv3'在PASCAL VOC 2012测试装置上实现了85.7%的性能。

8

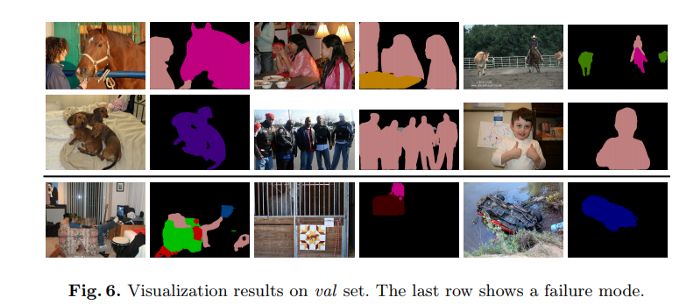

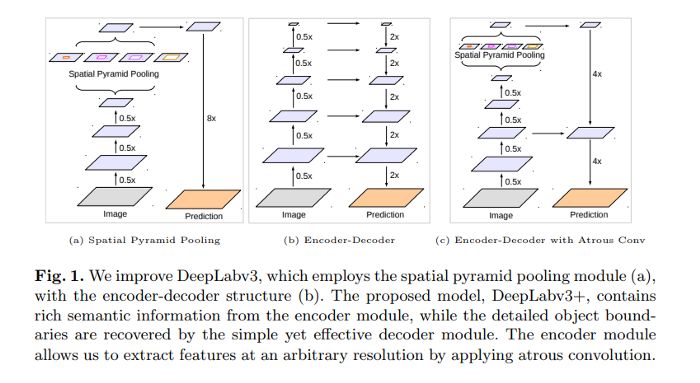

本文的方法“DeepLabv3 +”在PASCAL VOC 2012和Cityscapes数据集上没有任何后处理的情况下实现了89.0%和82.1%的测试集性能。此模型是DeepLabv3的扩展,通过添加简单的解码器模块来细化分割结果。

本文实现了两种类型的神经网络,使用空间金字塔池化(SPP)模型进行语义分割。一个通过池化不同分辨率的特征来捕获上下文信息,而另一个获得对象的确切边界。

FastFCN: Rethinking Dilated Convolution in the Backbone for Semantic Segmentation(2019)

9

本文提出了一个联合上采样模块,命名为联合金字塔上采样Joint Pyramid Upsampling(JPU),以取代消耗大量时间和内存的空洞卷积。它的工作原理是将提取高分辨率图的功能看作是联合上采样问题。

该方法在Pascal上下文数据集上实现了53.13%的mIoU性能,运行速度提高了3倍。

该方法实现了全连接网络(FCN)作为backbone,同时应用JPU对低分辨率最终特征图进行上采样,从而生成高分辨率的特征图。用JPU代替空洞卷积不会导致任何性能损失。

联合采样使用低分辨率目标图像和高分辨率引导图像。然后,它通过传递引导图像的结构和细节来生成高分辨率目标图像。

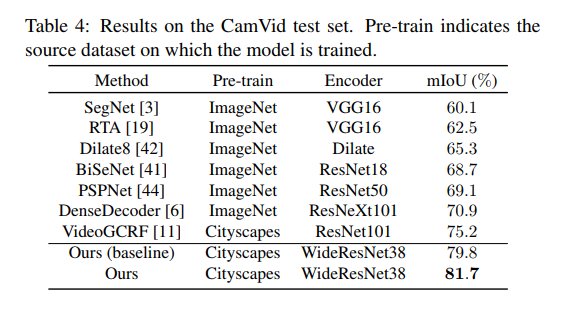

Improving Semantic Segmentation via Video Propagation and Label Relaxation (CVPR, 2019)

10

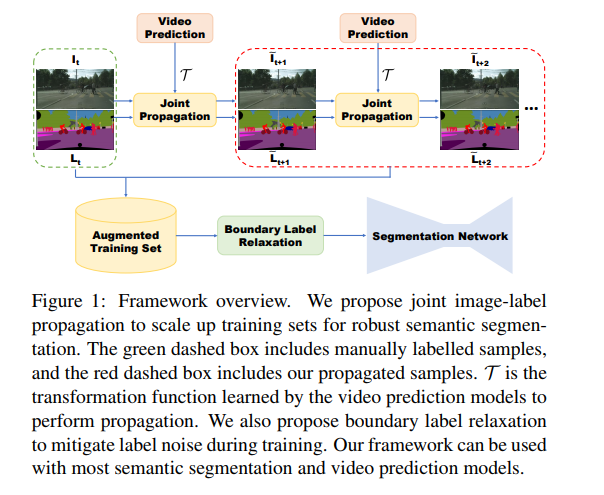

本文提出了一种基于视频的方法,通过合成新的训练样本来扩展训练集。这旨在提高语义分割网络的准确性。它探索了视频预测模型预测未来帧以预测未来标签的能力。

本文证明了在合成数据的数据集中训练分割网络可以提高预测准确性。本文提出的方法在Cityscapes上实现了83.5%的mIoU,在CamVid上则为82.9%。

本文提出了两种预测未来标签的方法:

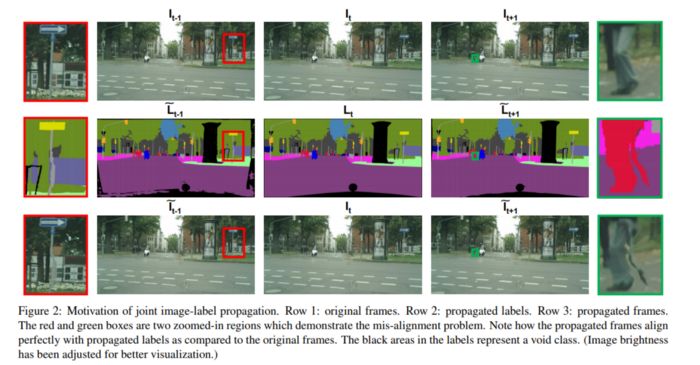

标签传播(LP)通过将传播的标签与原始未来帧配对来创建新的训练样本

联合图像标签传播(JP)通过将传播的标签与对应的传播图像配对来创建新的训练样本

本文有三个主要命题; 利用视频预测模型将标签传播到直接相邻帧,引入联合图像标签传播以处理错位问题,并通过最大化沿边界类结合的概率的可能性来放松one-hot标签训练。

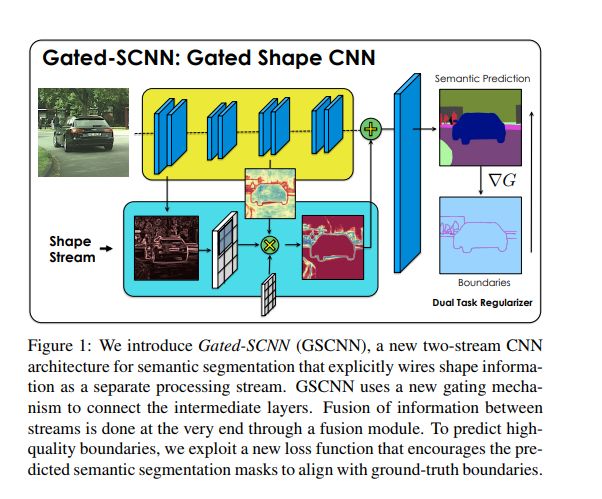

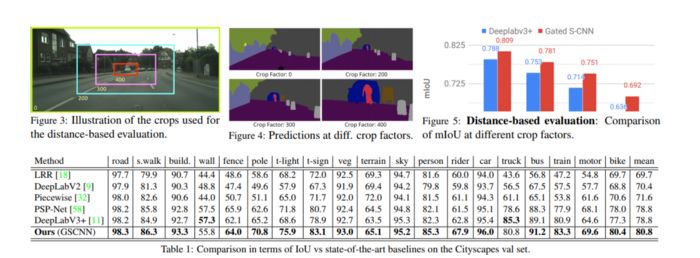

Gated-SCNN: Gated Shape CNNs for Semantic SegmentationCNN (2019)

11

本文是语义分割块的最新成果。作者提出了一种双流CNN架构。在此体系结构中,形状信息作为单独的分支处理。该形状流仅处理边界相关信息。这由模型的门控卷积层(GCL)和局部监督强制执行。

该模型在mIoU上的表现比DeepLab-v3高 1.5%,在F-Boundary得分上高4%。该模型已使用Cityscapes基准进行评估。在较小和较薄的物体上,该模型在IoU上实现了7%的改进。

下表显示了Gated-SCNN与其他模型相比的性能。

文章下载

请关注专知公众号(点击上方蓝色专知关注)

后台回复“11SS” 就可以获取本文中11篇语义分割关键文章的下载链接。

-END-

专 · 知

专知,专业可信的人工智能知识分发,让认知协作更快更好!欢迎登录www.zhuanzhi.ai,注册登录专知,获取更多AI知识资料!

欢迎微信扫一扫加入专知人工智能知识星球群,获取最新AI专业干货知识教程视频资料和与专家交流咨询!

请加专知小助手微信(扫一扫如下二维码添加),加入专知人工智能主题群,咨询技术商务合作~

专知《深度学习:算法到实战》课程全部完成!560+位同学在学习,现在报名,限时优惠!网易云课堂人工智能畅销榜首位!

点击“阅读原文”,了解报名专知《深度学习:算法到实战》课程