如何评价「神经网络本质不过是初中生都会的复合函数」?

加入极市专业CV交流群,与6000+来自腾讯,华为,百度,北大,清华,中科院等名企名校视觉开发者互动交流!更有机会与李开复老师等大牛群内互动!

同时提供每月大咖直播分享、真实项目需求对接、干货资讯汇总,行业技术交流。关注 极市平台 公众号 ,回复 加群,立刻申请入群~

问题:如何评价「神经网络本质不过是初中生都会的复合函数」?

有人说:"神经网络本质上就是一个复合函数,初中生都懂。”

他的理由是:「人工神经网络其实就是个复合函数,也就是类似y=h(g(f(x)))这种简单的东西,是初高中生都会的东西。哪怕深度神经网络,也不过是函数复合程度很高罢了。就是这么个简单得不能再简单的东西,神经网络这种看起来很高大上的单词只不过是某些"计算机人工智能深度学习业界专家"们的骗局,在真正的数学家面前不堪一击。因为它本身就是一场骗局,所以你们知道为什么深度学习的泡沫会崩溃了吧?」。

如何评价这种言论,从数学意义上看他说的真的正确吗?神经网络真的这么简单吗?

知乎高质量回答

本文来自知乎问答,回答已获作者授权,禁止二次转载

简单摘录两段:

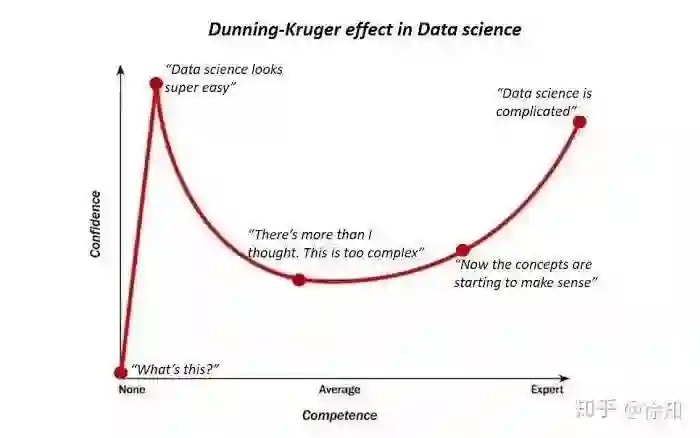

这种想法的主要谬误在于还原论假说从来都不意味着“建构论(constructionist)”假说: 将所有事物还原为简单的基本定律的能力并不意味着从那些基本定律出发并重建整个宇宙的能力。

这个层级结构并不意味着学科 X “仅仅是Y的应用”。 每个新的层级都需要全新的定律、概念和归纳,并且和其前一个层级一样,研究过程需要大量的灵感和创意。 心理学不是应用生物学,生物学也不是应用化学。

本文来自知乎问答,回答已获作者授权,禁止二次转载

本文来自知乎问答,回答已获作者授权,禁止二次转载

本文来自知乎问答,仅供学习参考,著作权归作者所有

本文来自知乎问答,仅供学习参考,著作权归作者所有

本文来自知乎问答,仅供学习参考,著作权归作者所有

我有一个朋友,喜哲学好思辨,最常用的口头禅有两个,一为“不就是”,二为“又怎样”。 这两个说法看似平凡无奇,其实杀伤力超强,前者消解一切理论差异,后者取消所有行动意义,双“枪”在手,连环出击,无往而不利。

你对此有什么看法呢?可以在留言区谈谈你的想法~

-END-

点击 阅读原文,可跳转浏览本文内所有网址链接

*延伸阅读

△长按添加极市小助手

△长按关注极市平台

觉得有用麻烦给个在看啦~

登录查看更多

相关内容

人工神经网络(Artificial Neural Network,即ANN ),是20世纪80 年代以来人工智能领域兴起的研究热点。它从信息处理角度对人脑神经元网络进行抽象, 建立某种简单模型,按不同的连接方式组成不同的网络。在工程与学术界也常直接简称为神经网络或类神经网络。神经网络是一种运算模型,由大量的节点(或称神经元)之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数(activation function)。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重,这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

最近十多年来,人工神经网络的研究工作不断深入,已经取得了很大的进展,其在模式识别、智能机器人、自动控制、预测估计、生物、医学、经济等领域已成功地解决了许多现代计算机难以解决的实际问题,表现出了良好的智能特性。