【KDD2020】可解释深度神经网络,200页ppt

最新KDD2020 可解释深度神经网络教程

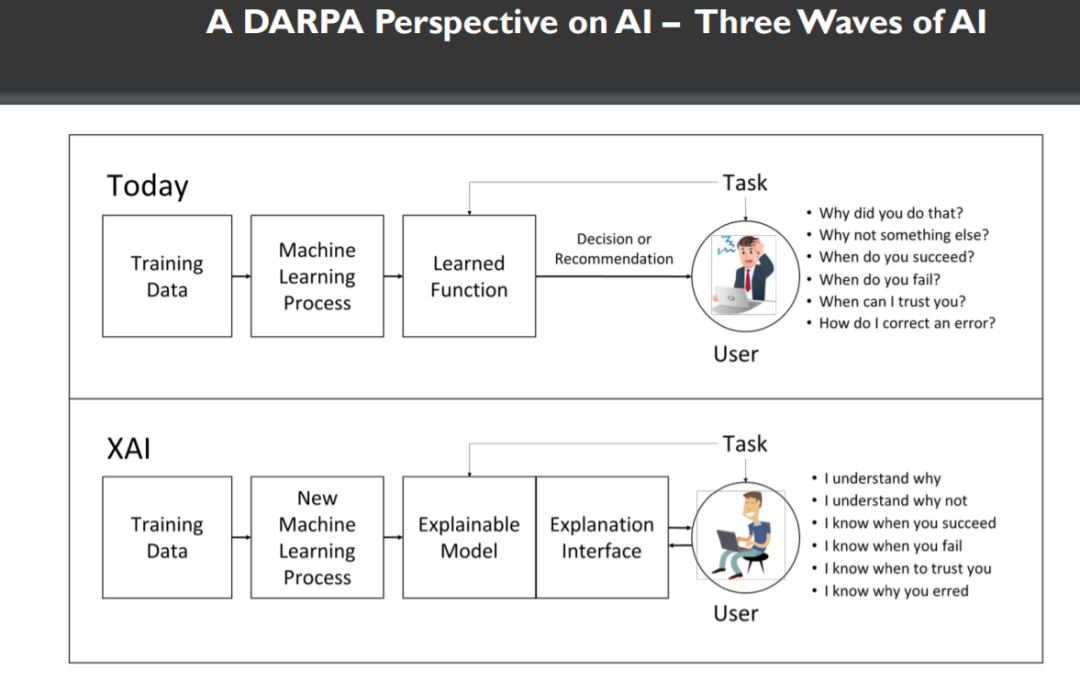

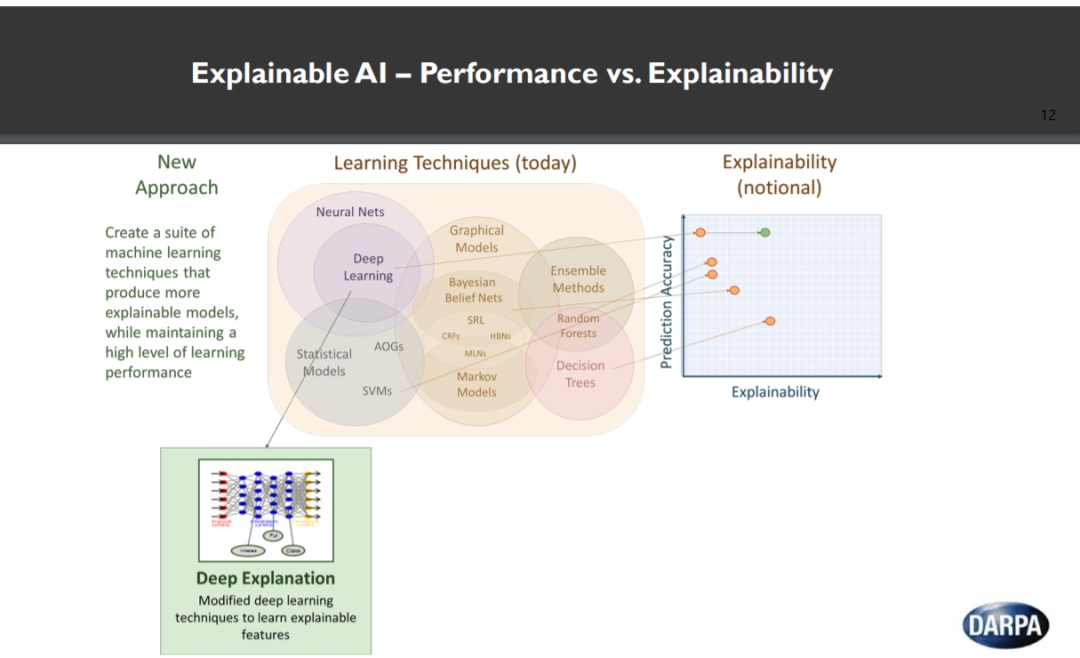

可解释的机器学习模型和算法是越来越受到研究、应用和管理人员关注的重要课题。许多先进的深度神经网络(DNNs)经常被认为是黑盒。研究人员希望能够解释DNN已经学到的东西,以便识别偏差和失败模型,并改进模型。在本教程中,我们将全面介绍分析深度神经网络的方法,并深入了解这些XAI方法如何帮助我们理解时间序列数据。

http://xai.kaist.ac.kr/Tutorial/2020/

首先,我们将提供一个全面的解释深度神经网络的基本原理。演讲的主题可能包括基于相关性评分的方法[Layer relevance Propagation (LRP), Deep Taylor Decomposition (DTD), PatternNet, RAP]和基于梯度的方法[DeConvNet, DeepLIFT, Guided Backprop]。我们还将通过介绍元解释[CleverHans]和神经元化方法[簇解释]来提出一个新的观点。

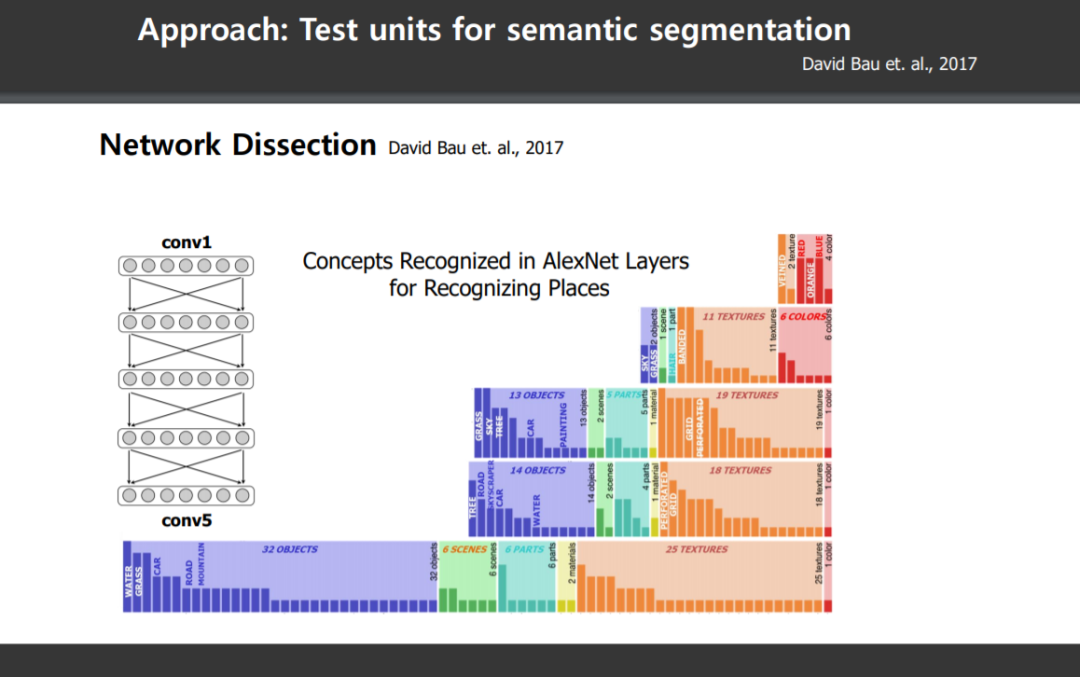

在本节中,我们将介绍解释深度神经网络内部节点的方法。我们将通过介绍卷积神经网络(网络解剖)和生成对抗网络(GAN解剖)的可视化通道的方法开始这一节。然后,我们将提出通过分析一组决策边界来分析DNNs内部节点的方法[凸壳,聚类解释,E-GBAS]。在允许的情况下,我们将简要概述使用注意力解释DNNs的方法。

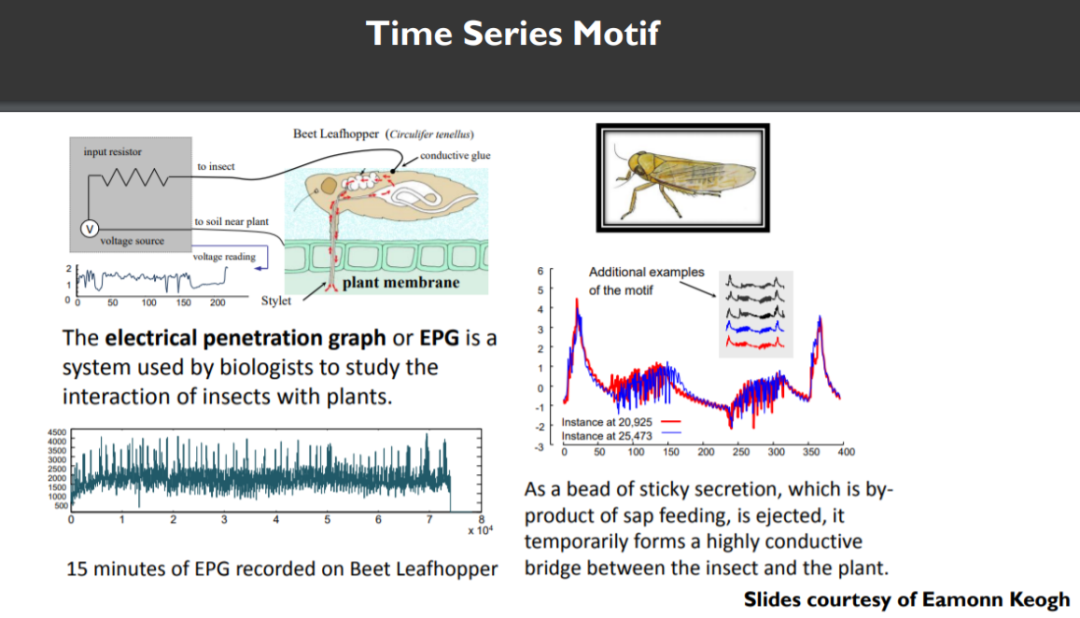

在最后一节中,我们将介绍最近在时间序列域中可解释的方法。我们将引入[N-BEATS],一个执行回归任务并提供可解释输出的框架,在准确性上不会有很大损失。[CPHAP]通过提取高度激活的时间段来解释颞神经网络的决策。此外,这种方法的聚类结果提供了理解数据挖掘的直觉。最后,我们将提供一种方法[自动统计学家],它可以用人类可读的报告预测时间序列,包括预测的原因。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“IEDNN” 就可以获取《【KDD2020】可解释深度神经网络,200页ppt》专知下载链接