算力≠智慧! MIT教授抛出「意识来源」新理论:人类认知与计算根本没关系

新智元报道

新智元报道

来源:IEEE

编辑:小咸鱼 David

【新智元导读】心智的计算理论是一个根深蒂固的理论,我们一般假设智能、思想、认知属于计算的产物。但也许有意识的体验来自某种「自我组织」。也许认知与计算根本没有关系。

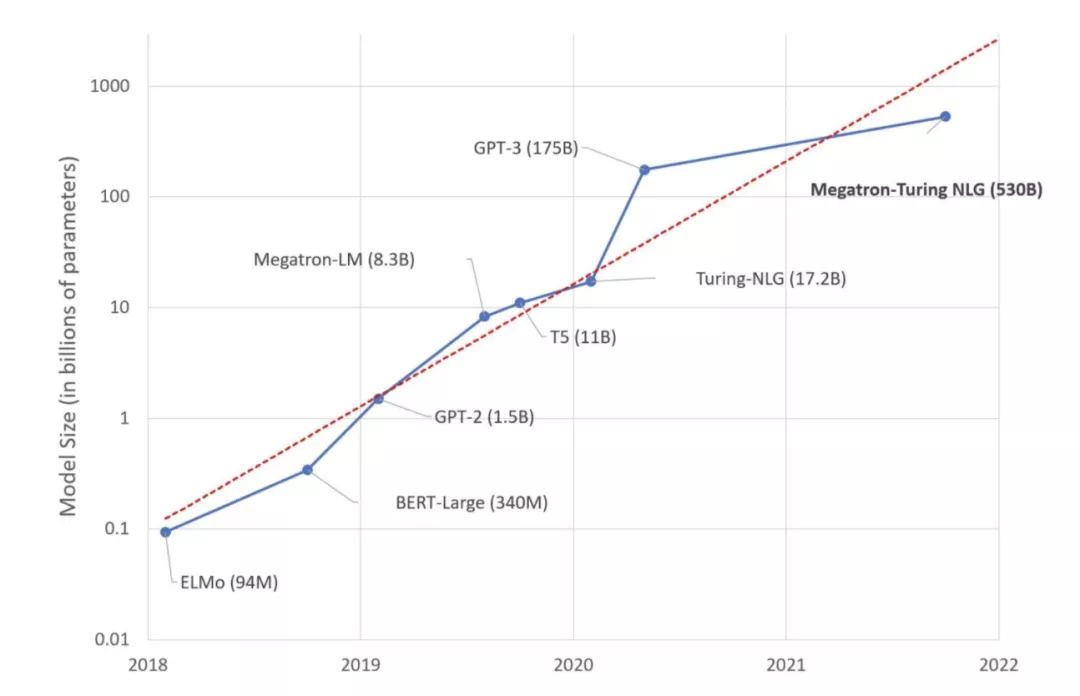

算力「陷阱」

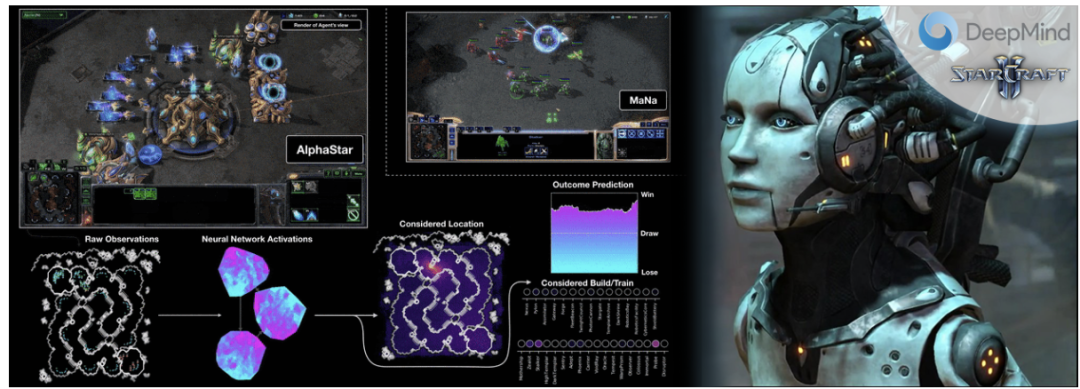

2016年,AlphaGo横空出世,以4:1击败了李世石,技惊四座。但不能忽视的是,DeepMind训练AlphaGo时,大概花费了3500万美元!

计算=认知?No!

人类的认知可能与计算没有任何关系。

你以为的就是你以为的吗?

比如燃烧的「燃素」理论。从 1667 年起的一个多世纪里,大多数科学家都认为,不同物质之所以能够燃烧,是因为一种常见的物质,这种物质后来被称为「燃素」。

意识来源新假说:「自我组织」

我们现在都假设智能、思想、认知,这些都是计算的产物。

登录查看更多

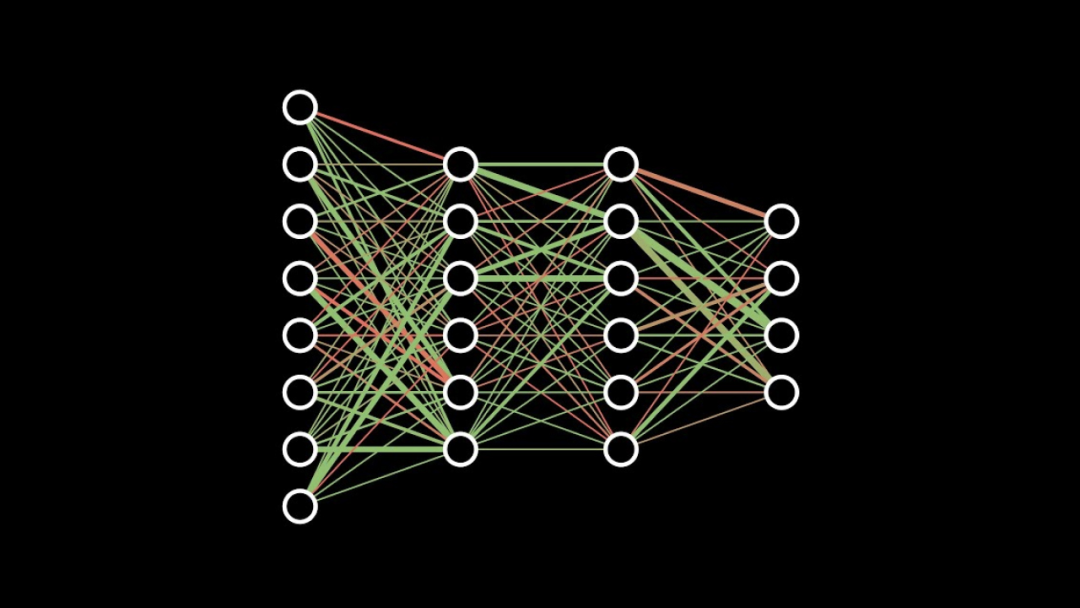

相关内容

人工神经网络(Artificial Neural Network,即ANN),它从信息处理角度对人脑神经元网络进行抽象,建立某种简单模型,按不同的连接方式组成不同的网络。在工程与学术界也常直接简称为神经网络或类神经网络。神经网络是一种运算模型,由大量的节点(或称神经元)之间相互联接构成。每个节点代表一种特定的输出函数,称为激励函数(activation function)。每两个节点间的连接都代表一个对于通过该连接信号的加权值,称之为权重,这相当于人工神经网络的记忆。网络的输出则依网络的连接方式,权重值和激励函数的不同而不同。而网络自身通常都是对自然界某种算法或者函数的逼近,也可能是对一种逻辑策略的表达。

Arxiv

0+阅读 · 2022年4月16日

Arxiv

0+阅读 · 2022年4月15日