今日面试题分享:LR与线性回归的区别与联系

LR与线性回归的区别与联系

参考答案:

解析:

LR工业上一般指Logistic Regression(逻辑回归)而不是Linear Regression(线性回归). LR在线性回归的实数范围输出值上施加sigmoid函数将值收敛到0~1范围, 其目标函数也因此从差平方和函数变为对数损失函数, 以提供最优化所需导数(sigmoid函数是softmax函数的二元特例, 其导数均为函数值的f*(1-f)形式)。

请注意, LR往往是解决二元0/1分类问题的, 只是它和线性回归耦合太紧, 不自觉也冠了个回归的名字(马甲无处不在). 若要求多元分类,就要把sigmoid换成大名鼎鼎的softmax了。

引用自:@AntZ

个人感觉逻辑回归和线性回归首先都是广义的线性回归, 其次经典线性模型的优化目标函数是最小二乘,而逻辑回归则是似然函数, 另外线性回归在整个实数域范围内进行预测,敏感度一致,而分类范围,需要在[0,1]。

逻辑回归就是一种减小预测范围,将预测值限定为[0,1]间的一种回归模型,因而对于这类问题来说,逻辑回归的鲁棒性比线性回归的要好。

引用自:@nishizhen

逻辑回归的模型本质上是一个线性回归模型,逻辑回归都是以线性回归为理论支持的。但线性回归模型无法做到sigmoid的非线性形式,sigmoid可以轻松处理0/1分类问题。

引用自:@乖乖癞皮狗

题目来源:七月在线官网(www.julyedu.com)——面试题库——面试大题——机器学习

今日学习推荐

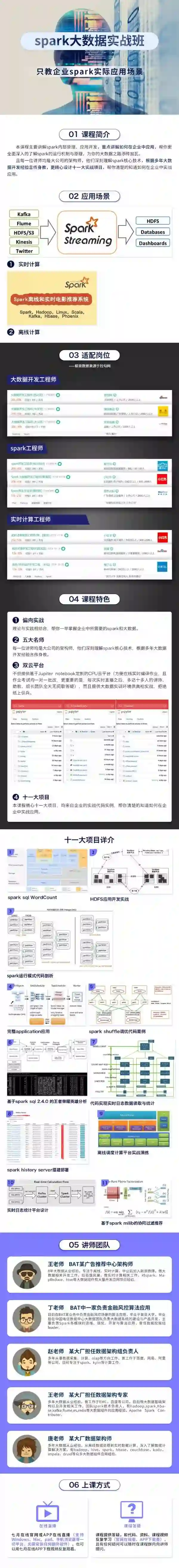

【Spark大数据实战班】

开课时间:3月16日

五位大厂架构师

只教工程实战和实际应用

咨询/报名/组团可添加微信客服

julyedukefu_02

扫描下方二维码

查看更多课程详情

☟

长按识别二维码

助力“金三银四”

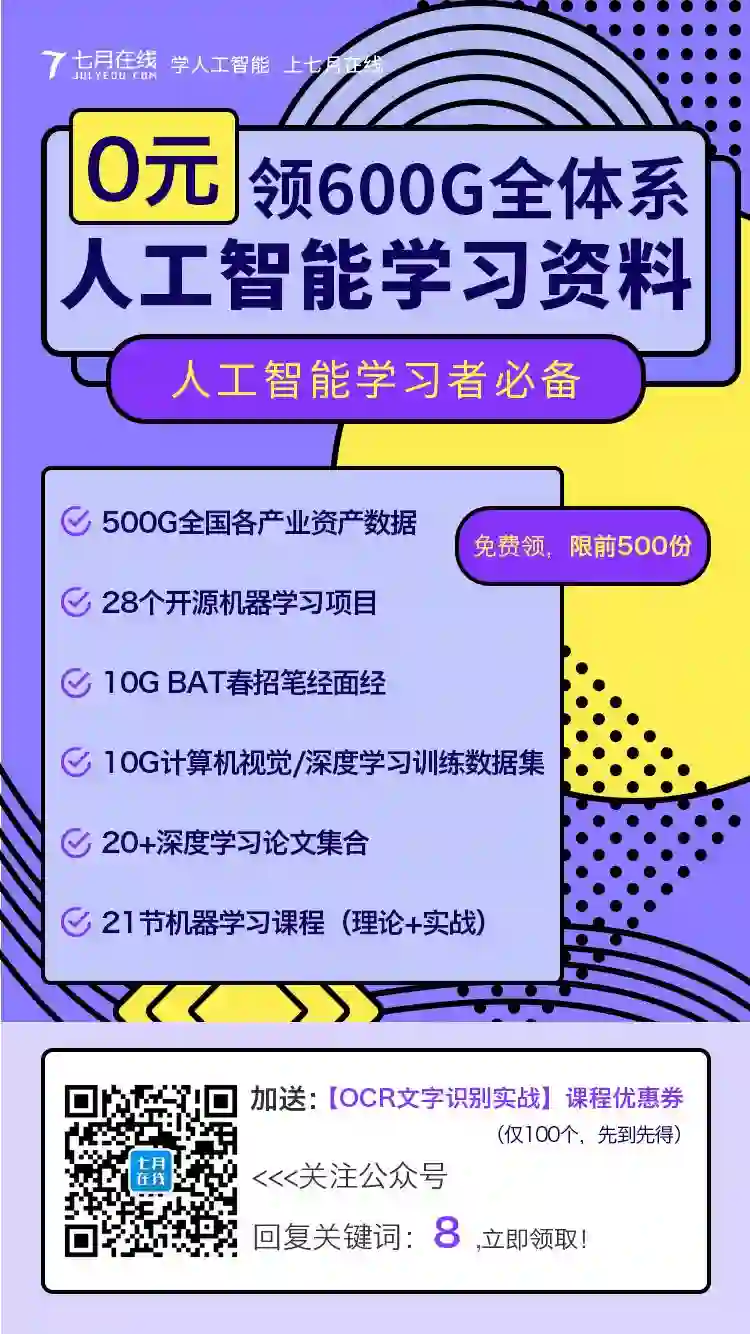

分享一套全体系人工智能学习资料

600G资料 限时限额0元领

小伙伴们可以屯起来,慢慢学习喔~

扫描下方海报二维码

立即领取

☟

▼

AI offer面经分享:薪资近乎翻倍,题库里的xgboost笔记看了不下十遍

点

咨询,查看课程,请点击“阅读原文”

给我【好看】

你也越好看!