Hinton:胶囊网络的专利是我的了!

作者 | 陈大鑫

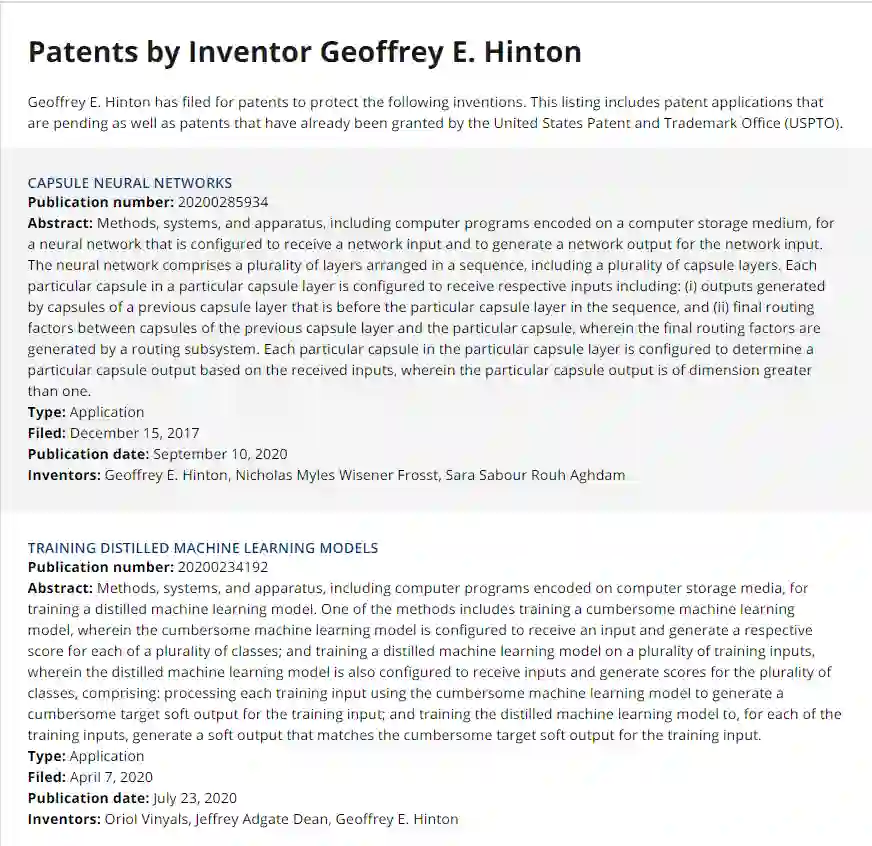

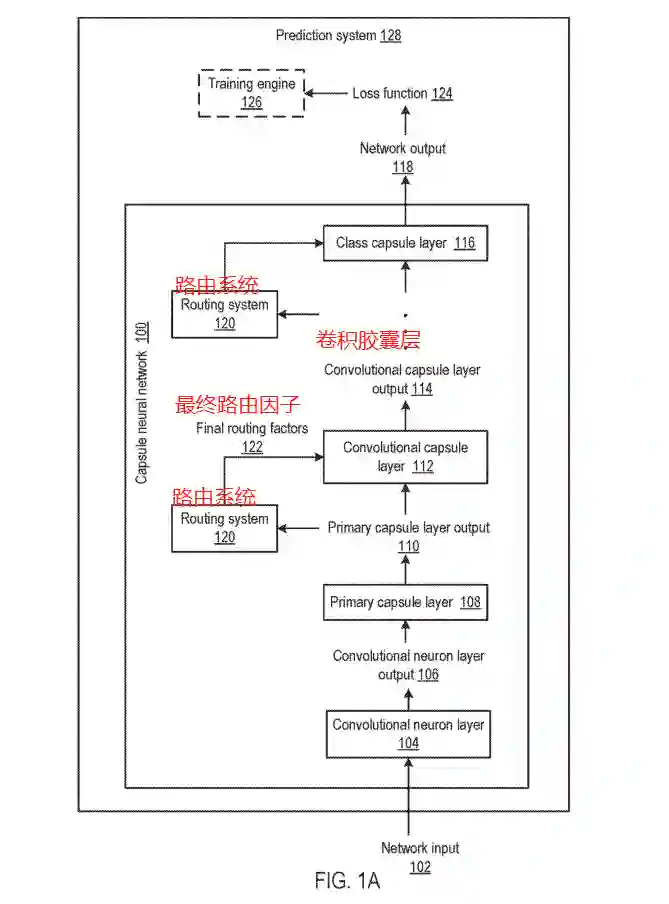

昨日,Reddit上有热心网友发现深度学习之父、图灵奖得主Hinton等人为胶囊(神经)网络申请了专利,该专利于2017年12月15日提交,于今年9月10日在网上发布,目前还未正式生效,但是相信这只是时间问题。

LSTM 之父Jürgen Schmidhuber一直在怼三巨头说他们不是深度学习真正的发明人,不管事情真相如何,但是这次,Hinton可以自信地说:胶囊网络的专利是我的了!

从上面专利图示可以看出,第一发明人即是Hinton本人,其他两位发明人也均是胶囊网络最初发表在NIPS 2017上论文的共同作者:

专利&胶囊网络

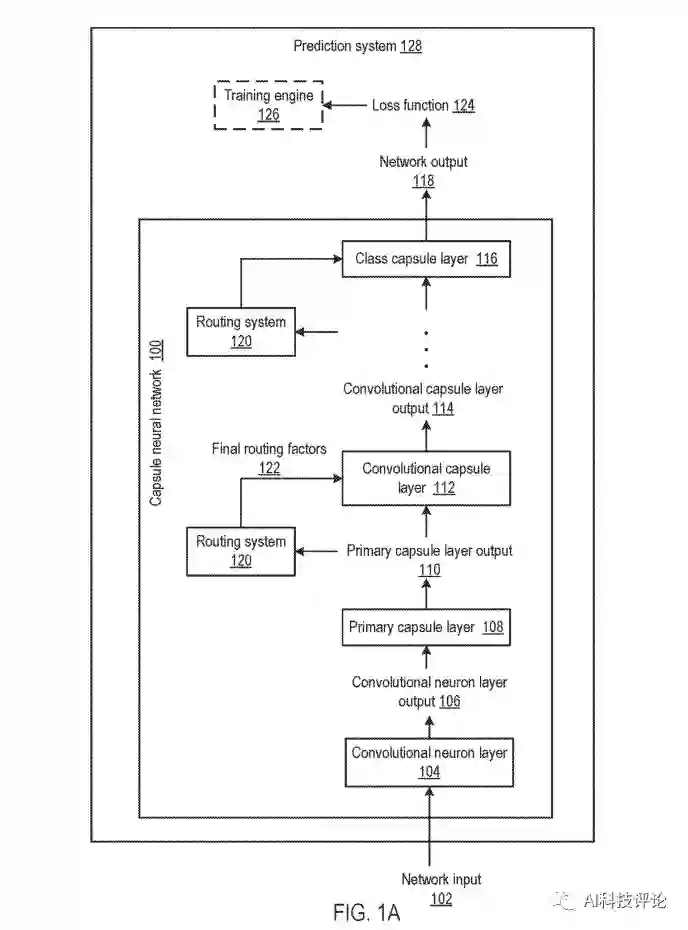

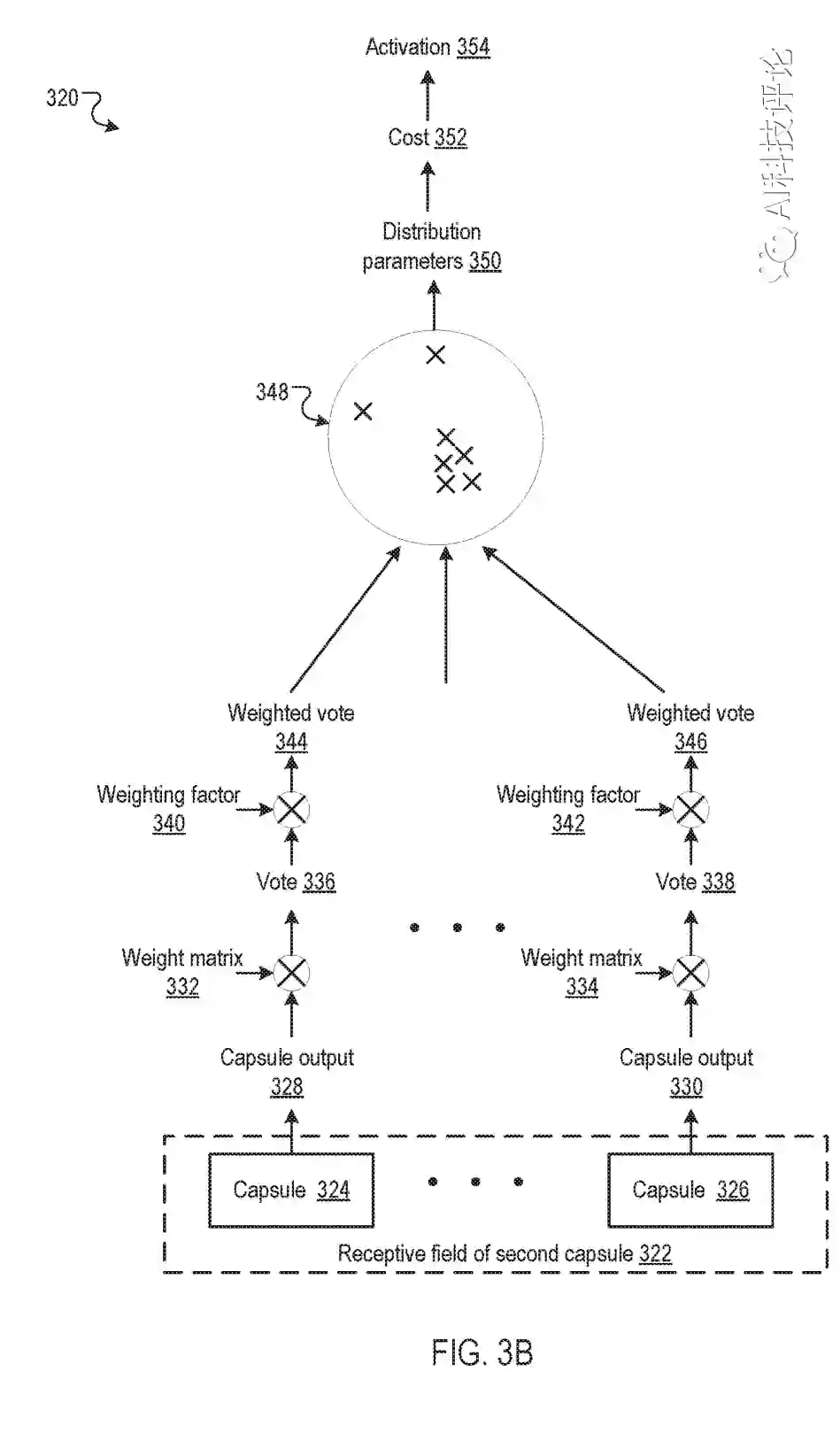

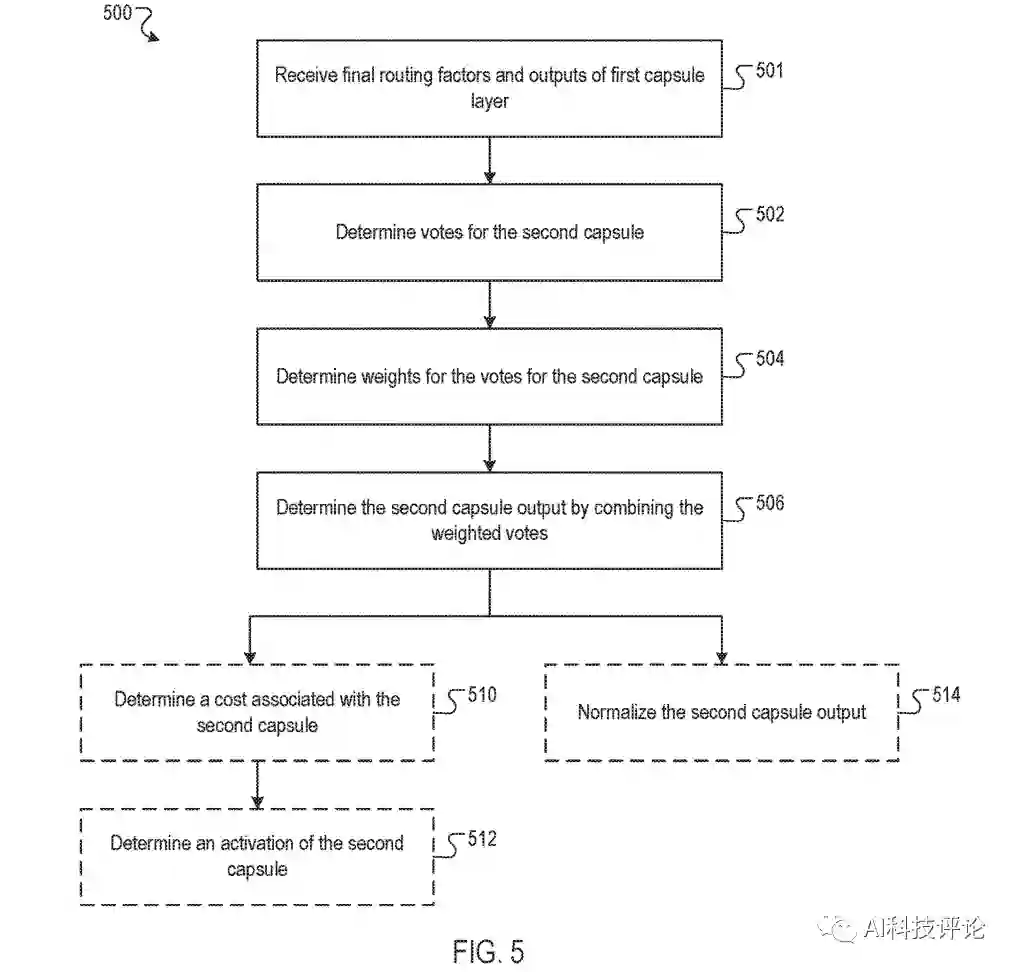

1、由序列中特定胶囊网络层之前的先前胶囊网络层的胶囊生成的输出:

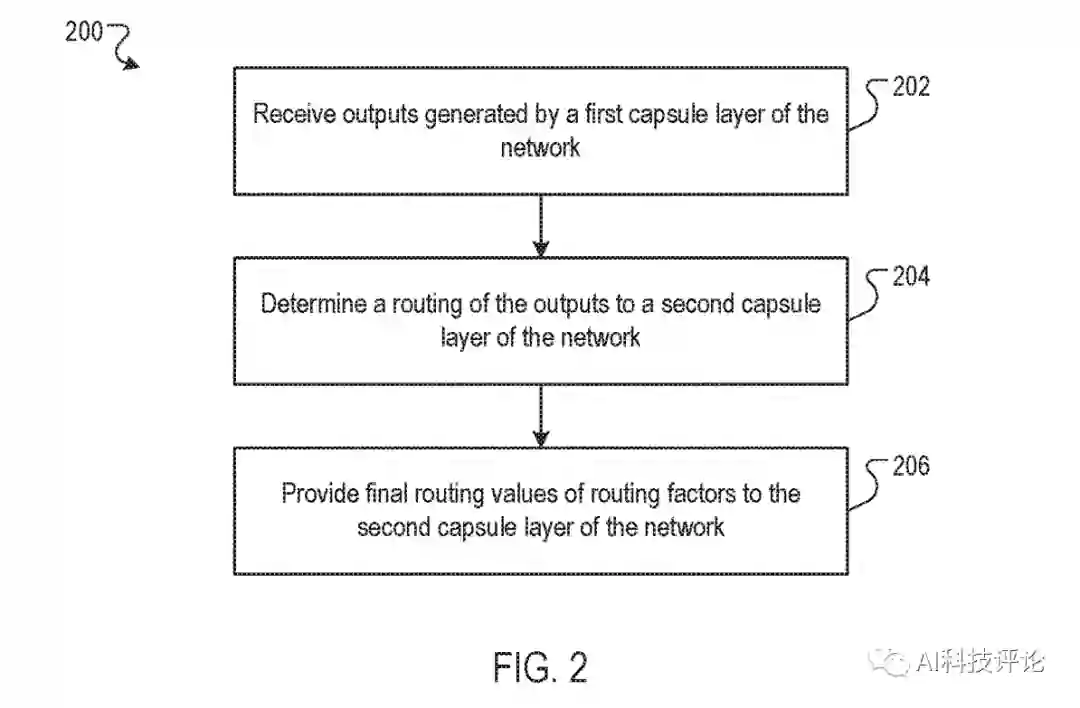

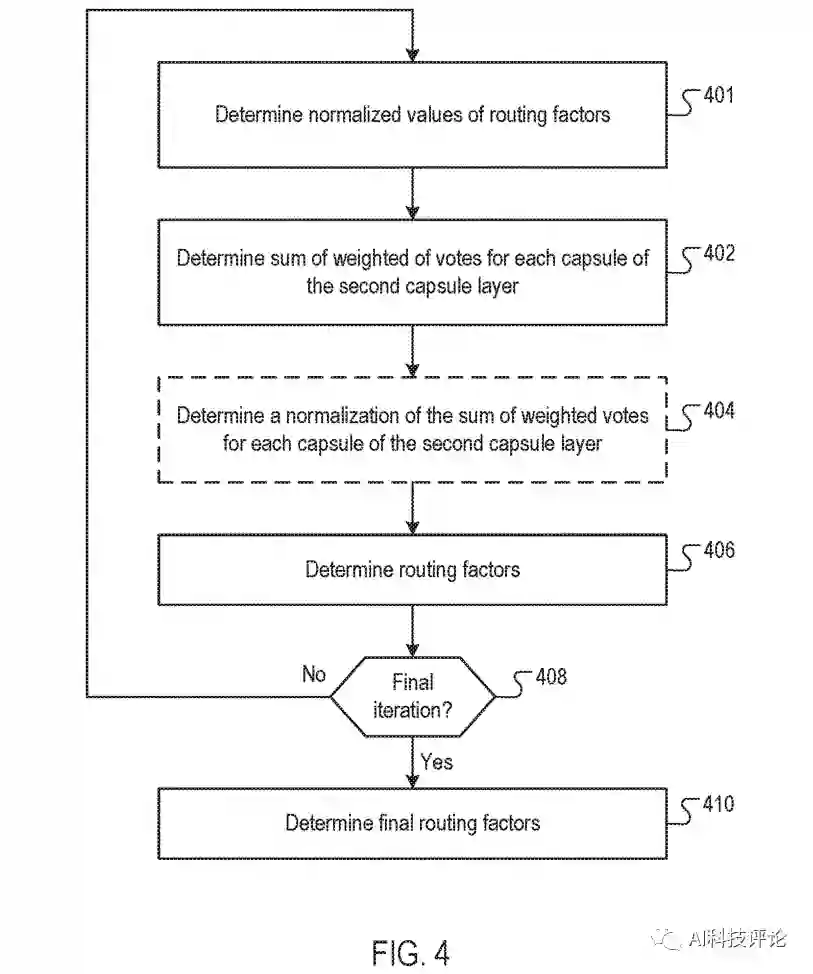

2、 在前一胶囊网络层的胶囊层和特定胶囊层之间的最终路由因子(routing factors),其中最终路由因子由路由子系统生成。

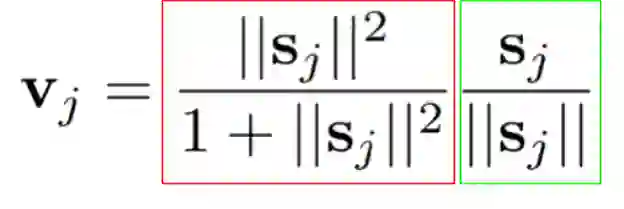

特定胶囊层中的每个特定胶囊被配置为基于所接收的输入确定特定胶囊输出,其中所述的特定胶囊网络层输出的尺寸大于1:

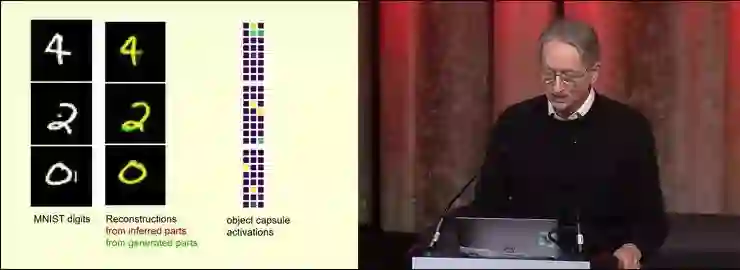

Hinton在2017年提出了CapsNet,其设想启发自脑皮层微柱结构,旨在解决CNN的信息丢失问题。

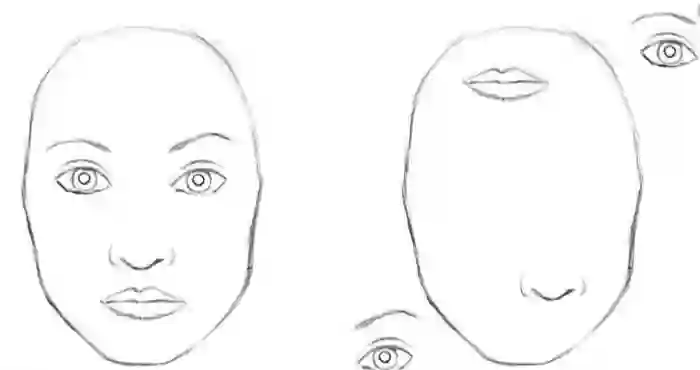

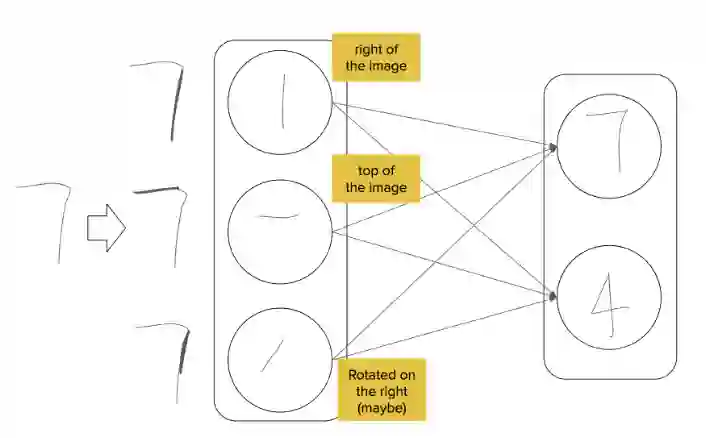

平移对称性原本是CNN的优点,但CNN将其泛化到了物体本身,从而导致不保持相对位置的元素组合也能被识别为同一物体。

如下图所示,左边和右边都能被CNN识别为一张人脸。池化操作也会导致信息丢失,Hinton曾经说过,“卷积神经网络中使用的池化操作是一个很大的错误,它运行良好的事实是一场灾难” 。

CapsNet可以保留图像的所有信息,不仅包括位置,还有姿势、纹理等等,其中动态路由算法可以让网络的低层和高层之间更好地传递信息,保留图像局部和全局之间的关系,从而克服上图中的问题。

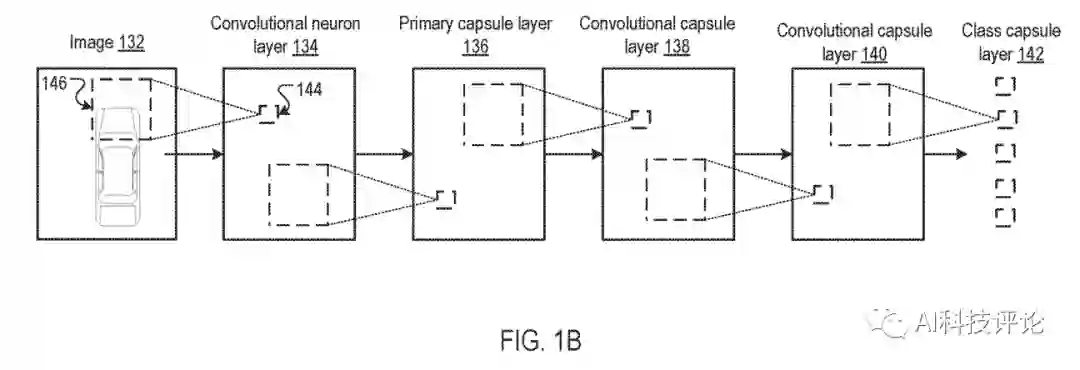

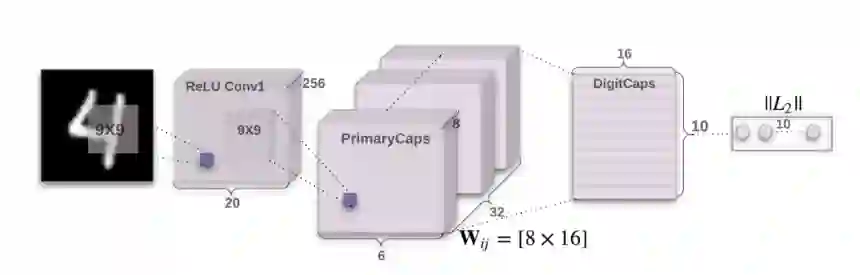

胶囊网络(CapsNet)包含一个编码器和一个解码器。

编码器架构:

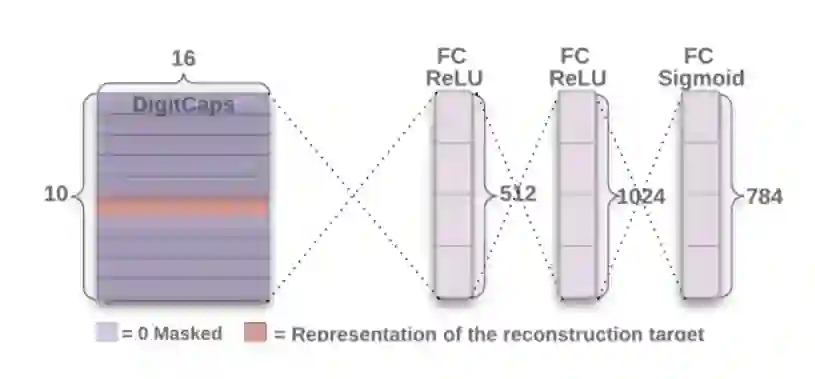

解码器架构:

此外,添加重构分支也使得CapsNet更加鲁棒,CapsNet在MNIST上获得了很好的表现:

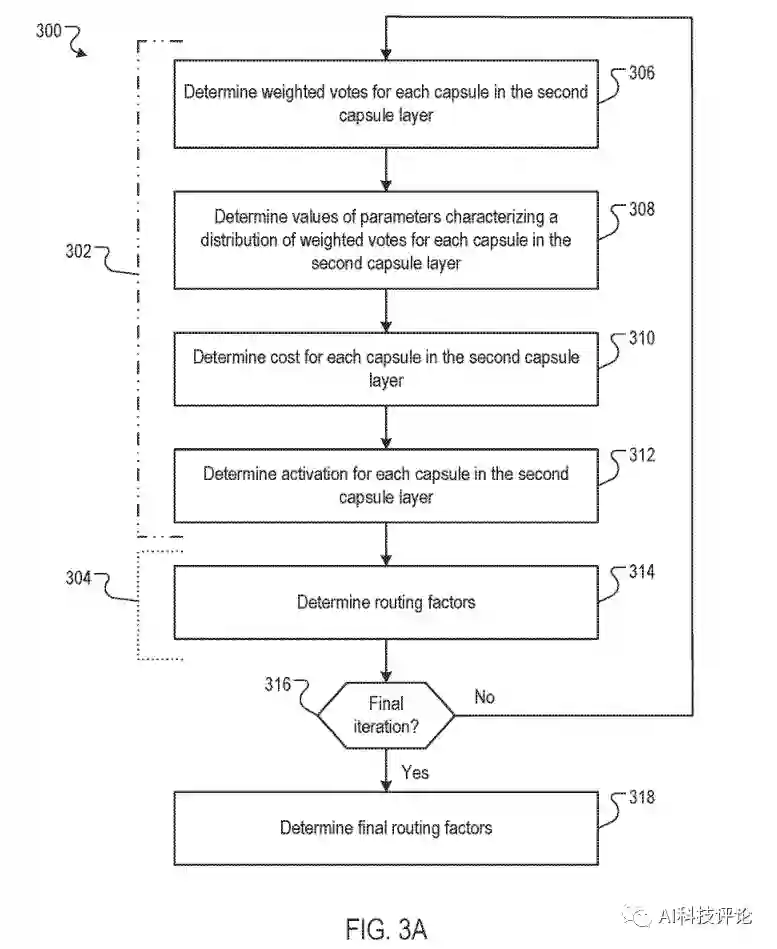

CapsNet内部的动态路由算法:

CapsNet的计算量更大,在MNIST上的表现更好,但是在较大的数据集比如CIFAR-10上表现明显差于CNN。

更多有关胶囊网络的介绍,请移步“Hinton AAAI2020 演讲:这次终于把胶囊网络做对了”一文。

AI专利回顾

谷歌AI专利

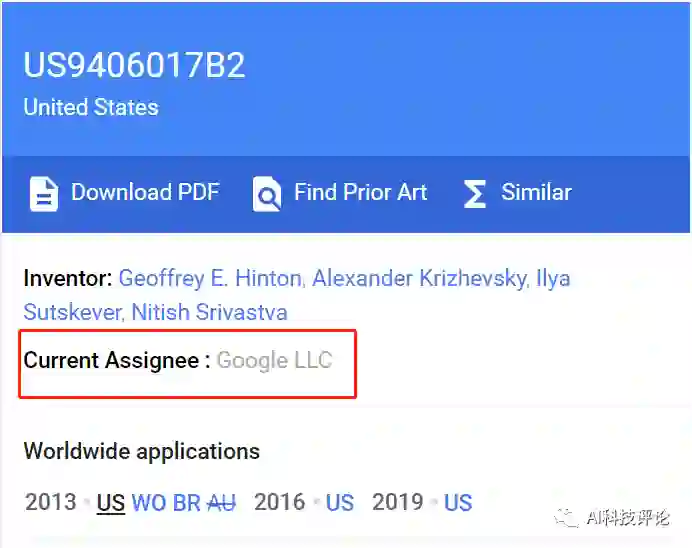

同样是Hinton,在2019年6月的时候,Hinton所在的谷歌公司为Hinton在2012 年提出的对防止过拟合有很好的效果的Dropout算法申请了专利且已经生效。

在Google Patents上Dropout专利详情页面中我们可以看到Dropout技术目前的专利权受让人(Current Assignee,即专利所有权人)归谷歌所有:

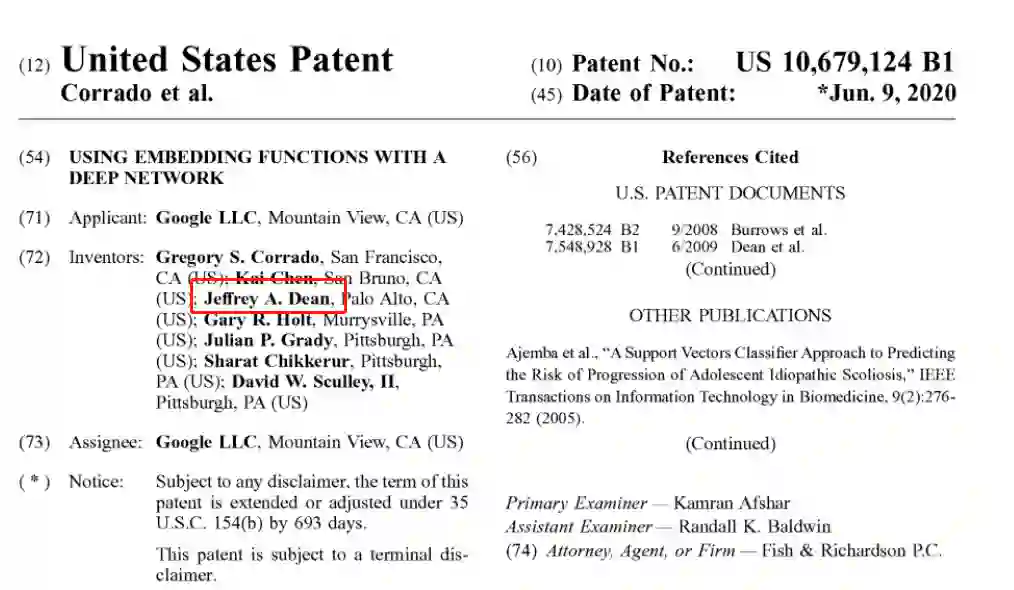

2020年6月,谷歌又申请了一项AI算法专利:《Using embedding functions with a deep network》,这一次的主要大牛是Jeffrey Dean。

Hinton本人专利

其实从网站patents.justia.com上可以看到,Hinton本人共申请了24项AI算法专利,大部分的专利受让人都是谷歌,以下是最近的两个专利,第一个便是胶囊网络:

DeepMind公布的AI专利

以下列举一些DeepMind申请过的包含RNN在内的专利,自 2016 年 9 月至 12 月期间几乎每周都有 1 份申请:

Generating Audio using neural networks

Processing sequences using convolutional neural networks

Generating video frames using neural networks

Neural networks for selecting actions to be performed by a robotic agent"

Processing text sequences using neural networks

Training action selection using neural networks

Reinforcement learning systems

Scene understanding and generation using neural networks

Recurrent neural networks

Sequence transduction neural networks

Reinforcement learning with auxiliary tasks

Environment navigation using reinforcement learning

以上数据来源:

https://ipkitten.blogspot.com/2018/06/deepmind-first-major-ai-patent-filings.html

专利相关讨论

在Reddit上,有网友质疑:

AI算法背后不就是一些数学公式吗,这也能被申请专利?

一切科学和工程背后都是数学 ,照你这样说,大家都不用申专利了......

这些AI算法的专利是防御性质的,主要是为了防止谷歌研究人员的成果被他人申请专利后进行碰瓷,这样做是为了避免产生经济损失。

谷歌不会利用这些专利进行盈利,也不会使用AI算法的专利来攻击别的公司。

令人遗憾的是,在18年的时候,谷歌因与五角大楼开展了军事合作:

谷歌员工抗议成不愿成为“杀人武器”,谷歌不作恶的原则在随后也被废除。

谷歌员工抗议成不愿成为“杀人武器”,谷歌不作恶的原则在随后也被废除。

此类算法模型工作在国内基本申请不到专利,通常被判为“智力活动不属于专利保护范围”,需要包装成一个“具体装置”才能通过,然而一旦具体到某个装置上,其保护范围呵呵。。。我国的专利审批应该跟美国对等起来,否则将来吃大亏。