图灵机器人郭家:以语义技术为核心驱动力,让机器更好地理解世界

导读:2017年12月26日,中国人工智能机器人CEO峰会在深圳举办。图灵机器人联合创始人郭家做了“AI之多模态语义”的主题分享。

12月26日,中国人工智能机器人产业联盟(CAIA)主办的2017中国人工智能机器人CEO峰会(下称“CEO峰会”)在深圳圆满举办。本次大会聚集了超过400位人工智能与机器人行业的企业高层、投资机构、学术界专家。

在2017人工智能机器人CEO峰会上,图灵机器人联合创始人郭家做了“AI之多模态语义”的主题分享。他认为,以语义技术为核心驱动力,可以让机器更好地理解世界。

以下是郭家在21017年人工智能机器人CEO峰会上的发言整理,有增减。

2017年人工智能机器人CEO峰会现场

图灵机器人作为当前还在从事语音交互的企业,从2010年开始就已经开始在消费级产品上进行投入。他认为,语义是AI领域的核心瓶颈,而真正的机器人就要有能理解语义的能力。因此,有一个名词就很重要——“多模态交互”。

“多模态交互”通俗的解释是:动作和语言串在一起。其背后理论基础“梅拉比安沟通模型”:有效沟通要素的重要性,其中,文字占比7%,声音语调占比38%,动作占比55%。

图灵在多模态交互这块,给行业提供语义技术,包括复杂系统拓扑学智能决策等等。我们都知道,在人和人交互的过程中,很重要的信息是靠我们的交流中的文字传达过来的,这过程中重点是我们如何理解决策和表达。从这个角度出发,我们公司的理念是持续的深挖语义的技术,最终让机器理解人理解世界。

郭家用案例讲述多模态交互

先用两个案例介绍一下多模态交互领域。

第一个案例叫BlueRiver。这个是美国独角兽的企业,做农业的。这个公司做的是很简单很受欢迎,在拖拉机的后面加一个注射器,它只要识别到杂草就注射一针化肥进去,一举三得,化肥把杂草烧死,之后让周围的农作物生长的更好,又可以节约人力,而且这个公司的目标非常清楚。前年做一个蔬菜是土豆,去年的目标是两个品种,一个是生菜一个是番茄。于是在短短的一年之内,实现盈利一千多万美元。

然而,他们在定义自己的产品时并不把自己叫智能机器人,而叫做智能机器。他们认为这只是智能机器,还没到机器人的那一步。

第二个案例是Twendy-One。它是日本养老院里面用的特别多的一款产品,它可以精细到拿起一个吸管,设定场景是很多老人手脚不灵便,吸管掉在地上它可以捡起来,并且递到他手里。

机器功能还可以,但是这个是反例。首先是价格过高,售价120万人民币一台,另外就是他并不能满足实际的需求。

因此这就给我们一个思考:我们做机器人到底应该往哪个方向做?

郭家讲述图灵的多模态交互技术

以前有一个记者采访高桥智隆(世界上数一数二的人形机器人的发明家),问他机器人和手机的最大区别是什么,高桥智隆说人可以跟机器人说话。记者说手机也可以说话,高桥智隆说你见过人跟乌龟说话跟金鱼说话,见过人跟手机说话的吗?

在高桥智隆眼中,如果做一个人形机器人,或者是有人性的东西出来,不光是能讲话,而是动作表情是能给你反馈的,就像我们养狗和猫就是他们能给你反馈,这也就是我们做这个产品的理念。

因为交流不是单一的,我们人和人交流过程中,纯文字只有7%,声音语调占38%,视觉肢体占55%,我们所有的交互过程中,其实纯文字的东西只是很少的一部分,大部分的信息是通过语音语调表情动作传达给对方的。

富士康找到图灵说要合作,除了提供对话功能还要把对话做到不仅仅是对话,还包括它的动作和表情,希望把他们串在一起,其实这就是刚才讲到的多模态交互,多模态语义,我做一个动作说你和我,这个动作其实和我的语言是完全串在一起的。我再举一个例子,我有一个西瓜切成两半,你一半我一半,这几个动作和语言都是串在一起的。

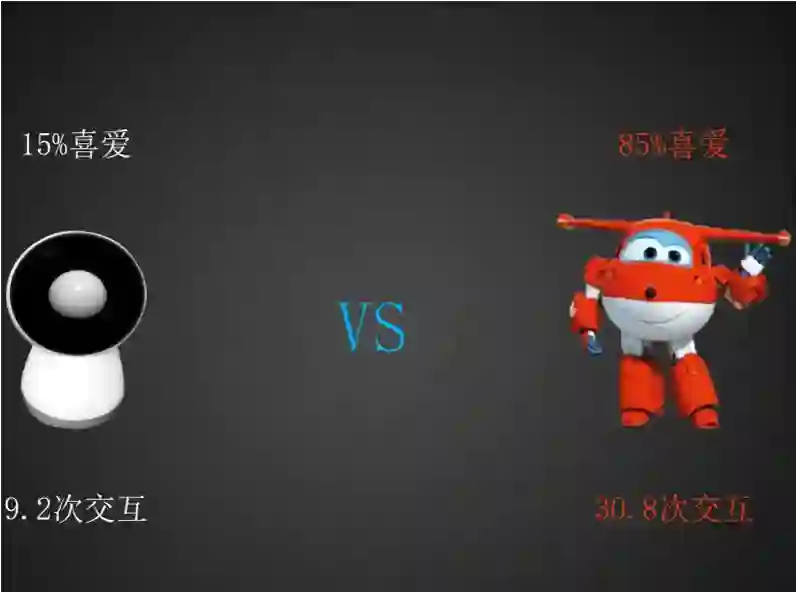

现在,我们做了两款机器人,白色的这款是美国创业公司从MIT做的,红色是(奥菲)跟图灵合作的机器人。从数据上明显的看到,用户跟它的交互次数,以及对它的购买欲望购买量,完全是两个数量级。这就是交互带来的不同。

目前图灵的多模态交互技术,在国内至少是领先同行业一年以上,因为大家知道有做语音交互的公司有做视觉交互的公司,有做语音加视觉的公司,但是做多模态的输入和输出的,以机体神经原为基础的这种几乎还没有。

以后,图灵会一直往这个方向发展。

公众号对话框回复1109可获取【人工智能产业全景图】和【人工智能时代的机器人3.0新生态研究报告】

推荐阅读

点击下方图片即可阅读

人工智能最大倒闭潮来临,95%公司要死掉?高通、联想、图灵机器人等企业高管却这么认为...