GAN作为一种深度学习训练的“左右互博术”在造假界曾“声名鹊起”。

前有“换脸术”,后有“假新闻”,技术作恶论也以GAN为源头甚嚣尘上。但事情总有两面性,例如DeepMind曾经改造了“史上最强”的BigGAN,让新的算法去做图像分类,刷新了ImageNet无监督表征学习的纪录。

而近日,英伟达研究院创建的强大新AI模型GameGAN也让四十年前的《吃豆人》游戏再度重生。

用神经网络支撑的GAN技术创造出逼真的游戏,英伟达此项工作属全球首个。

进一步,GameGAN经过5万个回合的游戏训练,能够在无需基础游戏引擎的情况下生成完整版的《吃豆人》游戏。

![]()

据悉,当玩家试玩GAN生成得游戏时,GameGAN会对游戏玩家的行为做出响应,从而实时生成新的游戏环境框架。在使用游戏不同等级或版本的游戏剧本进行训练后,GameGAN甚至可以生成从未有过的游戏关卡。

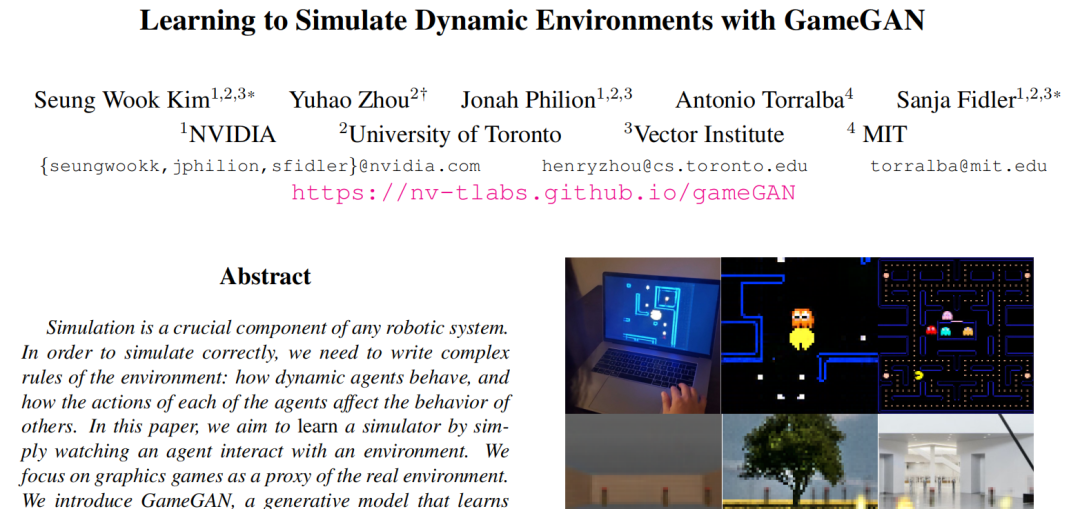

首个模仿计算机游戏引擎的神经网络模型

GameGAN是首个利用生成式对抗网络(GAN)模仿计算机游戏引擎的神经网络模型。其背后主要的模型思想是GAN:即由两个相互对抗的神经网络组成,一个生成器(generator)和一个鉴别器(discriminator),生成器和鉴别器相互对抗,直至生成能够以假乱真的内容。

与现有工作不同的是,英伟达设计得GameGAN,里面包含一个内存模块,该模块可以构建环境的内部地图,允许智能体以高度的视觉一致性返回到以前访问过的位置。GameGAN还能够将图像中的静态和动态组件分开,使模型的行为更易于解释,并和需要对动态元素进行显式推理的下游任务建立相关性。

论文地址:https://cdn.arstechnica.net/wp-content/uploads/2020/05/Nvidia_GameGAN_Research.pdf

GameGAN由Fidler、Kim、NVIDIA研究员Jonah Philion、多伦多大学(University of Toronto)学生Yuyu Zhou和麻省理工学院(MIT)教授Antonio Torralba共同创作,相关研究论文被CVPR 2020收录,并于6月份在会议上介绍。

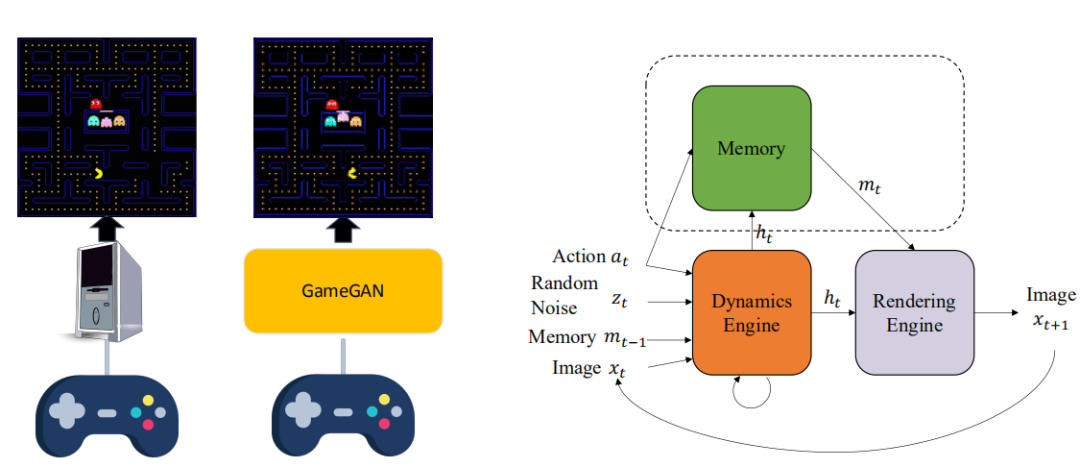

整个模型由三个主要模块组成,包含动态引擎、渲染引擎和内存。其中,动态引擎将行为、记忆、图像作为输入,并及时更新时间T的隐藏状态;内存模块负责整体地写入和读取;渲染引擎负责解码图像,可以学习解开图像中的静态和动态分量。

在问题的整体考虑上,英伟达的研究员将其定义为2D图像生成问题,给定观察到得图像帧序列和智能体采取的相应操作,然后进行图像模拟创造,效果类似于在真实动态环境中渲染。

在具体的训练过程中,GameGan会观察场景和玩家的键盘动作从而进行预测,也就是直接从图像和动作场景中学习,不需要访问底层游戏逻辑或引擎。

对于训练的细节,包括:吃豆人的速度、移动能力;四个鬼魂的运动方式;吃豆人吃下大力丸会怎样;当鬼魂碰到吃豆人时,会发生什么。

对于数据,英伟达团队在四天内为GameGAN提供了50,000集(共几百万帧)的《吃豆人》剧本。如此规模的数据集除了英伟达团队,吃豆人的游戏开发商万代南梦宫也出了一份力。

对于硬件,英伟达的AI研究团队在50,000小时的“ 吃豆人”游戏中训练了四台计算机场,每台计算机均配备了Quadro GV100工作站级GPU。

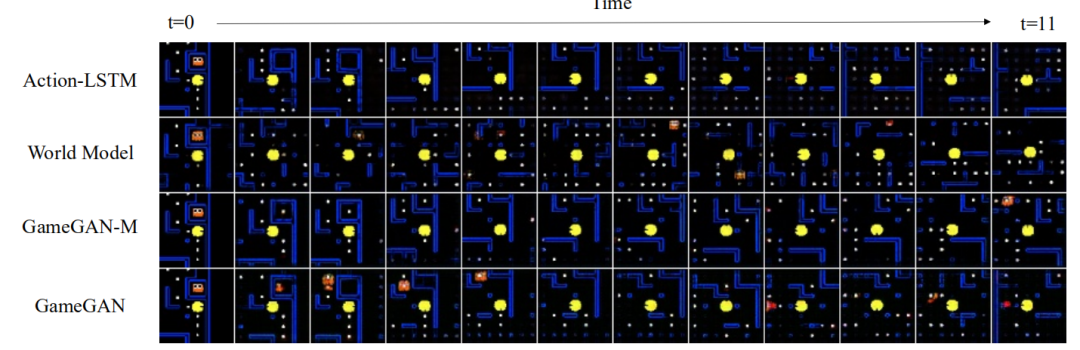

对于测试实验,英伟达研究人员分别在《吃豆人》和VizDoom环境中对GameGAN等四种模型进行定量和定性的综合评估。

实验结果如上图所示:Action-LSTM生成得帧缺少豆豆等细节,World Model在保持时间一致性方面存在困难,有时会出现严重的不连续,而GameGAN可以生成一致性模拟。

总的来说,经过训练后的GameGAN模型能够生成静态环境元素,例如统一的迷宫形状、豆子和强化道具,以及作为敌人的幽灵和吃豆人本身等移动元素。

该模型也能够学习简单和复杂的关键性游戏规则。例如,和原版游戏一样,吃豆人无法穿过迷宫墙。他需要一边四处移动,一边吃豆。当他吃到强化道具后,鬼魂会变成蓝色并四处逃窜。当吃豆人从一侧离开迷宫时,他会被传送到迷宫的另一侧。一旦吃豆人碰到鬼魂,屏幕就会闪烁并结束游戏。

不仅仅适用于游戏

自主机器人通常也需要在模拟器中接受训练,模拟器中的AI可以在与现实世界中的目标进行交互之前,学习环境规则。对于开发人员而言,创建模拟器是一个相当耗时的过程。开发人员必须编写有关如何与目标互动,以及及光在环境中如何表现等规则。

模拟器被广泛用于开发各种自主机器,例如学习如何抓握和移动物体的仓库机器人、或是需要在人行道上运输食物或药品的物流机器人等。

而GameGAN地出现,为其带来了一种可能性 —— 在未来的某一天,神经网络训练将能取代此类任务中编写模拟器的工作。

比如你在汽车上安装一个摄像头。该摄像头可以记录道路环境或驾驶员的行为,例如转动方向盘或踩下油门等。这些数据可被用于训练一个深度学习模型,其能够预测在现实世界中,人类驾驶员(或自动驾驶汽车)在做出猛踩刹车等动作时会发生什么后果。

NVIDIA多伦多研究实验室主任Sanja Fidler表示:“我们最终将训练出一个AI,其只需通过观看视频和观察目标在环境中所采取的行动,就能模仿驾驶规则或物理定律。GameGAN是朝这一目标所迈出的第一步。”

![]()

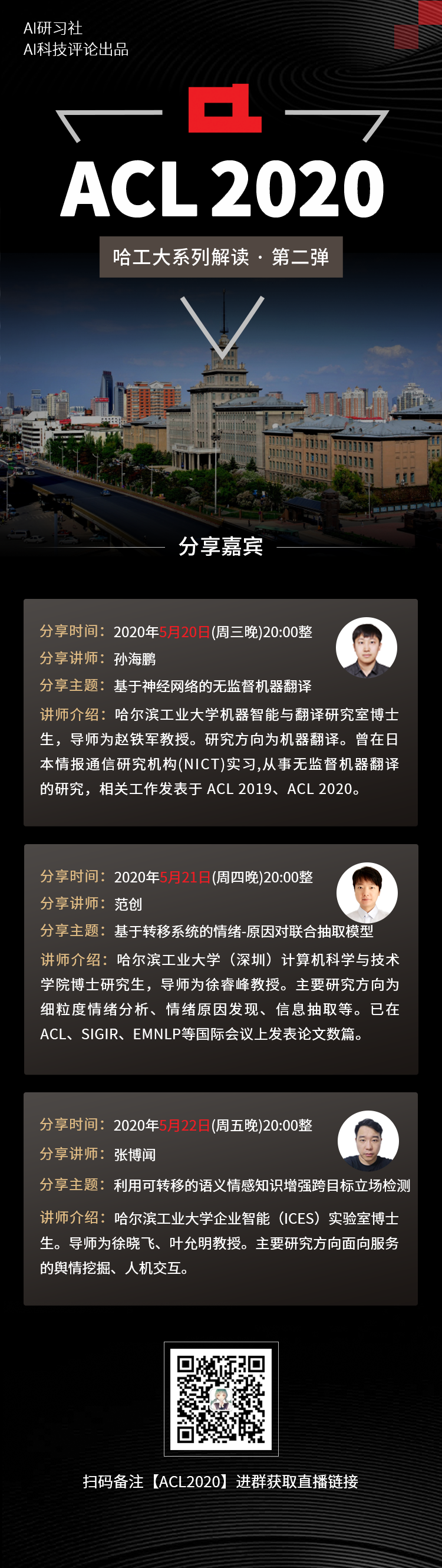

ACL 2020原定于2020年7月5日至10日在美国华盛顿西雅图举行,因新冠肺炎疫情改为线上会议。为促进学术交流,方便国内师生提早了解自然语言处理(NLP)前沿研究,AI 科技评论将推出「ACL 实验室系列论文解读」内容,同时欢迎更多实验室参与分享,敬请期待!

点击"阅读原文",直达“ACL 交流小组”了解更多会议信息。