澳门大学陈俊龙 | 宽度学习系统如何用横向扩展进行高效增量学习?

想必各位读者对深度神经网络及深度学习都不会感到陌生,不论是在数据处理或是应用层面,都取得了斐然的成绩。但囿于结构的复杂性及超参数的数量巨大,一方面带来了训练时间过多的困扰,另一方面,为了追求精度,深度模型需要持续增加层数及参数,反过来又给深度学习带来了进一步的训练难度。如何在保证效果的前提下极大地缩短神经网络系统的训练时间?学者们也做出了不少探索和尝试。

澳门大学讲座教授陈俊龙教授在近年来致力于解决这一问题。结合他在早期所做的单隐层网络的相关研究,陈俊龙教授提出了一个名为「宽度学习系统」(Broad Learning System,BLS)的网络结构,并从去年开始在多个场合提及这一概念。

今年年初,陈俊龙教授团队的相关论作Broad Learning System: An Effective and Efficient Incremental Learning System Without the Need for Deep Architecture也将在IEEE Transactions on Neural Networks and Learning Systems, pp. 10-24, Vol. 29, Issue 1, 2018发表。

本文深度探讨了他关于BLS的研究体会,借此得以从论文作者的角度一窥BLS的研究思路。

图片由受访者提供

宽度学习系统(BLS)是作为一种「深度学习网络的替代方法」被提出的,它基于将映射特征作为RVFLNN(随机向量函数链接神经网络,random vector functional link neural network)输入的思想而设计。

上世纪80年代,早期的神经网络工作主要集中于解决调参与层次结构问题,特别是梯度下降参数的求解。当时还在美国攻读学位的陈俊龙就已经涉足神经网络、模糊系统及遗传算法的研究。在90年代末期,陈俊龙教授基于包约翰教授提出的RVFLNN进行了单隐层神经网络的研究,在增量学习上做出了一些成熟探索。但限于当时的时代条件,对大数据及训练时间的需求并不迫切,利用Kernel的概念及相关应用也尚未流行起来,因此这一理念并没有得以延续。

而在近年,陈俊龙教授与学生们也做了一些模糊神经网络结构对等以及模糊波斯曼机的深度神经网络的相关研究。尽管系统在精度上得到了提升,但在训练时间耗时过多的特性依然不尽人意。陈俊龙教授联想到自己往期所做的相关工作,开始规划设计一个「又快又准的算法和结构」。

BLS最重要的特点在于它的单隐层结构,具有两个重要的优势,一个是「横向扩展」,另一个则为「增量学习」。与深度神经网络不同之处在于,BLS不采用深度的结构,基于单隐层神经网络而构建,可以用「易懂的数学推导来做增量学习」。

以往在精度不够准确时,深度神经网络会采用增加层数或调整参数个数的方式来达到这一目的,而BLS可以采用横向扩展的方式,利用输入映射的特征作为网络的「特征节点」,再增强为随机生成权重的「增强节点」,并将映射特征与增强节点直接连接到输出端,对应的输出系数可以通过快递的Pseudo伪逆得出这样一来,新加入的神经节点,包括新加入的特征节点,BLS并不需要从头开始学习,只需要调节与新增节点有关的权重,也可以对新加入的输入同时做增量学习。

这两点可以让系统「在很短的时间内找到非常高效的结果」,论文中的「effective」 和「efficient」由此而来。

陈俊龙教授说,BLS最重要的部分在于「从输入值映射到特征值」,「这概念有点像SVM里头的Kernel转换。或者是CNN里头的卷积运算。经过转换的新数组,我们可以称为『特征值』。这转换可以随机产生,也可以微调,并由最后一层的权重再做最优值。」

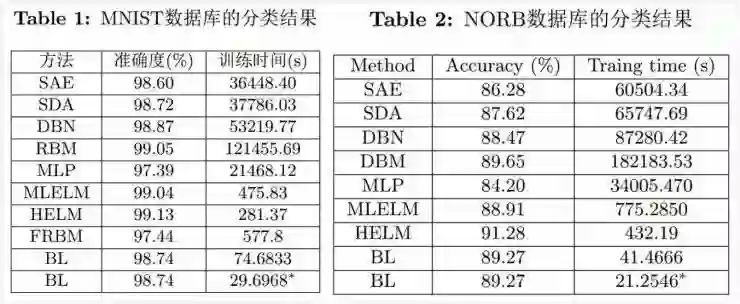

而在MNIST与NORB数据库上的表现可以看到,虽然BLS的测试准确度并非是最高的,但相对而言,在服务器上的训练速度要明显快于其它深度结构神经网络系统。宽度学习算法能够逐步更新建模系统,而不需要从头开始重新训练。「对于结构改变或输入变化是而不需要从头开始训练学习。因为学习时间非常快,也可以利用网格搜索很快速地找到一个优化的BLS结构。」陈俊龙教授说。

作为一个「无需深度结构的高效增量学习系统」,BLS实际上也存在着难点与挑战。在训练过程中,如果要经由稀疏的映射而对增强节点做比较好的组合,从输入的非线性的稀疏转换是一个比较重要的关键点。

此外,陈俊龙教授表示,如果输入过多时,(如 20 万个输入样本,每个样本至少有两三千维度时,)伪逆的算法所用的内存就对计算机提出了比较高的要求。「虽然可以通过做样本输入的增量学习来达成,但是在每一步的更新后,计算机总是会有微小的误差。如果能够把经由输入的增量学习找出来的最终权重,跟把所有输入收集一起做batch mode的伪逆所得的权重是一样的话,方能解决内存的问题。」

还有一个难点在于新加入节点会带来浪费的可能性:基于新加入节点增量学习的前提,无从保证新节点与原有节点是否构成线性独立。而如果要做一些算法处理(如orthogonal projection)来构成线性独立,则可能会额外增加训练时间,这又与宽度学习的初衷相悖。

虽然目前还存在一些优化空间,但陈俊龙教授认为,BLS逼近性优、算法快的特性能够使其很快成为主流训练方法。「在智能控制方面,类似 BLS 单隐层的神经网络已非常的流行。」这一点在大数据时代下显得较为实用:当系统收集到新输入数据时,在短时间内可以直接对节点进行更新,保证了系统的完整性。

「如果在一个在应用的场景里,在准确度可以被接受的前提下,能用最短的时间来完成任务,这何尝不是两全其美的事情?」在智能控制方面,大部分的系统因为有反馈的回路,所以宽度学习网络可以很快速地来做包括系统确定、微调、及输入的更新在内的工作。另一个重要的思路在于,宽度学习可以很容易地置于客户端来执行,而不需要依赖远程的云端计算,得以很快地做实时的更新,不用高大上的超算机。陈俊龙教授也表示,BLS的主要应用场景集中在智能控制的环境中进行实时更新学习,譬如在智能家居的环境中更新语音识别、人物识别、物体识别的相关系统,那么BLS也能在其中发挥它的重要优势,甚至成为主流。

陈俊龙教授在未来会将工作重心放在BLS的算法优化和稳定上,除此之外,寻找应用的行业与场景也成为了陈俊龙教授接下来一段时间的工作要点。在理论知识的基础上不忘找寻应用场景,是陈俊龙教授治学的基本理念。

回忆起在普度大学的博士就学经历,陈俊龙教授之所以会把这段经历评价为「整个事业生涯的一个重要里程碑」,正是在于普度大学非常看重工程背后的理论知识,强调理论与实际应用的结合。当时陈俊龙教授所在的智能制造团队的Intelligent manufacturing,下属在傅京孙教授在普度大学建立的「美国工程研究中心」的子团队,有着不少工程理论的训练。

陈俊龙教授也正是秉承博士导师赠予的箴言「always try your best」,一直潜心学问,笔耕不缀,共有31篇高被引论文(在ISI排名前1%)。在问及如何做论文选题时,陈俊龙教授也不忘首先感谢论文工作的合作者们,随后再开始谈自己的观点。他认为,要做选题之前,要先对学科研究进行细细分析,判断是做增量式研究还是大的概念突破,其次,也要对学科研究进行细读分析。「其实老师们都有出科研文章的压力。学生得毕业,有时候就不得不出增量式的改良文章(我有时也这样),但是要时时的提醒自己在一段时间内,还是要想想哪些文章是重要的,会有突破的。」

在采访期间,陈俊龙教授提及了两个促使他「跳出舒适感」的节点。一个是2010年,在美国长驻28年,担任教职23年后,陈俊龙教授决定回国,担任澳门大学的科技学院院长与讲座教授,后续又担任了自动化学会的副理事长。

「在美国的日子比较单纯,经过了奋斗期拿到了终身教授教职时,不论是在工作和生活上都很惬意,它的舒适感比较高,但是晋升到高层的机会相当就比较少。还有最重要的一点,应该是我个人的观点,当一件事情没有挑战感时,就可能是要跳出那舒适感的时候了。回国来澳门大学是我人生治学生涯中的一个重要分水岭,它有挑战感。」

在任内,陈俊龙教授推动澳门大学的工程学科及计算机学科获得国际工程组织(华盛顿协议跟首尔协议)的认证。同时也带领澳门大学的工程学科及计算机学科跻身世界大学学科排名前200名。

作为留美多年的学者,陈俊龙教授在访谈中一方面肯定了美国在AI研究上的多层面深入,在基础理论、技术层面及行业应用的都有着深厚的积累;另一方面也肯定了国内对科研的支持力度(包括澳门、内地),「我国人工智能技术攻关和产业应用虽然起步较晚,但在国家多项政策和科研基金的支持与鼓励下,近年来发展势头迅猛。在算法上,我国也可以媲美。虽然中国在人工智能的论文数量方面超过美国,但中国学者的研究影响力目前尚不及美国或英国同行。这也是我们这一行应该侧重的。同时我认为AI方面的科研应该要有应用市场及对一般民众的有感(军事的应用另外谈)。之前的中国科协的九大会议里的万众创新就是这种思维。」

而第二个节点则是最近,陈俊龙教授刚刚结束了他作为澳门大学科技学院院长的任期,也提及他正在思考与企业合作的切入点以及「跳出舒适感」,坦承「这是很不简单的」。陈俊龙教授认为,相对而言,在学术界的研究还是相对自由,可以「自己给自己出很困难的题目,然后想办法去解决它」,这种成就感让陈俊龙教授觉得欲罢不能。但企业的研究有时间的急迫性,也有市场、经济财务的压力。因此陈俊龙教授认为,要「跳」到企业界不仅有它的难度,也同样有机缘巧合的因素。

附:陈俊龙教授简介

陈俊龙,澳门大学讲座教授及科技学院前院长,博士生导师,国家千人学者,自动化学会副理事长,IEEE Transactions on Systems, Man, and Cybernetics: Systems期刊主编。1985年获美国密西根大学硕士学位,1988年获美国普度大学博士学位。曾在美国德州大学工学院任终身教授、工学院副院长及电机计算机系主任。曾任IEEE Systems, Man, and Cybernetics Society (SMCS) 学会国际总主席(2012-2013),现任资深主席(2016-2017)。陈教授是IEEE Fellow、AAAS Fellow、CAA Fellow、国际系统及控制论科学院院士(IASCYS)、香港工程师学会Fellow,担任多个IEEE期刊副主编。科研方向包括:系统及智能算法理论与工程,数据分析及挖掘,物理建模及智能控制。

陈教授近五年主持与参与的各类国家科技计划包括:国家基金委、科技部973物联网计划子课题和澳门科学基金会。曾承接美国基金委,美国航天局,美国空军科研实验室,海军研究实验室科研计划。两次获澳门自然科学奖,2016年获母校美国普度大学杰出电机与计算机工程奖。

📚往期文章推荐

🔗谷歌大脑2017总结 | Jeff Dean执笔,干货满满

🔗Science | 机器学习究竟将如何影响人类未来的工作?

🔗微软沈向洋 | 从Eliza到小冰,社交对话机器人的机遇和挑战

🔗征稿延期通知|第二届IEEE/IFAC区块链与知识自动化国际会议

点击“阅读原文”,快速进入峰会报名通道!