【Github】BERT-NER-Pytorch:三种不同模式的BERT中文NER实验

作者:lonePatient

Github地址:

https://github.com/lonePatient/BERT-NER-Pytorch

编者按:这是来自AINLP芝麻街嘉宾 马可灬低调 同学个人项目分享,推荐Star,点击文末阅读原文直达。

Chinese NER using Bert

BERT for Chinese NER.

model list

BERT+Softmax

BERT+CRF

BERT+Span

requirement

pytorch=1.1.0

cuda=9.0

input format

Input format (prefer BIOS tag scheme), with each character its label for one line. Sentences are splited with a null line.

美 B-LOC

国 I-LOC

的 O

华 B-PER

莱 I-PER

士 I-PER

我 O

跟 O

他 O

谈 O

笑 O

风 O

生 O

run the code

Modify the configuration information in

run_ner_xxx.pyorrun_ner_xxx.sh.sh run_ner_xxx.sh

result

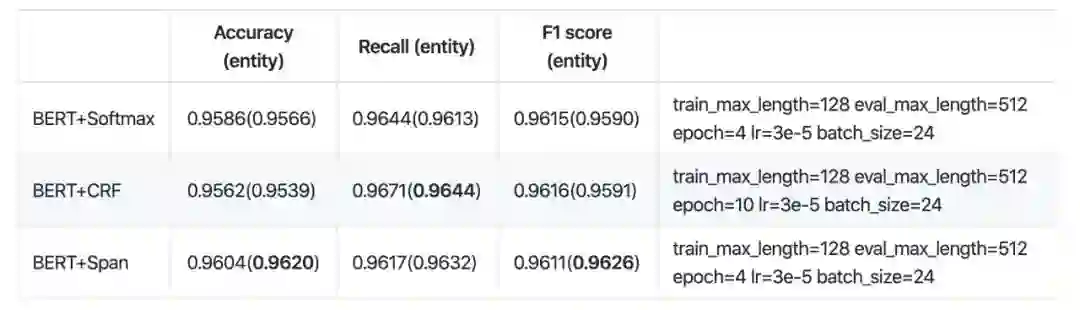

Tne overall performance of BERT on dev(test):

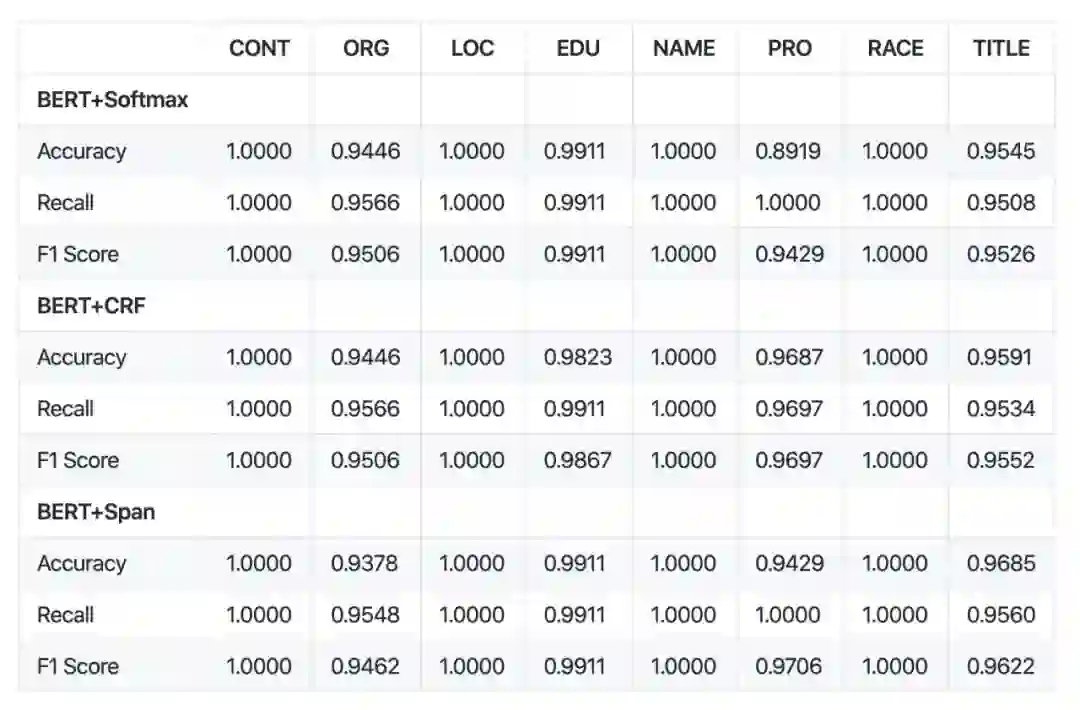

The entity performance performance of BERT on test:

推荐阅读

我们建了一个免费的知识星球:AINLP芝麻街,欢迎来玩,期待一个高质量的NLP问答社区

AINLP-DBC GPU 云服务器租用平台建立,价格足够便宜

关于AINLP

AINLP 是一个有趣有AI的自然语言处理社区,专注于 AI、NLP、机器学习、深度学习、推荐算法等相关技术的分享,主题包括文本摘要、智能问答、聊天机器人、机器翻译、自动生成、知识图谱、预训练模型、推荐系统、计算广告、招聘信息、求职经验分享等,欢迎关注!加技术交流群请添加AINLP君微信(id:AINLP2),备注工作/研究方向+加群目的。