【ICLR2022】GNN-LM基于全局信息的图神经网络语义理解模型

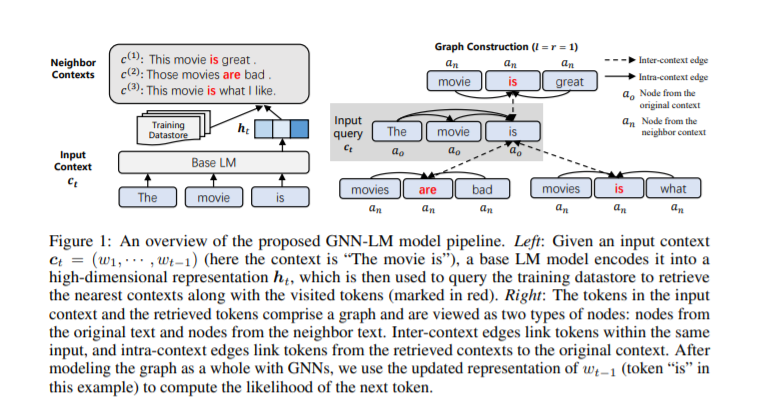

本文提出了GNN-LM,将图神经网络与语言模型相结合,通过允许在整个训练语料库中引用相似的上下文,扩展了传统的语言模型。使用k近邻检索与输入的表示最相似的邻居,我们为每个输入构建了一个有向异构图,其中节点是来自输入上下文或检索到的邻居上下文的token,边表示token之间的连接。然后利用图神经网络从检索到的上下文中聚合信息,以解码下一个token。实验结果表明,GNN-LM在标准数据集中优于强基线,并且通过与kNN-LM结合,能够在WikiText-103上取得最优效果。

论文标题:

GNN-LM: Language Modeling based on Global Contexts via GNN

作者:

Yuxian Meng, Shi Zong, Xiaoya Li, Xiaofei Sun, Tianwei Zhang, Fei Wu, Jiwei Li

论文链接:

https://www.zhuanzhi.ai/paper/096327d547ab2c5aee0df3e603ac64e6

接收会议:

ICLR 2022

代码链接:

https://github.com/ShannonAI/GNN-LM

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“GNLM” 就可以获取《【ICLR2022】GNN-LM基于全局信息的图神经网络语义理解模型》专知下载链接

登录查看更多

相关内容

Arxiv

10+阅读 · 2021年10月4日

Arxiv

20+阅读 · 2021年5月27日

Arxiv

19+阅读 · 2019年11月20日