【CVPR2022】基于节点-邻域互信息最大化的图中节点表示学习

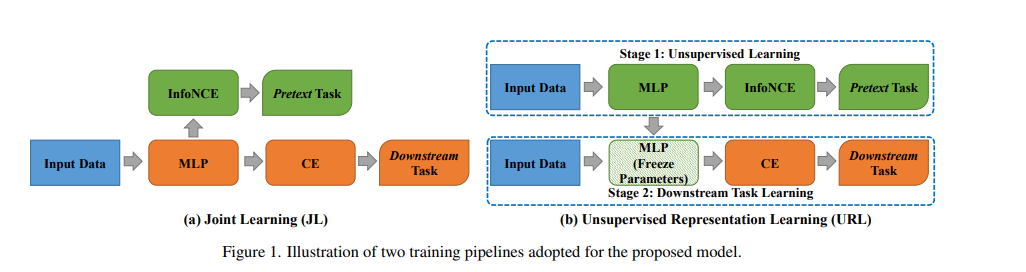

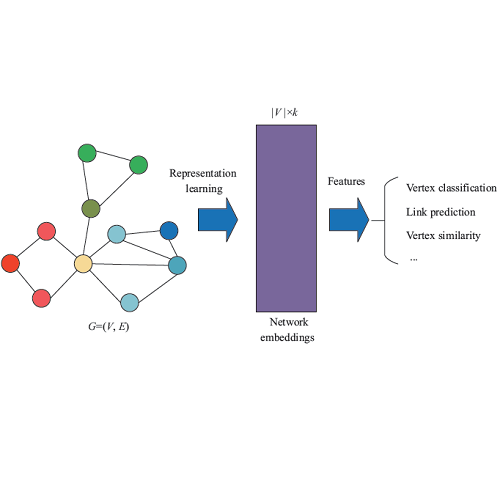

在CVPR 2022: Node Representation Learning in Graph via Node-to-Neighbourhood Mutual Information Maximization文章中,作者提出了一种简单有效的自监督节点表示学习策略框架,其通过直接最大化节点及其邻域的隐藏表示之间的互信息,并从理论上可以证明它与图平滑的联系。基于对比学习中的InfoNCE损失函数,文章提出的策略框架可由设计的代理损失函数进行优化,在此正样本的选择对于表示学习的质量和效率至关重要。为了选择高质量的正样本,文章中提出了一种拓扑感知的正样本采样策略,该策略通过考虑节点之间的结构依赖性来对邻域进行正样本采样,且在模型训练之前即可完成采样工作。文章中的采样策略甚至可以从邻域中仅仅采样一个最重要的正样本进行随后的模型训练,在这种极端的采样操作下,文章中的模型完全避免了具有高空间复杂度的邻域聚合算子。文章中的方法在各种节点分类数据集上取得了良好的性能。值得一提的是,将文章中的损失函数应用于基于多层感知机的节点编码器,可以比现有的解决方案快几个数量级。

https://www.zhuanzhi.ai/paper/59e7e99b81f4b39d6c85e36104249c8d

图1 CVPR论文的部分成果展示

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“NMIM” 就可以获取《【CVPR2022】基于节点-邻域互信息最大化的图中节点表示学习》专知下载链接

请扫码加入专知人工智能群(长按二维码),或者加专知小助手微信(zhuanzhi02),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG、论文等)交流~

登录查看更多

相关内容

Arxiv

0+阅读 · 2022年4月20日

Arxiv

0+阅读 · 2022年4月14日

Arxiv

11+阅读 · 2021年6月25日