BAT机器学习面试1000题(671~675题)

点击蓝字“七月在线实验室”关注我们

BAT机器学习面试1000题(671~675题)

671题

假定你想将高维数据映射到低维数据中,那么最出名的降维算法是 PCA 和 t-SNE。现在你将这两个算法分别应用到数据「X」上,并得到数据集「X_projected_PCA」,「X_projected_tSNE」。下面哪一项对「X_projected_PCA」和「X_projected_tSNE」的描述是正确的?

A、X_projected_PCA 在最近邻空间能得到解释

B、X_projected_tSNE 在最近邻空间能得到解释

C、两个都在最近邻空间能得到解释

D、两个都不能在最近邻空间得到解释

点击下方空白区域查看答案

▼

672题

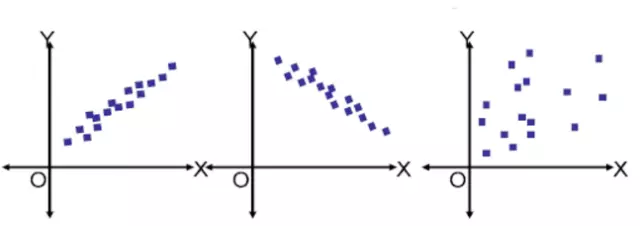

给定下面两个特征的三个散点图(从左到右依次为图 1、2、3)

在上面的图像中,哪一个是多元共线(multi-collinear)特征?

A、图 1 中的特征

B、图 2 中的特征

C、图 3 中的特征

D、图 1、2 中的特征

点击下方空白区域查看答案

▼

673题

在先前问题中,假定你已经鉴别了多元共线特征。那么下一步你可能的操作是什么?

1 移除两个共线变量

2 不移除两个变量,而是移除一个

3 移除相关变量可能会导致信息损失。为了保留这些变量,我们可以使用带罚项的回归模型(如 ridge 或 lasso regression)。

A、只有 1

B、只有 2

C、只有 3

D、2 或 3

点击下方空白区域查看答案

▼

674题

给线性回归模型添加一个不重要的特征可能会造成:

1 增加 R-square

2 减少 R-square

A、只有 1 是对的

B、只有 2 是对的

C、1 或 2 是对的

D、都不对

点击下方空白区域查看答案

▼

675题

假设给定三个变量 X,Y,Z。(X, Y)、(Y, Z) 和 (X, Z) 的 Pearson 相关性系数分别为 C1、C2 和 C3。现在 X 的所有值加 2(即 X+2),Y 的全部值减 2(即 Y-2),Z 保持不变。那么运算之后的 (X, Y)、(Y, Z) 和 (X, Z) 相关性系数分别为 D1、D2 和 D3。现在试问 D1、D2、D3 和 C1、C2、C3 之间的关系是什么?

A、D1= C1, D2 < C2, D3 > C3

B、D1 = C1, D2 > C2, D3 > C3

C、D1 = C1, D2 > C2, D3 < C3

D、D1 = C1, D2 < C2, D3 < C3

E、D1 = C1, D2 = C2, D3 = C3

点击下方空白区域查看答案

▼

题目来源:七月在线官网(https://www.julyedu.com/)——面试题库——笔试练习——机器学习

今日学习推荐

【机器学习集训营第七期】

火热报名中

前一百人特惠价:13999元

2019年1月14日开课

三个月挑战年薪四十万,甚至拿更高薪~

往期学员面经来一波

看看他们的面试经验和学习心得

(点击下方直接查看)

有意的亲们抓紧时间喽,报名即送两门课程👉《机器学习工程师 第九期》、《深度学习 第四期》,助力您更好的学习机器学习。且两人及两人以上组团还能各减500元,想组团/咨询者可添加微信号:julyedukefu_02

咨询/报名/组团可添加微信客服

julyedukefu_02

👇

长按识别二维码

更多资讯

请戳一戳

往期推荐

985本科生程序员,校招拿到40万的Offer,老员工被倒挂:难受!

拼团,咨询,查看课程,请点击 “ 阅读原文 ”