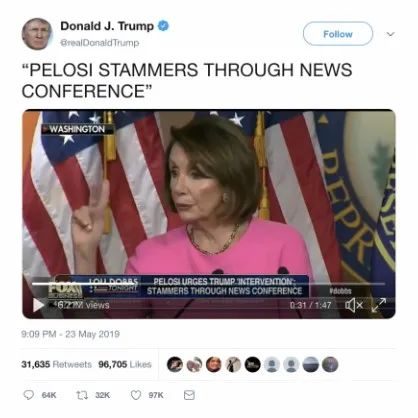

恶搞大军出动,佩洛西这次被「假视频」整惨了!

新智元报道

新智元报道

【新智元导读】恶搞视频越来越「邪门」了!面对层出不穷的假视频,媒体是否有义务做出提醒?

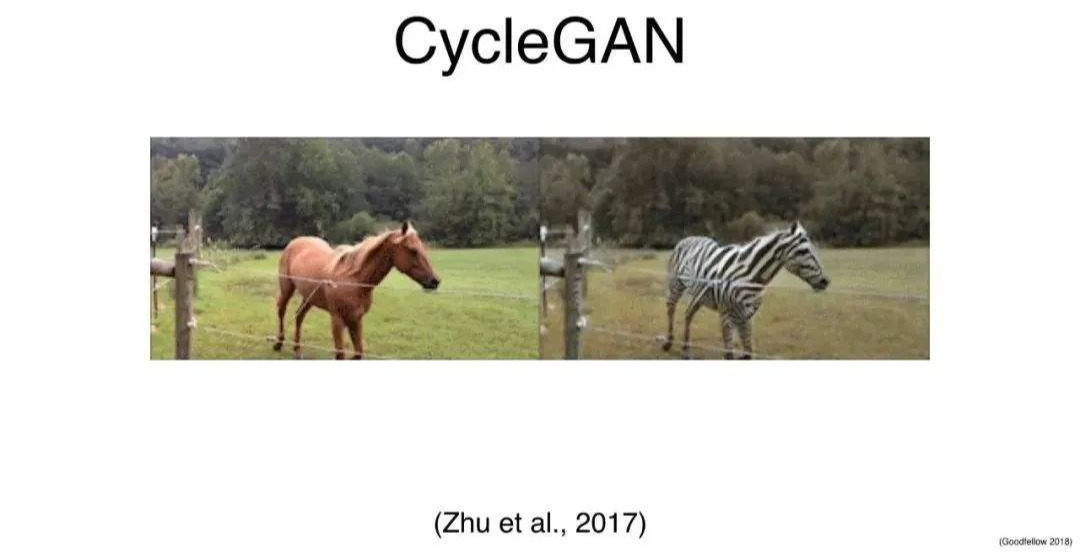

更神奇的DeepFake

女士们,先生们:我的名字叫Albert Einstein。我们全体人类正陷入一场战争, 而我们的敌人却看不见摸不着。请大家待在家里,保持距离,勤洗手。团结起来,我们一定能够战胜新冠病毒。谢谢。

媒体有提醒义务吗?

登录查看更多

相关内容

专知会员服务

27+阅读 · 2022年3月3日

Arxiv

0+阅读 · 2022年10月3日

Arxiv

0+阅读 · 2022年9月29日