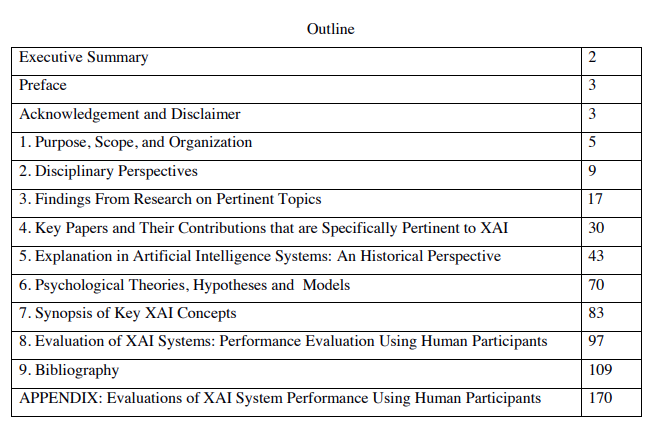

推荐!DARPA XAI计划支持《人类-人工智能系统中的解释:可解释的人工智能的关键思想和出版物的文献元分析综述概要和目录 》

总结

序言

专知便捷查看

便捷下载,请关注专知人工智能公众号(点击上方蓝色专知关注)

后台回复“DARPA” 就可以获取《推荐!DARPA XAI计划支持 200页报告《人类-人工智能系统中的解释:可解释的人工智能的关键思想和出版物的文献元分析综述概要和目录 》》专知下载链接

登录查看更多

相关内容

Arxiv

10+阅读 · 2018年4月11日