对于群体智能中的人类操作员来说,关键情况下的决策支持至关重要。自主系统共享的大量数据很容易使人类决策者不堪重负,因此需要支持以智能方式分析数据。为此,使用了用于评估情况和指示可疑行为或统计异常值的自主系统。这增强了他们的态势感知能力并减少了工作量。因此,在这项工作中,强调为检测监视任务中的异常而开发的数据融合服务,例如在海事领域,可以适应支持集群智能的运营商。此外,为了使人类操作员能够理解群体的行为和数据融合服务的结果,引入了可解释的人工智能 (XAI) 概念。通过为某些决策提供解释,这使得自主系统的行为更容易被人类理解。

作者解决了由于自主系统共享大量数据而导致的信息过载问题。为了缓解这个问题,他们建议通过两种智能数据分析方式来帮助人类操作员。第一种方法是自动异常检测,这可能会加强人类操作员的 态势感知SA 并减少他们的工作量。第二种方法是可解释的人工智能 (XAI) 概念;它们有可能使群体行为以及异常检测结果更易于理解。

作者认为,控制一群无人机仍然具有挑战性。一方面,(半自动化)群体代理“必须决定行动方案”;另一方面,人类操作员必须决定他们的行动,例如与群体互动。提出的建议力求改善人在循环中。考虑到海上监视的应用,使用非固定代理的动态方法具有几个优点。首先,某些场景只能使用动态方法进行管理;其次,与固定监视传感器相比,代理更便宜;第三,在多个地点灵活使用代理可以减少操作群体所需的人员数量。然而,情况评估仍然需要知情的操作员。

作者认为,在海洋领域用于船舶分析的异常检测算法可能适用于引入以下场景的群体。“假设我们有一个群体来支持海上船只,这些船只不仅会收集它们自己的传感器系统可用的数据,还会收集所有资产的数据。所有来源收集的信息都需要融合成一幅连贯的画面。这不应仅限于 JDL 数据融合的第一级,而应包括更高级别的数据融合过程,以获取有关附近所有对象的可用信息。” 数据驱动的方法能够应对这种情况。文献提供了三种检测位置和运动异常的方法:统计解释为与正常行为相比的异常值;聚类分析聚类相似的轨迹和确切的路线;用于建模正常移动模式的深度学习方法。为了应对更复杂的场景,包括船舶周围环境(基础设施、地理、天气等)在内的算法是必要的。在某些复杂异常的情况下,区分正常和异常行为需要基于规则、基于模糊、多智能体或基于概率图形模型的算法。对于所有提到的算法类别,作者都指出了大量的示例算法。

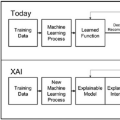

一些算法是黑盒模型,因此,它们的解释对于人类操作员来说是复杂的。XAI 概念可以帮助缓解这个问题。XAI 概念旨在“提供道德、隐私、信心、信任和安全”,并努力在“它已经做了什么、现在正在做什么以及接下来会发生什么”中明确决策。,从而提高了人工操作员的 SA。考虑到 XAI 模型,模型特定方法(仅限于某些数学模型)可以与模型无关(适用于任何类型的模型)方法区分开来。

在目前的贡献中,重点是与模型无关的方法。考虑到这些,局部解释方法(解释整个模型的单个预测结果)可以与全局解释方法(解释整个模型的行为,例如以规则列表的形式)区分开来。此外,作者使用特征属性、路径属性和关联规则挖掘来区分方法。通过特征属性,“用户将能够了解他们的网络依赖于哪些特征”;方法示例是提供全局和局部可解释性的 Shapley Additive Explanations (SHAP) 和指示“模型在进行预测时考虑的输入特征” 的局部可解释模型无关解释 (LIME)。路径集成梯度(PIG,使用局部解释)等路径属性提供了对模型预测贡献最大的特征,从而深入了解导致决策的推理。关联规则挖掘(ARM)是另一种使用全局解释的方法,发现大型数据集中特征之间的相关性和共现。ARM 方法使用简单的 if-then 规则,因此被认为是最可解释的预测模型。可伸缩贝叶斯规则列表 (SBRL)、基尼正则化 (GiniReg) 和规则正则化 (RuleReg) 技术被认为适用于监视任务。

作者认为,使用这样的 XAI 概念,人类操作员(决策者)可以更好地理解、更好地控制和更好地与一群自主代理进行通信,尤其是在具有挑战性的环境中。总而言之,将异常检测和 XAI 概念这两种方法应用于人类在环、用户对群体智能的理解和信任可能会得到改善。