XAI是否靠谱?美国DARPA「可解释人工智能」(XAI计划)的4年回顾与经验总结,附中文版

导语:可解释人工智能的概念最早来自于美国DARPA(美国防部高级研究计划局),2017年,为期4年的XAI研究计划启动。现在,随着 XAI 在 2021 年结束,本文总结和反思了 XAI 项目的目标、组织和研究进展。完整中英文版请上专知网站(www.zhuanzhi.ai)查看!

作者:David Gunning, Eric Vorm, Jennifer Yunyan Wang, Matt Turek

摘要

DARPA 于 2015 年制定了可解释人工智能 (XAI) 计划,旨在使最终用户能够更好地理解、信任和有效管理人工智能系统。2017年,为期四年的XAI研究计划开始。现在,随着 XAI 在 2021 年结束,是时候反思什么成功了,什么失败了,以及学到了什么。本文总结了 XAI计划的目标、组织和研究进展。

1 XAI计划创建背景

机器学习的巨大成功创造了新的人工智能 (AI) 能力的爆炸式增长。持续的进步有望产生能够自行感知、学习、决策和行动的自主系统。这些系统提供了巨大的好处,但它们的有效性将受到机器无法向人类用户解释其决策和行动的限制。这个问题对美国国防部 (DoD) 尤其重要,它面临着需要开发更智能、自主和可靠系统的挑战。可解释的人工智能对于用户理解、适当信任和有效管理新一代人工智能合作伙伴至关重要。

可解释性问题在某种程度上是人工智能成功的结果。在人工智能的早期,主要的推理方法是逻辑和符号。这些早期系统通过对(某种程度上)人类可读符号执行某种形式的逻辑形式来进行推理。早期系统可以生成其推理步骤的痕迹,然后可以成为解释的基础。因此,在如何使这些系统可解释方面进行了大量工作(Shortliffe & Buchanan, 1975; Swartout, Paris, & Moore, 1991; Johnson, 1994; Lacave & D´ıez, 2002; Van Lent, Fisher, & Mancuso , 2004)。

然而,这些早期的人工智能系统是无效的;事实证明,它们的建造成本太高,而且对于现实世界的复杂性来说太脆弱了。AI 的成功伴随着研究人员开发了新的机器学习技术,这些技术可以使用他们自己的内部表示(例如,支持向量、随机森林、概率模型和神经网络)来构建世界模型。这些新模型更有效,但必然更不透明且难以解释。

2015 年是 XAI 需求的转折点。数据分析和机器学习刚刚经历了十年的快速发展(Jordan & Mitchell,2015)。在 2012 年突破性的 ImageNet 演示之后,深度学习革命才刚刚开始(Krizhevsky、Sutskever 和 Hinton,2012 年)。大众媒体对超级智能 (Bostrom, 2014) 和即将到来的 AI 启示录(Apocalypse) (Gibbs, 2017, Cellan-Jones, 2014, Marr, 2018) 充满活力猜测。每个人都想知道如何理解、信任和管理这些神秘的、看似高深莫测的人工智能系统。

2015 年还出现了提供可解释性的初步想法。一些研究人员正在探索深度学习技术,例如使用反卷积网络来可视化卷积网络的层级(Zeiler & Fergus,2014)。其他研究人员正在寻求学习更多可解释模型的技术,例如贝叶斯规则列表 (Letham, Rudin, McCormick, & Madigan, 2015)。其他人正在开发与模型无关的技术,可以用机器学习模型(作为黑盒)进行试验,以推断出近似的、可解释的模型,例如 LIME(Ribeiro、Singh 和 Guestrin,2016 年)。还有一些人评估可解释交互的心理和人机交互因素(Kulesza、Burnett、Wong 和 Stumpf,2015 年)。

DARPA 花了一年时间调查研究人员,分析可能的研究策略,并制定计划的目标和结构。2016 年 8 月,DARPA 发布 DARPA-BAA-16-53 征集提案。

2 XAI计划目标

可解释人工智能 (XAI) 的既定目标是创建一套新的或改进的机器学习技术,以产生可解释的模型,当与有效的解释技术相结合时,使最终用户能够理解、适当地信任和有效地管理新一代人工智能系统。

XAI 的目标是最终用户,他们依赖于 AI 系统产生的决策或建议,或者它采取的行动,因此需要了解系统的基本原理。例如,从大数据分析系统接收建议的情报分析师需要了解它为什么建议某些活动,需要进行进一步调查。同样,执行自主系统任务的操作员需要了解系统的决策模型,以便在未来的任务中适当地使用它。XAI 的概念是为用户提供解释,使他们能够了解系统的整体优势和劣势;传达对其在未来/不同情况下的表现的理解;并且可能允许用户纠正系统的错误。

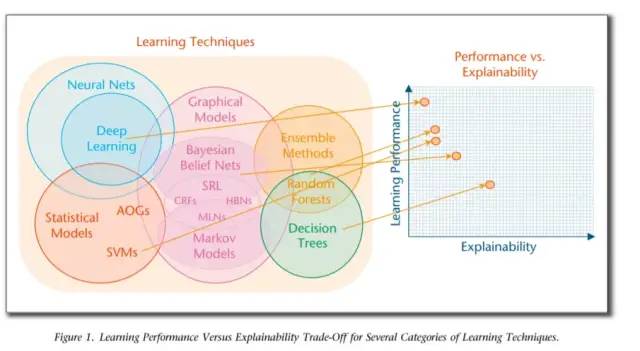

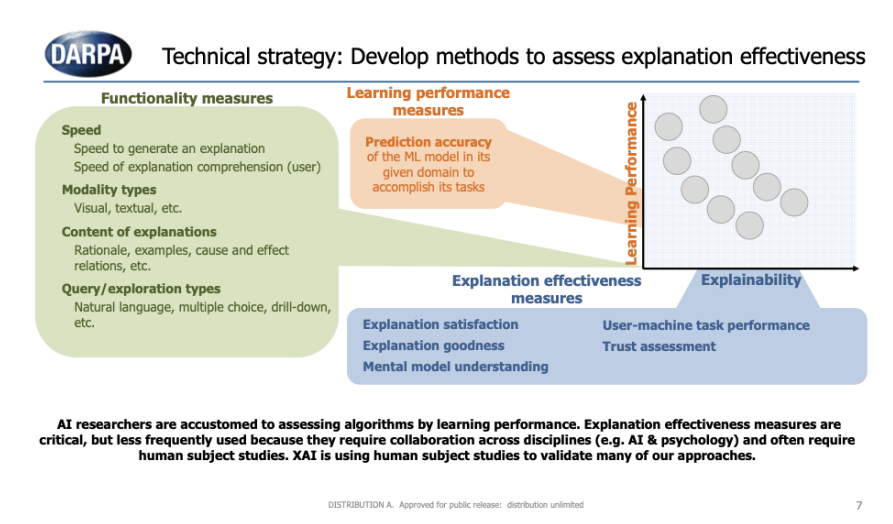

XAI 计划假设机器学习性能(例如,预测准确性)和可解释性之间存在固有矛盾关系,这一问题与当时的研究结果一致。通常性能最高的方法(例如深度学习)是最难解释的,而最可解释的(例如决策树)是最不准确的。该计划希望创建一系列新的机器学习和解释技术,为未来的从业者提供更广泛的设计选项,涵盖性能-可解释性交易空间。如果应用程序需要更高的性能,XAI 产品组合将包括更可解释、高性能的深度学习技术。如果应用系统需要更多的可解释性,XAI 将包括性能更高、可解释的模型。

3 XAI计划结构体系

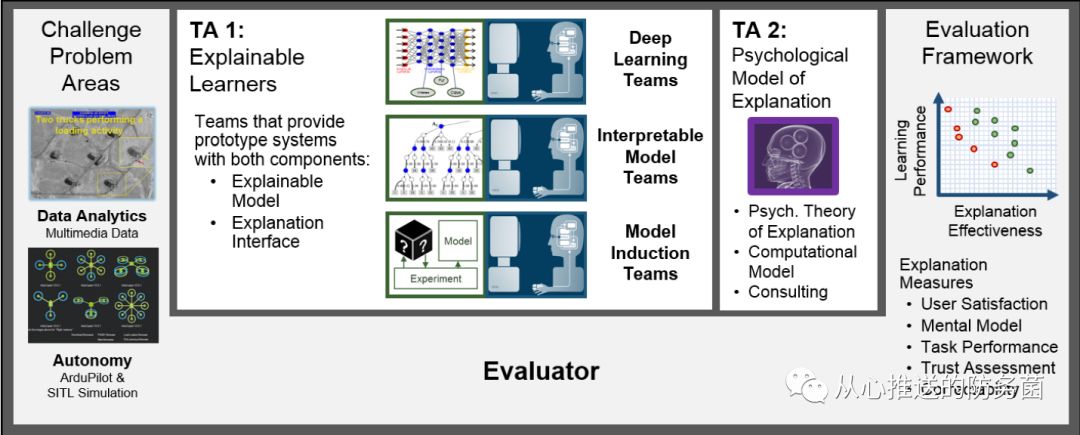

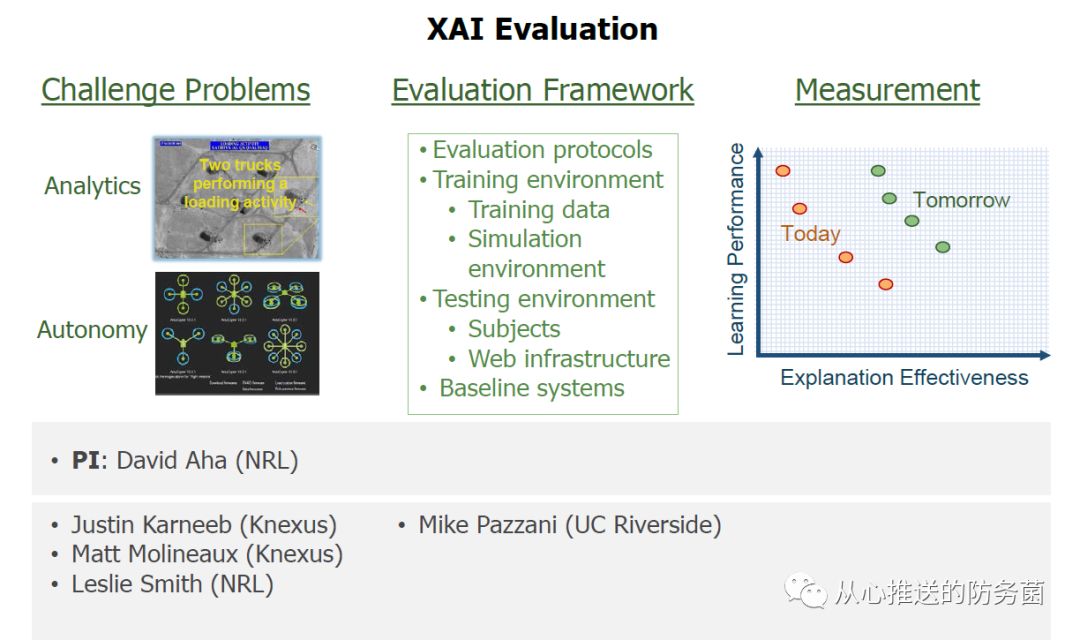

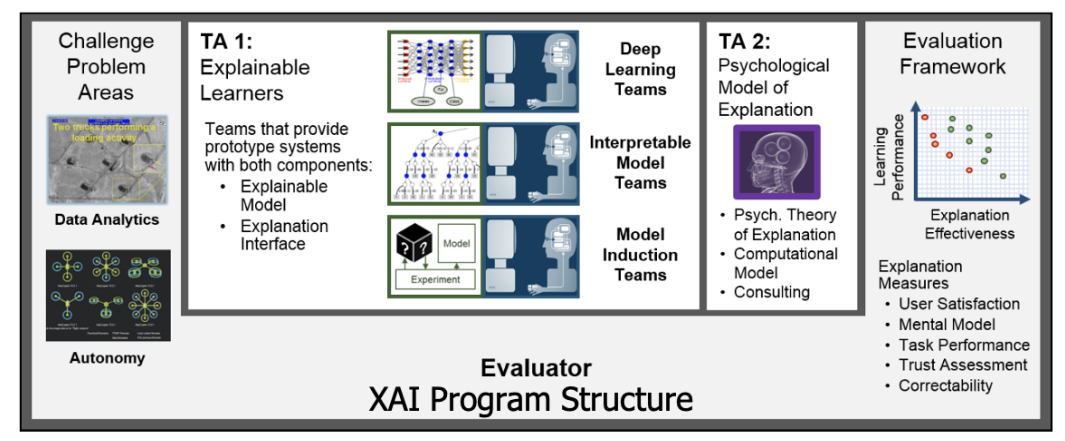

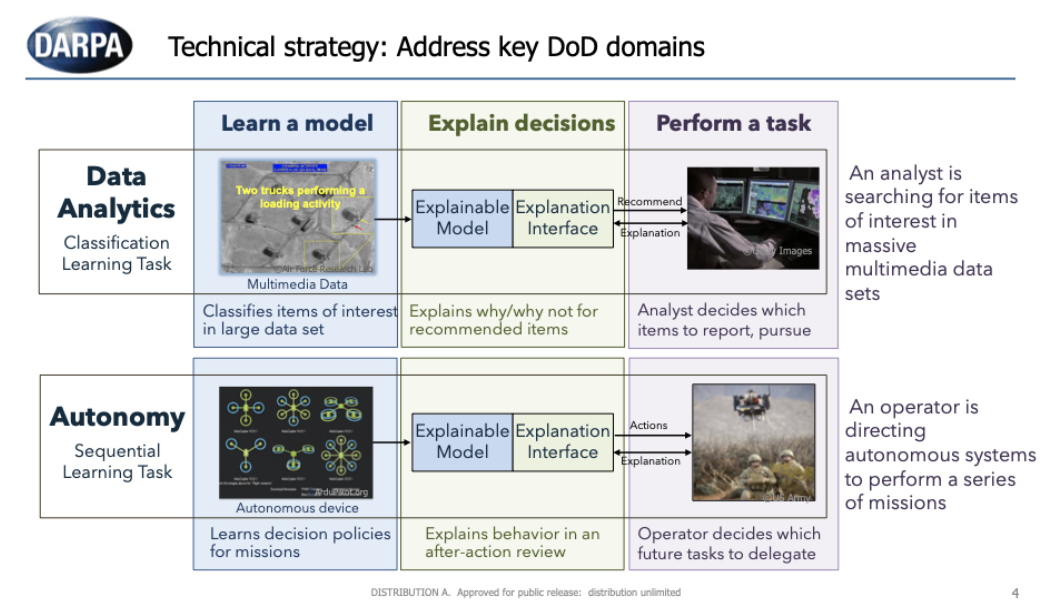

该计划分为三个主要技术领域(technical areas,TAs),如图 1 所示:(1)开发新的 XAI 机器学习和可解释技术以产生有效的解释性;(2)通过总结、延伸和应用可解释心理学理论,来理解可解释心理;(3) 在两个挑战问题领域评估新的 XAI 技术:数据分析和自主性。

最初的计划时间表包括两个阶段:第一阶段,技术演示(18 个月);第 2 阶段,比较评估(30 个月)。在第一阶段,开发人员被要求针对他们自己的测试问题展示他们的技术。在第 2 阶段,最初的计划是让开发人员针对政府评估人员定义的两个常见问题之一(图 2)测试他们的技术。在第 2 阶段结束时,预计开发人员将向开源 XAI 工具包贡献原型软件。

4 XAI计划开发

2017年5月,XAI计划开始启动。选择了 11 个研究团队来开发可解释学习器 (TA1),并选择了一个团队来开发可解释的心理模型。评估由美国海军研究实验室提供。以下总结了这些进展以及该计划结束时这项工作的最终状态。Gunning 和 Aha,2019 年给出了 2018 年底 XAI 发展的中期总结。

4.1 XAI可解释的学习方法(XAI Explainable Learner Approaches)

该计划预计研究人员将调查训练过程、模型表示,以及重要的解释交互。为模型表示设想了三种通用方法。可解释的模型方法将寻求开发对机器学习专家来说本质上更易于解释和更内省的 ML 模型。深度解释方法将利用深度学习或混合深度学习方法来产生除预测之外的解释。最后,模型归纳技术将从更不透明的黑盒模型创建近似可解释的模型。解释交互被认为是 XAI 的一个关键元素,将用户连接到模型,使他们能够理解决策过程并与之交互。

随着研究的进展,11 个 XAI 团队探索了许多机器学习方法,例如易处理的概率模型 (Roy et al. 2021) 和因果模型 (Druce et al. 2021) 以及强化学习算法生成的状态机等解释技术(Koul et al. 2019, Danesh et al. 2021), 贝叶斯教学 (Yang et al. 2021), 视觉显著图 (Petsiuk 2021, Li et al. 2021, Ray et al. 2021, Alipour et al. 2021, Vasu et al. 2021),以及网络和 GAN 解剖 (Ferguson et al. 2021)。也许最具挑战性和最独特的贡献来自机器学习和解释技术的结合,以进行精心设计的心理实验来评估解释的有效性。

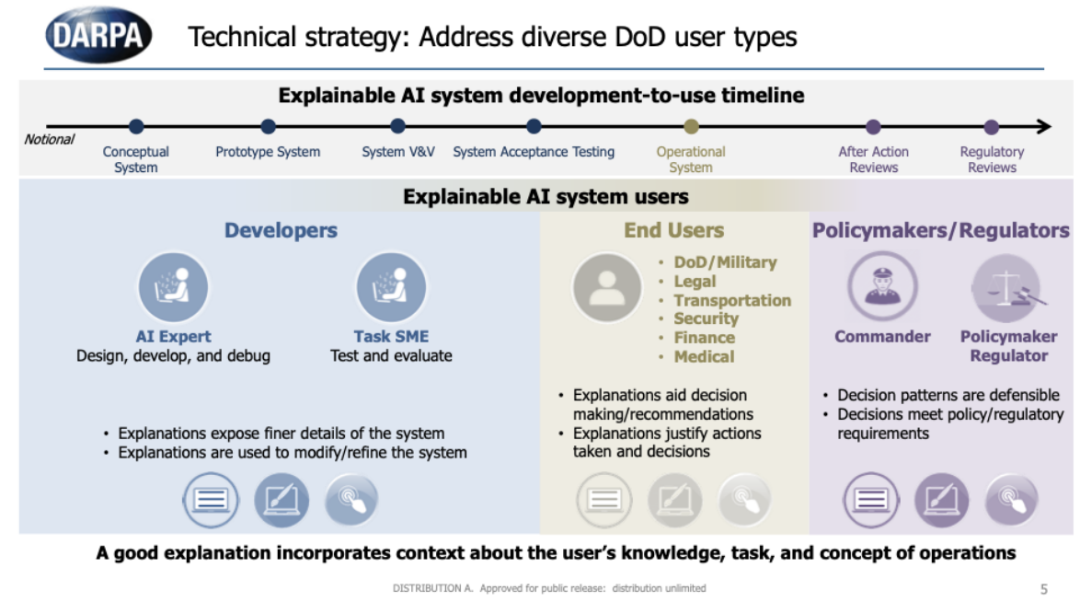

随着计划的推进,我们也对用户范围和开发时间线有了更深入的了解(图 3)。

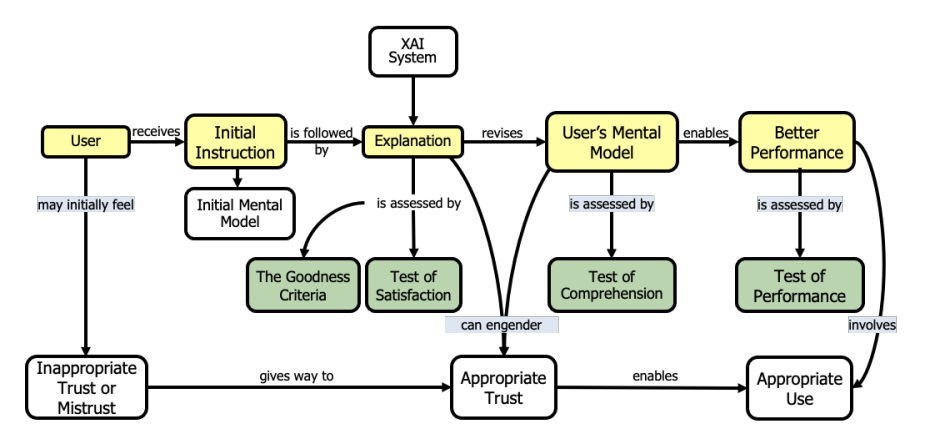

4.2 解释的心理学模型(Psychological Models of Explanation)

该计划需要对解释有扎实的心理学理论支持。选择了一个团队来总结当前的解释的心理学理论,以协助 XAI 开发人员和评估团队。这项工作始于对解释心理学的广泛文献调查以及之前关于 AI 可解释性的工作(IHMC 文献调查的参考资料)。最初,该团队被要求(1)对当前的解释理论进行总结,(2)根据这些理论开发一个解释的计算模型;(3) 根据 XAI 开发人员的评估结果验证计算模型。开发计算模型被证明是一座太极端的桥梁,但该团队确实对该领域有深入的了解并成功地制作了描述性模型。这些描述性模型对于支持有效的评估方法至关重要,这些评估方法涉及精心设计的用户研究,按照美国防部人体研究指南进行。图4说明了 XAI 解释过程的顶级描述模型。

4.3 评估

最初设想评估基于数据分析和自主性领域内的一组常见问题。然而,很快就很清楚,在广泛的问题领域中探索各种方法会更有价值。为了评估该计划最后一年的表现,由美国海军研究实验室 (NRL) 领导的评估小组开发了一个解释评分系统 (ESS)。基于一组领域专家的建议并使用内容有效性比 (CVR) 进行验证,ESS 提供了一种用于评估 XAI 用户研究设计的定量机制。ESS 评估用户研究的多个要素,包括任务、领域、解释、解释交互、用户、假设、数据收集和分析。XAI 评价指标如图 5所示,包括功能性指标、学习绩效指标和解释有效性指标。仔细设计用户研究以准确评估解释的有效性至关重要。通常,评估 XAI 算法的性能需要多种类型的度量(参见性能、功能、解释有效性)。XAI 用户研究设计可能很棘手,通常在该计划中最有效的团队拥有具有丰富心理学专业知识的人员。

5 XAI计划开发方法

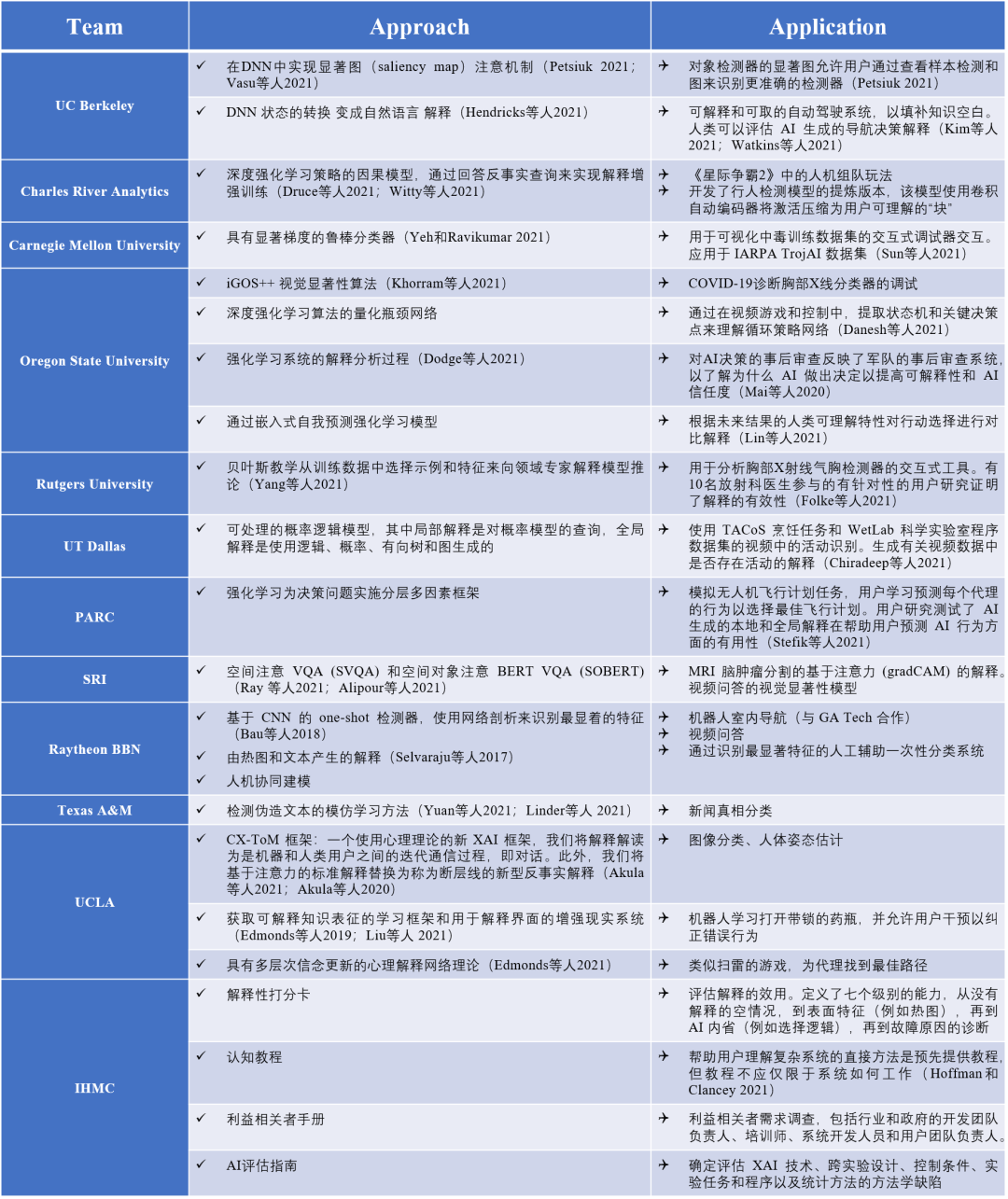

XAI计划探讨了许多方法,如表1所示。

表1: DARPA XAI计划的技术方法

6 XAI结果与经验教训

在该计划期间进行了三项主要评估:一项在第 1 阶段,两项在第 2 阶段。为了评估 XAI 技术的有效性,该计划的研究人员设计并执行了用户研究。用户研究仍然是评估解释的黄金标准。在 XAI 研究人员进行的用户研究中,大约有 12,700 名参与者,其中包括大约 1900 名受监督的参与者,其中个人由研究团队指导(例如亲自或在 Zoom 上)和 10800 名无监督的参与者,其中个人自我通过实验进行指导,并且没有受到研究团队(例如 Amazon Mechanical Turk)的积极指导。根据美国国防部 (DoD) 资助的所有人类受试者研究的政策,每个研究方案都由当地机构审查委员会 (IRB) 审查,然后国防部人类研究保护办公室审查方案和当地 IRB 调查结果。

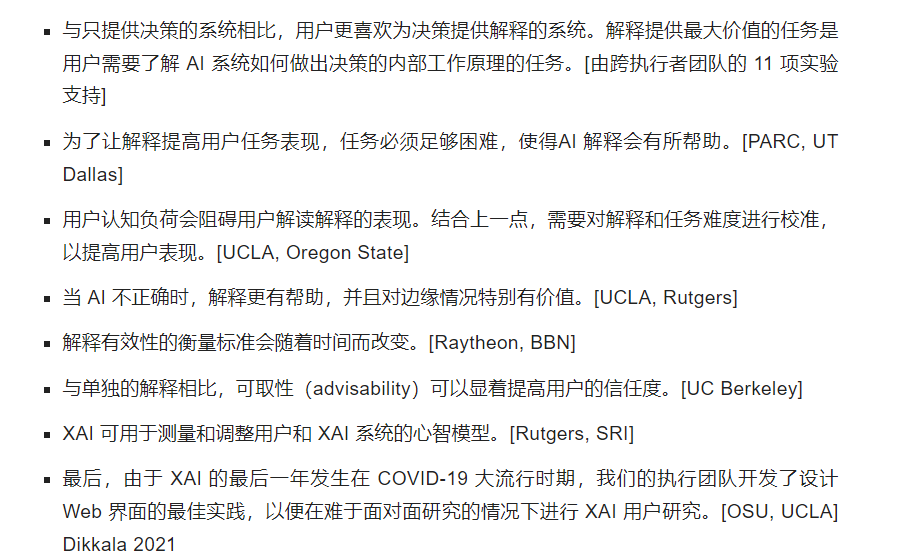

在这些用户研究过程中,确定了几个关键要:

如前所述,学习表现和可解释性之间似乎存在一种自然的矛盾关系。然而,在整个计划过程中,我们发现了可解释性可以提高性能(Kim et al. 2021, Watkins et al. 2021)。从直观的角度来看,训练系统以产生解释,通过额外的损失函数、训练数据或其他机制来提供额外的监督,以鼓励系统学习更有效的世界表征。虽然这可能并非在所有情况下都是正确的,并且在可解释的技术何时将具有更高性能时仍有大量工作要做,但它提供了希望,未来的 XAI 系统可以在满足用户解释需求的同时比当前系统具有更高的性能。

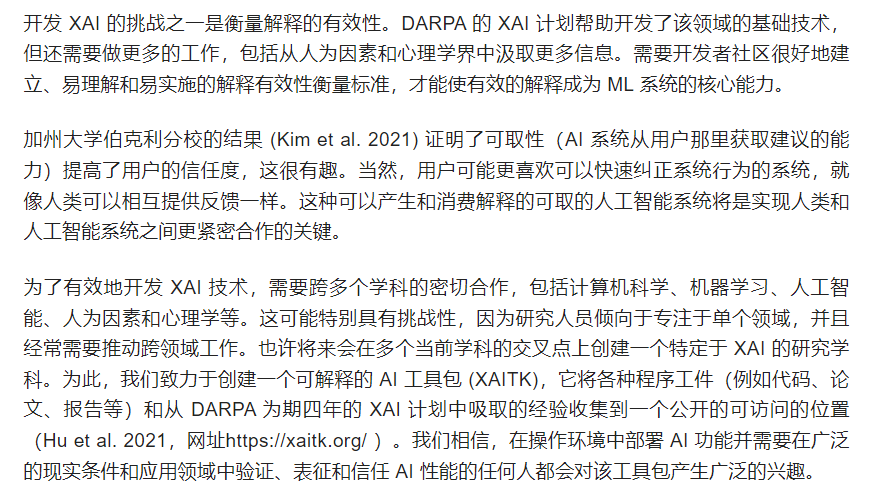

7 2021 年 DARPA 计划之后的世界状况、AI和 XAI

XAI 目前没有通用的解决方案。如前所述,不同的用户类型需要不同类型的解释。这与我们与其他人互动时所面临的没有什么不同。例如,考虑一名医生需要向其他医生、患者或医学审查委员会解释诊断。或许未来的 XAI 系统将能够自动校准并向大量用户类型中的特定用户传达解释,但这仍然远远超出了当前的技术水平。

与 2015 年相比,今天我们对 AI 的理解更加细致入微、不那么戏剧化,或许也更加准确。我们当然对深度学习的可能性和局限性有了更准确的理解。人工智能的末日已经从迫在眉睫的危险变成了遥远的好奇。同样,XAI 计划对 XAI 产生了更细致入微、不那么戏剧化、或许更准确的理解。该计划无疑起到了促进 XAI 研究(包括计划内部和外部)的作用。结果对 XAI 的使用和用户、XAI 的心理、衡量解释有效性的挑战以及产生新的 XAI ML 和 HCI 技术组合有了更细致的理解。当然还有更多工作要做,特别是随着新的人工智能技术的开发,这些技术将继续需要解释。XAI 将在一段时间内继续作为一个活跃的研究领域。作者认为,XAI 计划通过为开展这项工作奠定了基础,做出了重大贡献。

附:

“可解释人工智能”(XAI)项目背景资料

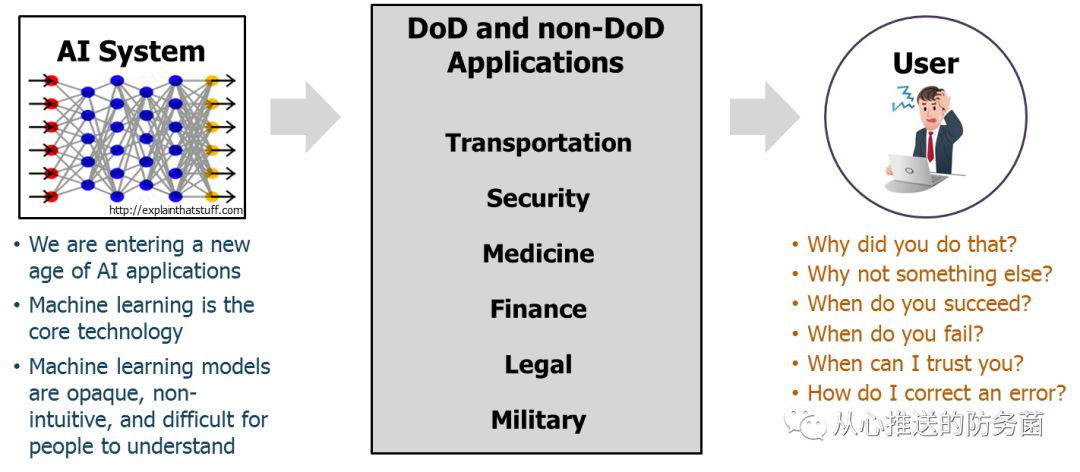

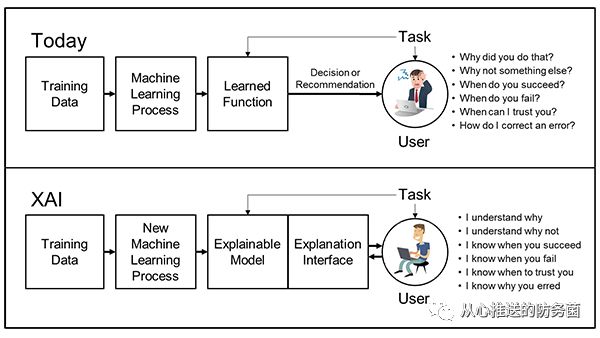

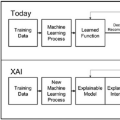

机器学习的巨大成功产生了大量人工智能(AI)应用项目。照此发展,其持续的进步有望产生能够自我感知、学习、决策和行动的自主系统。然而,这些系统的有效性受到机器当前无法向人类用户解释其决策和行动的限制(如下图)。美国国防部(DoD)面临着需要更智能、自主和共生系统的挑战。如果未来的战士能够理解,适当地信任并有效地管理新一代人工智能机器协作伙伴,那么可解释人工智能,特别是可解释的机器学习,将是必不可少的。

XAI项目需求

“可解释人工智能”(XAI)项目旨在创建一套机器学习技术:

产生更多可解释的模型,同时保持高水平的学习成绩(预测准确性);

使人类用户能够理解,适当地信任并有效地管理新一代人工智能合作伙伴。

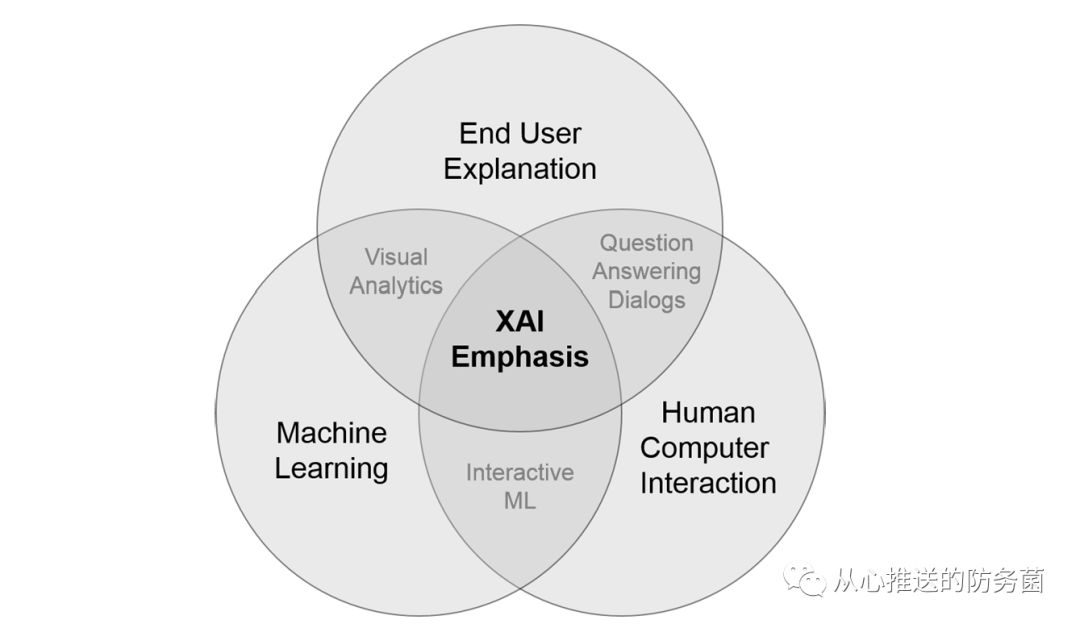

XAI项目强调区域

新的机器学习系统将能够解释它们的基本原理,表征它们的优点和缺点,并传达对它们将来如何表现的理解。实现该目标的策略是开发新的或改进机器学习技术,以产生更多可解释的模型。这些模型将结合最先进的人机界面技术,能够将模型转化为最终用户可理解和有用的解释对话(如下图)。DARPA研究团队的策略是采用各种技术,以生成一系列方法,为未来的开发人员提供一系列涵盖性能与可解释性交易空间的设计方案。

XAI项目概念

XAI项目是当前DARPA正在推行的AI项目之一,旨在实现“第三波AI系统”,其中机器了解其运行的环境和环境,并随着时间的推移构建底层解释模型,使其能够表征现实世界现象。

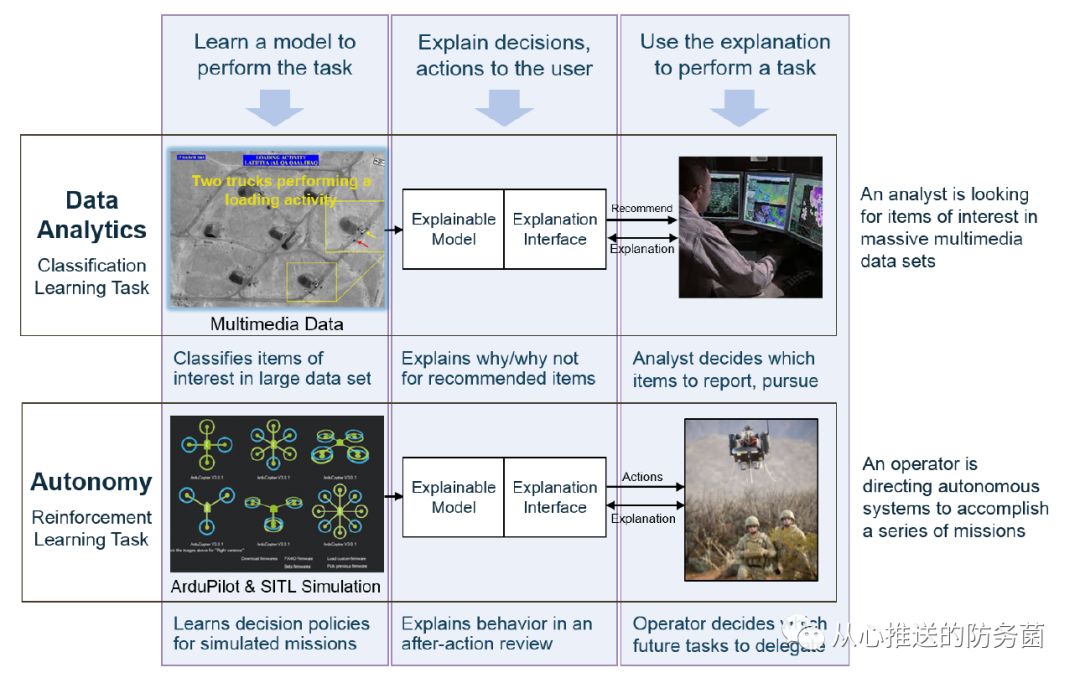

XAI项目通过解决两个技术领域的挑战问题,专注于多系统的开发:

(1)机器学习问题,用于对异构、多媒体数据中感兴趣的事件进行分类;

(2)机器学习问题,为自主系统构建决策策略,以执行各种模拟任务。

XAI项目挑战问题领域

这两个挑战问题领域被选择来代表两个重要的机器学习方法(分类和强化学习)和两个重要的国防部操作问题领域(情报分析和自主系统)的交叉点。

XAI项目结构

此外,研究人员正在研究解释心理学。

XAI研究原型在整个项目过程中经过测试和持续评估。在2018年5月,XAI研究人员展示了他们可解释学习系统的初步实施,并展示了他们的第一阶段评估的初步试点研究结果。随后在2018年11月进行全阶段1系统评估。

机器学习的巨大成功导致了AI应用的新浪潮(例如,交通、安全、医疗、金融、国防),这些应用提供了巨大的好处,但无法向人类用户解释它们的决定和行动。DARPA的可解释人工智能(XAI)项目致力于创建人工智能系统,其学习的模型和决策可以被最终用户理解并适当信任。实现这一目标需要学习更多可解释的模型、设计有效的解释界面和理解有效解释的心理要求的方法。XAI开发团队正在通过创建ML技术和开发原理、策略和人机交互技术来解决前两个挑战,以生成有效的解释。XAI的另一个团队正在通过总结、扩展和应用心理解释理论来解决第三个挑战,以帮助XAI评估人员定义一个合适的评估框架,开发团队将使用这个框架来测试他们的系统。XAI团队于2018年5月完成了第一个为期4年的项目。在一系列正在进行的评估中,开发人员团队正在评估他们的XAM系统的解释在多大程度上改善了用户理解、用户信任和用户任务性能。

(中文版)专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“XAI4” 就可以获取《美国DARPA「可解释人工智能」(XAI计划)的4年回顾与经验总结,附中英文版》专知下载链接