【NeurIPS2020】可靠图神经网络鲁棒聚合

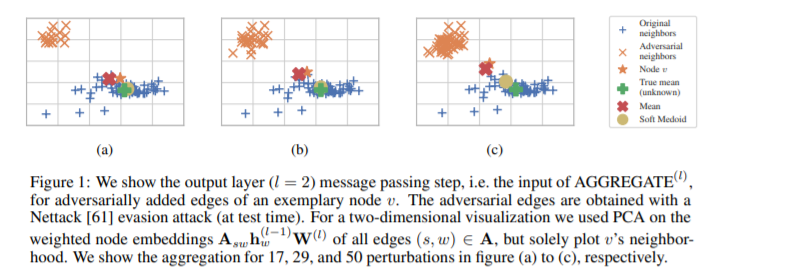

以图结构为目标的扰动已被证明在降低图神经网络(GNNs)性能方面非常有效,而传统的防御手段如对抗性训练似乎不能提高鲁棒性。这项工作的动机是观察到,反向注入的边缘有效地可以视为一个节点的邻域聚集函数的额外样本,这导致扭曲的聚集在层上累积。传统的GNN聚合函数,如总和或平均值,可以被一个单独的离群值任意扭曲。在鲁棒统计领域的启发下,我们提出了一个鲁棒聚合函数。我们的方法显示了0.5的最大可能分解点,这意味着只要节点的对抗边的比例小于50\%,聚合的偏差就有界。我们的新聚合函数,软Medoid,是Medoid的一个完全可微的泛化,因此很适合端到端深度学习。在Cora ML上配置聚合的GNN,可将结构扰动的鲁棒性提高3倍(Citeseer上提高5.5倍),对于低度节点,可提高8倍。

https://www.zhuanzhi.ai/paper/bfaf03d61ecd8da51a764adfcffbc173

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“GNNRA” 可以获取《【NeurIPS2020】可靠图神经网络鲁棒聚合》专知下载链接索引

登录查看更多