点击上方“CVer”,选择加"星标"或“置顶”

重磅干货,第一时间送达![]()

前言

近期 CVer 一直在更新 CVPR 2020 论文开源项目系列,此系列的重点是:CVPR 2020 + 开源。之前已陆续分享了三篇文章,分别是目标检测、语义分割和目标跟踪三大方向,详见:

本文篇幅较长,推荐直接拉到文末,一键收藏,然后再看!

大家反映很喜欢这个系列,经常催更,这次终于整理好CV另一大方向:目标跟踪的part。喜欢的同学可以给个在看,也欢迎向文末CVer小助手催更你想要方向。

这里的论文开源项目,其实是指提供了代码链接的论文。也就是含coming soon的情况,因为没法深究这类论文究竟什么时候开源。

1. PolarMask: 一阶段实例分割新思路

![]()

作者团队:港大(谢恩泽&罗平)&西安交大&商汤&南大&阿德莱德大学(沈春华)等

论文链接:

https://arxiv.org/abs/1909.13226

代码链接:https://github.com/xieenze/PolarMask

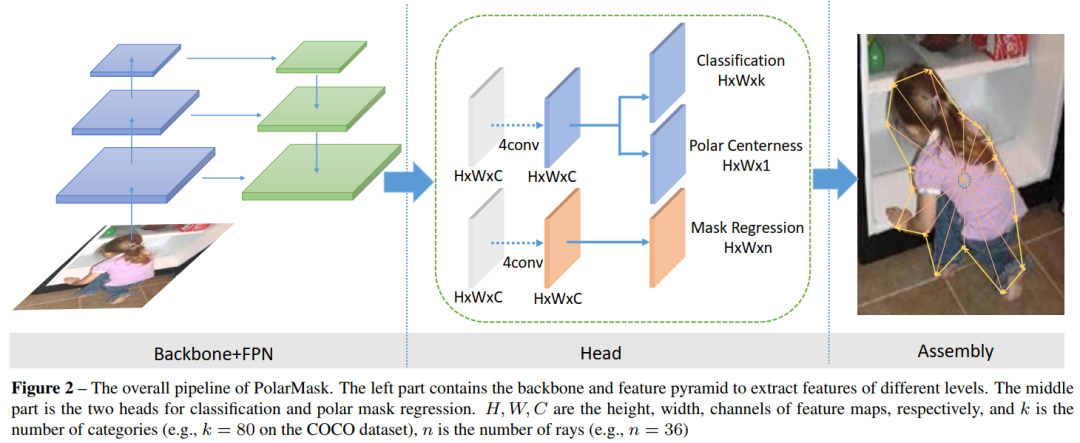

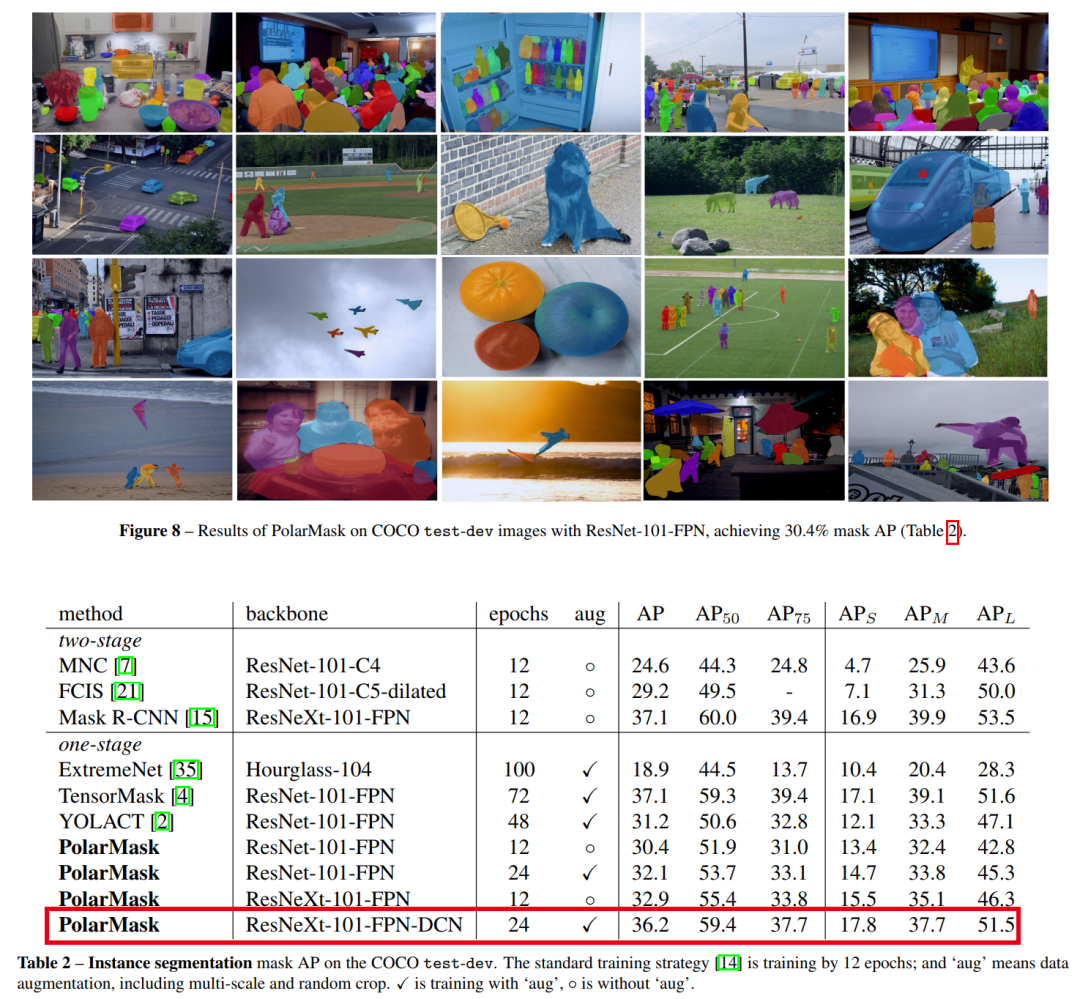

注:PolarMask基于FCOS,把实例分割统一到了FCN的框架下。

![]()

![]()

2. CenterMask:实时Anchor-Free实例分割

![]()

论文链接:

https://arxiv.org/abs/1911.06667

代码链接:https://github.com/youngwanLEE/CenterMask

注1:今年CVPR 2020上有两篇同名CenterMask,其中一篇是这个,另一篇是来自美团,因为没有看到美团的CenterMask开源项目,故本文不进行介绍。

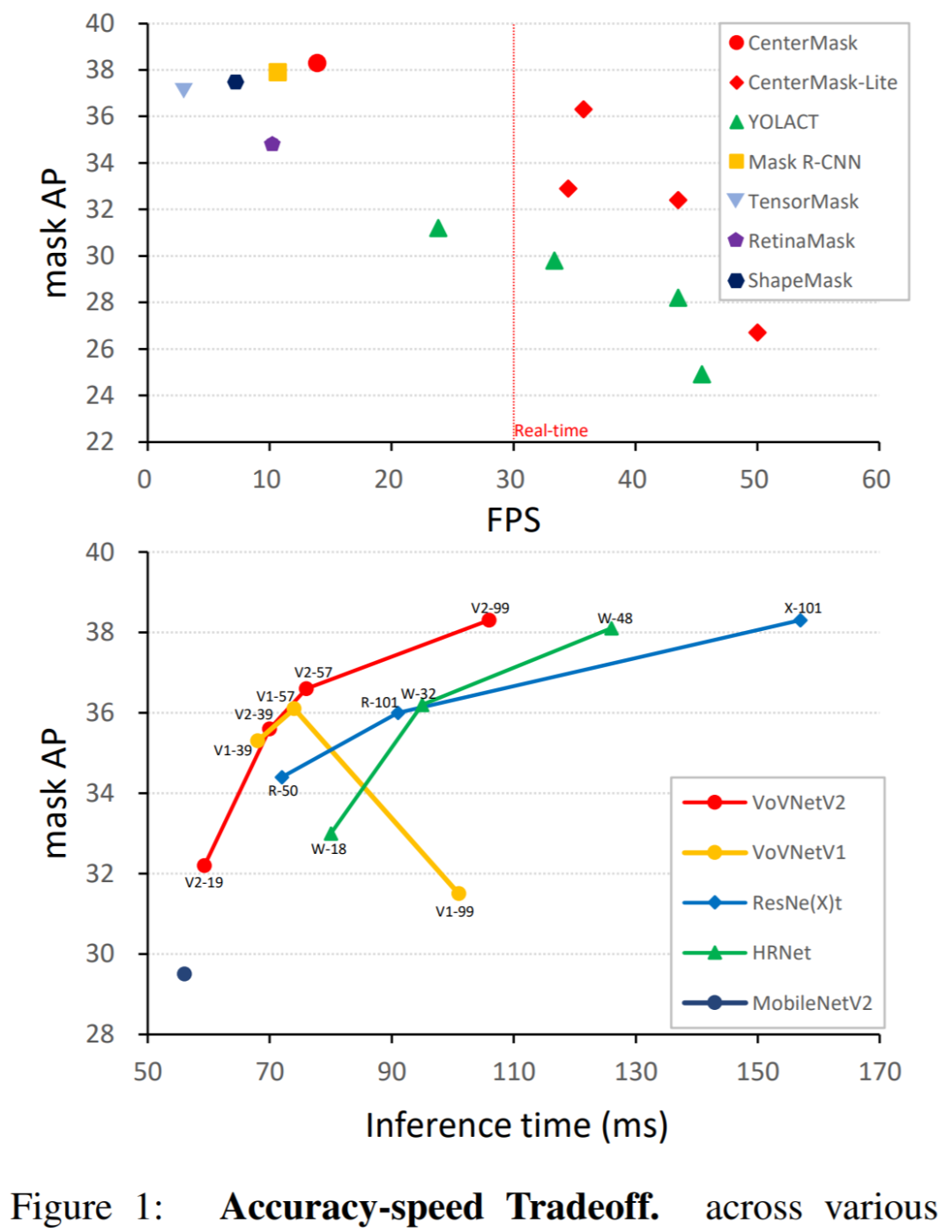

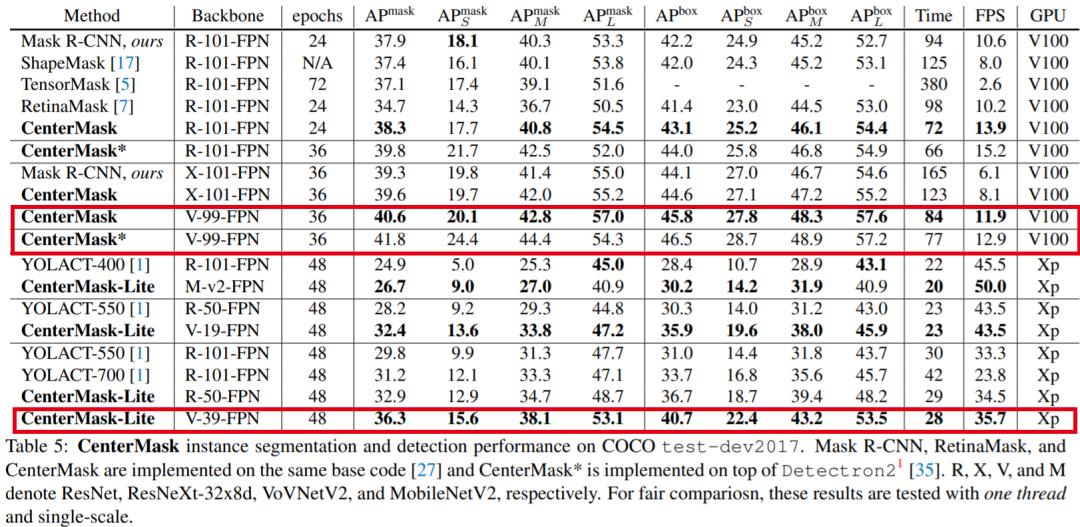

注2:CenterMask性能优于 TensorMask、RetinaMask;CenterMask-Lite优于YOLACT,速度高达50FPS!现已开源!

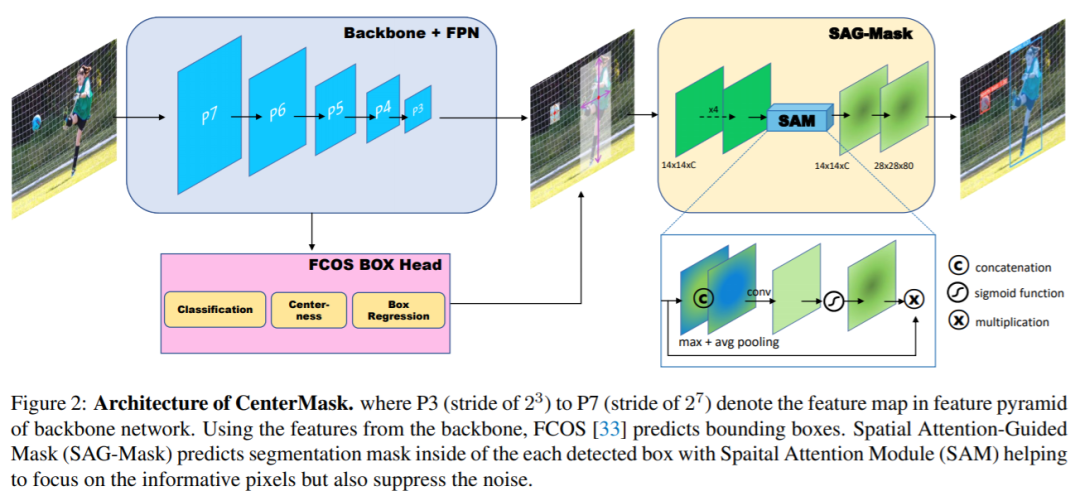

本文提出了一个简单而有效的anchor-free实例分割网络,称为CenterMask,它使用Mask R-CNN在同一vein中向anchor-free one stage目标检测器(FCOS)添加了一个新的空间注意力map(SAG-Mask)分支。插入FCOS目标检测器后,SAG-Mask分支将使用空间注意力map预测每个box上的分割mask,以帮助关注像素信息并抑制噪声。

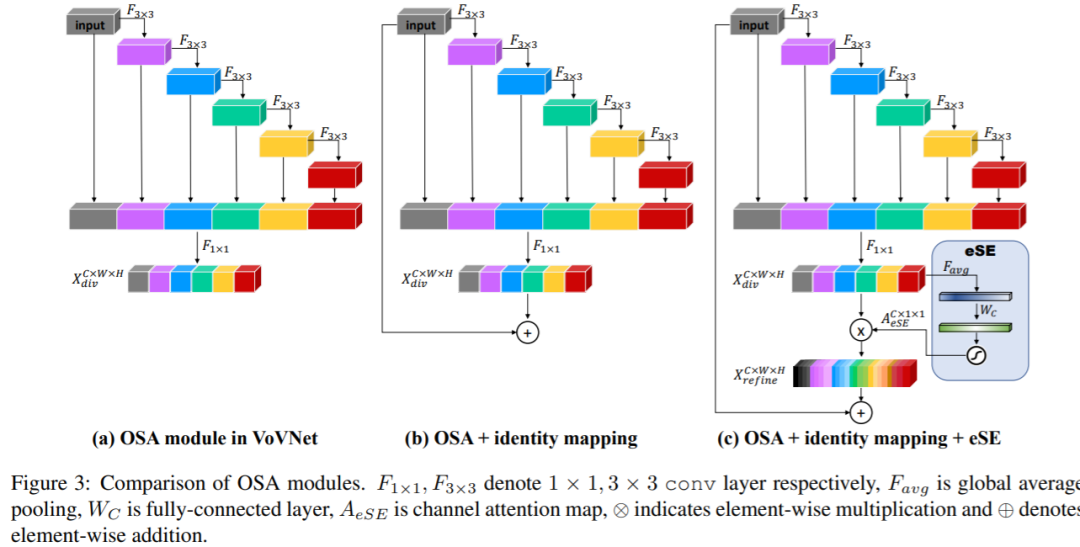

我们还提出了一种改进的

VoVNetV2

,它具有两种有效的策略:添加(1)残差连接以解决VoVNet的饱和问题,以及(2)有效的Squeeze-Excitation(eSE)处理原始SE的信息丢失问题。借助SAG-Mask和VoVNetV2,我们分别设计了针对大型模型和小型模型的CenterMask和CenterMask-Lite。 CenterMask以更快的速度超越了所有以前的最新模型。CenterMask-Lite还实现了33.4%的mask AP / 38.0%的box AP,在Titan Xp上以超过35 FPS的速度分别比最新技术提高了2.6 / 7.0 AP增益。我们希望CenterMask和VoVNetV2可以分别作为用于各种视觉任务的实时实例分割和骨干网络的坚实基准。

![]()

![]()

![]()

![]()

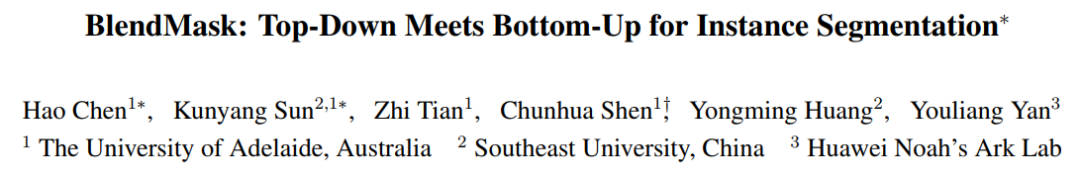

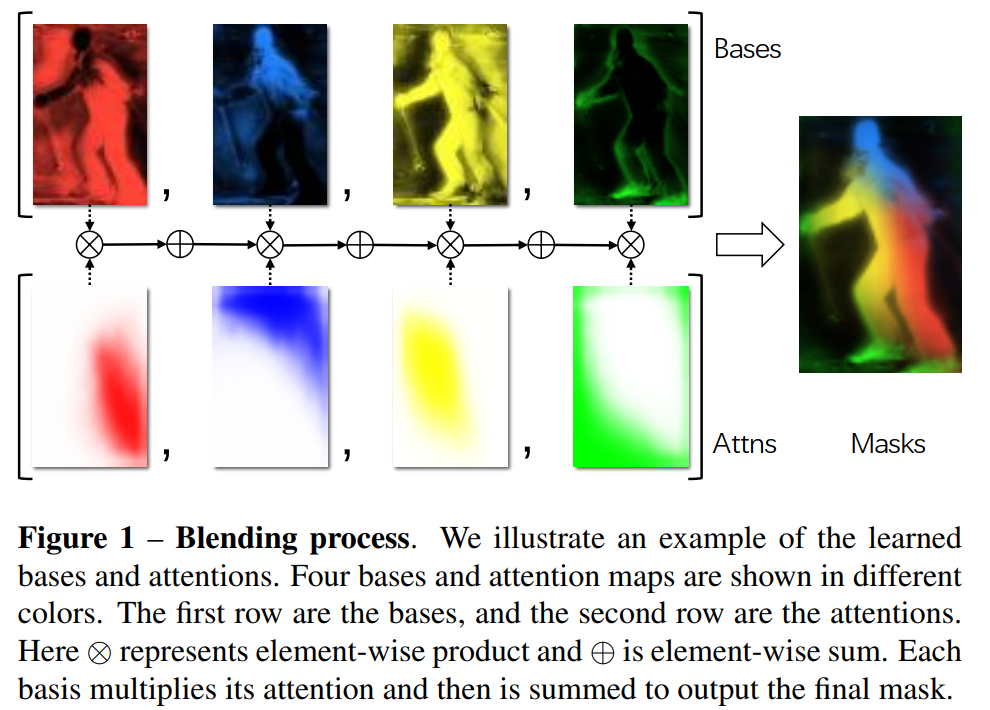

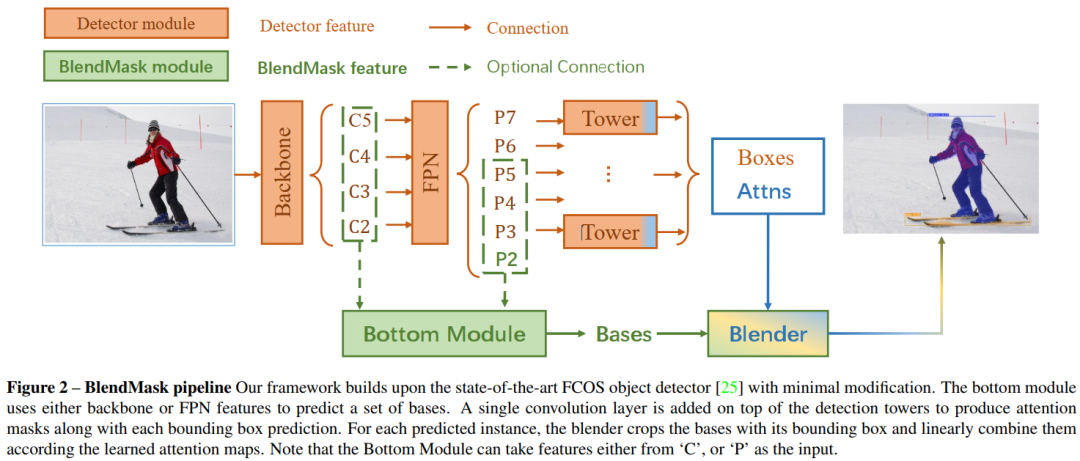

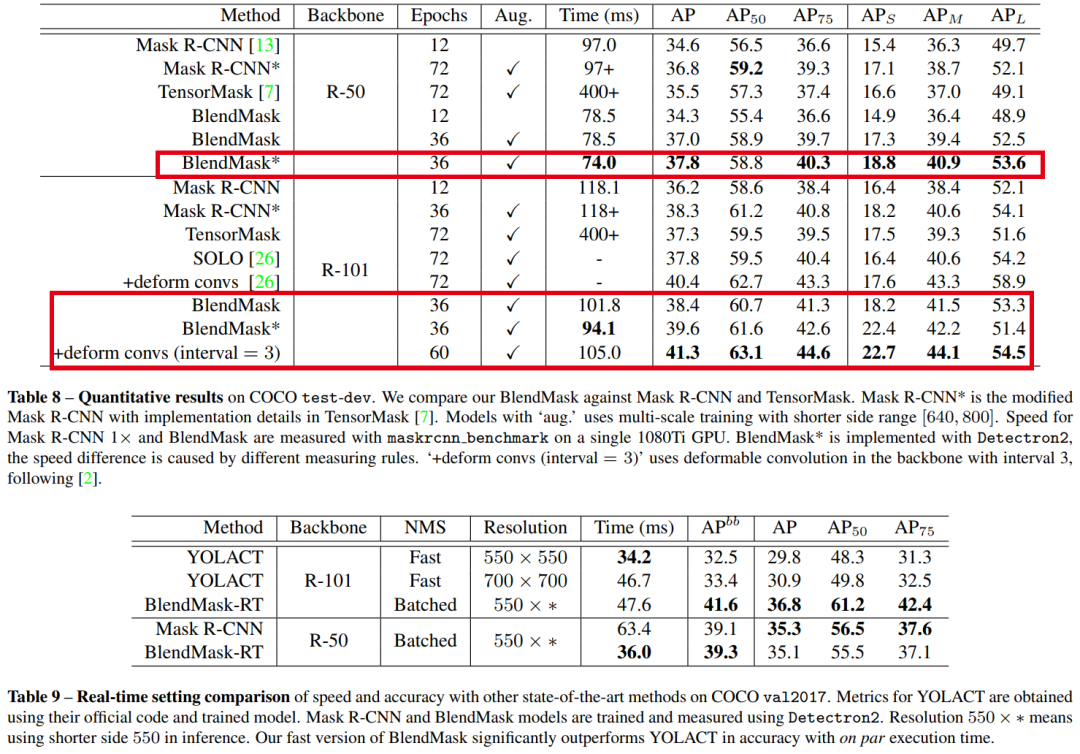

3. BlendMask: Top-Down Meets Bottom-Up for Instance Segmentation

![]()

作者团队:阿德莱德大学(陈昊&沈春华等)&东南大学&华为诺亚实验室

论文链接:

https://arxiv.org/abs/2001.00309

代码链接:https://github.com/aim-uofa/AdelaiDet

注:BlendMask实例分割新网络在COCO上,性能可达34.2mAP/25FPS!性能优于TensorMask、SOLO和Mask R-CNN等网络,其轻量级版本与YOLACT各有优点

论文解读:沈春华团队提出:BlendMask实例分割新网络,实时又SOTA

![]()

![]()

![]()

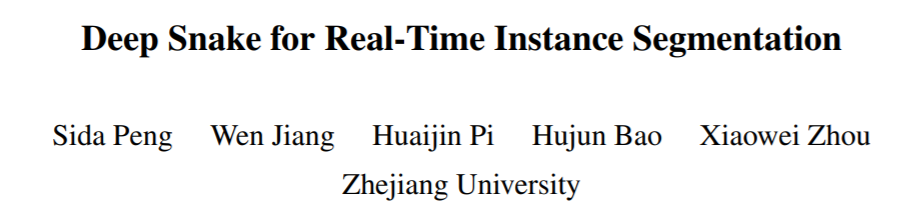

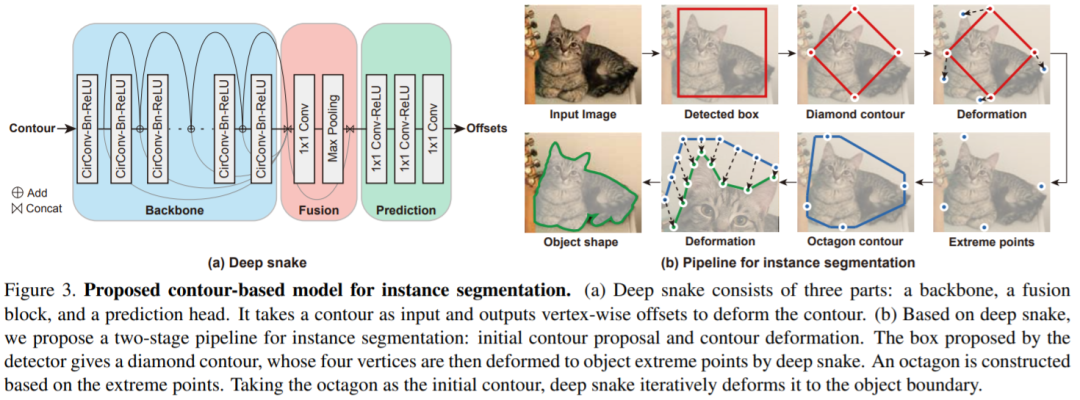

4. Deep Snake:用于实时实例分割

![]()

论文链接:

https://arxiv.org/abs/2001.01629

代码链接:https://github.com/zju3dv/snake

注:Deep Snake在1080Ti上的512×512图像的分割速度可达32.3 FPS!性能优于Mask R-CNN、PANet和PolygonRNN++等

本文介绍了一种新颖的基于轮廓的方法,称为Deep Snake,用于实时实例分割。与某些直接从图像中回归目标边界点的坐标的最新方法不同,Deep Snake使用神经网络将初始轮廓迭代变形为目标边界,从而通过基于学习的方法实现了snake算法的经典思想。对于轮廓上的结构化特征学习,我们建议在deep snake中使用圆形卷积,与通用图卷积相比,它可以更好地利用轮廓的循环图结构。在deep snake的基础上,我们开发了一个两阶段的pipeline用于实例分割:初始轮廓proposal和轮廓变形,可以处理初始目标定位中的错误。实验表明,该方法在Cityscapes,Kins和Sbd数据集上具有最先进的性能,同时对于1080Ti GPU上的512×512图像的实时实例分割效率高达32.3 FPS。

论文解读:CVPR2020 | Deep Snake:基于轮廓调整的实时实例分割方法,速度32.3FPS!

![]()

![]()

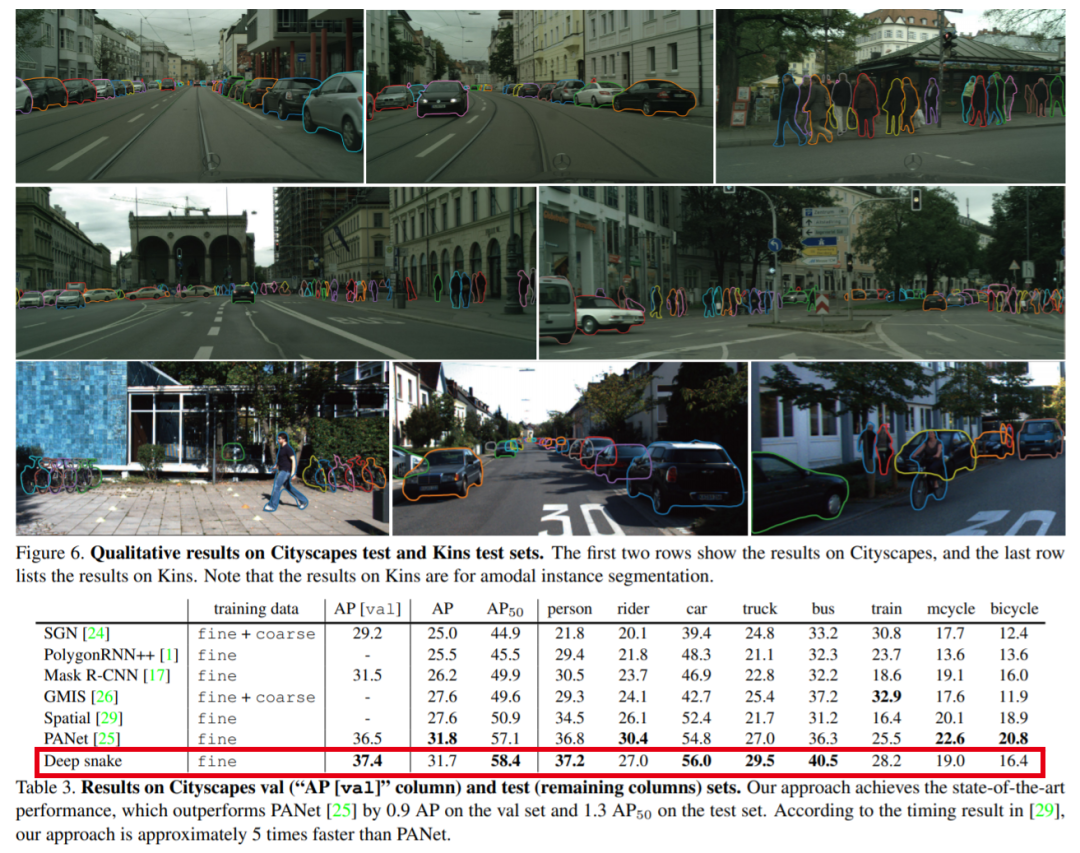

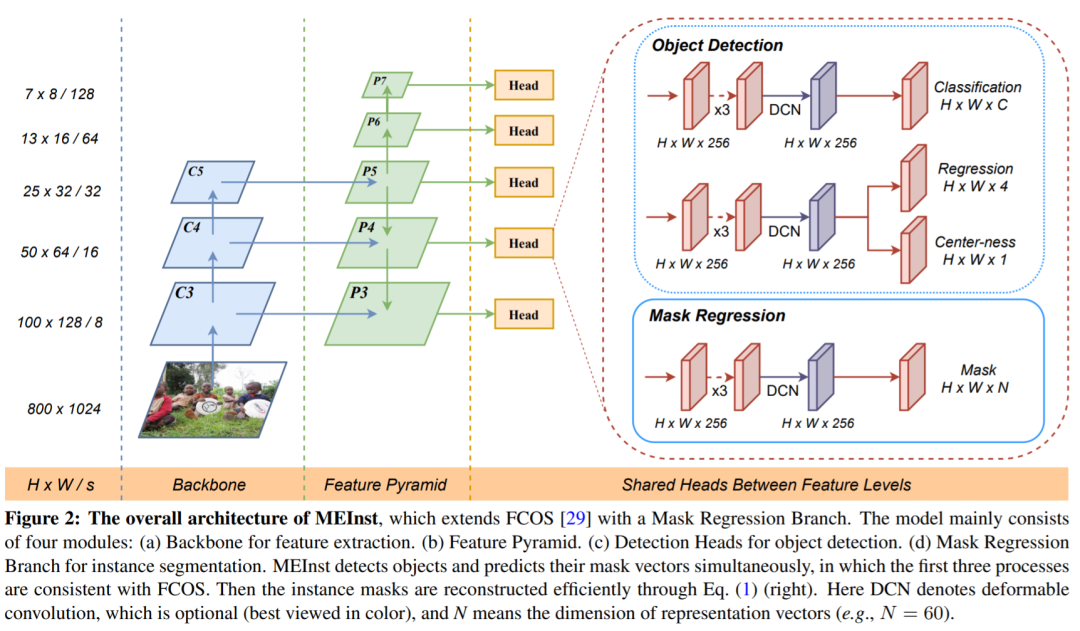

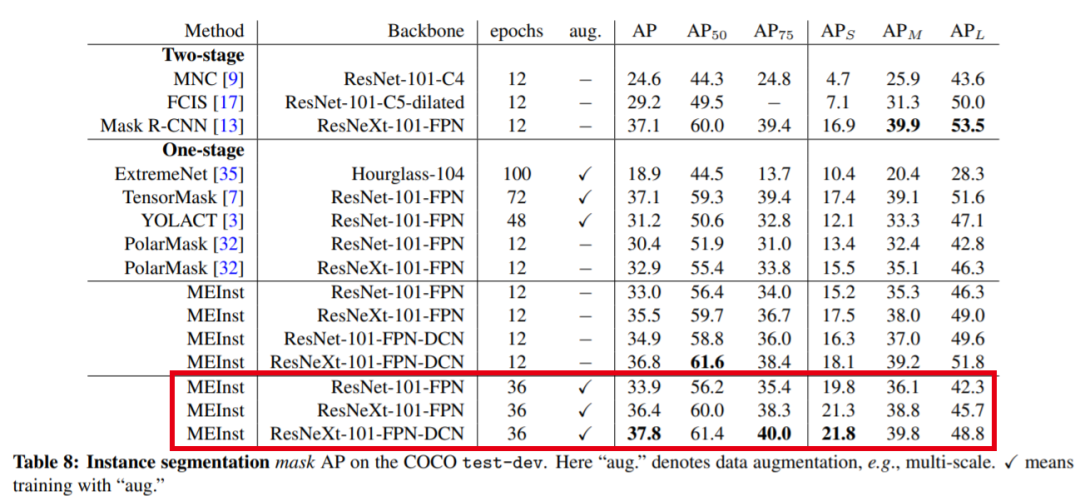

5. MEInst:Single Shot实例分割的Mask编码

![]()

作者团队:同济大学&阿德莱德大学(沈春华等)&华为诺亚

论文链接:

https://arxiv.org/abs/2003.11712

代码链接:

https://github.com/aim-uofa/AdelaiDet

注:性能优于PolarMask、YOLACT和TensorMask等网络

迄今为止,由Mask R-CNN率先采用的两阶段方法主导了实例分割。相比之下,one-stage 方案在mask AP中无法与Mask R-CNN竞争,这主要是由于难以紧凑地表征mask,使得one-stage方法的设计非常具有挑战性。在这项工作中,我们提出了一个简单的singleshot实例分割框架,称为基于mask编码的实例分割(MEInst)。 MEInst不是直接预测二维mask,而是将其提炼为紧凑且固定的维数表示向量,从而使实例分割任务可以合并到一级边界框检测器中,从而形成一个简单而有效的实例分割框架。提出的单阶段MEInst通过单模型(ResNeXt-101-FPN主干)和基于MS-COCO基准的单规模测试,可实现36.4%的mask AP。我们证明,更简单,更灵活的一阶段实例分割方法也可以实现竞争性能。该框架可以轻松地适用于其他实例级识别任务。

![]()

![]()

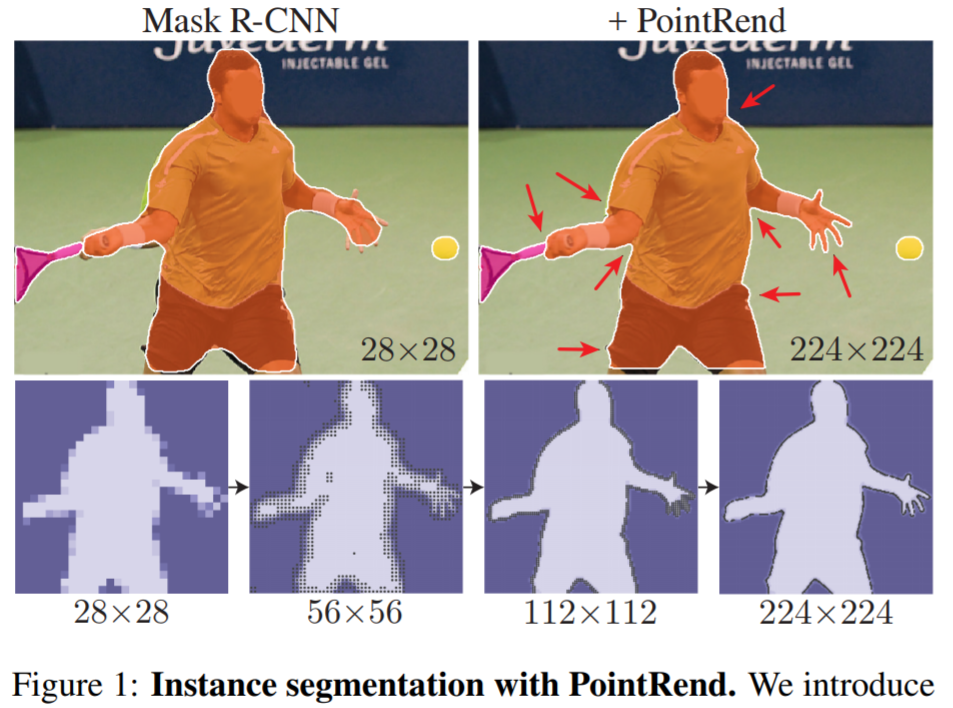

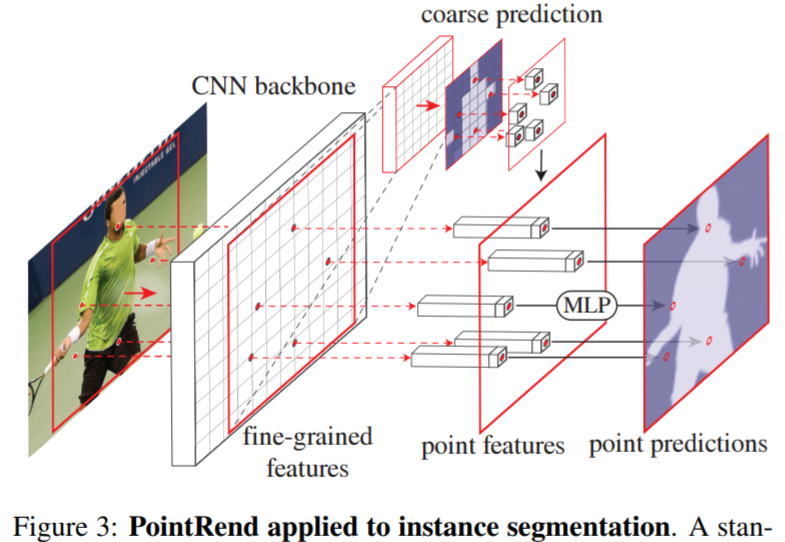

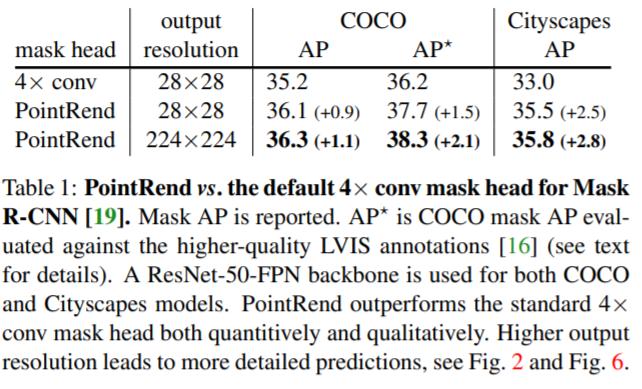

6. PointRend:将图像分割视为渲染(Rendering)

![]()

作者团队:FAIR(Alexander Kirillov/吴育昕/何恺明/RossGirshick)

论文链接:

https://arxiv.org/abs/1912.08193

https://github.com/facebookresearch/detectron2/tree/master/projects/PointRend

注:上述论文其实是按时间来介绍,而这里特意把

PointRend放最后,因为其不仅用于实例分割,同时对语义分割也有性能提升。比如对实例分割的Mask R-CNN有性能提升,同时对语义分割的DeepLabV3、SemanticFPN也有性能提升。

![]()

![]()

![]()

上述6篇论文的PDF和代码链接已经打包好,在CVer公众号后台回复:0512,即可下载。另外想第一时间知道更多论文的开源动态,欢迎加文末的CVer小助手微信,其朋友圈每天会推送最新论文和开源项目。整理不易,欢迎在文末点个

在看

,支持一下!

重磅!CVer-图像分割 微信交流群已成立

扫码添加CVer助手,可申请加入CVer-图像分割 微信交流群,目前已汇集1300人!涵盖语义分割、实例分割和全景分割等。互相交流,一起进步!

同时也可申请加入CVer大群和细分方向技术群,细分方向已涵盖:目标检测、图像分割、目标跟踪、人脸检测&识别、OCR、姿态估计、超分辨率、SLAM、医疗影像、Re-ID、GAN、NAS、深度估计、自动驾驶、强化学习、车道线检测、模型剪枝&压缩、去噪、去雾、去雨、风格迁移、遥感图像、行为识别、视频理解、图像融合、图像检索、论文投稿&交流、TensorFlow和PyTorch等群。

一定要备注:研究方向+地点+学校/公司+昵称(如图像分割+上海+上交+卡卡),根据格式备注,可更快被通过且邀请进群

![]()

▲长按加群

![]()

▲长按关注我们

请给CVer一个在看!![]()