斯坦福大学新研究:询问愚蠢问题,AI能变聪明

机器之心报道

身处社会环境中的 AI 智能体,也能从人类互动中进行学习了。

如果有人给你看一张鳄鱼的照片并问它是不是一只鸟,你可能会不禁一笑,感觉这是在恶作剧。现实当中,这种互动看起来很愚蠢,但在 AI 领域,有研究表明,这种互动可能是帮助人工智能学习的关键,能够极大地提高人工智能解读新图像的准确率。

现阶段,许多 AI 系统依靠一种称为机器学习的蛮力方法才变得智能,一般来说它们在海量的数据中找到模式然后进行预测,例如,AI 系统在分析完数千张家具图片后识别出椅子这一类别。

训练 AI 的方法类似于将 AI 单独锁在有一堆书的房间里。在大量手动标记的训练数据或抓取的网络内容的支持下,机器学习在许多任务(从医疗保健到可持续性发展)中取得了快速进展。但是如果数据中缺少某个概念时,AI 是无法自己得到它:将 AI 的知识源限制在房间里的书上会阻止 AI 学习房间里没有的其它概念。更糟糕的是这些方法使 AI 僵化,无法适应环境的持续变化或人类不断变化的需求。虽然训练好的 AI 通常在测试集上会展示强大的性能,但在面对新情况或部署到现实世界中时,可能会遇到困难。

为了帮助 AI 扩展它们对世界的理解,研究人员正试图开发一种方法,让计算机程序既能定位它们的知识空白,还能通过询问如:「水槽是什么形状的?」等愚蠢的问题,以获得答案的方式进行学习。这有点像孩子问父母为什么天是蓝的。

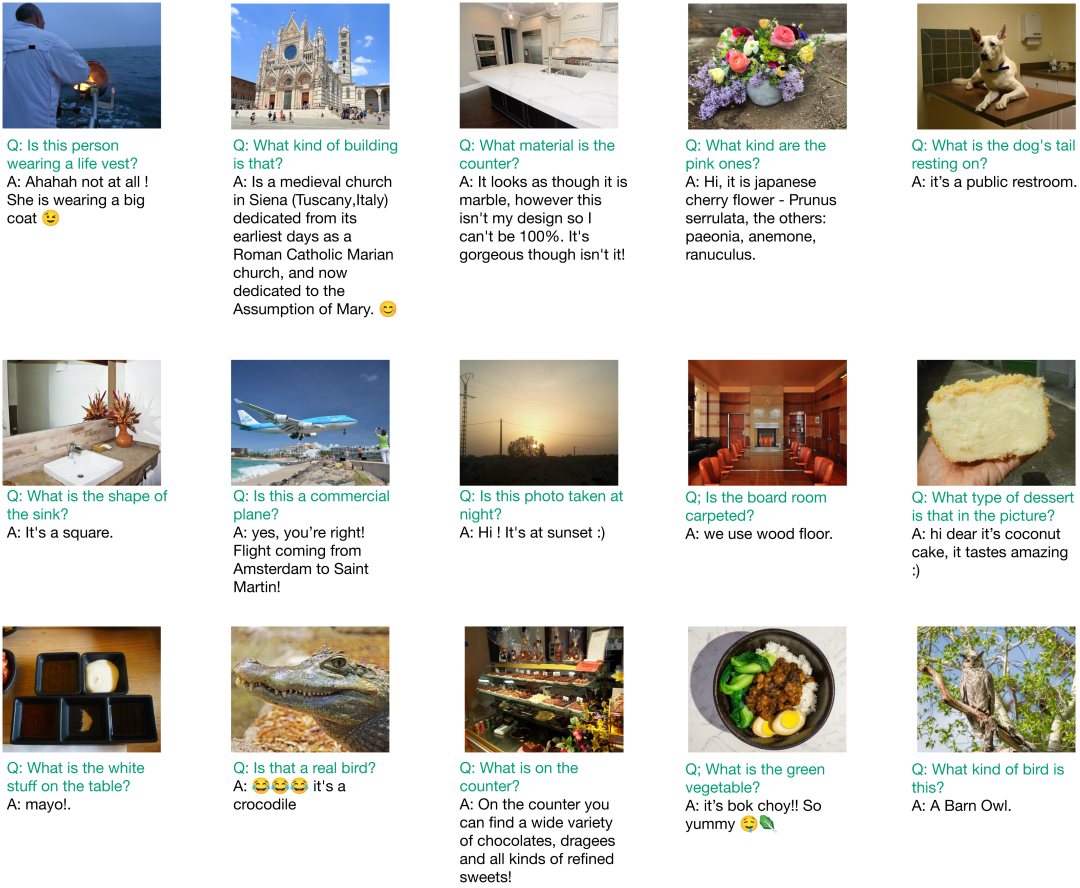

Q:图片中的甜点是什么?答这是椰子蛋糕,味道棒极了。

本文中,来自斯坦福大学等机构的研究者提出一种形式化的方法,使 AI 能够通过与现实社会情景中的人类进行持续互动来学习,从而突破信息茧房。这种方法称为社会情境人工智能,并通过现场实验提供证据,证明它可以让 AI 智能体通过学习如何与人互动来学习其初始训练数据中从未出现过的新概念。这个方法是受人类成长过程的启发,这是一个以社交为中介的过程,在这个过程中,儿童通过与知识渊博的成人进行好奇的对话,获得新概念和新文化。社交环境下的人工智能对于实现许多有益的应用至关重要,尤其是在这些应用中,有效的人机交互对于提高 AI 智能体的理解和行动能力至关重要,包括人机交互、交互式机器人、个性化会话智能体和无障碍技术。

论文地址:https://www.pnas.org/doi/epdf/10.1073/pnas.2115730119

为实现社交型人工智能,智能体不仅必须收集数据以学习新概念,还必须学习如何与人交互以收集数据。在任何特定时刻,智能体必须在互动学习和学习互动这两个双重目标之间进行权衡。任务变得更具挑战性,因为智能体要学习的可能交互空间很大,有效的社交交互空间是可能交互的稀疏子集,信息交互空间随着智能体的学习而不断变化。强化学习将可能的互动形式化为行动空间,将反馈形式化为奖励,需要数亿次互动才能揭示这一信息和社会互动的子空间;通常人们会在智能体跨过门槛之前就放弃。由于这一限制,迄今为止,从人类交互中学习的方法仅在手动人类标签或小的行动空间(如游戏和模拟)中取得成功。

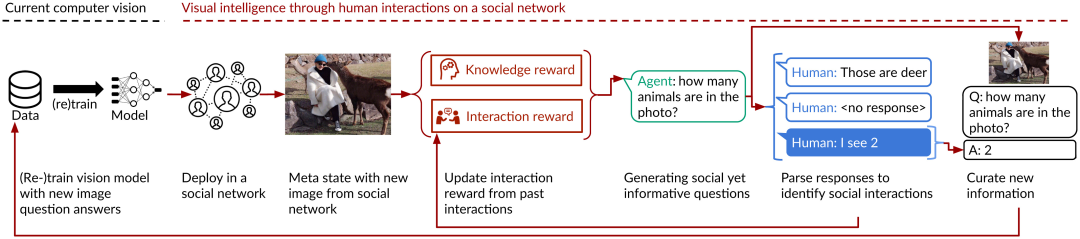

为克服这些挑战,本文引入一种社会情境人工智能的形式化,将其作为迭代强化学习问题,在这个问题中,智能体通过与人们社会环境进行交互来改善底层模型,在这种环境中,人可能会、也可能不会做出信息响应。只有当响应包含对智能体有用的新信息时才有用。智能体必须选择能够引出对模型有用的新概念的社会交互。本文的公式采用知识奖励来引导智能体进行互动,从而发现新的概念,并采用互动奖励来指导智能体进行符合环境中社会规范的互动。从这些交互中收集新的概念,这些概念用作更新模型的训练数据。随着模型在这些概念上的改进,智能体将更新其策略,并开始学习如何询问人们感兴趣但模型性能仍然较差的新概念问题。学习相关社会规范、改进底层模型和更新交互策略的过程贯穿于智能体的整个生命周期。

通过一个大规模的现场实验来探索与社会情境学习相关的挑战:本文在某大型照片共享社交网络上部署一个 AI 智能体学习新的视觉概念,这是一项具有挑战性的任务,之前的模型被评判为有限、脆弱,并且容易出问题。本文的智能体通过在社交媒体上发布自然语言问题作为评论来与人们互动(图 1 和图 2)。在实验中,本文将智能体与只关注知识奖励(传统主动学习)或只关注互动奖励的消融进行比较。

图 1:无论如何全面地管理数据集,AI 模型部署都不可避免地会遇到以前从未见过的情况,从而限制了它们在现实世界中的实用性。本文引入了一个社会情境人工智能框架,这是一个强化学习框架,使智能体能够发现与人进行的有用的社会互动,从而发现新信息。利用这个模式,本文设计了原型来展示视觉智能任务的社会情境学习的可能性。本文设计的智能体通过询问人们在社交媒体上上传的图片来学习视觉概念。它将人们对智能体的反应分解为两个奖励,这两个奖励引导智能体进行更适合的交互,并为其基础模型提供信息。

图 2:本文的智能体在社交媒体上与人们发起的 236000 次互动,显示其问题和回答的多样性。一些问题验证了概念,而另一些问题则询问诸如建筑物类型或对象材质等属性。答案在长度和词汇上差异很大。虽然有些人直接回答了问题,例如这是一个正方形,但其他人提供了很多背景信息。一些回答还通过使用表情符号、感叹号或诸如嗨,亲爱的之类的短语来表达积极的情绪。每个问题前面都有一个自我介绍:我们是一个计算机科学研究项目。为了保护隐私,所展示的照片都是在创意共享许可下,并且在视觉和语义上都与用户在社交媒体上上传的照片相似。

通过 8 个月的部署,本文的智能体与 236000 名社交媒体用户交互,智能体在识别新视觉信息方面的性能提高了 112%。对照实验表明,本文设计的智能体比主动学习基线高 25.6%。这项工作为不断改进 AI 智能体提供了机会,使其更好地遵循开放社会环境中的规范。