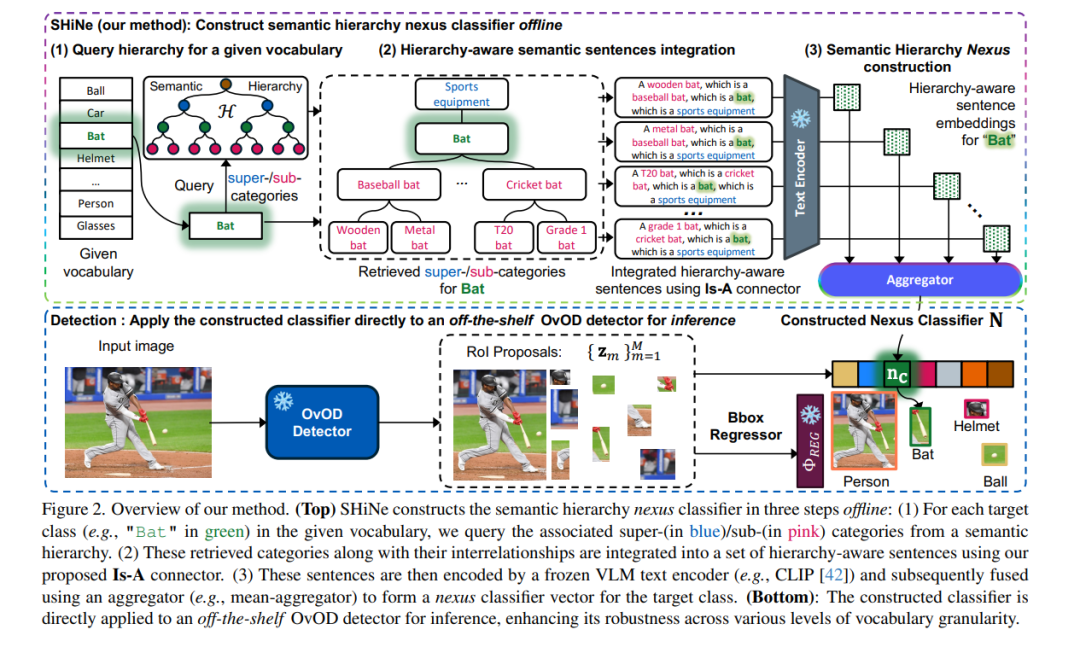

开放词汇目标检测(OvOD)将检测转变为一个由语言引导的任务,使用户能够在推理过程中自由定义他们感兴趣的类别词汇。然而,我们的初步研究表明,现有的OvOD检测器在处理不同语义粒度的词汇时表现出显著的差异性,这对实际应用提出了挑战。为此,我们引入了语义层次枢纽(Semantic Hierarchy Nexus,SHiNe),这是一种利用类层次语义知识的新型分类器。它通过三个步骤离线运行: i) 从层次结构中检索每个目标类别的相关上位/下位类别; ii) 将这些类别整合成层次感知句子; iii) 融合这些句子嵌入生成枢纽分类器向量。我们在各种检测基准上的评估表明,SHiNe增强了跨不同词汇粒度的鲁棒性,在使用真实层次结构时实现了高达+31.9%的mAP50提升,同时在使用大语言模型生成的层次结构时也保持了改进。此外,应用于ImageNet-1k的开放词汇分类时,SHiNe将CLIP零样本基线提升了+2.8%的准确率。SHiNe无需训练,可以无缝集成到任何现成的OvOD检测器中,并且在推理过程中不会增加额外的计算开销。代码是开源的。 https://arxiv.org/abs/2405.10053

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日