这本书提供了使“机器学习”系统更可解释的最新概念和可用的技术的全面介绍。本文提出的方法几乎可以应用于所有当前的“机器学习”模型: 线性和逻辑回归、深度学习神经网络、自然语言处理和图像识别等。

机器学习(Machine Learning)的进展正在增加使用人工代理来执行以前由人类处理的关键任务(医疗、法律和金融等)。虽然指导这些代理设计的原则是可以理解的,但目前大多数深度学习模型对人类的理解是“不透明的”。《Python可解释人工智能》通过从理论和实践的角度,填补了目前关于这一新兴主题的文献空白,使读者能够快速使用可解释人工智能的工具和代码。

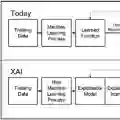

本书以可解释AI (XAI)是什么以及为什么在该领域需要它为例开始,详细介绍了根据特定背景和需要使用XAI的不同方法。然后介绍利用Python的具体示例对可解释模型的实际操作,展示如何解释内在的可解释模型以及如何产生“人类可理解的”解释。XAI的模型不可知方法可以在不依赖于“不透明”的ML模型内部的情况下产生解释。使用计算机视觉的例子,作者然后着眼于可解释的模型的深度学习和未来的展望方法。从实践的角度,作者演示了如何在科学中有效地使用ML和XAI。最后一章解释了对抗性机器学习以及如何使用对抗性例子来做XAI。

成为VIP会员查看完整内容

相关内容

Arxiv

0+阅读 · 2021年7月5日