AI如何促进态势感知?2022美国空军AFRL等「态势感知」万字综述论文,24也pdf阐述智能战场态势感知技术、挑战和前景

【智能战场态势感知】2022美国空军AFRL最新综述论文23页:「态势感知」技术、挑战和前景

【作 者】

Arslan Munir:堪萨斯州立大学计算机科学系

Alexander Aved :美国空军研究实验室 (AFRL)

Erik Blasch:AFRL 空军科学研究办公室 (AFOSR)

【摘 要】

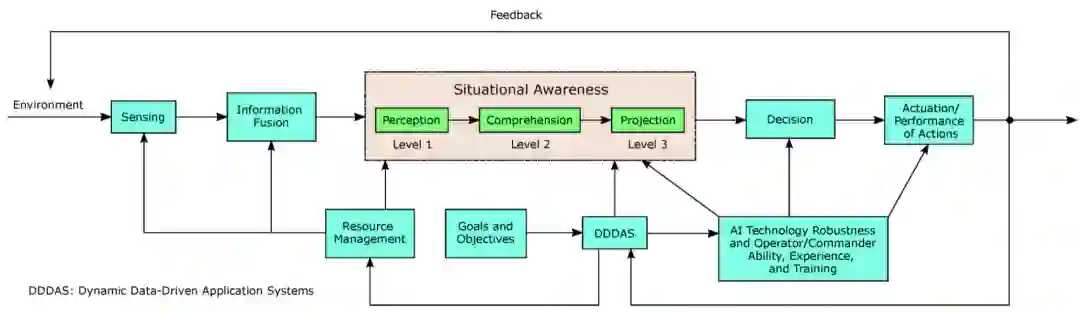

态势感知 (SA) 被定义为对环境中实体的感知、对其意义的理解以及对其近期状态的预测。从空军的角度来看,SA 是指理解和预测空域内红蓝飞机和地面威胁的当前和未来部署的能力。在本文中,我们提出了一个 SA 和动态决策模型,该模型结合了人工智能和动态数据驱动的应用系统,以根据不断变化的情况调整测量和资源。我们讨论了 SA 的测量以及与 SA 量化相关的挑战。然后,我们阐述了大量有助于改进 SA 的技术,从不同的情报收集模式到人工智能,再到自动视觉系统。然后,我们介绍了 SA 的不同应用领域,包括战场、灰色地带战、军事和空军基地、国土安全和国防以及关键基础设施。最后,我们以对 SA 提出未来的见解。

关键词: 态势感知;动态数据驱动系统;人工智能;合成视觉系统;雾计算;灰色地带战

1. 引言

态势感知 (SA) 可以定义为对环境中实体的认知、对其意义的理解以及对其近期状态的预测。从空军的角度来看,SA 是指在一定空间内设想红色和蓝色飞机的当前和未来部署以及地面威胁的能力。Endsley 的 SA 模型 [1] 已被广泛采用,它包括三个不同的阶段或层次:感知、理解和预测。美国国防部 (DOD) 的军事和相关术语词典将空间 SA 定义为:“空间物体和空间作战所依赖的作战环境的必要基础、当前和预测知识和特征”[2]。SA 通常被认为包含评估(机器)、意识(用户)和理解(用户-机器组合)[3]。

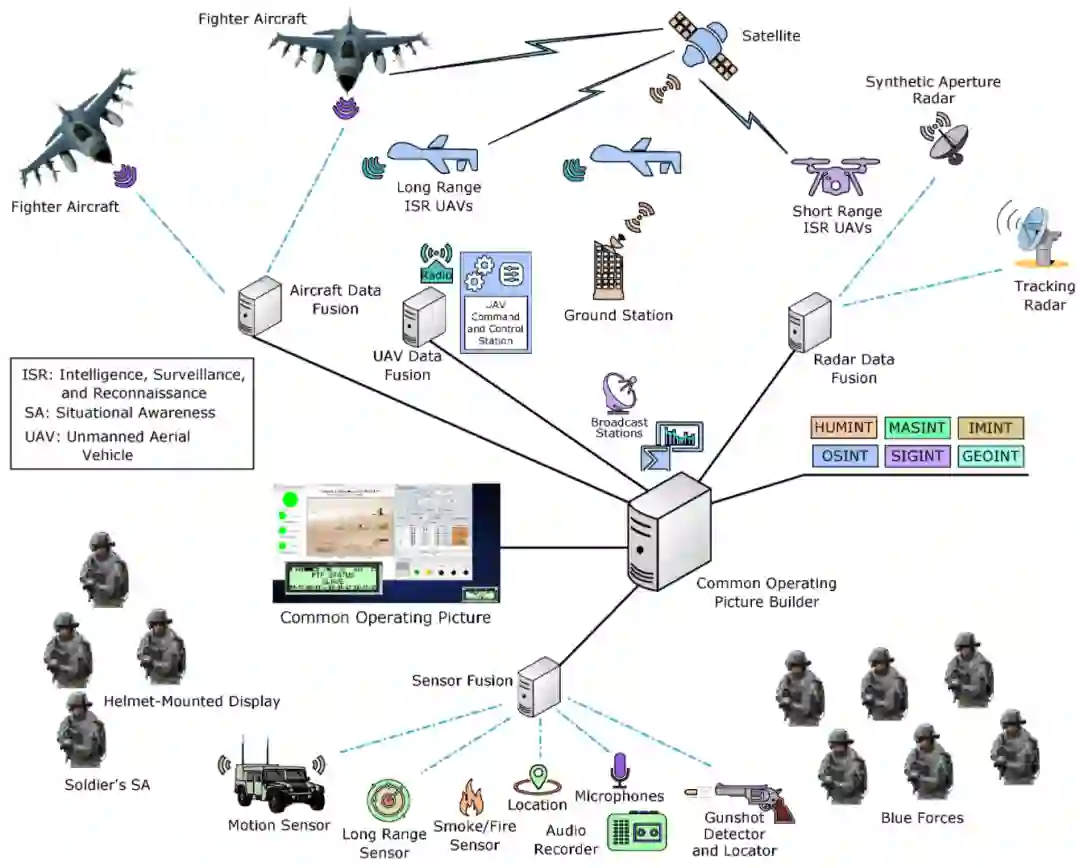

尽管许多领域都需要 SA,例如紧急情况和/或灾难响应、工业过程控制 SA 和基础设施监控,但 SA 对于军事和空军尤其重要。图 1从军事和空军的角度描述了 SA 的概况。SA 是军事指挥和控制 (C2) 不可分割的一部分。美国国防部军事和相关术语词典将 C2 定义为:“在完成任务时,由适当指定的指挥官对指定和附属部队行使权力和指挥”[2]。C2 可以被视为由 SA、计划、任务和控制组成。C2 系统设计的目的是有选择地向指挥官展示形势,以便指挥官了解形势,然后采取最佳行动。SA 不仅对指挥官而且对下马操作员都是必不可少的。为了使下车操作员有效参与,他们不仅必须获取和理解有关其环境的信息,而且还必须利用这些信息来预测不久的将来的事件,从而相应地计划和调整他们的行动。

SA 对空军来说是必不可少的,被认为是空战交战中的决定性因素 [4]。混战中的生存很大程度上依赖于 SA,因为它依赖于观察敌方飞机当前的移动并在敌方自己观察他/她的飞机移动之前几秒钟预测其未来的行动。SA 也可以被视为等同于美国空军 (USAF) 战争理论家约翰·博伊德上校所描述的观察-定向-决策-行动 (OODA) 循环的“观察”和“定向”阶段 [5]。战斗中的制胜策略是通过比对手更好的 SA 进入对手的 OODA 循环,从而不仅比对手更快地做出自己的决定,而且还可能以不可观察或不可理解的方式改变局势在给定的时间内由对手。失去一个人的 SA 就等于脱离了 OODA 循环。由于飞行员要应对较高级别的航空交通、恶劣天气(例如风暴、大雾)以及最近在空域的无人机(UAV)等许多艰巨的情况,他们需要配备先进的 SA 系统来应对在这些对立的条件下。本文从军事和空军的角度讨论 SA。我们在本文中的主要贡献如下:

-

我们从军事和空军的角度定义和阐述 SA。 -

我们提出了一个 SA 和动态决策模型。 -

我们讨论 SA 的测量,确定 SA 评估的指标,以及与 SA 量化相关的挑战。 -

我们讨论了有助于提高 SA 的不同技术和技术。 -

我们概述了 SA 的不同应用领域,包括战场、城市战、灰色地带战、国土安全和国防、灾难响应管理和关键基础设施。

本文的其余部分组织如下。第 2 节介绍了 SA 和相关决策的模型。第 3 节讨论 SA 的测量方法以及与测量 SA 相关的挑战。第 4 节详细介绍了改进 SA 的技术和技术。第 5 节概述了 SA 的不同应用领域。最后,第 6 节总结了本文。

2. SA 和决策模型

图 2. SA 模型和动态决策

图 2. SA 模型和动态决策

3. 衡量态势感知

-

表面效度:根据主题专家的判断,SA 测量方法似乎可以测量 SA 的程度。 -

建构效度: SA 测量方法在何种程度上得到 SA 的合理理论或模型的支持。 -

预测效度: SA 测量方法可以预测 SA 的程度。 -

并发有效性: SA 测量方法与 SA 的其他测量相关的程度。

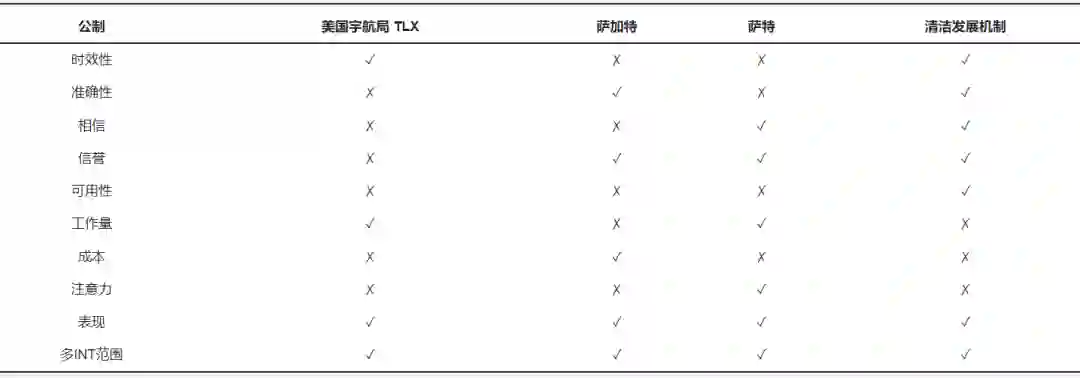

3.1 SA 评估技术

3.1.1 美国宇航局 TLX

3.1.2 SAGAT

3.1.3 SART

3.1.4 CDM

3.2 衡量 SA 的挑战

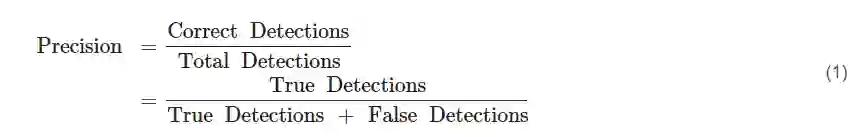

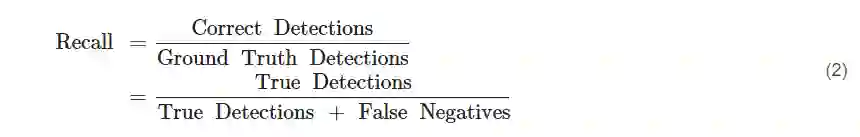

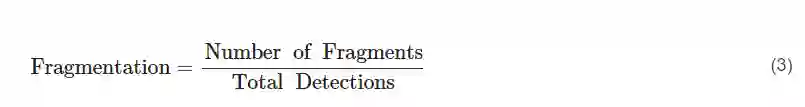

3.3 SA 指标

4. 提高态势感知的技巧和技术

改进 SA 一直处于军事技术进步的前沿。军方已利用各种技术创新来改进 SA。虽然不可能涵盖已用于改进 SA 的所有技术和技术,但本节概述了其中一些正在考虑或已被军队和/或空军采用以增强 SA 的技术进步。

4.1 情报收集模式

SA 依赖于从多个来源收集的情报,例如人类、信号、数据(例如,文本、音频、视频)和社交媒体。为了获得更好的 SA 并提高所获取 SA 的准确性,需要来自多个来源的情报来过滤从特定情报来源报告的差异。有助于改进 SA 的不同情报来源包括人类情报 (HUMINT)、开源情报 (OSINT)、测量和签名情报 (MASINT)、信号情报 (SIGINT)、图像情报 (IMINT) 和地理空间情报 (GEOINT)。

4.2 传感器和传感器网络

技术进步导致了多种传感器的开发,其中许多传感器已在监视和 SA 系统中得到应用。通常用于增强 SA 的传感器包括位置传感器、可见光(红、绿、蓝 (RGB))摄像头传感器、夜视摄像头传感器、红外图像传感器、紫外图像传感器、运动传感器、接近传感器、烟雾/火传感器、枪声探测器和定位器、远程传感器和合成孔径雷达。这些传感器通常以无线方式连接在一起,为给定区域提供监视覆盖。地理定位系统是基于传感器的系统的一个示例,通常是监视和 SA 应用程序的一部分。军事地理定位系统旨在克服多路径并提供小于 1 m (< 1 m) 开阔地形中的测距精度和建筑物内小于 2 m (<2 m) 的精度。为了实现这些目标,军事装备的地理定位系统依赖于各种传感器。用于军事设备的许多地理定位系统集成了来自互补传感器的测量,例如全球定位系统 (GPS)、惯性测量单元、到达时间、气压传感器和磁罗盘,以提供比任何技术都更精确的融合解决方案个别传感器。

大量情报、监视和侦察 (ISR) 传感器收集的数据增强了决策者的 SA,并帮助他们更好地了解他们的环境和威胁。然而,多种因素阻碍了最终用户的 SA 增强,包括不兼容的数据格式、带宽限制、传感器持久性(传感器连续感知的能力)、传感器重访率(传感器观察同一地理点的速率;该术语主要用于移动传感器,例如卫星或无人机传感)和多级安全[ 23 ]。此外,随着传感器数据量的增加,挑战在于识别最重要的信息片段,融合该信息,然后以合适的格式将该信息呈现给最终用户。

最近在军队和空军中,需要访问传感器信息的最终用户数量不断增加。例如,此信息的最终用户可能是制定目标决策的战斗机(例如,F-16 战隼、F-35 闪电 II)的飞行员、保卫城市的军事指挥官、试图在镇压民间骚乱,或联合空中作战中心 (CAOC) 战略团队成员制定空中作战战略计划 [ 23 ]。尽管每个最终用户的具体信息要求、安全级别和带宽限制会有所不同,但对实现和维护 SA 的及时、准确、相关和可信信息的总体需求保持不变。分层传感的概念空军研究实验室 (AFRL) 传感器理事会已设想向决策者提供融合的、多源、多维和多光谱的传感器数据,无论决策者位于何处,都符合他们的需求,其目标是提高决策者的 SA。

4.3 软件定义无线电

软件定义无线电 (SDR) 是一种无线电通信系统,它在软件而不是硬件中实现了许多无线电组件,例如混频器、调制器、解调器、纠错和加密,因此可以更轻松地重新配置和适应不同的沟通情况。美国军方的联合战术无线电系统 (JTRS) 计划的任务是用一组 SDR 替换现有的军用无线电,这些无线电可以通过简单的软件更新在新的频率和模式(波形)下工作,而不是需要多个无线电用于不同的频率和模式并要求更换电路板进行升级 [24]。后来 JTRS 转变为联合战术网络中心 (JTNC) [25]。SDR 经常用于小型单位运营商的 SA 系统,以便为作战人员提供一个系统,该系统可以在限制性环境,特别是城市环境中提供可靠和灵活的通信。SDR 提供广泛的调谐范围(例如,从 20 MHz 到 2500 MHz [26]),使运营商的 SA 系统能够选择最佳频段,以在各种受限地形中保持链路连接。此外,SDR 允许自适应直接序列扩频波形(例如,从 0.5 MHz 到 32 MHz [26]) 用于调制。SDR 的其他潜在可调参数包括无线电设置的适应(例如,传输功率、频率、天线增益、调制、编码、基带滤波、信号增益控制、采样和量化)、数据链路层参数(例如,信道监控和关联方案、传输和睡眠调度、传输速率和错误检查)和网络层参数(例如,路由、服务质量管理和拓扑控制)[27]。

4.4 人工智能

人工智能的进步对 SA 有重大影响。人工智能可以极大地提高下车操作员、士兵和飞行员对环境的认识,因为基于人工智能的应用程序可以通知士兵红军的存在和移动,从而帮助识别和缓解威胁。AI 在 SA 的“投射”阶段(3 级 SA)特别有用。AI 可以帮助进行实时分析和预测以改进 SA。对于军事应用,人工智能可以为地面上的步行操作员和飞行员提供可操作的情报和决策协助。人工智能还可以通过实现预测性维护、提高操作设备的安全性和降低运营成本来促进物流。此外,人工智能可以通过在军用弹药耗尽之前跟踪和供应军用弹药来促进部队的战备状态。人工智能也是人机协作工作不可或缺的一部分,旨在促进人类与复杂机器的高效和有效集成,超越标准图形用户界面、计算机键盘和鼠标的使用,并专注于多模式交互功能,例如眼镜显示、语音、手势识别和其他创新界面。人工智能还适用于完成枯燥、危险或肮脏的军事工作,从而增强兵力,减少伤亡。人工智能也是人机协作工作不可或缺的一部分,旨在促进人类与复杂机器的高效和有效集成,超越标准图形用户界面、计算机键盘和鼠标的使用,并专注于多模式交互功能,例如眼镜显示、语音、手势识别和其他创新界面。人工智能还适用于完成枯燥、危险或肮脏的军事工作,从而增强兵力,减少伤亡。人工智能也是人机协作工作不可或缺的一部分,旨在促进人类与复杂机器的高效和有效集成,超越标准图形用户界面、计算机键盘和鼠标的使用,并专注于多模式交互功能,例如眼镜显示、语音、手势识别和其他创新界面。人工智能还适用于完成枯燥、危险或肮脏的军事工作,从而增强兵力,减少伤亡。

4.5 无人机

无人机 (UAV) 可以极大地帮助改进 SA,因为无人机适用于从被认为沉闷、肮脏或危险的环境中收集情报。随着技术的进步,下一代无人机不仅将收集数据,还将能够执行机载数据处理、融合和分析。配备摄像头的情境感知无人机可以生成对视频中观察到的场景的高级描述,并识别潜在的危急情况。可以利用语义技术来识别场景中的对象及其交互 [ 28]。通过使用模糊认知地图推理模型、深度神经网络或其他机器学习模型,可以为无人机添加认知能力,使无人机了解场景中不断变化的情况并识别不稳定的情况。此外,无人机可以通过充当飞雾在边缘 SA中发挥关键作用因此,当无人机在传感器上方导航时,作为地面传感器数据的接收器。无人机飞雾的一个理想特性是能够处理、融合和分析机上数据以及将数据(无论是原始形式还是经过处理的形式,取决于性质、复杂性和环境)传输到地面用于存档和详细分析的工作站和/或云。无人机还可以采用 DDDAS 方法,使无人机能够根据实时传感器数据动态调整其传感、处理和导航(路由),以更好地监控和跟踪目标。

4.6 自动驾驶汽车

尽管自动驾驶汽车 (AV) 主要针对消费市场,但 AV 也可以使 SA 受益,如下所述。由于 AV 嵌入了大量传感器,因此 AV 能够在运行期间始终进行监控。例如,一个 AV 网络可以在任何时间和地点以全面、详细的跟踪所有 AV 及其用户的形式实现大规模监控 [29]。可以收集和集中存储从车载 AV 的不同传感器检索到的信息。该存储信息的详细分析可用于提供 SA 见解。

4.7 枪击定位系统

枪击定位系统是一种重要的声学监测工具,可用于打击城市地区非法使用枪支的行为,以及在城市战争和战场上定位炮火、子弹和狙击手的来源。声学 SA 可以解释为用于在所有时间和所有天气条件下观察环境声学成分的活动和手段。声学 SA 中的目标采集是指通过对一个或多个先前识别的目标的检测、空间定位、侦察和识别来表征构成环境噪声的声源。现代枪击定位系统归功于军事狙击手检测技术的技术转移,该技术是为对抗战场上的狙击手行动而开发的。枪击定位系统的操作可以通过流体动力学建模、声学传感技术和地震技术来解释。从物理上讲,火灾由两个主要现象构成:枪管内弹药推进剂的冲击引起的化学反应,以及从枪管开口端排放到空气中的弹丸的动力学[30]。弹药发射药的冲击引起的化学反应有两个阶段:第一阶段,子弹发射药被点燃,热量通过枪管呼啸而出,第二阶段,未燃烧的发射药被重新点燃并燃烧产品在枪口外的空气中释放。

与冲击引起的化学反应相关的最关键的流体动力学过程是枪管开口端的放电等离子体的枪口爆炸流。高温高压等离子体的这种快速退出产生了从枪口呈球形辐射的枪口冲击波。弹丸动力学具有三个相关的流体动力学现象[ 30]。首先,释放枪管的弹头的活塞式运动会引起冲击波。其次,抛射体在运动中脱落的涡流会沿着轨迹产生骚动,这会产生风神音。第三,如果弹丸速度为跨音速或更高,它将在飞行中的子弹之后产生弹道冲击波或马赫锥,其压力幅度具有 N 波轮廓。此外,可以根据声学特征区分不同类型的武器。阴影成像已被用于区分不同武器的火力。

电声传感器通常用于检测、定位和识别枪声或射击噪音。电声传感器由压电基板和对声压敏感并具有全向拾音模式的低成本电容式声换能器组成。这些电声传感器处理嵌入在枪击事件声发射中的信息,以猜测枪击源的空间坐标(即方位角、仰角、射程)以及其他相关的弹道特征。电声传感器可以使用无线通信或有线通信(例如,专用电话线)来传输数据。为了进行声学监视,声学传感器分布在感兴趣的区域以形成声学传感器网络。声学传感器通常安装在较高的位置,例如灯杆、高层建筑、蜂窝基站等。声学传感器网络的覆盖范围取决于声学传感器对枪口爆炸波形和环境的敏感度。在露天条件和没有背景噪音的情况下,可以在距离枪支 600 米(0.373 英里)或更远的地方感知到枪口冲击波。在城市环境中,建筑物引入的声学多径和高背景噪声显着降低了传播声学信号的质量。373 英里)或更多距离枪支。在城市环境中,建筑物引入的声学多径和高背景噪声显着降低了传播声学信号的质量。373 英里)或更多距离枪支。在城市环境中,建筑物引入的声学多径和高背景噪声显着降低了传播声学信号的质量。

现代枪击定位系统能够评估射手的方位角和仰角、射手的射程、弹丸的弹道和口径以及初速。弹丸的到达方向是根据弹道冲击波的每次扰动到达声传感器对的时间延迟来估计的。使用一对换能器之间冲击波的到达时间延迟来估计弹丸的速度。弹丸口径可以从 N 波分析中推断出来。射手的射程是通过使用麦克风阵列和三角测量算法分析枪口冲击波前的曲率来确定的[30]。该地理信息系统作为声学 SA 向指挥官或执法官员的一个输入。

4.8 物联网

物联网 (IoT) 可以通过与军事和空军人员的整合极大地增强 SA。操作员/地面士兵是战场上的资产,对于实施战术决策至关重要。越来越多的无处不在的传感和计算设备被军事人员佩戴并嵌入军事装备(例如作战服、仪表化头盔、武器系统等)中。这些传感和计算设备联网在一起形成军事物联网 (IoMT) 或战场物联网 (IoBT) [31]。IoMT/IoBT能够获取多种静态和动态生物特征(如人脸、虹膜、眼周、指纹、步态、手势和面部表情),可用于对士兵的心理物理进行上下文自适应的连续监测和场上的情绪状况。除了监测士兵的武器、弹药和位置外,IoMT/IoBT 还可以帮助捕获士兵的重要健康参数(例如,心率、心电图 (ECG)、血糖水平、体温、血压)。借助 IoMT/IoBT,军队和空军人员能够获得战术态势感知,从而获得对敌人的感知以及友军的进展。IoMT/IoBT 收集的各种统计数据和参数对于坐在指挥和控制中心的指挥官具有重要价值。然后将这些获取的数据发送到边缘服务器或云,然后可以将信息融合和大数据分析应用于 SA、态势评估、决策活动,并为战场上的士兵提供实时支持。指挥官可以了解蓝军的健康参数、武器参数、装备参数和弹药参数,从而可以下达提供适当援助的命令。

4.9 图数据库

最近,在[32]中提出了将物联网(IoMT/IoBT)与图数据库相结合为战场上士兵的每个参数提供 SA,从而实现更好的决策支持系统。图数据库是一种新的范式,其中数据可以以图形形式体现,比传统数据库更容易搜索和遍历。在图形数据库中,数据以节点的形式存储,这些节点通过边以图形方式相互连接,边表示连接节点之间的关系。当数据/节点的属性很重要时,图形数据库很有用。例如,士兵可以是具有不同属性的主节点,例如装备、弹药、武器和身体传感器参数。由于物联网与其他节点和数据有很多互连,因此可以使用图形数据库来存储和检索这些信息。图形表示和存储有助于查询此类复杂数据。图论的标准算法(例如,最短路径、聚类、社区检测等)以及机器学习方法可用于图数据库,以方便检索所需信息[32]。图数据库的使用可以提高指挥官的可视化和SA。通常,平面方式的信息不足以以清晰的方式开发 SA。存储在图形数据库中的各种来源的信息允许以图形方式检索存储的信息,这有助于更好地理解图形中不同节点的属性之间的关系。由于物联网时代从传统的基于地图和基于电话的 SA 过渡,指挥官能够在支持物联网的设备上远程访问所有信息。图形数据库可以在雾/云级别实现,因此查询的可视化结果可以提供有关情况的有趣数据,以协助指挥官做出战术决策。

4.10 雾/边缘计算

雾计算或边缘计算是计算中的一种新趋势,它将应用程序、服务、数据、计算能力、知识生成和决策从集中节点推向网络的逻辑极端。边缘计算和雾计算在本质上是相似的,并且在我们之前的工作中已经概述了一些细微的差异[33]。现有的监视系统难以实时检测、识别和跟踪目标,这主要是由于从传感器传输原始数据、在远程中央平台(例如云)上执行信息融合、计算和分析所涉及的延迟,并将命令发送回执行器以执行控制决策。雾/边缘计算可以在网络边缘附近进行计算,并有助于减轻核心网络的通信负担。雾/边缘计算还支持基于位置的服务、本地分析,并有助于提高 SA 系统的实时响应能力[34、35]。使用生物识别、环境传感器和其他连接的 IoMT/IoBT 设备利用雾/边缘计算快速发送和接收数据不仅有助于改善指挥和控制操作,而且还允许军事人员及时应对战场上的潜在危险情况。

4.11 信息融合

监控应用使用大量传感器,例如运动检测器、接近传感器、生物识别传感器以及各种摄像机,包括彩色摄像机、夜视成像摄像机和热成像摄像机,它们从不同的视点和分辨率观察目标。信息融合通过帮助从感知数据中获得有价值的见解,在 SA 中发挥着重要作用。SA 包含低级信息融合(跟踪和识别)、高级信息融合(基于威胁和场景的评估)和用户细化(物理、认知和信息任务)[ 3]。信息融合最大限度地减少了不同传感器捕获的数据之间的冗余,例如不同相机捕获的相同或相似视图。此外,当系统中的一个相机跟踪的对象移出其视野并进入另一个相机的视野时,信息融合还有助于在相机之间执行切换。在雾/边缘计算范式中,传感器/物联网节点的信息融合减少了需要传输到边缘服务器的数据,从而为物联网设备节省能源,从而有助于延长物联网设备的电池寿命。先进的计算技术,如并行计算和可重构计算,可用于实时信息融合,在物联网和边缘/雾节点提供实时SA。

4.12 视频流中的自动事件识别

来自无人机、物联网设备和闭路电视 (CCTV) 摄像机的视频流是监控和 SA 的重要来源。传统上,需要多个操作员观看这些视频流,然后将有关感兴趣事件的信息传递给指挥官以改进 SA。从大量无人机和物联网设备收集的视频流越来越多,需要越来越多的操作员。此外,在高活动期间,操作员可能会超负荷,因此可能无法跟踪所有感兴趣的事件。自动分析来自各种来源(如无人机和物联网设备)的视频数据,可以通过提供感兴趣的事件或活动的通知来减少所需的操作员数量[36]。事件可以定义为在一段时间内发生的对象之间关系的变化。使用无人机进行自动事件识别的一个有趣例子是车队监视。小型无人机,如“扫描鹰”(ScanEagle),可用于为车队提供监视,在车队上空飞行的无人机不仅会探测和跟踪车队中的实体,而且还会在车队附近发现可能构成威胁的其他车辆和物体。

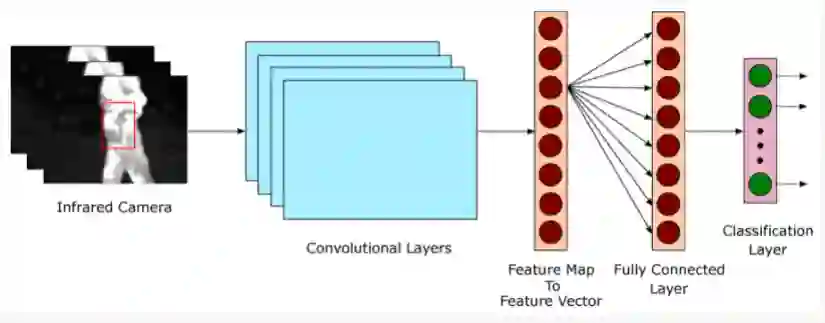

各种方法已用于事件识别,例如贝叶斯网络、隐马尔可夫模型 (HMM) 和神经网络 [36]。特别是,随着深度学习的最新进展,卷积神经网络 (CNN) 在视频帧中的自动对象检测、分类和识别方面变得非常流行。图 3展示了用于自动对象检测和分类的 CNN 架构。CNN 架构通常由输入层、输出层和多个隐藏层组成。CNN 的隐藏层主要包括多个卷积层、全连接层以及可选的非线性层、池化层和归一化层。在图 3,来自红外摄像机的输入被馈送到 CNN 架构,该架构通过多个卷积、非线性、池化、归一化处理输入(注意,为简单起见,图 3中未显示非线性、池化和归一化层)和全连接层,并在输出/分类层产生目标检测和分类的输出。图 3显示了 CNN 架构从红外视频输入中检测手枪。

图 3. 用于自动对象检测和分类的卷积神经网络 (CNN) 架构

我们注意到 HMM 和神经网络需要大量的训练数据来配置网络以识别事件。由于许多感兴趣的事件是异常事件,缺乏用于训练的视频数据,因此当训练视频数据稀缺时,贝叶斯网络可用于事件识别[36]。贝叶斯网络还在推理中包含不确定性,并提供指示事件为真的可能性的输出,或对于多状态事件,事件处于特定状态的概率。

尽管自动事件识别对 SA 具有巨大的价值,但它是一个具有挑战性的问题,也是近期研究的重点。其他对 SA 至关重要且是近期研究主题的相关研究问题是对象检测和识别、对象之间关系的识别和活动识别。

4.13 增强视觉系统 (EVS)

增强型视觉系统 (EVS) 或增强型飞行视觉系统 (EFVS) 通过主动和被动传感器增强飞行员的能见度和 SA,这些传感器可以穿透风暴、雾、霾、黑暗、雨和雪等天气现象。现代军用飞机配备了增强型视觉系统,但是,由于成本、复杂性和技术性,这些系统在商用飞机上并不常见。增强型视觉传感器的性能取决于传感器特性和外部环境。例如,高频雷达(例如 94 GHz)和红外传感器的范围性能在强降水和某些雾类型中会降低 [ 37]。相反,低频(例如,9.6 GHz)和中频(例如,35 GHz)雷达的范围有所提高,但显示分辨率较差。此外,当多个有源传感器靠近时,有源雷达传感器可能会相互干扰。尽管增强视觉系统已在军事和空军中大量使用以改进 SA,但当代增强视觉系统不提取可能在特定温度或雷达反射条件下产生误导性视觉伪影的颜色特征 [ 37 ]。EVS/EFVS 的示例包括 Collins Aerospace 的 EFVS-4860 [ 38 ] 和 Collins Aerospace 的 EVS-3600 [ 39],它使用短波红外、长波红外和可见光摄像机的组合来提高飞行员的能见度。EVS 的另一个例子是 Elbit System 的 ClearVision [ 40 ],它结合了视觉相机、近红外传感器和长波红外传感器来提供改进的 SA。

4.14 合成视觉系统 (SVS)

合成视觉系统本质上是不受天气影响的显示器,允许操作员和/或飞行员看到世界,因为它始终处于完美的天气条件下。合成视觉系统使用传感器、全球定位系统 (GPS) 卫星信号、惯性参考系统和内部数据库的组合,为飞行员提供他们周围世界的合成视图。合成视觉系统通过在姿态参考系统上叠加真实世界图像的增强现实 (AR) 系统取代了飞机中旧的姿态指示器(即指示地平线位置的蓝棕色姿态指示器)。基于 AR 的 SA 系统,例如 NASA 的合成视觉系统,可以提高航空安全并提高飞机运行效率。

Collins Aerospace 的 SVS 在 HUD 上提供与天气无关的高清图像显示,其中包含三层信息——地形、障碍物、机场和跑道——以呈现环境的完整画面 [ 39 ]。Collins Aerospace 的 SVS 将传感器与提供地形轮廓、英里标记、跑道亮点和机场圆顶的全球数据库集成在一起。SVS 的另一个例子是霍尼韦尔的 SmartView [ 41 ],它将来自各种机载数据库、GPS 和惯性参考系统的飞行信息合成为全面的、易于理解的前方地形 3-D 渲染。

4.15 组合视觉系统 (CVS)

合成视觉系统让飞行员在任何天气条件下都能清楚地看到窗外的世界。这些视觉系统是迈向未来视觉系统的一步,也称为组合视觉系统 (CVS),它将为飞行员提供远远超出眼睛所能看到的视野。CVS 是合成视觉(即基于传感器和存储的数据库信息实时创建渲染环境的系统)和增强型飞行视觉系统(即利用前视红外系统和毫米波雷达提供飞行员可以实时查看飞机周围的世界)[ 42 ]。Collins Aerospace 的 CVS 通过将他们的 EVS 和 SVS 组合成一个动态图像为飞行员提供清晰的视图,如图 4 所示. CVS 算法利用来自 EVS 和 SVS 的重叠视野来检测、提取和显示来自两个来源的内容。例如,CVS 提供夜间地形热成像、不受天气影响的虚拟地形,以及集成在单个系统中的跑道和进近照明的快速检测。

图 4. Collins Aerospace 的组合视觉系统 [43]

4.16 增强现实

随着移动设备的计算能力不断提高,可以由多个部门(例如,军事、民用、执法)的步行操作员携带,AR 为增强 SA 提供了一种有前途的手段。由于下车操作员倾向于处理大量可能相关或不相关的信息,因此 AR 系统可以通过以可识别的方式过滤、组织和显示信息来帮助改进 SA [44]。AR 系统需要识别要在操作员的 HUD 中显示和增强的感兴趣元素。这些元素包括地形图和蓝色和红色力量的指示。可以使用以操作员为中心的径向迷你地图显示地形图,实时显示操作员的位置以及盟友和敌人的位置以及兴趣点。通过使用 AR 技术对路径进行着色,导航数据可以与地形图集成,从而将地图和导航路径叠加在操作员的视野中。AR 还能够在操作员可能难以操纵其设备和/或武器的情况下提供帮助,例如在近距离战斗或巡逻中,武器通常在臀部水平处静止[44]。这种 AR 十字准线的有效性可以通过比较操作员在有或没有十字准线的参与期间的响应时间来凭经验测量。总之,随着 AR 技术的进步,AR 在军事和空军设备中的使用一直在不断增加。

五、态势感知的应用领域

战场、军事和空军基地、航空、空中交通管制、紧急情况和/或灾难响应、工业流程管理、城市地区和关键基础设施等各个领域都需要 SA,如图 5 所示。在本节中,我们将概述其中一些领域。不充分的 SA 通常与导致逆境的人为错误有关,例如战争中的军事损失、紧急情况和灾难响应中平民和急救人员的生命损失以及工业控制中的收入损失。

图 5. 态势感知领域

5.1 战场

SA 对于知情和可靠的战场 C2 系统必不可少。由 IoBT/IoMT 和雾计算等最先进技术增强的 SA 可以帮助军队和空军充分利用部署在(未来)中的大量异构 IoBT/IoMT 设备收集的信息。) 战场,并且可以为军队/空军提供相对于对手的战略优势。战场上的 SA 可以在不同级别提供:(i)监督战场行动的指挥官,(ii)在战术层面执行任务的下马士兵,以及(iii)为士兵提供近距离空中支援的飞行员。SA 技术的最新进展可以帮助士兵在低延迟下识别敌人、访问设备和武器系统,并提高 SA 和士兵的安全性。

5.2 城市战

在城市环境中为军队和空军部队维护 SA 比在农村和开阔地带更具挑战性。城市环境中的战斗空间动态发生了显着变化,从传统的以敌为主的二维空间转变为敌方可以从任意方向、多方向同时发动进攻的三维迷宫[ 26]。越来越多的非战斗人员使城市战场变得更加复杂。GPS 等导航辅助设备在城市环境中的可靠性不如开阔地形,因为很难获得卫星的视线。因此,在城市环境中共享有关战斗空间的信息以获得共同作战图 (COP)(美国国防部军事及相关术语词典将 COP 定义为:“由多个司令部共享的相关信息的单一相同显示,以促进协作规划并协助所有梯队实现态势感知”[ 2 ])需要一个能够在任何环境(即存在多径和无线电干扰的情况下)保持链路的通信系统/网络。

5.3 灰色地带战

在不对称战争或灰色地带战争中特别需要 SA [ 45] 识别敌方战斗人员并不总是那么简单,例如,敌人可能以平民的身份出现或使用被盗徽章进入受限军事基地。为了在灰色区域情况下提供 SA,生物特征传感器可以扫描虹膜、指纹和其他生物特征数据,以识别可能构成危险的个人。在 SA 系统中使用 DDDAS 方法可以帮助有针对性地收集有关已识别个人的数据,还可以动员响应单位(例如狙击手)来分散威胁。SA 系统可以提供对站点和潜在灰色区域参与者的实时监控,以帮助防止或减轻灰色区域战争的负面影响,例如错误信息以及服务和关键基础设施的中断。

5.4 军事和空军基地

SA 是军事和空军基地的安全保障所必需的。由于敌人可能试图用偷来的徽章/身份潜入基地,因此需要对军事/空军基地进行持续监视。SA 系统可以检测基地中的可疑人员和未经授权的人员,当局可以据此采取适当的行动。

5.5 国土安全与国防

SA 系统是增强国土安全和防御所必需的。实时监控有助于及时发现和应对自然灾害(例如飓风、洪水)和人为事件(例如恐怖主义)。此外,SA 系统可以协助执法人员反恐、打击走私和逮捕逃犯。

5.6 灾难响应管理

灾难恢复行动具有挑战性,需要多个机构的支持,包括当地和国际应急响应人员、非政府组织和军方。在灾难发生后,最紧迫的要求是对 SA 的要求,以便可以根据影响和救灾需求对资源(包括人员和物资)进行优先排序和引导。此外,在灾难性情况下,随着恢复工作的继续,SA 需要根据不断变化的条件不断更新。在灾难情况下提供 SA 的传统信息来源包括灾难受害者的报告,但是,受害者报告可能并非在所有情况下都可行,因为通信手段可能会因灾难而中断。因此,灾害监测和报告需要 SA 系统,因此有助于对灾害做出适当的响应。SA 系统也是早期预警系统不可或缺的一部分,通过促进快速检测和响应紧急情况(例如火灾、洪水、桥梁倒塌、供水中断、地震、火山爆发、和龙卷风等。

5.7 关键基础设施

桥梁、发电和配电网络、供水网络、电信网络、交通网络等关键基础设施的安全需要 SA。我们通过几个来自道路网络的例子来说明关键基础设施的 SA交通网络的重要组成部分。道路 SA 需要感知不利的道路状况(例如坑洼)、驾车者、行人和交通状况 [ 10]。道路 SA 提供的交通监控和可疑车辆检测将减少犯罪、事故和死亡人数。深度学习的进步极大地促进了 Road SA 的发展。CNN 可用于感知道路图像数据中的车辆类别和位置,从而有助于解决道路交通 SA 系统中的情境元素识别问题 [ 11 ]。在灰色地带战争时代,监控关键基础设施变得更加重要,因为敌人通常旨在破坏关键基础设施,从而为军事交战创造有利局面。

6. 结论

在本文中,我们从军事和空军的角度定义并解释了态势感知 (SA)。我们已经提出了 SA 和动态决策的模型。所提出的模型结合了人工智能和动态数据驱动的应用系统,以帮助根据 SA 核心感知和预测的不断变化的情况来引导测量和资源。我们讨论了 SA 的测量并确定了 SA 评估的指标。我们还概述了与测量 SA 相关的挑战。我们讨论了可以增强 SA 的不同技术和技术,例如不同模式的情报收集、传感器和传感器网络、软件无线电、人工智能、无人驾驶飞行器、自动驾驶汽车、枪击定位系统、物联网、雾/边缘计算、信息融合、视频流中的自动事件识别、增强视觉系统、合成视觉系统、组合视觉系统和增强现实。最后,我们介绍了需要具备 SA 的不同领域或应用领域,例如战场、城市战、灰色地带战、军事和空军基地、国土安全和国防以及关键基础设施。

展望未来,SA 技术和方法将随着技术的进步而不断改进。有许多领域需要积极研究以增强 SA。例如,军方仍在寻求基于软件定义无线电 (SDR) 的完美无线电,该无线电可以实现安全、可互操作和有弹性的多通道通信,能够处理不同的模式/波形。自动事件检测和识别是与 SA 相关的另一个需要积极研究的领域。特别是实时自动事件检测和识别是一个具有挑战性的问题,不仅需要人工智能的进步,还需要先进的计算技术,例如并行计算和可重构计算。此外,硬件加速器可以方便地实现实时自动事件检测和识别。另一个需要积极研究的领域是无人驾驶飞行器 (UAV) 的安全自主导航,以便无人机或无人机群能够自主完成任务,而无需主动远程驾驶。需要进一步研究战场/军事物联网 (IoBT/IoMT),以感知、整合和处理与士兵的健康和心理生理状况、士兵的武器、弹药和战场位置相关的大量参数,以及有关感兴趣地区的红军信息。雾/边缘计算的进一步研究可以确保对这些感测参数进行实时处理和分析,以帮助实现实时评估和指挥和控制决策,以应对不断变化的情况。士兵和飞行员的增强视觉系统需要随着传感和增强现实 (AR) 技术的创新而不断改进。需要基于多智能融合结果开发新的可视化技术,以允许用户查看可重新配置的用户自定义操作画面。关于 SA 量化,需要开发新的 SA 测量技术,以涵盖更多的评估指标。最后,迫切需要开发新的 SA 评估工具,以便根据给定应用程序领域的 SA 要求,可以根据这些工具对 SA 进行量化。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“SA23” 就可以获取《AI如何促进态势感知?2022美国空军AFRL等「态势感知」万字综述论文,24也pdf阐述智能战场态势感知技术、挑战和前景》专知下载链接

资金

这项研究得到了空军研究实验室 (AFRL) 信息局 (RI) 的部分支持,通过空军科学研究办公室 (AFOSR) 夏季教师奖学金计划®,合同编号 FA8750-15-3-6003、FA9550- 15-0001 和 FA9550-20-F-0005。本材料中表达的任何意见、发现和结论或建议均为作者的观点,不一定反映 AFRL 和 AFOSR 的观点。APC 由堪萨斯州立大学资助。

参考文献

-

Endsley, M.R. Designing for Situation Awareness in Complex System. In Proceedings of the Second Intenational Workshop on Symbiosis of Humans, Artifacts and Environment; 2001. Available online:https://www.researchgate.net/profile/Mica-Endsley/publication/238653506_Designing_for_situation_awareness_in_complex_system/links/542b1ada0cf29bbc126a7f35/Designing-for-situation-awareness-in-complex-system.pdf (accessed on 13 December 2021). -

DOD. DOD Dictionary of Military and Associated Terms. 2019. Available online: https://www.jcs.mil/Portals/36/Documents/Doctrine/pubs/dictionary.pdf (accessed on 16 August 2019). -

Blasch, E. Multi-Intelligence Critical Rating Assessment of Fusion Techniques (MiCRAFT). In Proceedings of the SPIE, Signal Processing, Sensor/Information Fusion, and Target Recognition XXIV; 2015; Volume 9474. Available online: https://www.spiedigitallibrary.org/conference-proceedings-of-spie/9474/94740R/Multi-intelligence-critical-rating-assessment-of-fusion-techniques-MiCRAFT/10.1117/12.2177539.short?SSO=1 (accessed on 13 December 2021). -

Spick, M. The Ace Factor: Air Combat and the Role of Situational Awareness; Naval Institute Press: Annapolis, MD, USA, 1988. [Google Scholar] -

McKay, B.; McKay, K. The Tao of Boyd: How to Master the OODA Loop. 2019. Available online: https://www.artofmanliness.com/articles/ooda-loop/ (accessed on 14 August 2019). -

Endsley, M.R. Toward a Theory of Situation Awareness in Dynamic Systems. Hum. Factors J. Hum. Factors Ergon. Soc. 1995, 37, 32–64. [Google Scholar] [CrossRef] -

Endsley, M.R. Situation Awareness in Aviation Systems. In Handbook of Aviation Human Factors; Garland, D.J., Wise, J.A., Hopkin, V.D., Eds.; Lawrence Erlbaum Associates Publishers: Mahwah, NJ, USA, 1999; pp. 257–276. [Google Scholar] -

Blasch, E.; Ravela, S.; Aved, A. (Eds.) Handbook of Dynamic Data Driven Applications Systems; Springer: Berlin/Heidelberg, Germany, 2018. [Google Scholar] -

Snidaro, L.; García, J.; Llinas, J.; Blasch, E. (Eds.) Context-Enhanced Information Fusion: Boosting Real-World Performance with Domain Knowledge; Springer: Berlin/Heidelberg, Germany, 2016. [Google Scholar] -

Garg, V.; Wickramarathne, T. Ubiquitous Sensing for Enhanced Road Situational Awareness: A Target-Tracking Approach. In Proceedings of the 21st International Conference on Intelligent Transportation Systems (ITSC), Maui, HI, USA, 4–7 November 2018; pp. 831–836. [Google Scholar] -

Zhu, Q. Research on Road Traffic Situation Awareness System Based on Image Big Data. IEEE Intell. Syst. 2020, 35, 18–26. [Google Scholar] [CrossRef] -

Zhang, D.; Peng, Y.; Zhang, Y.; Wu, D.; Wang, H.; Zhang, H. Train Time Delay Prediction for High-Speed Train Dispatching Based on Spatio-Temporal Graph Convolutional Network. IEEE Trans. Intell. Transp. Syst. 2021, 1–11. Available online: https://ieeexplore.ieee.org/stamp/stamp.jsp?arnumber=9511425 (accessed on 13 December 2021). [CrossRef] -

Endsley, M.R. Situation Awareness Global Assessment Technique (SAGAT). In Proceedings of the IEEE National Aerospace and Electronics Conference, Dayton, OH, USA, 23–27 May 1988. [Google Scholar] -

Uhlarik, J.; Comerford, D.A. A Review of Situation Awareness Literature Relevant to Pilot Surveillance Functions; Office of Aerospace Medicine, Federal Aviation Administration, DOT/FAA/AM-02/3; 2002. Available online: https://www.faa.gov/data_research/research/med_humanfacs/oamtechreports/2000s/media/0203.pdf (accessed on 13 December 2021). -

Nguyen, T.; Lim, C.P.; Nguyen, N.D.; Gordon-Brown, L.; Nahavandi, S. A Review of Situation Awareness Assessment Approaches in Aviation Environments. IEEE Syst. J. 2019, 13, 3590–3603. [Google Scholar] [CrossRef] -

Hart, S.G.; Staveland, L.E. Development of NASA-TLX (Task Load Index): Results of Empirical and Theoretical Research. Adv. Psychol. 1988, 52, 139–183. [Google Scholar] -

Taylor, R. Situational Awareness Rating Technique (SART): The Development of a Tool for Aircrew Systems Design. In Proceedings of the AGARD AMP Symposium on Situational Awareness in Aerospace Operations (AGARD-CP-478), Copenhagen, Denmark, 2–6 October 1989. [Google Scholar] -

O’Hare, D.; Wiggins, M.; Williams, A.; Wong, W. Cognitive Task Analyses for Decision Centred Design and Training. Ergonomics 1998, 41, 1698–1718. [Google Scholar] [CrossRef] [PubMed] -

Blasch, E.P.; Salerno, J.J.; Tadda, G.P. Measuring the Worthiness of Situation Assessment. In High-Level Information Fusion Management and Systems Design; Blasch, E., Bossé, E., Lambert, D.A., Eds.; Artech House: Norwood, MA, USA, 2012; pp. 315–329. [Google Scholar] -

Endsley, M.R. The Divergence of Objective and Subjective Situation Awareness: A Meta-Analysis. J. Cogn. Eng. Decis. Mak. 2020, 14, 34–53. [Google Scholar] [CrossRef] -

Zhang, T.; Yang, J.; Liang, N.; Pitts, B.J.; Prakah-Asante, K.O.; Curry, R.; Duerstock, B.S.; Wachs, J.P.; Yu, D. Physiological Measurements of Situation Awareness: A Systematic Review. Hum. Factors 2020, 1–22. Available online: https://pubmed.ncbi.nlm.nih.gov/33241945/ (accessed on 13 December 2021). [CrossRef] [PubMed] -

Tadda, G. Measuring Performance of Cyber Situation Awareness Systems. In Proceedings of the 2008 11th International Conference on Information Fusion, Cologne, Germany, 30 June–3 July 2008; pp. 1–8. [Google Scholar] [CrossRef] -

Nowak, M. Layered Sensing to Enhance Situational Awareness. In Proceedings of the International Symposium on Collaborative Technologies and Systems, Irvine, CA, USA, 19–23 May 2008. [Google Scholar] -

Kamal, S.; Armantrout, J.T. The U.S. Military’s Joint Tactical Radio System. 2020. Available online: https://www.doncio.navy.mil/CHIPS/ArticleDetails.aspx?id=4344 (accessed on 29 May 2020). -

U.S. Military. Joint Tactical Networking Center. 2020. Available online: https://www.jtnc.mil/ (accessed on 29 May 2020). -

Randall, A.L.; Walter, R.C. Overview of the Small Unit Operations Situational Awareness System. In Proceedings of the IEEE Military Communications Conference (MILCOM), Boston, MA, USA, 13–16 October 2003. [Google Scholar] [CrossRef] -

Kansakar, P.; Munir, A. A Two-Tiered Heterogeneous and Reconfigurable Application Processor for Future Internet of Things. In Proceedings of the IEEE Computer Society Annual Symposium on VLSI (ISVLSI), Hong Kong, China, 9–11 July 2018. [Google Scholar] -

Cavaliere, D.; Senatore, S.; Loia, V. Proactive UAVs for Cognitive Contextual Awareness. IEEE Syst. J. 2019, 13, 3568–3579. [Google Scholar] [CrossRef] -

Bloom, C.; Tan, J.; Ramjohn, J.; Bauer, L. Self-Driving Cars and Data Collection: Privacy Perceptions of Networked Autonomous Vehicles. In Proceedings of the Thirteenth Symposium on Usable Privacy and Security (SOUPS 2017), Santa Clara, CA, USA, 12–14 July 2017. [Google Scholar] -

Aguilar, J.R. Gunshot Location Systems: The transfer of the sniper detection technology from military to civilian applications. In Proceedings of the International Carnahan Conference on Security Technology (ICCST), Medellin, Colombia, 8–10 October 2013. [Google Scholar] -

Castiglione, A.; Choo, K.K.R.; Nappi, M.; Ricciardi, S. Context Aware Ubiquitous Biometrics in Edge of Military Things. IEEE Cloud Comput. 2017, 4, 16–20. [Google Scholar] [CrossRef] -

Tripathi, G.; Sharma, B.; Rajvanshi, S. A Combination of Internet of Things (IoT) and Graph Database for Future Battlefield Systems. In Proceedings of the International Conference on Computing, Communication and Automation (ICCCA), Greater Noida, India, 5–6 May 2017. [Google Scholar] -

Munir, A.; Kansakar, P.; Khan, S.U. IFCIoT: Integrated Fog Cloud IoT: A novel architectural paradigm for the future Internet of Things. IEEE Consum. Electron. Mag. 2017, 6, 74–82. [Google Scholar] [CrossRef] -

Munir, A.; Blasch, E.; Kwon, J.; Kong, J.; Aved, A. Artificial Intelligence and Data Fusion at the Edge. IEEE Aerosp. Electron. Syst. Mag. 2021, 36, 62–78. [Google Scholar] [CrossRef] -

Munir, A.; Kwon, J.; Lee, J.H.; Kong, J.; Blasch, E.; Aved, A.; Muhammad, K. FogSurv: A Fog-Assisted Architecture for Urban Surveillance Using Artificial Intelligence and Data Fusion. IEEE Access 2021, 9, 111938–111959. [Google Scholar] [CrossRef] -

Higgins, R.P. Automatic Event Recognition for Enhanced Situational Awareness in UAV Video. In Proceedings of the IEEE Military Communications Conference (MILCOM), Atlantic City, NJ, USA, 17–20 October 2005. [Google Scholar] [CrossRef] -

Prinzel, L.; Kramer, L. Sythetic Vision Systems. 2009. Available online: https://ntrs.nasa.gov/archive/nasa/casi.ntrs.nasa.gov/20090007635.pdf (accessed on 11 August 2019). -

Rockwell Collins. Rockwell Collins EFVS-4860 Enhanced Flight Vision System. 2006. Available online: www.rockwellcollins.com (accessed on 12 August 2019). -

Rockwell Collins. Rockwell Collins Enhanced Vision Systems. 2019. Available online: https://www.rockwellcollins.com/Products-and-Services/Commercial-Aviation/Flight-Deck/Vision-Systems.aspx (accessed on 12 August 2019). -

Elbit Systems. ClearVision EVS. 2016. Available online: https://elbitsystems.com/media/Cearvision_EVSAward_2016.pdf (accessed on 12 August 2019). -

Honeywell. Honeywell SmartView Synthetic Vision System. 2019. Available online: https://aerospace.honeywell.com/en/products/safety-and-connectivity/smartview-synthetic-vision-system (accessed on 12 August 2019). -

NASA. NASA, Boeing Testing Synthetic Vision Technologies. 2017. Available online: https://www.nasa.gov/feature/langley/nasa-boeing-testing-synthetic-vision-technologies (accessed on 11 August 2019). -

Collins Aerospace. New Bombardier Global 5500 and Global 6500 Aircraft to Feature Rockwell Collins’ Transformational Flight Deck and Cabin Systems. 2020. Available online: https://www.rockwellcollins.com/Data/News/2018-Cal-Yr/CS/20180718-Global-5500-6500-feature-transformational-flight-deck-cabin-systems.aspx (accessed on 20 June 2020). -

Brandão, W.L.; Pinho, M.S. Using Augmented Reality to Improve Dismounted Operators’ Situation Awareness. In Proceedings of the IEEE Annual International Symposium on Virtual Reality (VR), Los Angeles, CA, USA, 18–22 March 2017. [Google Scholar] -

Votel, J.L.; Cleveland, C.T.; Connett, C.T.; Irwin, W. Unconventional Warfare in the Gray Zone. Jt. Force Q. 2016, 101–109. Available online: https://ndupress.ndu.edu/Portals/68/Documents/jfq/jfq-80/jfq-80_101-109_Votel-et-al.pdf (accessed on 13 December 2021).

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“SA23” 就可以获取《AI如何促进态势感知?2022美国空军AFRL等「态势感知」万字综述论文,24也pdf阐述智能战场态势感知技术、挑战和前景》专知下载链接

请扫码加入专知人工智能群(长按二维码),或者加专知小助手微信(zhuanzhi02),加入专知主题群(请备注主题类型:AI、NLP、CV、 KG、论文等)交流~