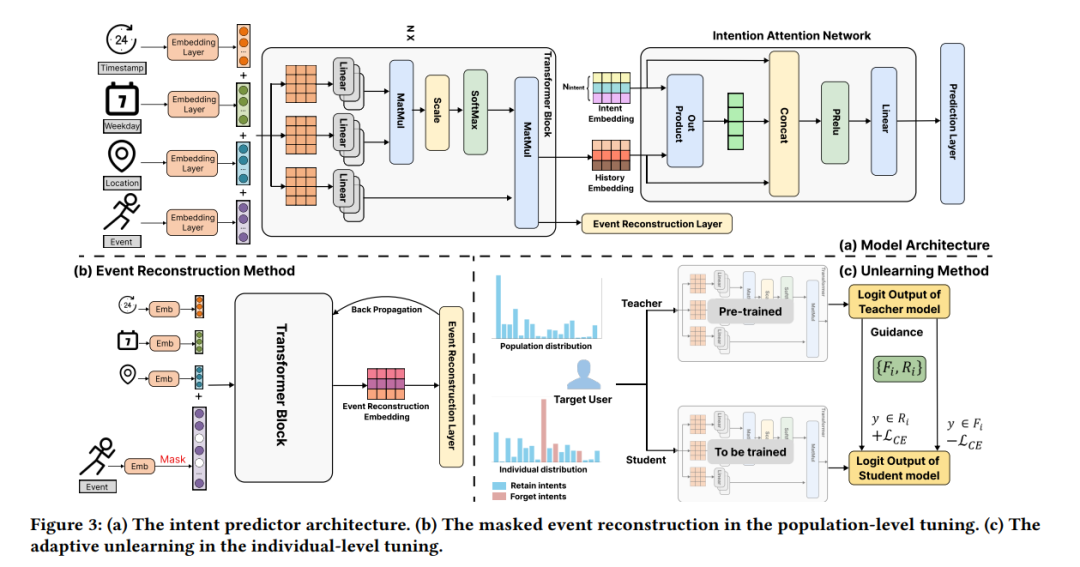

![]() 移动设备,尤其是智能手机,支持丰富的功能,已经发展成为日常生活中不可或缺的工具。随着生成式人工智能服务的兴起,智能手机有望转变为个性化的助手,预测用户需求并相应地安排服务。在智能手机上预测用户意图,并基于过去的交互和上下文反映预期的活动,是实现这一愿景的关键步骤。现有的研究主要集中于特定领域,忽视了在动态上下文中对多样事件序列进行建模的挑战。利用预训练语言模型(PLM)提供了一个有前途的方向,然而将PLM适应于设备上的用户意图预测仍面临重大挑战。为了解决这些挑战,我们提出了PITuning,这是一种从群体到个体的调优框架。PITuning通过动态事件到意图的转化建模增强了常见模式的提取,并通过自适应去学习策略解决了长尾偏好问题。基于真实世界数据集的实验结果表明,PITuning在意图预测性能上表现优越,突显了其捕捉长尾偏好能力及其在设备端预测场景中的实用性。https://arxiv.org/pdf/2408.09815

移动设备,尤其是智能手机,支持丰富的功能,已经发展成为日常生活中不可或缺的工具。随着生成式人工智能服务的兴起,智能手机有望转变为个性化的助手,预测用户需求并相应地安排服务。在智能手机上预测用户意图,并基于过去的交互和上下文反映预期的活动,是实现这一愿景的关键步骤。现有的研究主要集中于特定领域,忽视了在动态上下文中对多样事件序列进行建模的挑战。利用预训练语言模型(PLM)提供了一个有前途的方向,然而将PLM适应于设备上的用户意图预测仍面临重大挑战。为了解决这些挑战,我们提出了PITuning,这是一种从群体到个体的调优框架。PITuning通过动态事件到意图的转化建模增强了常见模式的提取,并通过自适应去学习策略解决了长尾偏好问题。基于真实世界数据集的实验结果表明,PITuning在意图预测性能上表现优越,突显了其捕捉长尾偏好能力及其在设备端预测场景中的实用性。https://arxiv.org/pdf/2408.09815 ![]()