【Amazon】使用预训练Transformer模型进行数据增强

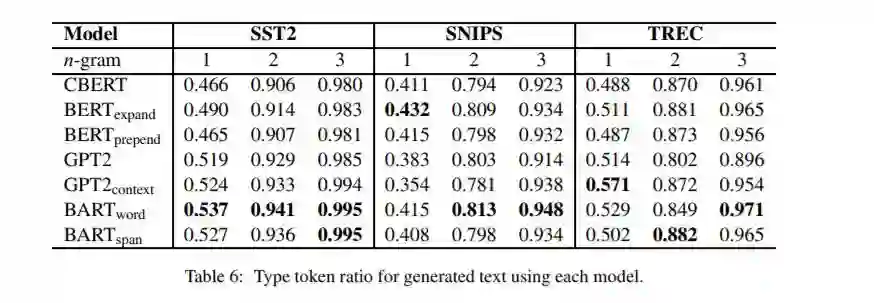

基于语言模型的预训练模型,如BERT,在不同的NLP任务中提供了显著的收益。在本文中,我们研究了不同类型的基于自回归模型(GPT-2)、自编码器模型(BERT)和seq2seq模型(BART)等用于条件数据增强的预训练transformer 模型。我们表明,将类标签前置到文本序列提供了一种简单而有效的方法来设置预训练模型的条件,以便进行数据扩充。在三个分类基准上,预先训练的Seq2Seq模型优于其他模型。此外,我们还探讨了不同的基于预训练模型的数据扩充在数据多样性方面是如何不同的,以及这些方法如何很好地保存类标签信息。

地址:

https://www.zhuanzhi.ai/paper/f0767181df6e45b5ff53f5019f9137de

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“DAPT” 就可以获取《Amazon—使用预训练Transformer模型进行数据增强》专知下载链接

登录查看更多

相关内容

专知会员服务

51+阅读 · 2020年3月7日

Arxiv

4+阅读 · 2018年8月15日

Arxiv

4+阅读 · 2017年12月2日