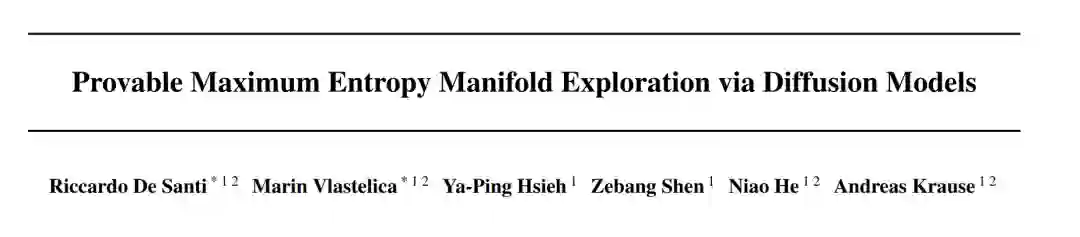

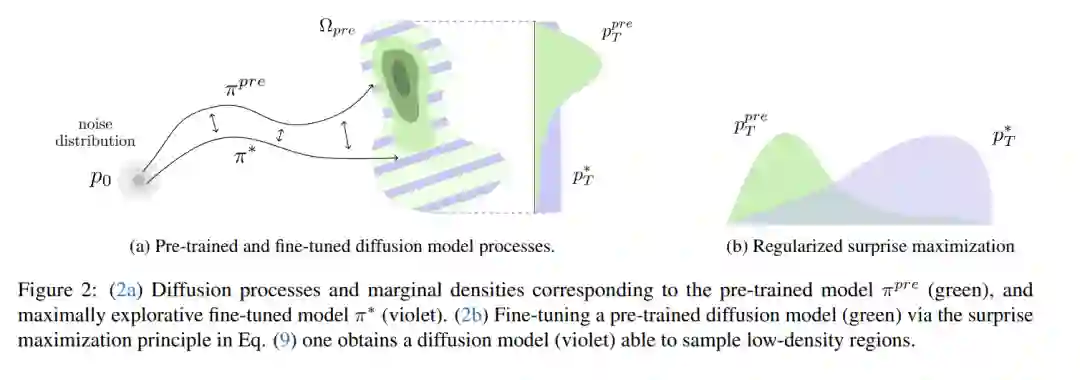

探索在解决真实世界中的决策问题(如科学发现)中至关重要,其目标是生成真正新颖的设计,而非仅仅模仿已有数据分布。在本研究中,我们关注如何在不依赖显式不确定性量化的前提下,利用生成模型的表征能力来实现探索。我们提出了一个新颖的框架,将探索问题表述为在由预训练扩散模型隐式定义的近似数据流形上进行熵最大化。 随后,我们引入了一种基于密度估计的全新探索原理,而密度估计在实际中是一个众所周知的挑战性问题。为了解决这一难题并提升方法的可扩展性,我们利用了扩散模型诱导密度的熵与其得分函数之间的基本联系。在此基础上,我们设计了一种基于镜像下降(mirror descent)的算法,将探索问题转化为对预训练扩散模型的序列式微调过程。 在现实可行的假设下,借助近期对镜像流(mirror flows)的理解,我们证明了该算法能够收敛到最优的探索性扩散模型。最后,我们在合成任务与高维文本生成图像的扩散任务上对该方法进行了实证评估,结果展现出有前景的性能表现。

成为VIP会员查看完整内容

相关内容

Arxiv

87+阅读 · 2023年4月4日

Arxiv

153+阅读 · 2023年3月29日