![]() 人工智能(AI)驱动的电子设计自动化(EDA)技术已在VLSI电路设计应用中被广泛探索。最近,针对电路的基础AI模型作为一项新兴技术趋势开始崭露头角。与传统的面向特定任务的AI解决方案不同,这些新型AI模型的发展经历了两个阶段:1)在大量无标签数据上通过自监督预训练以学习电路的内在特性;2)针对具体下游应用进行高效的微调,例如早期设计质量评估、电路相关上下文生成以及功能验证。这一新范式带来了诸多优势:模型的泛化能力、对标注电路数据依赖的降低、高效适应新任务以及前所未有的生成能力。本文提出将采用这一新范式开发的AI模型称为电路基础模型(CFMs)。本文全面综述了电路基础模型的最新进展,涵盖了超过130项相关研究,其中超过90%的工作发表于2022年或之后,这表明这一新兴研究趋势在短时间内已受到广泛关注。在本综述中,我们建议将所有现有的电路基础模型大致分为两类:1)基于编码器的方法,用于执行电路表示的泛化学习以应对预测任务;2)基于解码器的方法,利用大型语言模型(LLMs)完成生成任务。对于我们介绍的各项工作,本文详细讨论了它们的输入模态、模型架构、预训练策略、领域适应技术以及下游设计应用。此外,本文还讨论了从数据角度观察到的电路独特特性,这些特性激发了该领域大量的研究工作,并将这些工作与通用AI技术区分开来。最后,我们分享了在发展面向EDA方法论的基础AI模型过程中所观察到的挑战和未来潜在的研究方向。

人工智能(AI)驱动的电子设计自动化(EDA)技术已在VLSI电路设计应用中被广泛探索。最近,针对电路的基础AI模型作为一项新兴技术趋势开始崭露头角。与传统的面向特定任务的AI解决方案不同,这些新型AI模型的发展经历了两个阶段:1)在大量无标签数据上通过自监督预训练以学习电路的内在特性;2)针对具体下游应用进行高效的微调,例如早期设计质量评估、电路相关上下文生成以及功能验证。这一新范式带来了诸多优势:模型的泛化能力、对标注电路数据依赖的降低、高效适应新任务以及前所未有的生成能力。本文提出将采用这一新范式开发的AI模型称为电路基础模型(CFMs)。本文全面综述了电路基础模型的最新进展,涵盖了超过130项相关研究,其中超过90%的工作发表于2022年或之后,这表明这一新兴研究趋势在短时间内已受到广泛关注。在本综述中,我们建议将所有现有的电路基础模型大致分为两类:1)基于编码器的方法,用于执行电路表示的泛化学习以应对预测任务;2)基于解码器的方法,利用大型语言模型(LLMs)完成生成任务。对于我们介绍的各项工作,本文详细讨论了它们的输入模态、模型架构、预训练策略、领域适应技术以及下游设计应用。此外,本文还讨论了从数据角度观察到的电路独特特性,这些特性激发了该领域大量的研究工作,并将这些工作与通用AI技术区分开来。最后,我们分享了在发展面向EDA方法论的基础AI模型过程中所观察到的挑战和未来潜在的研究方向。![]() 1 引言集成电路(IC)是我们信息社会的基础。其复杂度一直在持续增长,最近的复杂度已超过1000亿个晶体管 [1]。IC复杂度的提高导致IC设计成本飞涨,据估计,3nm技术的成本将超过5亿美元 [2]。这些挑战迫切需要提升IC设计效率,而这一目标有可能通过开创性的下一代电子设计自动化(EDA)技术实现。学术界和工业界的许多EDA从业者对在IC设计和EDA技术中应用新兴的人工智能(AI)或机器学习(ML)方法寄予厚望,目标是实现更敏捷的设计,以降低IC设计成本、减少人工投入,并缩短设计周期。近年来,针对芯片设计的AI技术,也被称为EDA的AI/ML或AI辅助EDA [3, 4],因其能够借用先前电路设计数据中的知识而被视为一项极具前景的技术。这类基于AI的EDA技术亦被引入商业EDA工具中 [5, 6]。各种ML模型可以被训练用以对电路提前进行预测或优化,从而绕过耗时的下游设计和仿真步骤。通过从先前的设计方案中学习,ML模型能够在设计早期进行电路质量评估,从而指导早期设计优化。现有的EDA领域AI技术已被广泛探索,几乎涵盖了标准VLSI设计的所有阶段(例如:架构阶段、高级综合(HLS)代码、寄存器传输级(RTL)代码、门级网表、布局后置、时钟树以及后布线布局)和所有主要的电路设计目标(例如:时序、功耗、面积、拥塞、IR压降、信号完整性及功能性)。面向EDA/芯片设计的基础AI:一种新趋势与我们的关注点最近,自然语言处理(NLP)和计算机视觉(CV)领域中的通用基础AI模型(例如BERT [7]、CLIP [8]、DALLE [9]和ChatGPT [10])纷纷涌现,代表了AI技术的一大飞跃。这些基础模型以其庞大的模型规模和广泛的应用范围为特点,展示了其卓越的理解、预测以及生成内容的能力 [11]。相比之下,以往在电路领域的AI应用远远落后于对自然语言和图像的充分探索。这促使了最新趋势,即探索面向EDA技术及电路设计应用的基础AI模型。针对EDA的基础AI相关工作在模型泛化、少样本学习和生成任务方面展示了前所未有的能力。这些模型通常采用两阶段范式:首先在大规模数据集上预训练,然后针对具体应用进行微调,从而显著增强模型在各种EDA任务中的适应能力。它们的巨大潜力已吸引了EDA社区的广泛关注。一些具有代表性的工作 [12–15] 自发布以来引用率相对较高,明显高于普通EDA文献。然而,目前尚缺乏对这一系列最新工作系统性定义、分析或综述,这在讨论社区内的多个概念时(例如:大型电路模型 vs. LLM辅助设计 vs. 用于EDA的AI代理)造成了一定混淆。在本综述中,我们将覆盖所有代表性的面向EDA的基础AI工作,并提议将这类工作称为电路基础模型(CFMs)。图2展示了现有电路基础模型的演化树,包括基于编码器和基于解码器的两大范式。本文还从我们的视角探讨了CFMs的潜力与挑战。第一部分结构说明在本引言中,我们首先在1.1节提出了我们对现有EDA领域AI技术的分类法,将所有现有AI for EDA技术归纳为两大类。接着,在1.2节中简要介绍了已被广泛研究的类型I技术(面向EDA的监督式AI),并在1.3节详细阐述了新兴的类型II技术(面向EDA的基础AI,也是本综述的重点)。之后,在1.4节中,我们将总结现有涵盖类似主题的所有综述,并阐述本综述的贡献。在1.5节中,我们将介绍整篇综述论文的整体结构。

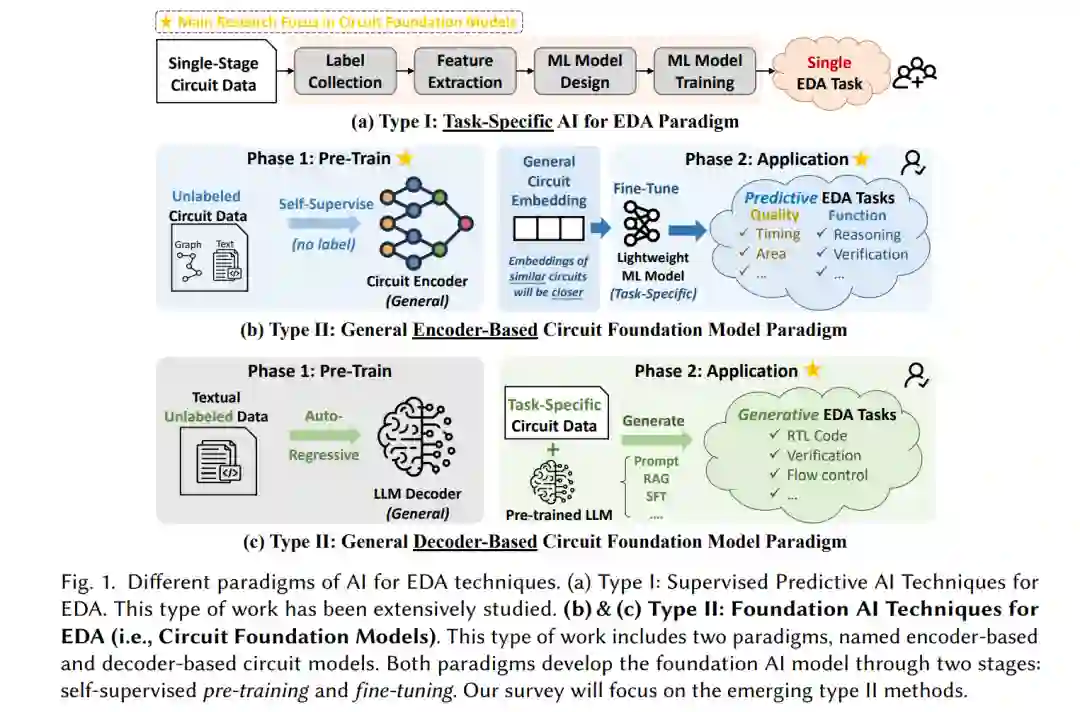

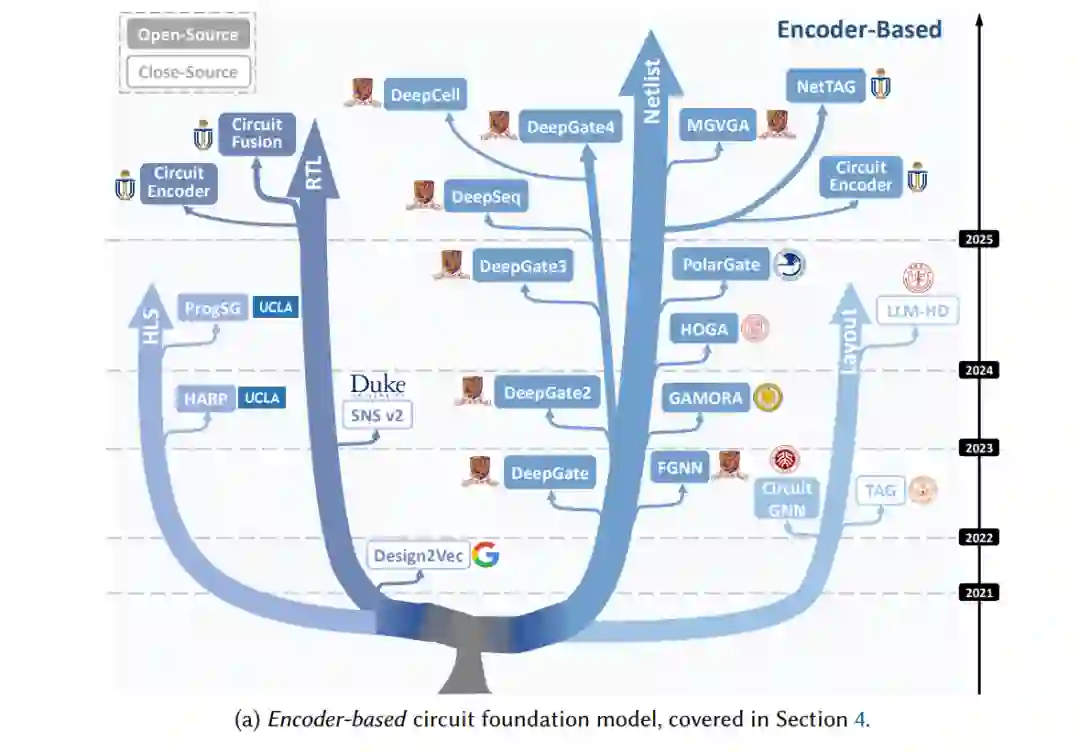

1 引言集成电路(IC)是我们信息社会的基础。其复杂度一直在持续增长,最近的复杂度已超过1000亿个晶体管 [1]。IC复杂度的提高导致IC设计成本飞涨,据估计,3nm技术的成本将超过5亿美元 [2]。这些挑战迫切需要提升IC设计效率,而这一目标有可能通过开创性的下一代电子设计自动化(EDA)技术实现。学术界和工业界的许多EDA从业者对在IC设计和EDA技术中应用新兴的人工智能(AI)或机器学习(ML)方法寄予厚望,目标是实现更敏捷的设计,以降低IC设计成本、减少人工投入,并缩短设计周期。近年来,针对芯片设计的AI技术,也被称为EDA的AI/ML或AI辅助EDA [3, 4],因其能够借用先前电路设计数据中的知识而被视为一项极具前景的技术。这类基于AI的EDA技术亦被引入商业EDA工具中 [5, 6]。各种ML模型可以被训练用以对电路提前进行预测或优化,从而绕过耗时的下游设计和仿真步骤。通过从先前的设计方案中学习,ML模型能够在设计早期进行电路质量评估,从而指导早期设计优化。现有的EDA领域AI技术已被广泛探索,几乎涵盖了标准VLSI设计的所有阶段(例如:架构阶段、高级综合(HLS)代码、寄存器传输级(RTL)代码、门级网表、布局后置、时钟树以及后布线布局)和所有主要的电路设计目标(例如:时序、功耗、面积、拥塞、IR压降、信号完整性及功能性)。面向EDA/芯片设计的基础AI:一种新趋势与我们的关注点最近,自然语言处理(NLP)和计算机视觉(CV)领域中的通用基础AI模型(例如BERT [7]、CLIP [8]、DALLE [9]和ChatGPT [10])纷纷涌现,代表了AI技术的一大飞跃。这些基础模型以其庞大的模型规模和广泛的应用范围为特点,展示了其卓越的理解、预测以及生成内容的能力 [11]。相比之下,以往在电路领域的AI应用远远落后于对自然语言和图像的充分探索。这促使了最新趋势,即探索面向EDA技术及电路设计应用的基础AI模型。针对EDA的基础AI相关工作在模型泛化、少样本学习和生成任务方面展示了前所未有的能力。这些模型通常采用两阶段范式:首先在大规模数据集上预训练,然后针对具体应用进行微调,从而显著增强模型在各种EDA任务中的适应能力。它们的巨大潜力已吸引了EDA社区的广泛关注。一些具有代表性的工作 [12–15] 自发布以来引用率相对较高,明显高于普通EDA文献。然而,目前尚缺乏对这一系列最新工作系统性定义、分析或综述,这在讨论社区内的多个概念时(例如:大型电路模型 vs. LLM辅助设计 vs. 用于EDA的AI代理)造成了一定混淆。在本综述中,我们将覆盖所有代表性的面向EDA的基础AI工作,并提议将这类工作称为电路基础模型(CFMs)。图2展示了现有电路基础模型的演化树,包括基于编码器和基于解码器的两大范式。本文还从我们的视角探讨了CFMs的潜力与挑战。第一部分结构说明在本引言中,我们首先在1.1节提出了我们对现有EDA领域AI技术的分类法,将所有现有AI for EDA技术归纳为两大类。接着,在1.2节中简要介绍了已被广泛研究的类型I技术(面向EDA的监督式AI),并在1.3节详细阐述了新兴的类型II技术(面向EDA的基础AI,也是本综述的重点)。之后,在1.4节中,我们将总结现有涵盖类似主题的所有综述,并阐述本综述的贡献。在1.5节中,我们将介绍整篇综述论文的整体结构。![]()

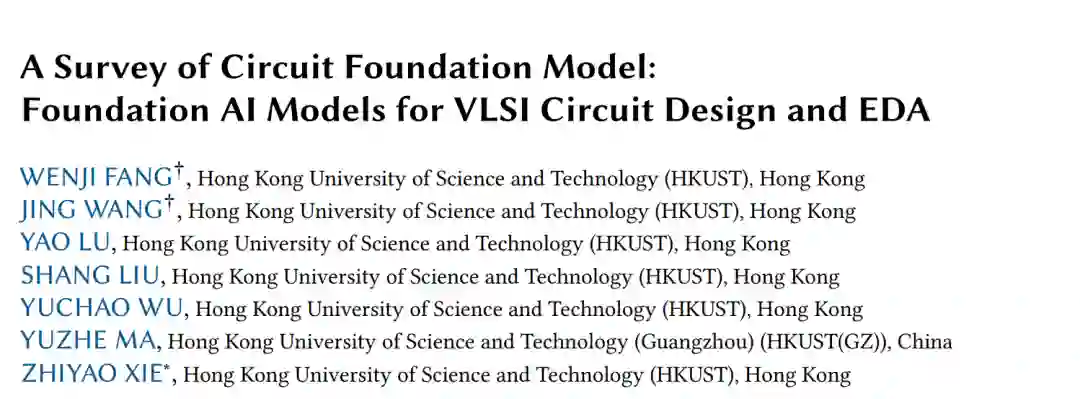

![]() 1.1 我们对EDA领域AI技术的分类:两种不同类型在本综述中,我们建议将现有的EDA领域AI技术分为以下两大类。图1总结并对比了这两类工作的三种范式。类型I:面向EDA的监督式预测AI技术。此前大多数EDA领域AI解决方案采用的主流范式是监督式预测AI模型。这些监督式预测模型已针对各种应用进行了开发,包括早期设计质量预测、快速设计质量仿真、设计空间探索等。相关工作在现有综述 [3, 4] 以及相关专著 [16] 中均有大量讨论。类型II:面向EDA的基础AI技术(电路基础模型)。这一趋势技术是本综述的重点。根据我们提出的定义,基础AI解决方案的发展涉及两个阶段:1)预训练阶段;2)微调阶段。第一阶段通常是在大量无标签数据上进行自监督预训练,使AI模型学习更通用的电路内在模式;随后的微调阶段则能高效使模型适应具体的EDA任务。图1(b)和1(c)分别展示了电路基础模型的两种不同范式。我们将这两种范式纳入电路基础模型的范畴:基于编码器的电路基础模型。这种主要范式通过电路表示学习来支持预测任务。它们通常将电路设计编码为一个包含丰富电路信息的通用嵌入向量,该嵌入向量随后作为轻量级下游模型在各种EDA应用中的输入。基于解码器的电路基础模型。另一主要范式是执行解码任务,从而支持生成任务。它们通常采用基于解码器的大型语言模型(LLMs),以协助生成诸如设计HLS或RTL代码、设计功能描述、验证断言、EDA工具脚本等电路相关内容。1.2 类型I:面向EDA的监督式预测AI技术(前期综述已覆盖)现有的EDA领域AI方法大多针对特定任务而定制,例如对各类设计质量指标的早期预测(例如:时序 [17–22]、面积 [23–26]、功耗 [27–35]、IR压降 [36–40]、布线性 [41–47]、串扰 [48–50]以及可制造性 [51–53])或对用于验证的电路功能进行推理 [54–58]。此外,针对电路优化任务(例如流调优 [59–61]、设计空间探索 [62–64]、设计质量优化 [65, 66])也在很大程度上依赖于电路质量预测来提供反馈。如图1(a)所示,这些方法通常通过监督训练开发,即需要大量标签数据的收集、模型定制和针对每项任务的模型开发。尽管这种主流的监督式范式效果显著,但其存在以下几个内在局限性:获取足够标签数据的困难。通常难以积累足够的带标签训练数据:(1)许多粗粒度预测任务仅提供极少量标签。例如,在预测网表的布局面积时,每个电路布局仅有一个标签(即其布局面积);(2)标签生成过程本质上非常耗时。矛盾在于,大多数预测AI模型是为了绕过最耗时的设计/仿真步骤而训练的,而正是这些最慢的步骤用于收集标签。AI模型开发过程耗时。针对特定任务的监督式解决方案的开发过程繁琐且耗时,包括电路数据收集、标签生成、特征工程、模型架构设计、模型训练及测试。整个过程往往需要数月的工程投入。任务间泛化能力不足。由于监督式任务定制模型无法直接泛化到其他任务,导致需要重复且低效地开发ML解决方案。此外,从方法论角度讲,这也意味着这些监督式ML解决方案仅仅学习了任务特定的模式,而未能理解目标电路设计的更通用知识。鉴于篇幅限制以及类型I工作数量众多,本综述不会对所有先前的类型I工作进行详尽讨论。关于类型I监督式预测工作的更全面列表,读者可参考先前综述 [3, 4] 以及由该领域众多研究者合著的专著 [16]。1.3 类型II:面向EDA的基础AI技术(本文重点关注)本综述聚焦于面向EDA的新兴基础AI技术。正如图1(b)和1(c)所示,这一类技术利用预训练的电路基础AI模型(简称电路基础模型),仅需少量任务特定的带标签电路数据即可进行高效微调。与传统特定任务的监督式EDA解决方案相比,类型II技术具有显著优势:学习无标签电路内在特性。电路基础模型通常在大量无标签数据上进行预训练,使其能够捕捉电路的内在信息,而无需昂贵的带标签数据集。高效微调以解决EDA任务。预训练良好的模型仅需少量标签数据便可进行微调,显著减少了从零开始训练模型所需的时间和资源。跨多任务的泛化能力。基础模型学习到的一般电路内在特性可以适用于多种任务,使模型具有较强的通用性,从而减少了重复开发针对特定任务模型的需求。EDA任务上前所未有的生成能力。部分电路基础模型展现出了出色的生成能力,能够前所未有地自动化诸如电路代码生成、验证断言生成和设计流程脚本生成等任务。这些模型不仅局限于传统预测任务,而且能够推动创新的AI驱动解决方案,提升设计生产率并简化电路开发流程。基于编码器的电路基础模型图1(b)展示了电路编码器的范式。电路编码器将不同的电路模态(例如图结构或文本格式)转换为包含丰富内在电路属性的通用嵌入向量。这些编码器通常在电路数据上进行预训练。由于电路数据相较于已广泛研究的图像或自然语言具有独特性,编码器模型必须经过专门定制以处理电路数据。研究工作主要集中在以下两个方面:(1)第一阶段,开发专门的ML架构和预训练技术,有效捕捉电路语义、结构信息及物理属性;(2)第二阶段,利用预训练的电路编码器支持各种预测型EDA任务,包括设计质量评估和功能推理。在本综述中,我们将系统地按照各自的设计阶段对现有电路编码器进行分类,并对其所支持的下游任务进行全面分析。基于解码器的电路基础模型图1(c)展示了解码器范式。电路解码器通常采用大型语言模型(LLMs)作为其骨干,这些LLM通常在跨领域的大规模文本数据集上进行了充分预训练。借助于强大的预训练LLM,电路解码器主要聚焦于电路相关生成任务的领域适应,如提示工程、微调、检索增强生成(RAG)等。在本综述中,我们根据不同应用领域对现有基于解码器的方法进行分类,涵盖了电路代码生成、验证、设计流程自动化等关键领域,并对各类别中的代表性基准、模型开发技术和最新进展进行了分析。编码器与解码器模型之间的关键区别电路模态作为输入:编码器主要处理基于图结构的电路数据,如网表和控制数据流图,常利用图学习模型;部分近期工作整合了多模态学习,将结构化图信息与文本描述结合。而解码器则侧重于处理基于文本的格式,如HDL代码和自然语言规范,利用LLM进行解读和生成。电路学习技术:编码器需要在电路数据上进行专门定制的预训练和微调,通常从零开始构建基于图AI模型,因而缺乏统一的电路编码架构,导致模型设计和自监督学习技术多种多样。而解码器通常依赖于在大规模文本数据上已充分预训练的LLM,相关工作依托于公共领域中已有的预训练LLM,包括开源(例如Llama、Mistral、DeepSeek)以及商业版本(例如GPT-3.5、GPT-4)等,通过提示工程、微调和检索增强生成技术实现对电路领域的适应。目标下游任务:编码器主要支持预测任务,如利用编码后的电路嵌入进行设计质量评估和功能推理;而解码器则主要面向生成任务,如电路代码生成、验证自动化以及设计流程生成等。

1.1 我们对EDA领域AI技术的分类:两种不同类型在本综述中,我们建议将现有的EDA领域AI技术分为以下两大类。图1总结并对比了这两类工作的三种范式。类型I:面向EDA的监督式预测AI技术。此前大多数EDA领域AI解决方案采用的主流范式是监督式预测AI模型。这些监督式预测模型已针对各种应用进行了开发,包括早期设计质量预测、快速设计质量仿真、设计空间探索等。相关工作在现有综述 [3, 4] 以及相关专著 [16] 中均有大量讨论。类型II:面向EDA的基础AI技术(电路基础模型)。这一趋势技术是本综述的重点。根据我们提出的定义,基础AI解决方案的发展涉及两个阶段:1)预训练阶段;2)微调阶段。第一阶段通常是在大量无标签数据上进行自监督预训练,使AI模型学习更通用的电路内在模式;随后的微调阶段则能高效使模型适应具体的EDA任务。图1(b)和1(c)分别展示了电路基础模型的两种不同范式。我们将这两种范式纳入电路基础模型的范畴:基于编码器的电路基础模型。这种主要范式通过电路表示学习来支持预测任务。它们通常将电路设计编码为一个包含丰富电路信息的通用嵌入向量,该嵌入向量随后作为轻量级下游模型在各种EDA应用中的输入。基于解码器的电路基础模型。另一主要范式是执行解码任务,从而支持生成任务。它们通常采用基于解码器的大型语言模型(LLMs),以协助生成诸如设计HLS或RTL代码、设计功能描述、验证断言、EDA工具脚本等电路相关内容。1.2 类型I:面向EDA的监督式预测AI技术(前期综述已覆盖)现有的EDA领域AI方法大多针对特定任务而定制,例如对各类设计质量指标的早期预测(例如:时序 [17–22]、面积 [23–26]、功耗 [27–35]、IR压降 [36–40]、布线性 [41–47]、串扰 [48–50]以及可制造性 [51–53])或对用于验证的电路功能进行推理 [54–58]。此外,针对电路优化任务(例如流调优 [59–61]、设计空间探索 [62–64]、设计质量优化 [65, 66])也在很大程度上依赖于电路质量预测来提供反馈。如图1(a)所示,这些方法通常通过监督训练开发,即需要大量标签数据的收集、模型定制和针对每项任务的模型开发。尽管这种主流的监督式范式效果显著,但其存在以下几个内在局限性:获取足够标签数据的困难。通常难以积累足够的带标签训练数据:(1)许多粗粒度预测任务仅提供极少量标签。例如,在预测网表的布局面积时,每个电路布局仅有一个标签(即其布局面积);(2)标签生成过程本质上非常耗时。矛盾在于,大多数预测AI模型是为了绕过最耗时的设计/仿真步骤而训练的,而正是这些最慢的步骤用于收集标签。AI模型开发过程耗时。针对特定任务的监督式解决方案的开发过程繁琐且耗时,包括电路数据收集、标签生成、特征工程、模型架构设计、模型训练及测试。整个过程往往需要数月的工程投入。任务间泛化能力不足。由于监督式任务定制模型无法直接泛化到其他任务,导致需要重复且低效地开发ML解决方案。此外,从方法论角度讲,这也意味着这些监督式ML解决方案仅仅学习了任务特定的模式,而未能理解目标电路设计的更通用知识。鉴于篇幅限制以及类型I工作数量众多,本综述不会对所有先前的类型I工作进行详尽讨论。关于类型I监督式预测工作的更全面列表,读者可参考先前综述 [3, 4] 以及由该领域众多研究者合著的专著 [16]。1.3 类型II:面向EDA的基础AI技术(本文重点关注)本综述聚焦于面向EDA的新兴基础AI技术。正如图1(b)和1(c)所示,这一类技术利用预训练的电路基础AI模型(简称电路基础模型),仅需少量任务特定的带标签电路数据即可进行高效微调。与传统特定任务的监督式EDA解决方案相比,类型II技术具有显著优势:学习无标签电路内在特性。电路基础模型通常在大量无标签数据上进行预训练,使其能够捕捉电路的内在信息,而无需昂贵的带标签数据集。高效微调以解决EDA任务。预训练良好的模型仅需少量标签数据便可进行微调,显著减少了从零开始训练模型所需的时间和资源。跨多任务的泛化能力。基础模型学习到的一般电路内在特性可以适用于多种任务,使模型具有较强的通用性,从而减少了重复开发针对特定任务模型的需求。EDA任务上前所未有的生成能力。部分电路基础模型展现出了出色的生成能力,能够前所未有地自动化诸如电路代码生成、验证断言生成和设计流程脚本生成等任务。这些模型不仅局限于传统预测任务,而且能够推动创新的AI驱动解决方案,提升设计生产率并简化电路开发流程。基于编码器的电路基础模型图1(b)展示了电路编码器的范式。电路编码器将不同的电路模态(例如图结构或文本格式)转换为包含丰富内在电路属性的通用嵌入向量。这些编码器通常在电路数据上进行预训练。由于电路数据相较于已广泛研究的图像或自然语言具有独特性,编码器模型必须经过专门定制以处理电路数据。研究工作主要集中在以下两个方面:(1)第一阶段,开发专门的ML架构和预训练技术,有效捕捉电路语义、结构信息及物理属性;(2)第二阶段,利用预训练的电路编码器支持各种预测型EDA任务,包括设计质量评估和功能推理。在本综述中,我们将系统地按照各自的设计阶段对现有电路编码器进行分类,并对其所支持的下游任务进行全面分析。基于解码器的电路基础模型图1(c)展示了解码器范式。电路解码器通常采用大型语言模型(LLMs)作为其骨干,这些LLM通常在跨领域的大规模文本数据集上进行了充分预训练。借助于强大的预训练LLM,电路解码器主要聚焦于电路相关生成任务的领域适应,如提示工程、微调、检索增强生成(RAG)等。在本综述中,我们根据不同应用领域对现有基于解码器的方法进行分类,涵盖了电路代码生成、验证、设计流程自动化等关键领域,并对各类别中的代表性基准、模型开发技术和最新进展进行了分析。编码器与解码器模型之间的关键区别电路模态作为输入:编码器主要处理基于图结构的电路数据,如网表和控制数据流图,常利用图学习模型;部分近期工作整合了多模态学习,将结构化图信息与文本描述结合。而解码器则侧重于处理基于文本的格式,如HDL代码和自然语言规范,利用LLM进行解读和生成。电路学习技术:编码器需要在电路数据上进行专门定制的预训练和微调,通常从零开始构建基于图AI模型,因而缺乏统一的电路编码架构,导致模型设计和自监督学习技术多种多样。而解码器通常依赖于在大规模文本数据上已充分预训练的LLM,相关工作依托于公共领域中已有的预训练LLM,包括开源(例如Llama、Mistral、DeepSeek)以及商业版本(例如GPT-3.5、GPT-4)等,通过提示工程、微调和检索增强生成技术实现对电路领域的适应。目标下游任务:编码器主要支持预测任务,如利用编码后的电路嵌入进行设计质量评估和功能推理;而解码器则主要面向生成任务,如电路代码生成、验证自动化以及设计流程生成等。![]()

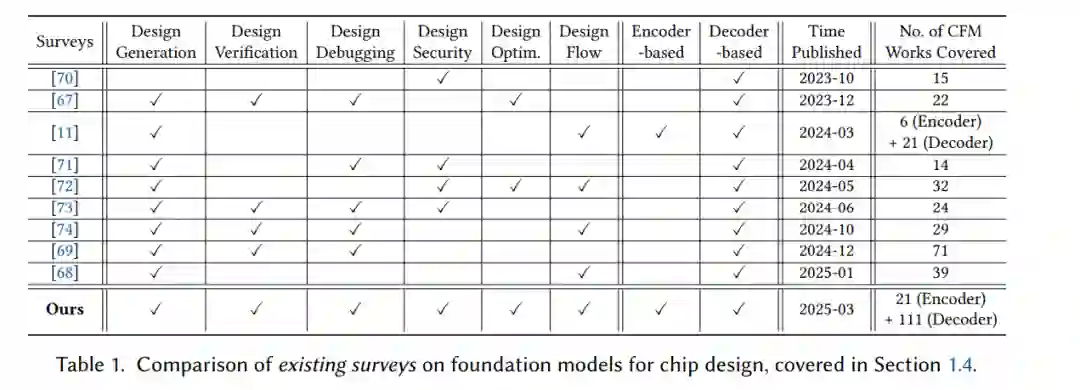

**1.4 现有相关综述与本论文的对比

表1对比了所有关于面向电路应用的基础AI模型的现有综述文章 [11, 67–73]。值得注意的是,几乎所有综述 [67–73] 都仅聚焦于基于解码器的模型(即用于EDA的LLM)。这一趋势反映了LLM技术的快速演进及其在生成型EDA任务(例如HDL代码生成、验证、调试等)中的巨大潜力。在这些关于EDA领域基于解码器LLM的综述中,有些综述 [67–69] 尝试对多个相关任务进行全面回顾,而另一些综述 [70–73] 则聚焦于某一特定主题,主要关注电路安全方面。唯一的例外是一篇由多位EDA研究者共同署名的特殊视角论文 [11],该论文倡导构建一个涵盖多个设计阶段、彼此对齐的基于编码器的基础模型框架。这一设想被命名为大型电路模型(LCM) [11]。 与现有的综述不同,我们的综述论文同时涵盖了基于编码器和基于解码器的电路基础模型,对两种范式的异同进行了分析。表1还统计了各综述中涉及的与CFM相关的工作数目。我们仅统计了处于电路基础模型范畴内的工作(即针对电路设计任务的预训练和微调AI模型)。部分由于这一新兴方向的快速发展,大多数现有综述仅涵盖了少于40个相关工作。相比之下,我们的综合综述前所未有地介绍了最多(即超过130个)相关工作,涵盖了表1列出的所有关键电路设计任务。下面我们简要介绍每篇现有综述,并重点阐述本研究的独特贡献。 关于涵盖广泛任务的基于解码器模型的综述。

LLM4EDA [67] 是一篇较早的综合性回顾,涵盖了诸如基于聊天机器人的方法、电路代码和脚本生成以及电路验证等多种EDA任务。然而,由于其发表于2023年且该方向发展迅速,综述中仅收录了22个相关工作。Xu等人 [74] 总结了29项关于电路代码生成、调试、验证和物理实现的早期研究。虽然该综述为这些领域提供了一定的见解,但缺乏对最新进展以及诸如安全、设计优化、体系结构设计等更广泛主题的覆盖。Abdollahi等人 [69] 提供了更为广泛的综述,分析了71项关于LLM辅助电路设计的研究,涵盖了电路生成、验证和调试等应用。不过,由于其自动化文献筛选流程,我们发现该综述中存在一些描述错误。例如,[69] 错误地将 [75–77] 的工作归类为LLM辅助设计方法,而实际上这些工作主要关注于加速LLM(即设计硬件加速器)。Pan等人 [68] 最近的一篇综述回顾了LLM在EDA中的应用。尽管其较为新近,但其涵盖的工作数量仍有限(39个工作),主要侧重于设计生成和设计流程自动化,对设计验证、安全、体系结构设计以及模拟任务等方面缺乏更广泛的讨论。 关于针对特定任务的基于解码器模型的综述。

除了针对广泛EDA应用的综述外,还有另一系列综述 [70–73] 专门聚焦于采用LLM辅助技术的电路安全主题。Saha等人 [70] 在2023年率先讨论了将LLM集成到SoC安全验证范式中的问题。由于当时针对SoC安全定制的专门LLM方案较少,该工作主要总结了将通用LLM技术应用于硬件安全任务的情况。到2024年,有三篇较短的综述(均不足7页) [71–73] 回顾了用于硬件安全的LLM方法,每篇涵盖了10到30个相关工作。 关于LCM的视角论文。

2024年,一篇由多位EDA研究者共同署名的特殊视角论文 [11] 提出了一个有趣而雄心勃勃的大型电路模型(LCM)概念。该LCM可视为一个涵盖多个设计阶段、基于编码器的电路基础模型构成的设想框架。该论文同时回顾了监督式面向特定任务的AI解决方案和EDA领域的基础AI模型(即6个编码器和21个解码器),识别了开发大规模电路编码器所面临的关键挑战,并为基于编码器的电路基础模型的未来进展奠定了基础。 本综述与现有综述的主要贡献可总结如下:

本综述提出了电路基础模型的概念,整合了基于编码器的电路表示学习技术和基于解码器的EDA专用LLM到一个统一框架中,从而实现了两种范式之间的对比。 1. 本综合综述系统地介绍了超过130项相关工作,涵盖了所有在现有综述 [11, 67–73] 中引用的电路基础模型。 1. 其中,21个基于编码器的模型覆盖了所有标准设计阶段,包括HLS、RTL、网表和布局阶段,以及它们所支持的预测型EDA任务。 1. 111个基于解码器的模型涵盖了所有主流EDA应用,包括VLSI电路代码处理(生成、优化、验证及调试)、硬件安全、设计流程自动化、物理设计、体系结构设计及模拟设计。 1. 除了对这些方法进行深入分析外,我们还重点讨论了关键的进展、所面临的挑战以及未来可能的研究方向,以进一步提升电路基础模型在现代VLSI设计自动化中的作用。

本综述尽可能覆盖了处于电路基础模型范围内的所有出版物,包括期刊、会刊、会议及研讨会论文、学位论文和预印本。然而,对于篇幅非常短(例如,3页或以下)的文章(如最新成果或实验报告),可能未予以收录。对于同一工作存在多个版本且可能拥有不同标题的情况,我们将避免重复引用,并倾向于引用最新版本。在统计出版日期时,我们以该工作首次公开发布的日期为准。

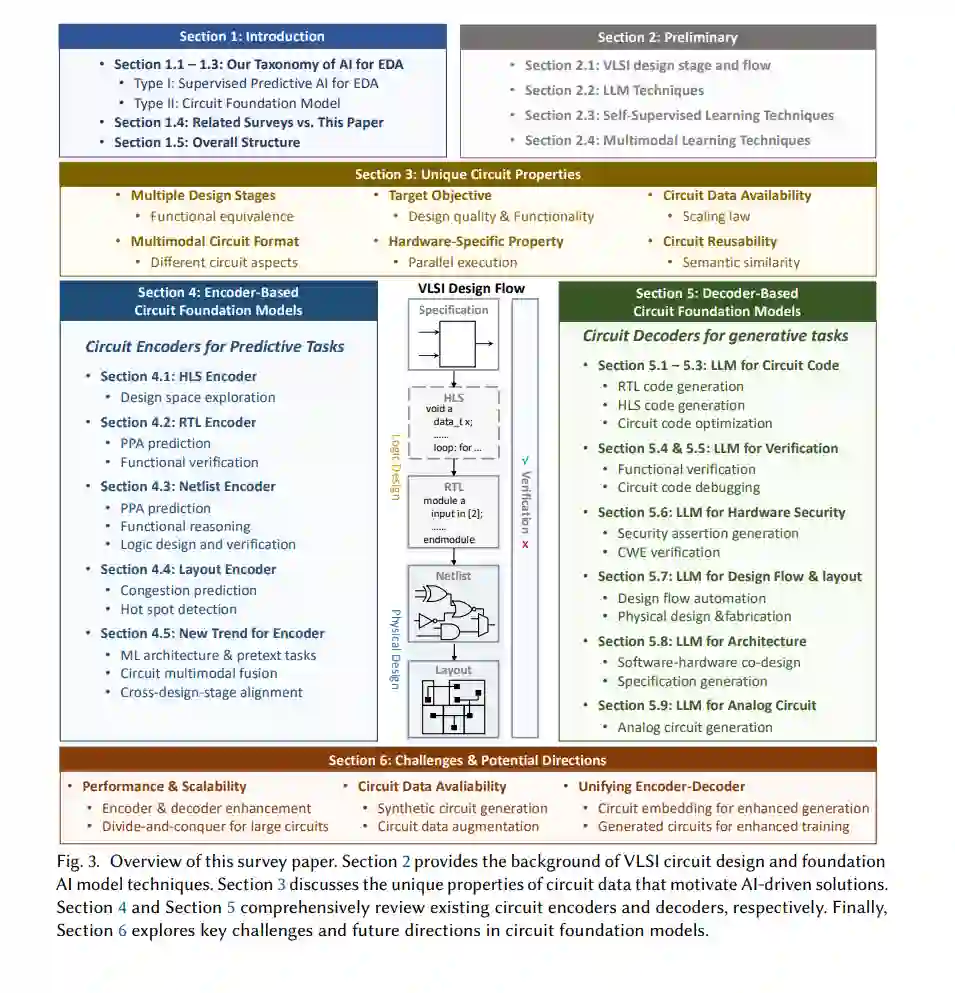

**1.5 本综述论文的整体结构

图3展示了本文的整体结构。 * 第2节:我们将总结相关的基础知识,涵盖标准VLSI电路设计流程(第2.1节)以及通用基础AI模型的基本技术,包括LLM技术(第2.2节)、自监督学习技术(第2.3节)和多模态学习技术(第2.4节)。 * 第3节:介绍我们观察到的电路数据的独特属性。这些属性在很大程度上激发了本综述中众多CFM工作的产生,并使这些工作有别于其他领域(如CV、NLP)的通用AI解决方案。 * 第4节:全面介绍现有的基于编码器的电路基础模型,涵盖了HLS阶段(第4.1节)、RTL阶段(第4.2节)、网表阶段(第4.3节)和布局阶段(第4.4节)。新兴的、更加先进的电路编码器技术将在第4.5节中进行讨论。 * 第5节:介绍现有的基于解码器的电路基础模型,涵盖所有应用领域:RTL代码生成(第5.1节)、HLS代码生成(第5.2节)、设计优化(第5.3节)、硬件代码验证(第5.4节)、硬件代码调试(第5.5节)、硬件设计安全(第5.6节)、设计流程自动化和布局设计(第5.7节)、硬件体系结构设计(第5.8节)以及模拟电路设计(第5.9节)。 * 第6节:基于我们的研究经验,我们将分析电路基础模型所面临的挑战与机遇。 ![]()