AAAI 是由国际人工智能促进协会主办的年会,是人工智能领域中历史最悠久、涵盖内容最广泛的国际顶级学术会议之一,也是中国计算机学会(CCF)推荐的 A 类国际学术会议,在人工智能领域享有较高的学术声誉。2024年,AAAI主办地为加拿大温哥华,录用文章2342篇,录用率为23.75%。

“知识不应该只对那些能够支付的人开放”,加州大学教授学术委员会主席罗伯特·梅这样说。同样地,机器学习也不应该只对那些能够支付的人开放。因此,机器学习应该惠及全世界,特别是对非洲和亚洲的发展中国家而言。当数据集大小增长时,获得完美数据(例如,干净、安全、平衡的数据)变得费时费力且昂贵,特别是对发展中国家来说。结果,不完美数据的量变得巨大,例如,带有噪声标签的网络规模图像和语音数据、带有特定噪声的图像、以及长尾分布的数据。然而,标准机器学习假设监督信息完全正确且完整。因此,不完美数据损害了大多数标准学习算法的性能,有时甚至使现有算法崩溃。在这个教程中,我们专注于在面对三种类型的不完美数据时的可信学习:噪声数据、对抗性数据和长尾数据。

概述 噪声数据下的可信学习。有一系列理论和方法被提出来处理噪声数据。据我们所知,标签噪声学习跨越了机器学习的两个重要时代:统计学习(即,浅层学习)和深度学习。在统计学习时代,标签噪声学习侧重于设计耐噪声损失或无偏风险估计器。然而,在深度学习时代,标签噪声学习有更多选项来对抗噪声标签,例如设计有偏风险估计器或利用深度网络的记忆效应。在这个教程中,我们总结了基础知识,并回顾了最新的耐噪声监督技术。通过参加本教程,观众将从统计学习理论、深度学习、典型算法和框架的详细分析以及它们在工业界的实际应用的角度,获得标签噪声学习的广泛知识。

对抗性数据下的可信学习。现有的深度学习技术使得机器学习算法的现实世界部署成为可能。然而,对抗性数据的存在显著降低了使用机器学习算法训练的模型的安全性。为了处理这一风险,研究人员专注于两个方面:在预测/分类前检测对抗性数据(即,对抗性数据检测)和使模型在对抗性数据上泛化得好(即,对抗性训练)。在这个教程中,我们总结了对抗性数据的基础知识和统计属性,并回顾了最新的对抗性数据检测和对抗性训练技术,从统计学和机器学习的角度以及它们在工业界的应用。

长尾数据下的可信学习。长尾学习在许多研究领域如信息检索、计算机视觉和医学数据分析中引起了关注,并开发了一系列方法来处理这个问题。简而言之,这些方法背后的分类可以总结为三类:数据增强、模型个性化和损失设计。所有这些方法都探索了在多数和少数之间的受限权衡,以追求最佳的整体性能。在这个教程中,我们将系统地讨论这三个不同方向的一些基础知识,并给出具体示例,以帮助观众理解长尾学习的过去、现在和未来。

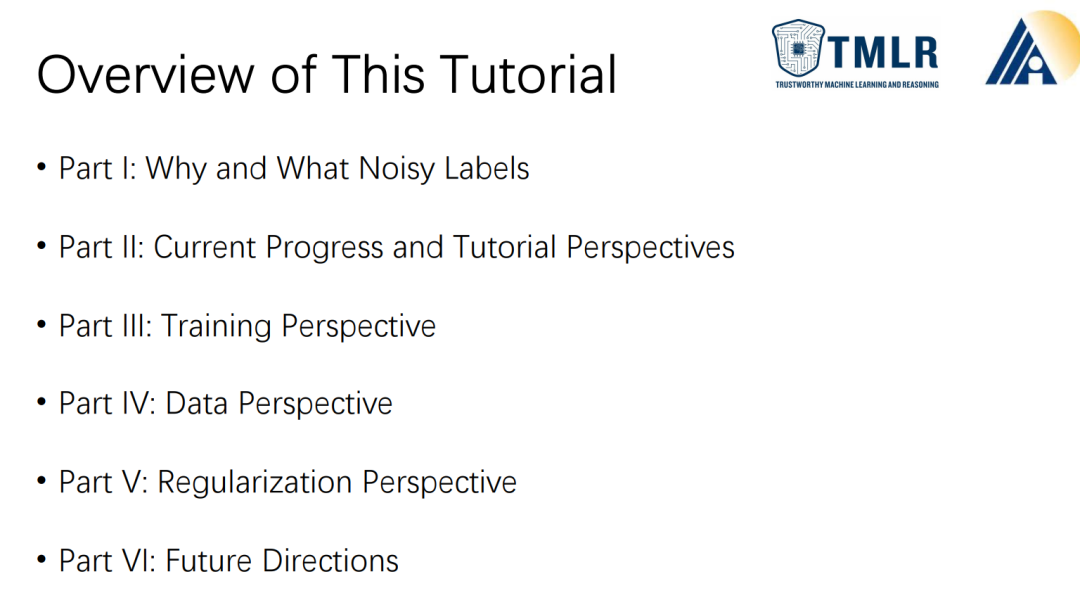

目录内容:

I: Trustworthy Machine Learning Under Noisy Data

摘要:在噪声数据下的可信学习一直是机器学习及相关领域的一个长期问题。本教程的第一部分将从各个方面介绍噪声数据下可信学习的基础知识和最新研究,包括可信统计学习、可信表示学习、应用和理论。在教程开始时,我将简要概述这个领域并解释第一次教程的结构。然后,噪声数据下可信统计学习中的一个基本问题是研究使用噪声数据学习的分类器与使用干净数据学习的分类器之间的差异。如果从噪声数据中学习的分类器与使用干净数据定义的最优分类器一致,则算法是分类器一致的。因此,我们将全面回顾构建分类器一致算法的最新进展。具体来说,我们将深入了解基于鲁棒损失函数的方法和基于转换矩阵的方法的基础知识。最后,使用噪声数据鲁棒地训练深度神经网络是具有挑战性的,因为深度神经网络的容量如此之高,以至于它们可以完全过拟合这些噪声标签。因此,我们将全面回顾最新的可信表示学习进展,即标签噪声表示学习。此外,我们将介绍标签噪声表示学习中的三种代表性技术,如数据视角的“估计噪声转换矩阵”、训练视角的“在选定样本上训练”和正则化视角的“随机整合梯度下降”。

II: Trustworthy Machine Learning Under Adversarial Data

在对抗性数据下的可信学习已成为将机器学习算法部署到现实世界中的关键。本教程的第二部分将从各个方面介绍在对抗性数据下可信学习的基础知识和最新研究,包括可信统计学习、可信表示学习、应用和理论。在这部分的开始,我将简要概述这个领域并解释第二次教程的结构。然后,对抗性数据下可信统计学习中的一个基本问题是研究如何衡量对抗性数据和自然数据之间的差异。有许多方法可以衡量两个分布之间的差异。因此,我们将全面回顾可以用来衡量对抗性和自然数据之间的分布差异的最新统计进展。最后,训练能够在对抗性数据上泛化得很好的模型非常困难。因此,我们将全面回顾与对抗性数据相关的可信学习的最新进展,即对抗性训练。此外,我们将介绍对抗性训练中的两种代表性技术,如非加权对抗性训练和加权对抗性训练。

III: Trustworthy Machine Learning Under Long-tailed Data

近年来,随着在表示、模型集成和损失设计方面的一些新进展,长尾学习在深度学习中得到了复兴。与这个主题相关的广泛研究领域分别促进了长尾学习的发展,具有相似的精神。在这个教程中,我们首先将简要回顾长尾学习的核心问题及其多样化的下游场景。然后,我们将回顾处理长尾学习的经典方法,以及一些来自数据增强、模型集成和损失设计视角的示例方法。最后,我们将讨论长尾学习在弱监督和自监督设置下的一些未来方向。我们希望我们的总结可以帮助观众系统地理解长尾学习的过去、现在和未来。