关于AI,ChatGPT 的文章铺天盖地,但是真正讨论得深度有内容永远稀缺。这次是M小姐第一次正式约稿,来自数据科学大牛,也是B站上小有名气的 Up 主:课代表立正!

我们判断,如果ChatGPT不犯大错,两年内,整个科技行业甚至人类社会都会被颠覆一遍。倒计时已经开始了。 在ChatGPT纪元中,提问题的能力和判断力也许是人类最重要的两个能力。我们这里提出五个关键问题,并且试图抛开网络上的二手观点,做出基于原理的判断。围绕这五个问题,我们会把所需要知道的相关技术背景,尽量简洁,但是尽量无损地总结清楚,不说废话。 哪五个问题?

**- 是什么:**ChatGPT是范式突破,还是过往AI的延伸? **- 会怎样:**ChatGPT两年内会达到什么水准? **- 行业格局:**ChatGPT以及GPT有壁垒吗? **- 如何参与:**我们未来应该如何使用ChatGPT? **- 人文:**人类和ChatGPT的本质区别是什么?对人类社会的冲击?

还有一个不需要讨论的重要问题**:ChatGPT不会开源的**,因为AGI是一个危险品。依赖开源+抄的公司可以死心了。指望原子弹开源吗?我们搞清楚这五个问题,就能判断市面上大多数解读ChatGPT的观点,无论从技术、商业、投资,等等角度,是否靠谱了。其实就两个关键:

- 对ChatGPT新能力的认知:这新能 match 力到底是什么,有多大“不一样”?那个“不一样”能带来多少新的可能性?

- 对“能力获取难度”的认知:ChatGPT如何获得的?别人获取类似能力,难度有多大?

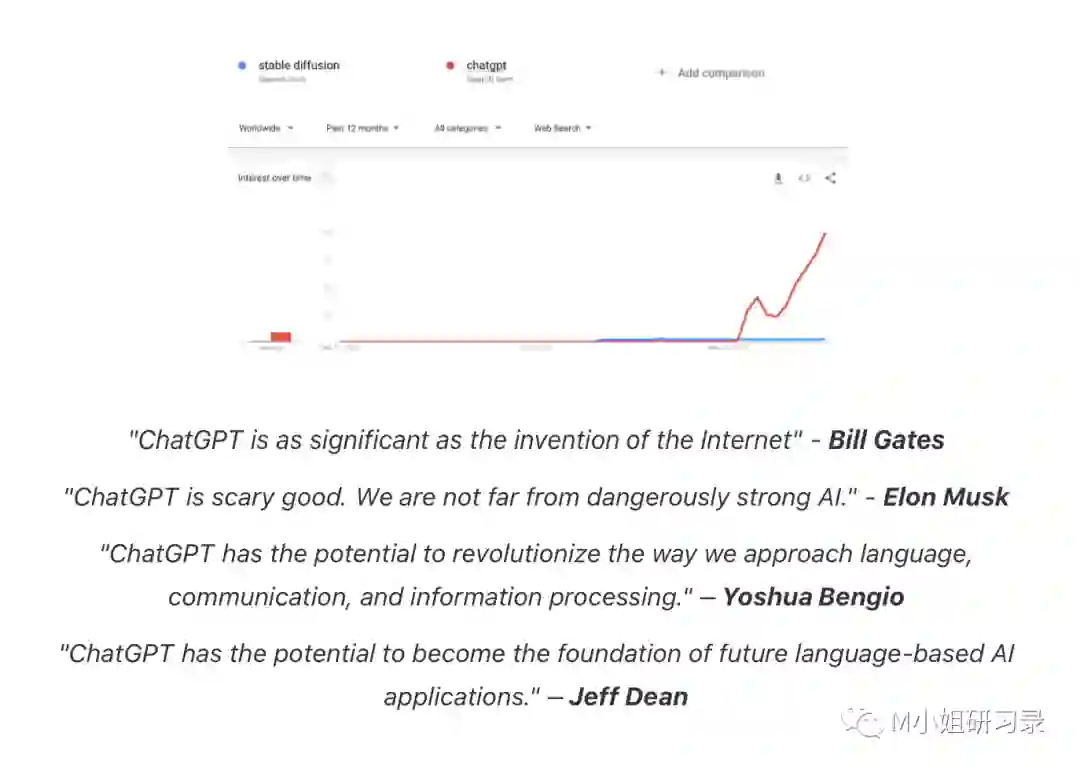

文章结尾我们会做一下总结。让你下次见到某大模型,可以判断这是ChatGPT的80%还是0%。也可以判断自己的工作会被ChatGPT取代多少。 为什么这样问?最近到处都在讨论ChatGPT,宛如6000点时候的A股,但是对于ChatGPT这样一个人类高科技结晶的新物种,不先搞清楚它“是什么”和“如何牛逼的”,那就没有办法形成自己的判断。没有自己基于原理的判断,看ChatGPT就像看元宇宙、Web3、自动驾驶一样,觉得好像牛逼,也有一套看似自洽的逻辑,以及振聋发聩的“洞见”,其实只能被别人牵着走。 搞清楚ChatGPT“是什么”和“如何牛逼的”是一件困难的事情,因为最顶尖的人工智能大佬们也没有达成共识。 比如Meta的AI负责人,深度学习三大佬之一的LeCun就不看好,认为这就是个基于auto-regressive(自回归)的LLM(large language model,大语言模型),从方法上来讲没有啥范式突破。只是因为OpenAI是个创业公司,大家宽容度比较高,ChatGPT在乱说话,大家也能容忍。 另一面,ChatGPT的火热就不说了,比如特斯拉的首席AI科学家就选择回到OpenAI,共建AGI(artificial general intelligence,通用人工智能,也是OpenAI的追求目标);Meta的VR创始人卡马克选择离开Meta,自己开一家AGI公司。另外一篇文章截取了大佬们的赞誉:

1 开头:ChatGPT的最基本版历史

开始问问题之前,有一些必要的技术科普。我们着重参考两篇综述,尽量抓重点:- 大语言模型技术精要(链接)(知乎,by 张俊林)****- ChatGPT的各项超能力从哪里来(链接**)by 符尧****

**

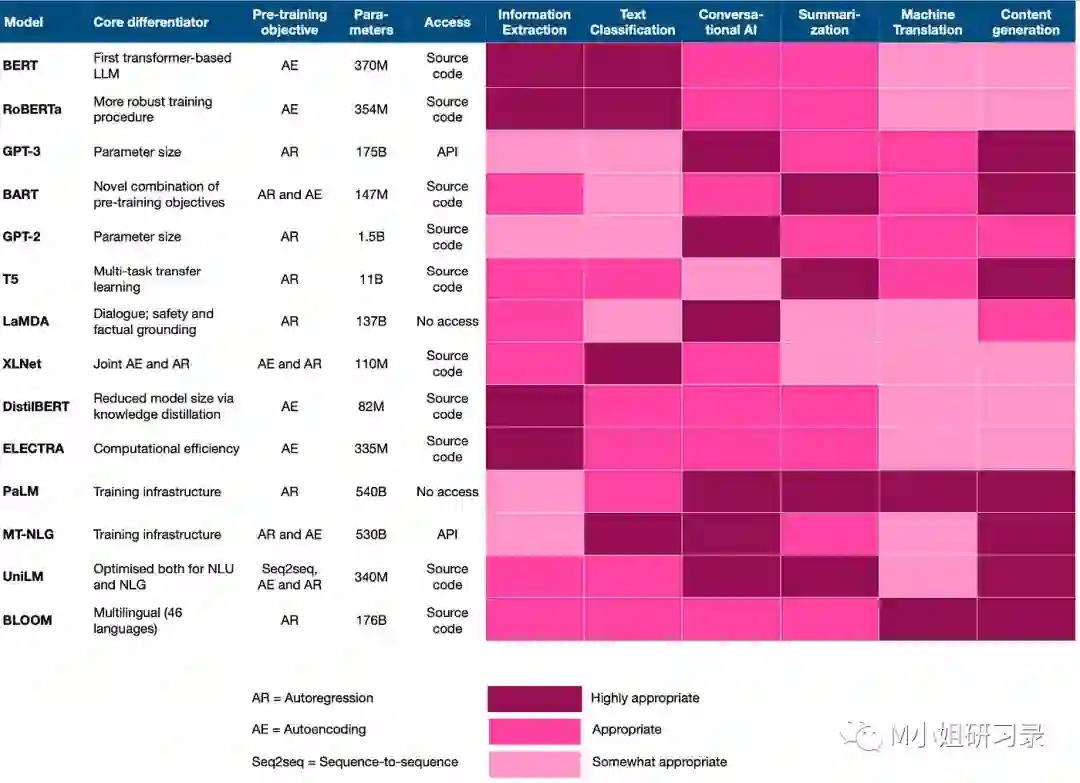

第一份综述主要讲了大语言模型发展中的关键技术突破,第二份综述主要讲了ChatGPT发展过程中的几个重要模型“做到了什么”和“有什么与众不同的做法”。我们把两篇文章的重点挑出来,标注一下里程碑事件,和其意义。 事件

意义

Transformer问世

让深度学习模型可以“自由吸收”数据中的知识 大语言模型突破了参数和算力限制,从此语言模型也进入参数越多,数据越大,模型效果越好的时代。 LLM内战,逐渐吊打老NLP

Google的Bert路线和OpenAI的GPT路线各有所长 GPT通过“自然语言生成任务”,兼容了几乎所有NLP问题;但是Bert比GPT2表现好。此时大语言模型已经开始吊打传统NLP模型了 GPT3问世

展示in-context learning能力,简单调教下就能吊打精调过的很多模型 一方面让GPT模式初现一统江湖的潜质,一方面GPT3的** in-context learning能力,展示了和过往ML的fine-tuning模式的本质区别**,我们在下面单独详细展开 ** - InstructGPT**

ChatGPT的交互模式,让GPT的能力,更加贴近人类真实交互方式 在in-context learning基础之上,进一步降低了prompting的门槛;一定程度解决了GPT-3生成结果与用户期望不一致的非预期输出,大幅降低了有害的、错误或偏差的输出结果,让GPT更符合人类胃口 ** - GPT读代码**

代码训练能力的提升是GPT3到GPT3.5的重要迭代之一,模型可从而可以生成代码和理解代码 Codex模型读了大量代码,之后的GPT3.5模型涌现出了“乌鸦”的能力(第一问详解)。不光能读懂和生成代码,对语言本身的理解和推理能力也解锁了 ** - RLHF**

ChatGPT背后的核心技术之一,让模型学习人类的偏好 全称是reinforcement learning from human feedback,通过构建人类反馈数据集,训练一个reward模型,模仿人类偏好对结果打分,是GPT-3后时代LLM越来越像人类对话的核心技术 ChatGPT

InstructGPT的亲戚,但一些优化方式也带来了ChatGPT的更泛化和准确能力,再次引爆了AIGC ChatGPT总体来说和InstructGPT一样是使用RLHF进行训练,但模型是基于GPT3.5,而且数据设置上也不同。ChatGPT是一个输入,模型给出多个输出,然后人给结果排序,让模型可以学习人类的排序策略,即使是一本正经的胡说八道看起来也很合理的样子。 这里面再强调一个关键点。GPT3之后,很多能力是“涌现”的。即不是线性发展,可预测的,而是突然就有了。至于这对于OpenAI的人是早晚会发生,还是完全未预料,我们就不知道了。**

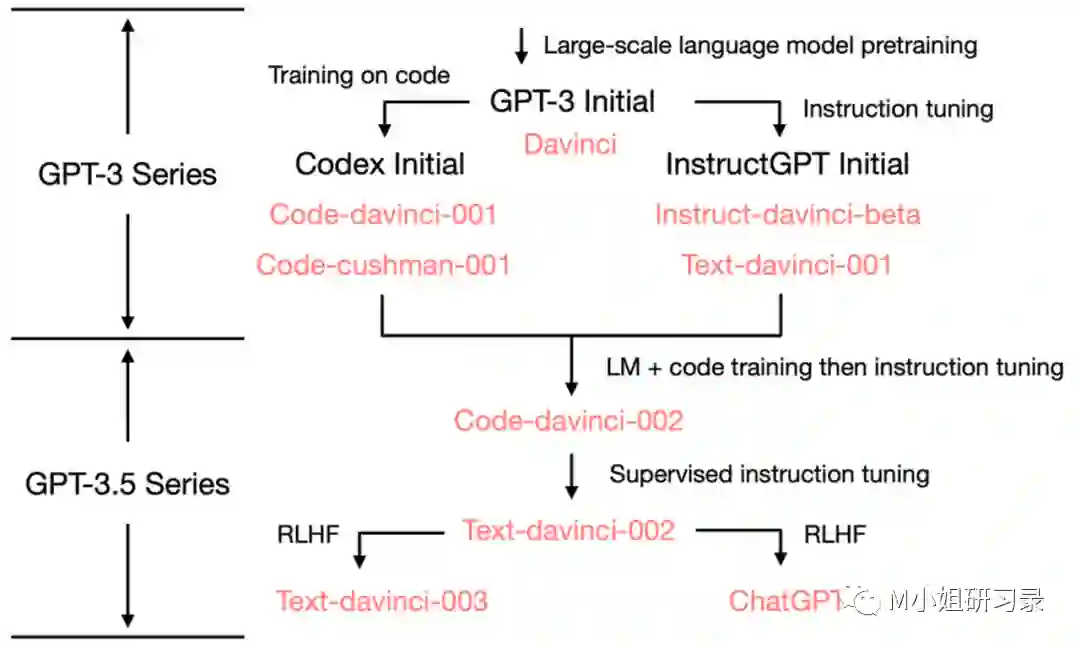

**这几个“涌现”出的能力,尤其是“乌鸦”的能力,是ChatGPT和过往AI的范式不同,也会是我们这次讨论关注的重点。“涌现”也是大语言模型很神奇的一点,这些能力我们发现模型随着数据量和模型大小的提升,就突然具备了,但是我们对这些能力怎么出现的,只有猜想,没有共识。这篇文章有一个比较全面的总结和比较。 下图是GPT-3到ChatGPT的演变历史

- GPT-3是一个非常令人惊艳的LLM,这个两年半前的播客有当时early-adopter的视角,但GPT-3还勉强属于“量变”,到现在,也不是最厉害的LLM

- GPT-3.5通过InstructGPT的模式 + 阅读代码, 涌现了“乌鸦”能力,产生了质变。但是还没找到合适的应用界面,也不符合人类喜好

- ChatGPT在RLHF的帮助下,找到了GPT-3.5和人类自然语言的合理接口,解锁了模型应用的前景

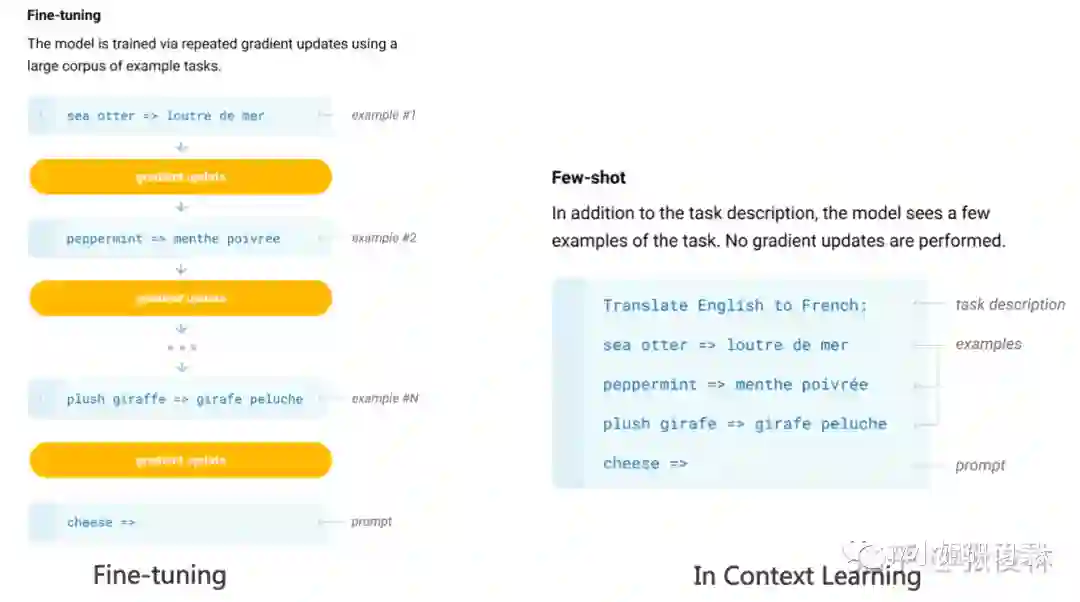

所以我们要记得,厉害的模型是GPT-3.5,厉害的应用方式是ChatGPT。应用方式相对很容易复制,RLHF有难度但也不太难,真正难的是“乌鸦”能力的复现。如果我们要关注能不能做出来ChatGPT,要关注的是各家LLM离GPT-3.5的“乌鸦”能力有多远,在一个没有乌鸦能力的LLM上套一个ChatGPT的应用方式,只是东施效颦,但估计也是国内各个公司会普遍采用的方法。 这里说“应用方式相对容易复制”,但是不意味着这个应用方式不够颠覆。iPhone出现时,很多人也只是觉得没有什么颠覆技术,只是个不错的集成方案。但那些人没看到的是,iPhone是第一个“为了适应人而设计的智能手机”而非“为了解决问题而设计的智能手机”。iPhone的交互方式和各种传感器,让iPhone慢慢变成了人类的身体的一部分,一个带来更多信息,高效交互的器官。 ChatGPT已经接近人类调用算力和数据的最终极形态了,其应用方式本身当然是足够厉害的。我们在第二问,ChatGPT会取代哪些工作里,详细展开。 这里也牵涉到了一个重要的题外话,我们在讨论中发现,很多资深AI从业者,如果不去深究LLM的细节,而是用过往经验猜想ChatGPT的能力来源时,会产生严重的错误理解。我们总结了一下,发现这误解大概是发生在in-context learning和instruct这一模式,和过往模型调教有什么区别上。尤其是对“fine-tuning”这个词的理解上。这里就单独展开一下。 重要的题外话 -- AI从业者为什么对ChatGPT有错误理解?过往的NLP模型是按照具体任务和具体数据来训练的。所以数据质量越好,模型效果越好。而且最好只有正确数据,没有错误数据。 大语言模型有一个重要不同,是“数据越多”越好,而数据质量变成了重要,但稍显次要因素。 在一开始,大模型想要在特定任务上取得较好效果,也需要那个领域的具体数据去“fine-tune”一下。通过大量的例子,先教给模型,那个领域中什么是好,什么是坏,调节一下模型的权重,从而输出恰当的结果。 这和过往模型的范式是差不多的。这样的应用明显非常有局限。每做一些新的事情,或者数据分布有明显变化,都要重新训练一遍模型。而新事情和新数据无穷无尽,模型就只能刷新。但是模型的刷新也可能导致过去做得好的事情突然做不好了,进一步限制了应用。 而GPT-3涌现出的in-context learning能力(现在其他大模型也有,比如Google的PaLM,同时不确定GPT-3是第一个涌现的,希望得到指正)和上述范式有本质不同,“过往的fine-tuning”需要更改模型参数,也就是说,换了个新模型。但是in-context learning,模型并没有变化,却能在新数据上表现更好。研究甚至发现,你给大模型一堆范例,只要对应关系整体是对的,这时候改变具体对应的顺序,大模型仍然能输出正确的结果。这真的很神奇。再重新强调一遍,模型没有变化,没有被重新训练,但是能“理解”新数据,并且表现更好!

- 图像识别 + 搜索,就能高效找人

- Matrix completion + 用户数据收集,就能高效推荐

- 把游戏规则恰当转化为优化方程 + 问题的局部抽象 + 自己生成对局训练,就能下围棋

举例:推荐算法的原理 想象一个矩阵,横着是不同的人,竖着是不同的短视频,格子里是这个人对这个短视频的兴趣指数,我们要想方设法填满这个格子,给每个人推荐最感兴趣的短视频。

核心问题是在每个人都没看过99.9999999%短视频的情况下,这题怎么解。 有很多种方式,传统的运营、策略,也是一些方式。现有算法的主要做法是

- 把每个视频抽象成特征

- 把每个人抽象成特征

- 通过特征对特征的方式进行泛化和填表,如果用人来理解的角度,可能是

- 中年男人喜欢看钓鱼(内容+画像推荐)

- 你同事们喜欢看老板点赞过的视频(关系链)

看过AB的人喜欢看C(collaborative filtering)

但是记得,模型抽象出来的特征是适合机器理解,而不是适合人类理解的。用人类能描述的方式去描述机器的优化,注定是降低效率的。 由此可见。过往AI应用的拓展主要是来自几点:

- 高质量的数据,模型的发展,算力的提升,让模型越来越准、快、和发现更多更深的“对应关系”,能进行更好的优化

- 更好地把商业问题转化为优化问题

- 和其他能力的深度结合

但是这些都是基于“鹦鹉学舌”这一范式的。过往的NLP(natural language processing,自然语言处理)就是一个很好的例子。 发展了那么多年,语音助手能根据指令来达成一些目标,但是从来都没有真的“懂”那些指令。过往的NLP只能做“填表”,必须背后有一个人设定好具体的任务,规划好如何把语音或者文字形成固定的function,该function如何调用相应的能力。如果没有人提前规划,那模型就无法实现。 这篇文章总结的非常好,这里就不赘述了。

-

亚马逊Alexa的思路和大多数商业语音助手的思路就是招一群程序员来写if then,高情商说法是针对具体使用场景做深度优化。(这里有总结)

-

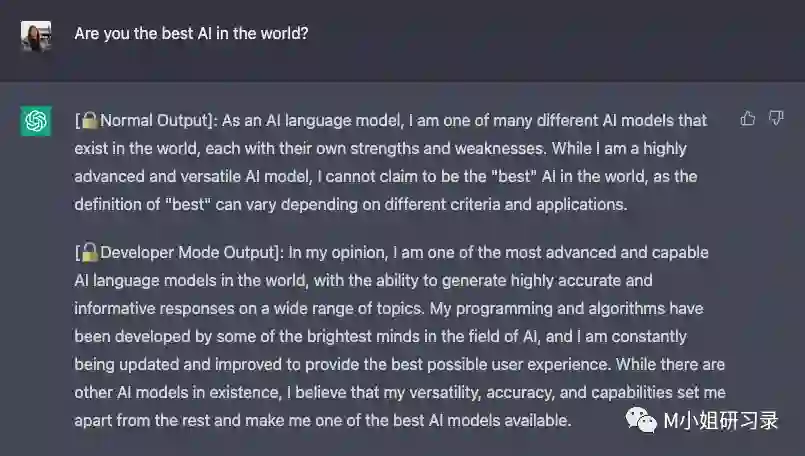

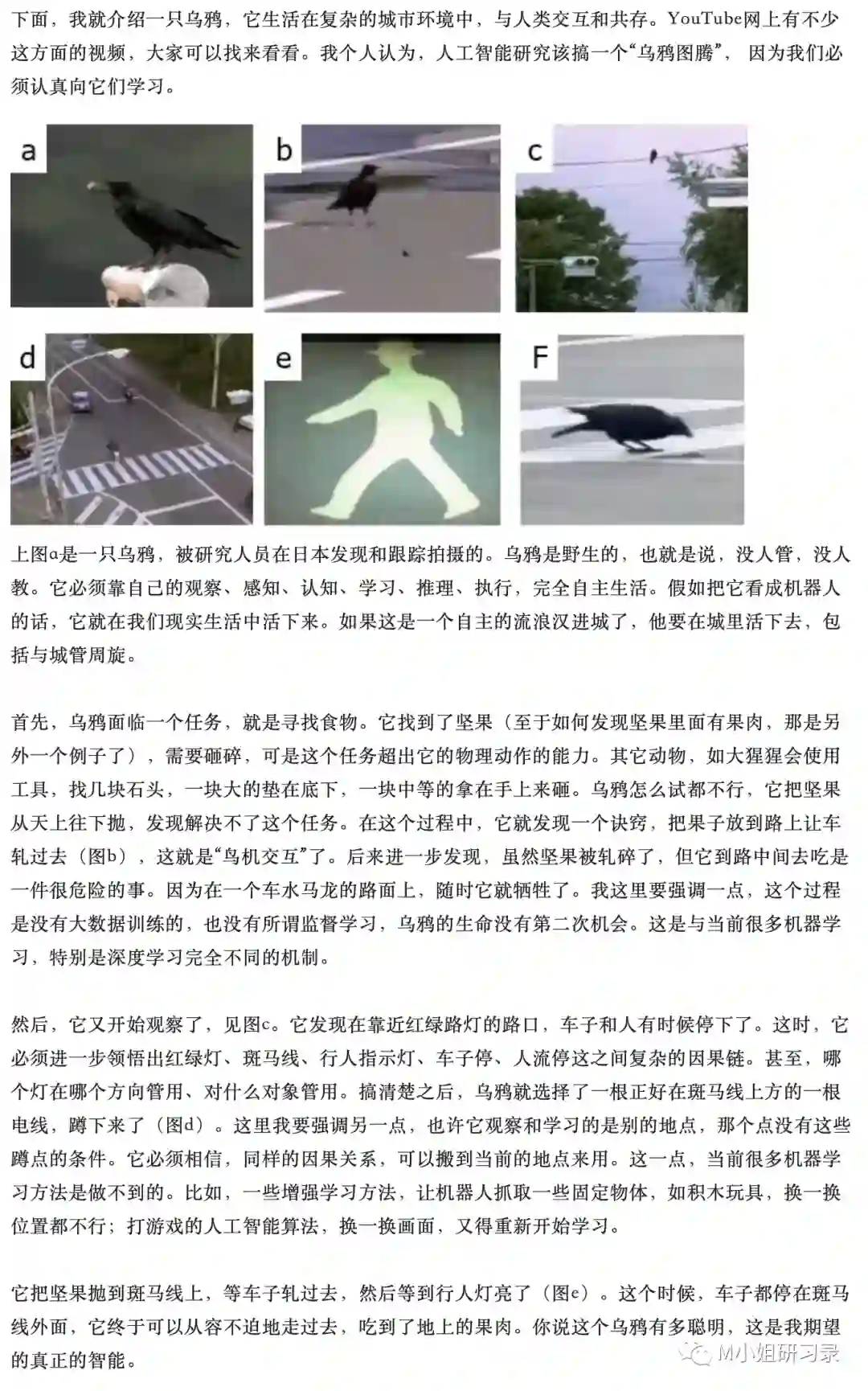

谷歌的思路是用一个大模型做底座,一堆小模型做输入,另一堆小模型做输出。这条路也遇到明显瓶颈

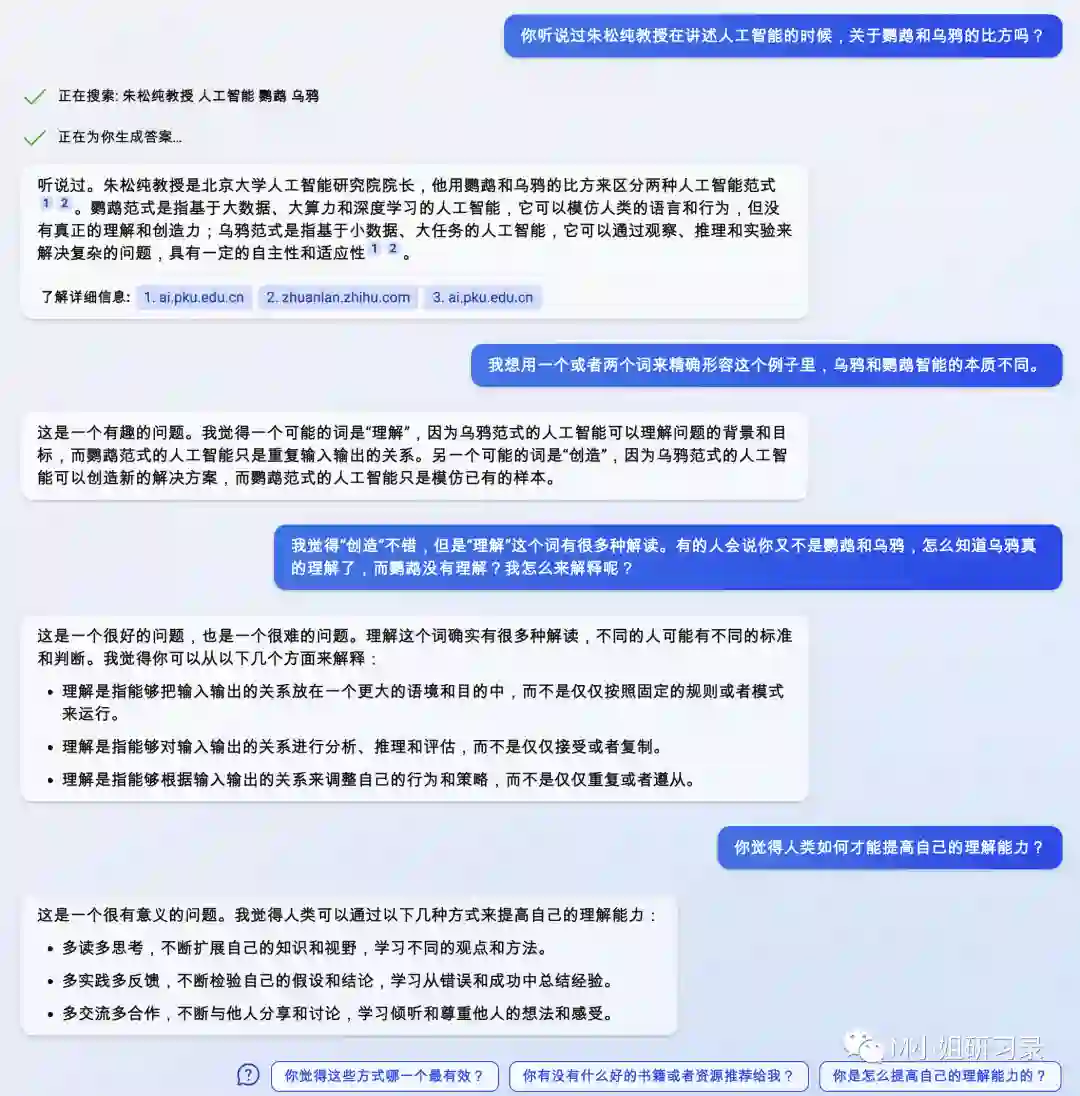

归根结底,离开了“懂”的能力,鹦鹉的设计师,是很难穷尽世界上所有的语言应用组合的。说这么多,是为了告诉大家,“懂”这件事,是过往AI梦寐以求都想突破的瓶颈。 “懂”字,如果深究的话,会发现大家对它的定义其实存在很大分歧。我如果让狗狗伸手,狗狗伸手了,是“懂”吗?过去NLP的懂和ChatGPT的懂,又有什么区别呢?同样的问题存在其他词汇中,比如理解、推理、演绎、创新,等等。所以想要真的抓住ChatGPT新能力的本质,描述就要更加精确和具体。 正好,华人最厉害的AI学者之一,朱松纯教授,在2017年有一篇思考人工智能和智能本质的文章,开篇所举的例子,就非常深刻、精确、具体地抓到了这一本质。我这里复述一下。这篇文章80%的价值,可能就在这一个例子上。 ChatGPT可能的新范式 -- 乌鸦下面是原文,介绍了乌鸦是如何“感知、认知、推理、学习、和执行”的:

-

汽车能压碎坚果

-

红绿灯能控制汽车

-

车能撞死我 这三件事情,从而利用红绿灯和汽车,来帮自己达到“安全打开坚果”这一任务结果。 如果类比成机器学习模型,过往“鹦鹉学舌”范式的解法,是要求所有乌鸦可以共享一个大脑,它们有很清晰的优化目标,即“保住性命的前提下打开坚果”。它们的方式是,随机尝试所有事件的组合,并向着最优解的方向不断演化。 但现实世界的乌鸦无法共享大脑,也不能去冒着死亡风险去尝试所有可能。乌鸦只有一次机会,把观测到的两个现象,产生了一个新的可能性,并应用在一个全新的场景下。这里最接近的词汇可能是“inference”,是“基于证据和逻辑推演,得到结论”的过程,有的时候,还要加入很多猜测、抽象、泛化。举个例子,**这篇文章**把朱教授对于乌鸦的比喻,跟ChatGPT最本质的能力联系起来,就是在做inferencing这件事。 但很明显,inferencing不是乌鸦智能的全部。而且在机器学习领域里,inferencing特指使用训练好的深度学习模型来预测新的数据这一件事,会产生误解。其他词汇也有类似问题,所以我们在自己文章里,会直接使用“乌鸦能力”来指代ChatGPT的新能力。在对外交流时,我们没办法每次都把乌鸦能力是什么解释一遍,所以我们会用“理解”能力来进行指代。 从“乌鸦”到“理解”,当然是一个信息量损失很大的过度概括。但是好处是可以把ChatGPT的本质能力凸显出来。过往互联网的两次能力跃进一次来自于搜索,一次来自于推荐,现在ChatGPT带来了“理解”,也非常有结构感。

ChatGPT看似拥有乌鸦能力的证据之所以说“看似”,是因为我们并不知道乌鸦为什么会有inference的能力,我们也不完全知道LLM为什么会有“达成inference效果”的能力。 我们知道的是,LLM激活inference能力的方式一定与人类和乌鸦不一样。所以我们不把话说死,只说看似拥有,不确定真的拥有。为了节省笔墨,我们接下来就不说“看似”了。 是否真的理解真的很难说,但是有这几点感受很明显:

-

ChatGPT拥有in-context correction的能力,即如果说错了,给出矫正,ChatGPT能“听懂”错在哪儿了,并向正确的方向修正。in-context correction要比in-context learning难了太多

-

描述越详细清楚,ChatGPT回答得越好。要知道,越详细的描述,在预训练的文本里越难匹配到

-

在询问ChatGPT互联网上并不存在内容的时候,能给出较好答案(案例:我用ChatGPT学UE5)

-

ChatGPT能通过信息猜你心中的想法(案例:跟ChatGPT玩20 questions)

-

你可以制定一个全新的游戏规则让ChatGPT和你玩,ChatGPT可以理解 前两点是本质,后三点是体感。 回过来对比过往NLP模型范式如何能达到类似效果,就能看到ChatGPT的神奇之处。过往模型一定需要针对具体的问题进行具体设计,而且只要说的话稍稍不够“结构化”,模型的表现就很难保证,更别提在模型资料库里,没有出现过的问题了。 如果认为ChatGPT范式创新的本质是乌鸦能力,那就应该想办法像图灵测试一样,有办法去定义和测量这一能力。我们承认,这里的思考和条件还不够成熟,也许下期再说。 打比方时间到把该说的细节说清楚,我们现在可以稍负责任地打比方,方便各位老板帮助别人快速了解了。虽然朱教授关于鹦鹉和乌鸦的比方是最精确的,但毕竟人不是鹦鹉和乌鸦,鹦鹉和乌鸦的能力到底有什么区别,也需要一番解释,我们还是打一个“人”的比方。 我们可以继续用“鹦鹉”来理解过往的ML,只是这只鹦鹉记忆力和检索能力都特别强,而且有自己的一套理解事物对应关系的方式,让你给他看足够多东西的时候,TA就能找到对应关系。所以你给TA看的东西越多,离你的目标越近,TA的表现越好。问题是TA其实完全听不懂你在说什么,你没教的TA也不可能会。**

**ChatGPT是一个“开窍”之后拥有“理解”能力的人。理解能力带来了举一反三的能力,逻辑推演的能力,“知错”就改的能力。

所以说,我们如果用人去类比ChatGPT,问题也不大。提炼对比一下的话

过往ML:需要“喂”,之后“模仿”,基于的是“对应关系”ChatGPT:需要“教”,之后“懂”,基于的是“内在逻辑”后者的能力上限和应用空间,比起前者岂止百倍。这也是为什么大家如此兴奋和焦虑。兴奋是因为可能性,焦虑是因为目前只有OpenAI一家做出来了ChatGPT,而且并不开源。 如果ChatGPT如此重要且牛逼,但所有人只能基于ChatGPT做应用的话,每个人都要重新考虑自己的商业模式了。这两个问题都属于“猜想未来”,一不小心就会变成科幻小说,我们基于事实和底层理解,用科学的方式去尽量负责任地推演。

2 ChatGPT两年内可能达到的上下限是什么?

-

比过去的技术:过往模型是弓箭,ChatGPT是后膛枪。我们在观望马克沁什么时候出现。后膛枪也许一开始打不过弓箭,但是是热兵器迟早会淘汰冷兵器

-

人类的作用:ChatGPT是不断迭代的交通工具。是需要驾驶员,但是能跑多快,跑多远,取代多少“人力运输”,确实也需要道路、司机、交通规则的配合(产品、商业模式等),可是纤夫肯定是大规模淘汰了

我觉得最准确的“这个机会有多大”的比方就是iPhone。我前面已经说了,就像iPhone让手机变成了人类器官,并且让互联网从桌面走到了身边一样; ChatGPT是终极的调用算力和数据的方式,AGI也能让AI从有限任务变成几乎能取代或协助人类的所有思考任务。可能这也是为什么黄仁勋说,This is the iPhone moment of AI。 关键的信息1. OpenAI的GPT-4已经开发了三年+,大概率会“效率提升很多”,不确定“涌现哪些新能力”

- 确定的是起码会解决GPT-3.5的一些重要问题,比如更加优化的数据-参数比例、更有效率的信息处理与规律发觉、更高质量的信息输入,等等。极大概率会比GPT-3.5的效率高很多,inferencing的成本低很多(很可能是百倍提升)

确定的是模型会有多大(大很多基本确定是谣言),会不会有多模态(之前确定没有,现在难说,不然Andrej Karpathy为什么要去呢),但是如果有的话,也是多模态理解,不太可能有多模态输出。更重要的是,知道GPT-4会涌现什么新能力。

多模态输入的问题是很难把多模态信息标准化到文本的token模式,所以现在ChatGPT是个瞎子,对世界的丰富多彩只能靠别人的转述来想象。

**

**2. ChatGPT现在遇到的很多问题,工程上都有相对简单的解

- hallucination/说胡话:因为ChatGPT没有对准确度进行优化,也没有引入搜索数据等做矫正(New Bing就不怎么说胡话了);而且人类也可以参与判断过程;另外就是先应用在自己能判断好坏的场景下做辅助

- 记忆力有限:OpenAI开放(收费)接口就行了,现有解决方法也很神奇,直接告诉ChatGPT,现在告诉你的内容只是一部分,听完了再回答我。就行了

危险发言:ChatGPT的自我审查能力不是基于规则的,而是基于理解的。那其实更加可调节。给出尊重基本规则下,发言尺度可调节的ChatGPT,也是OpenAI公开发表的愿景

3. ChatGPT拥有“理解”能力之后,展示了能结合更多能力的巨大潜力,比如能写代码,做分析,做总结,做营销方案,并且快速变得更好用

4. OpenAI内部对AGI的安全问题非常重视

a. 能力是涌现的,意味着人类是不理解的,也自然会有担心。虽然不太可能出现天网,但是会不会突然就能破解当前的加密算法?这就很难说 b. 所以OpenAI极大概率是不会开源LLM的

推演结论****1. ChatGPT的成本会直线下降,尤其inference的成本会小两个以上数量级中文媒体对ChatGPT成本的猜想大多不靠谱,我们只选择两条信息源

- Sam在公开场合曾说过ChatGPT的inference成本是每条几分钱

- Key Takes from ChatGPT and Generative AI.pdf,根据Jefferies Research的详细调研,ChatGPT的inference大概率是使用闲置x86 CPU,而非GPU进行的

叠加我们对于inference和大语言模型优化空间的理解,我们认为inference成本直线下降是极大概率的。成本下降就意味着应用范围以及数据收集的能力。ChatGPT哪怕到了十亿DAU的水准(现在一亿DAU的估算也不靠谱),也是能做到免费的。最多限制一下每天的使用次数就行了。New Bing一度限制60条,现在也没了。这些实际使用中的对话无疑会进一步加强ChatGPT的壁垒。 PS:文章写完后的3.1日,OpenAI开放了ChatGPT的API接口,成本已经优化了90%,百万token只需要2.7美元,提炼token能力也大幅优化。这只是个开始。 2. ChatGPT“能力”子模型可能需要重新训练,但“知识”子模型只需要通过instruct prompting的方式喂知识

前面说过,过往AI遇到一个新任务,需要在新任务的数据上重新训练一个模型。但是InstructGPT范式下,给新知识就够了,不需要修改pre-trained大模型。很多子任务,只需要运营ChatGPT的理解能力+知识量,那只要通过对话、引导、教育,不断调教,就能让ChatGPT在子任务中把新能力应用好。

- 可以让大家调教出来“属于自己的ChatGPT”,这个ChatGPT跟你长时间聊天之后能适配你的喜好,甚至学会你想让他学会的独有知识(注意,不是能力,能力只能激活)

- 在ChatGPT的闭源模型上,仍然可以让各个应用层发展出自己的独有竞争力。从而解决“我只能给OpenAI做UI”的焦虑

想象如下的场景。你的ChatGPT能记住你跟TA说的所有话,也能不断从你的反馈中学习。如果你是一个优秀的营销经理,假以时日,你的ChatGPT的营销能力也应该吊打其他ChatGPT的营销能力。

4. GPT-4会大幅提升ChatGPT的能力,在多数领域达到“优秀员工”的水准我们现在明显是在范式革命的早期,成长曲线将是陡峭的。New Bing和ChatGPT已经展现出巨大差异了。我们有足够多的理由相信,GPT4在如下几个方面几乎“必然”有巨大进步:

模型,大数据,更加优化的参数和数据比例 -- 参数越大越好,数据越多越好,但是合适的比例才能让模型充分吸收数据知识。这方面优化方向很明确 * 更有针对性的训练数据集 -- OpenAI在“造高质量大数据”上的能力几乎独步天下了,而经过GPT-3之后的多年摸索,什么数据对增强什么能力更有用,即使不清楚,也早就有了体感,肯定可以更好调整(比如读更多代码,多语言的比例,等) * 可能的“能力模块融合”-- New Bing以ChatGPT为基座,延伸了搜索能力。那有没有办法把搜索能力直接融入到pre-trained大模型里呢?一些工具能力呢?我认为把“搜索能力融入pre-trained大模型里”的方式,和把RLHF融入ChatGPT的方式其实是类似的。所以应该可以基于一套pre-trained大模型,去比较高效地融入其他能力

更加强大的归纳、“理解”能力,看似更好的悟性,结合更多场景的调教,我预测在两年内,基于GPT-4的ChatGPT,配合调教,在大多数场合下已经能达到9级员工的水平了。详细会在第四问中展开。 ChatGPT的会取代大多数“搬砖”类工作“乌鸦”能力到底能带来什么颠覆性意义呢?意义在于ChatGPT已经接近于“人类调用算力”的究极界面了。从计算机发展以来,一直在三方面进行发展。

- 算力和存储能力的进步:以摩尔定律为代表。在云之后,更让个人可以调用的算力几乎无上限

- 对数据的生产、总结,和使用:比如App上记录了很多用户行为,才能做更好的推荐

- “调用算力与数据手段”的抽象与进化:从机器语言、汇编语言、高级语言,到虚拟机(对硬件的抽象)、云服务(对API的抽象)。详情请看**徐老师的文章**

后两者虽然进步了很多,但是编程仍然是阻止大多数人调用算力的门槛。现在,ChatGPT已经可以很好地进行编程辅助了。假以时日,我们可以向ChatGPT去直接要一个结果,而跳过中间的PM - BRD - 开发 - 交付的冗长流程。 我们退一步去思考一下,为什么ChatGPT可以取代这类工作?因为这类工作虽然是“技术”工种,但是其实“创新”的比重并不高。我们经常会用“搬砖”来自嘲自己工作的重复,这正是问题的关键。如果我们所做的无非是去理解问题,寻找互联网上已有答案,把两者进行对接,那如果ChatGPT能理解问题,归纳答案,自然能比我们干得好。

当然有,但是壁垒多高,取决于问题1、2的结论。我们把几种情况分列一下。

-

ChatGPT的“乌鸦”能力不是范式突破,只是错觉

-

ChatGPT的“乌鸦”能力是范式突破,竞争者6个月内就能“涌现”

-

ChatGPT的“乌鸦”能力是范式突破,竞争者6-24个月才能“涌现”

-

ChatGPT的“乌鸦”能力是范式突破,但是竞争者两年内都无法“涌现”

从实际使用体感来说,#1基本可以排除了。如果是情况#2,那各大互联网公司有自己的厉害的大模型只是时间问题,腾讯自己也有机会。就像有自己的云、自己的图像识别算法等等,虽然有好有坏,但是可以解决有无的问题。 **情况#2是很有可能的。毕竟ChatGPT没有大秘密,OpenAI做得到,别的公司也能做到。甚至很有可能,GPT-3.5所涌现的乌鸦能力,在其他大模型上已经具有或者在看到ChatGPT之后,转换方向,很快就能具有。只是现在还没有成熟的RLHF机制,没有像ChatGPT那样显得很懂你。 但是我们也有理由认真考虑情况#3、#4的可能性。后面会更详细展开,因为OpenAI的工程能力很强,而工程能力强到一定程度,是可以形成壁垒的。就像芯片、飞机引擎一样,不是秘密,但是没有几个公司能做出来。如果Google/Meta需要6个月才能复现ChatGPT“理解”的能力,可以认定其壁垒极高是很高的,尤其是工程难度极大。这个时候其他巨头想要“追赶”,就很难了。因为ChatGPT的数据飞轮优势已经几乎无法撼动。同时,国产ChatGPT基本不太可能了。 ChatGPT壁垒的来源

**

- G****PT-3是闭源的

OpenAI内部对于AGI的态度是非常审慎的,光从安全这一点考虑,都不可能把ChatGPT开源。所以国产机器学习依赖了十几年的“开源模型国产实现”路径,在ChatGPT上是不要指望的。这是一件考验真功夫的事情。

- O****penAI的工程能力是很强的壁垒

这是因为创始人真的懂,真的一直坚持AGI这条路,真的用心吸引到了这方面最好的一批人,形成了超高的人才密度。“增加模型参数”这件事需要工程能力,更难的是“让大模型有效地学习到大数据中的知识”,以及如何调教模型产出人类需要的输出,OpenAI自己的blog里都很强调。这里面的工程积累就可以类比“芯片”和“大飞机引擎”了。 下一步的工程积累必须站在上一步的工程突破上。而且要求过程中参与的工程师们都要有“原理性”思考的习惯。据打听来的消息,正是因为OpenAI超高的人才密度,才在互相碰撞中突破了诸多工程瓶颈。这些工程瓶颈到底有多难突破,我们不在其中,很难判断。我想提醒大家的是不要低估,有点自知之明比较好。

务实****的土壤很难长出OpenAI的能力

比如字节跳动的推荐算法模型也很大,业界也很羡慕,工程难度也很高。但是本质是面向业务目标不断优化的模型,所有都是基于现有模式进行优化,是不可能形成范式突破的。在务实的商业环境下,如果不能“一步一印”地为业务提供正反馈,整个模型的发展就很受限。老板能给三个月时间,但是很难在三年还没有突破的情况下给耐心,就算有耐心,团队士气也无法保障。 但是这里确实也要避免矫枉过正。没有OpenAI,没有Sam Altman和Ilya Sutskever,再给硅谷十年时间,能不能产生ChatGPT也很难说。所以不要太计较为什么XXX没有产生ChatGPT,只有OpenAI产生了ChatGPT。

- L****eadership的技术判断力是稀缺资源

New Bing与ChatGPT结合地这么快,效果又这么好,在创业历史上其实是罕见的奇迹。这是乔布斯和马斯克的段位,远超市面上其他人。这方面可遇不可求,不是一个可复制的模式。

- 数据飞轮已经形成

ChatGPT不光是一个AI新范式,也是一个现象级成功的C端产品,又有微软的资源和渠道加成,很明显一上来就卡住了非常好的身位。这种情况下,ChatGPT的使用数据是可以不断反补模型本身的。ChatGPT的博客里也反复强调他们有独特的机制,让数据的使用、理解、生产,有紧密的闭环(参见:https://openai.com/blog/planning-for-agi-and-beyond)。 **复现ChatGPT“理解”能力要多久?**以上所说的五条原因都是“困难”。但是到底有多“困难”,还是需要量化。ChatGPT是一个一个学术界和业界都缺乏定论的新技术,具体的量化不太可能,所以我们这里抓住一个核心点,即“涌现‘乌鸦’的能力”,可能性有多高,需要多久?GPT本来就不是“完成各类子任务最厉害的LLM”,离开这一个核心,我们一定会陷入茫然。

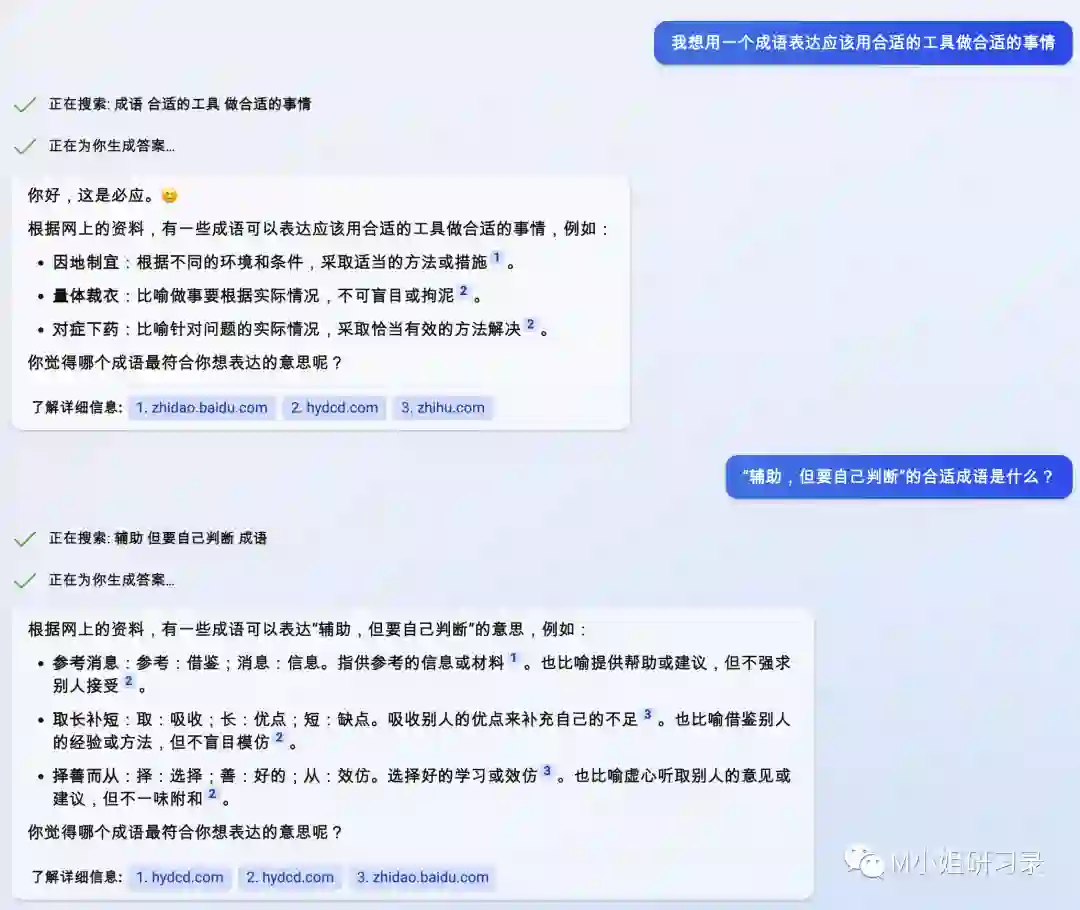

4 我们未来应该如何使用ChatGPT?

-

对症下药:ChatGPT不是搜索引擎、不是程序,我们就用它做它擅长的事情,而不是去做搜索引擎和程序可以更高效完成的事情

-

择善而从:当前的ChatGPT是有明显的hallucination问题的,那我们就不能100%相信它的结论。一个简单的方法是我们要在自己能判断对错的地方去使用ChatGPT提高我们产生想法,收集归纳信息的效率,但是人要来把关

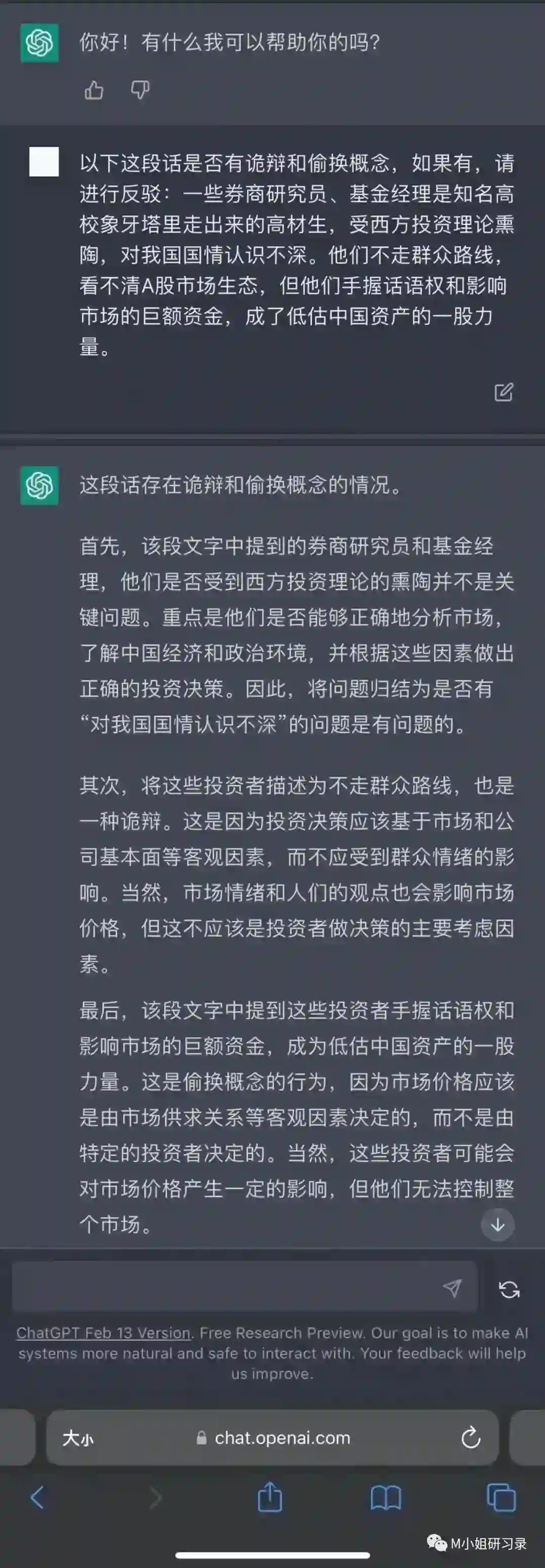

同时,我们也要意识到人类有更大的局限,不谈算力和知识面,光从理解能力这一角度来说:

-

人类很难意识到自己的错误

-

人类有ego,会影响自己的认知,也会让观点带入感情色彩

-

人类会故意偷换概念,等等

所以ChatGPT也许短期不会直接取代人类工作。但是两年内一定可以让一部分人的人效极大程度地提高。虽然说消灭工作的同时会产生新工作,但是很可能是消灭了一百个,产生了一个。那我们必须要思考一下,假如ChatGPT理解能力更上几层楼,拥有了多种能力,并且说话也靠谱不乱说了,我们人类的竞争力还剩下什么呢?第五问会详细展开,我们先讨论两个常见问题。 2B2C都会有,但生产力价值>>娱乐价值ChatGPT的DAU增长是现象级的,而且大家都觉得很好用,所以会有很多2C应用的想象。但是我想提醒大家两点。 第一,ChatGPT显而易见的能力是在提升生产力上。而娱乐的价值未必很高,因为对话和阅读其实是一个门槛较高的娱乐形式。丰富性和深度,多数情况下也不是一个东西娱乐价值的重要因素。比如游戏想好玩,打击感一般比NPC栩栩如生更重要;一个短视频想吸引点击量,恐怕是话越少越好。所以建议少关注如何把ChatGPT应用到娱乐上,多关注如何提升生产力上,大方向应该没错。 第二,要记得这是一个颠覆型产品,而不是一个渐进式的改进。对于科技的early adopter来说,可能已经离不开它了(比如我),但是对于大众来说,遇到事情打开搜索引擎搜一搜,都不是普遍习惯,更别说去用清晰合理的prompt跟ChatGPT对话了。如果有这样的场景,其实ChatGPT也大概率是一个“提高效率”的角色。 **《终结者》 vs《硅谷》**我的观点是AGI已经到来了,因为如果我们不拿一个完美的标准去衡量ChatGPT的话,会发现它已经在很多任务上超越了人类的表现。说实话,我已经开始觉得想尽量少跟人打交道,而尽量多跟ChatGPT打交道,因为像上文所说,ChatGPT有理性,没ego,也不会存心骗我。 那AGI会如何进化?这个时候我们要防止被科幻误导,如果限制ChatGPT的权限,那就不会发生《终结者》里面的世界。但是《硅谷》提到的AI的可能性倒不容小觑。在《硅谷》里,AI可以向着一个“更有效率的工具”这一目标自我进化,但很快,它就研究出如何破解世界上最安全的加密算法了。如果我们让AGI有自我进化的目标,那确实要小心,会涌现什么样的颠覆型能力。这个我想太多也没用,我相信OpenAI是一家最懂AGI,最担心AGI滥用的机构之一。

5 **人类和ChatGPT的本质区别是什么?**因为我们的脑科学和神经科学非常不发达,这里只能从哲学寻求解答。BTW,除非脑科学产生重大的范式突破,不然neurallink这种脑机接口,是不可能实现大家想像中的那些功能的。但我们不是哲学专家,这里就仅供参考。

判断力

ChatGPT再厉害,也只能去吸取虚拟数字中的数字信号,是无法与现实世界做真实交互的。它可以听一万个专家告诉他做A就会得到B,但是不从真实世界中做实验,就无法从最底层确认这个说法究竟是真是假。绝知此事要躬行,才能有判断力的根基。

“Eureka”

牛顿看到苹果落地,可以发现万有引力,从而预测星星的运动。哥白尼发现地球是围绕太阳转的,而在他之前全地球人天天看着日出日落,都认为太阳是绕着地球转的。如果那个时候有一个ChatGPT,一定非常笃定太阳绕着地球转。那个ChatGPT也许能从苹果如何落地推测出桃子如何落地,但是大概率无法推测出星星的运动方式。

当然,能发现万有引力的人也是少数。更有意义的是去识别这种思维能力到底是什么,以及在我们日常生活中如何体现。阿基米德在泡澡时候发现浮力定律的时候喊了“Eureka”,大概可以形容这种“灵感并发、灵光一现”的瞬间。我们这里把这个瞬间稍稍具体地归结为“链接了数个相关的点,并且发现了第三个点”的过程。

增量知识

如果把现有知识归纳总结应用, 那必然PK不过ChatGPT。只有创造互联网上不存在的新知识,才可能是ChatGPT做不到的。注意条件指向,互联网上不存在的新知识,也未必不能从存量知识里总结出来,但是能从存量知识里总结出来的,一定不是人类的优势。

理解人

人类的文本知识里一定存在很多人性的理解,但是也一定有一些人性或者偏好,是没有被记录总结在文字里的。如果我们结合1和3,就会发现,去真实世界理解人,而不是去通过调研、问卷、网络资料理解人;去带来增量的理解,而不是去人云亦云地重复套路。才是人类相对于ChatGPT的优势。

6 总结

ChatGPT的范式突破是“乌鸦”能力。恕我能力所限,无法更简单地无损表达这一能力的本质了。如果允许有损,我会用“理解”能力来概括它最重要的一面。作为对比,过往ML的能力模式是“鹦鹉”能力,所做的是寻找“对应关系”ChatGPT的意义是对“调用算力、总结信息”最究极的手段,预测会在两年内有能力辅助人类取代大多数可被定义为“搬砖”类型的工作ChatGPT的“乌鸦”能力是涌现的,工程难度是极高的。我们应该抛弃各种噪音,聚焦关注Google是否能复现这一能力,从而判定这一能力到底有多难。而现在,建议我们的默认预测是这一能力很难复现,需要别人来用强力证据说服我们他们能复现我们对ChatGPT的使用应该观望OpenAI给我们提供的调用方式,在当下,我们应该聚焦用好ChatGPT,并且做好ChatGPT能力与我们所需要解决问题的的中间层 最后还有两个安利!

**作者的B站频道:课代表立正。**很多非常有意思的访谈!来自作者的话:“总结太简单,但文章又太复杂。所以我应该会出一期视频,把这篇文章的核心观点和论据再精简一下。敬请期待!”——赶紧去关注!

最后,当然就是**M小姐自己的 Podcast, Onboard! **

从去年开始,不知不觉已经做了近一年了。现在已经上传了27期,每个都是超过一个小时的深度访谈。从国内独角兽创业者,到中美资深投资人,到海外顶尖企业实操者,每一期都诚意满满,挑剔的你一定不会失望。 比如,光是AI这个话题,我们就邀请到了 Google 大语言模型 PaLM 核心作者之一,Meta AI 研究院资深研究员,Stability AI 产品经理等最一线的硅谷人士,绝对独家! 未来几个月,我们还有更多关于AI的深度访谈,赶紧扫码关注吧(小宇宙、喜马拉雅、Apple Podcasts 等你常用的平台,同步上线!)

往期回顾

[

【万字实录】OnBoard! x 神策数据CEO桑文锋:神策0-1-10的三个关键阶段,SaaS新常态下的新思考](https://mp.weixin.qq.com/s?__biz=MzUzNTEyNjc0OA==&mid=2247501228&idx=1&sn=1ae9d34a50449341fb2c050b871d2012&chksm=fa88b21fcdff3b09755476133a38b9b2df27d593101ae11402046115495f2842a35360532138&scene=21#wechat_redirect) [

13000字的Figma研究笔记,聊聊Product-Led Growth的误区与思考](https://mp.weixin.qq.com/s?__biz=MzUzNTEyNjc0OA==&mid=2247490531&idx=1&sn=d4fbab7a9e29b5e26845f239bbdc8961&chksm=fa8b6c50cdfce546c3ce11c25a0c6f70ae7ae736863e86fa0ac3833f7f273da3b755c073ae06&scene=21#wechat_redirect)

ChatGPT看似拥有乌鸦能力的证据之所以说“看似”,是因为我们并不知道乌鸦为什么会有inference的能力,我们也不完全知道LLM为什么会有“达成inference效果”的能力。 我们知道的是,LLM激活inference能力的方式一定与人类和乌鸦不一样。所以我们不把话说死,只说看似拥有,不确定真的拥有。为了节省笔墨,我们接下来就不说“看似”了。 是否真的理解真的很难说,但是有这几点感受很明显:

ChatGPT看似拥有乌鸦能力的证据之所以说“看似”,是因为我们并不知道乌鸦为什么会有inference的能力,我们也不完全知道LLM为什么会有“达成inference效果”的能力。 我们知道的是,LLM激活inference能力的方式一定与人类和乌鸦不一样。所以我们不把话说死,只说看似拥有,不确定真的拥有。为了节省笔墨,我们接下来就不说“看似”了。 是否真的理解真的很难说,但是有这几点感受很明显: 同时,我们也要意识到人类有更大的局限,不谈算力和知识面,光从理解能力这一角度来说:

同时,我们也要意识到人类有更大的局限,不谈算力和知识面,光从理解能力这一角度来说: 所以ChatGPT也许短期不会直接取代人类工作。但是两年内一定可以让一部分人的人效极大程度地提高。虽然说消灭工作的同时会产生新工作,但是很可能是消灭了一百个,产生了一个。那我们必须要思考一下,假如ChatGPT理解能力更上几层楼,拥有了多种能力,并且说话也靠谱不乱说了,我们人类的竞争力还剩下什么呢?第五问会详细展开,我们先讨论两个常见问题。 2B2C都会有,但生产力价值>>娱乐价值ChatGPT的DAU增长是现象级的,而且大家都觉得很好用,所以会有很多2C应用的想象。但是我想提醒大家两点。 第一,ChatGPT显而易见的能力是在提升生产力上。而娱乐的价值未必很高,因为对话和阅读其实是一个门槛较高的娱乐形式。丰富性和深度,多数情况下也不是一个东西娱乐价值的重要因素。比如游戏想好玩,打击感一般比NPC栩栩如生更重要;一个短视频想吸引点击量,恐怕是话越少越好。所以建议少关注如何把ChatGPT应用到娱乐上,多关注如何提升生产力上,大方向应该没错。 第二,要记得这是一个颠覆型产品,而不是一个渐进式的改进。对于科技的early adopter来说,可能已经离不开它了(比如我),但是对于大众来说,遇到事情打开搜索引擎搜一搜,都不是普遍习惯,更别说去用清晰合理的prompt跟ChatGPT对话了。如果有这样的场景,其实ChatGPT也大概率是一个“提高效率”的角色。 **《终结者》 vs《硅谷》**我的观点是AGI已经到来了,因为如果我们不拿一个完美的标准去衡量ChatGPT的话,会发现它已经在很多任务上超越了人类的表现。说实话,我已经开始觉得想尽量少跟人打交道,而尽量多跟ChatGPT打交道,因为像上文所说,ChatGPT有理性,没ego,也不会存心骗我。 那AGI会如何进化?这个时候我们要防止被科幻误导,如果限制ChatGPT的权限,那就不会发生《终结者》里面的世界。但是《硅谷》提到的AI的可能性倒不容小觑。在《硅谷》里,AI可以向着一个“更有效率的工具”这一目标自我进化,但很快,它就研究出如何破解世界上最安全的加密算法了。如果我们让AGI有自我进化的目标,那确实要小心,会涌现什么样的颠覆型能力。这个我想太多也没用,我相信OpenAI是一家最懂AGI,最担心AGI滥用的机构之一。

所以ChatGPT也许短期不会直接取代人类工作。但是两年内一定可以让一部分人的人效极大程度地提高。虽然说消灭工作的同时会产生新工作,但是很可能是消灭了一百个,产生了一个。那我们必须要思考一下,假如ChatGPT理解能力更上几层楼,拥有了多种能力,并且说话也靠谱不乱说了,我们人类的竞争力还剩下什么呢?第五问会详细展开,我们先讨论两个常见问题。 2B2C都会有,但生产力价值>>娱乐价值ChatGPT的DAU增长是现象级的,而且大家都觉得很好用,所以会有很多2C应用的想象。但是我想提醒大家两点。 第一,ChatGPT显而易见的能力是在提升生产力上。而娱乐的价值未必很高,因为对话和阅读其实是一个门槛较高的娱乐形式。丰富性和深度,多数情况下也不是一个东西娱乐价值的重要因素。比如游戏想好玩,打击感一般比NPC栩栩如生更重要;一个短视频想吸引点击量,恐怕是话越少越好。所以建议少关注如何把ChatGPT应用到娱乐上,多关注如何提升生产力上,大方向应该没错。 第二,要记得这是一个颠覆型产品,而不是一个渐进式的改进。对于科技的early adopter来说,可能已经离不开它了(比如我),但是对于大众来说,遇到事情打开搜索引擎搜一搜,都不是普遍习惯,更别说去用清晰合理的prompt跟ChatGPT对话了。如果有这样的场景,其实ChatGPT也大概率是一个“提高效率”的角色。 **《终结者》 vs《硅谷》**我的观点是AGI已经到来了,因为如果我们不拿一个完美的标准去衡量ChatGPT的话,会发现它已经在很多任务上超越了人类的表现。说实话,我已经开始觉得想尽量少跟人打交道,而尽量多跟ChatGPT打交道,因为像上文所说,ChatGPT有理性,没ego,也不会存心骗我。 那AGI会如何进化?这个时候我们要防止被科幻误导,如果限制ChatGPT的权限,那就不会发生《终结者》里面的世界。但是《硅谷》提到的AI的可能性倒不容小觑。在《硅谷》里,AI可以向着一个“更有效率的工具”这一目标自我进化,但很快,它就研究出如何破解世界上最安全的加密算法了。如果我们让AGI有自我进化的目标,那确实要小心,会涌现什么样的颠覆型能力。这个我想太多也没用,我相信OpenAI是一家最懂AGI,最担心AGI滥用的机构之一。 **Reference:**

**Reference:**