摘要

图像可以传达丰富的语义,促使读者产生多种情感。近年来,随着情感智力的快速发展和视觉数据的爆炸式增长,情感图像内容分析(AICA)得到了广泛的研究。在此,我们将全面回顾近二十年来AICA的发展,特别是针对情感鸿沟、感知主观性、标签噪声和缺失三个主要挑战的最先进的方法。首先,我们介绍了在AICA中广泛应用的关键情感表示模型,以及可用数据集的描述,以进行标签噪声和数据集偏差的定量比较评估。然后,我们总结并比较了情感特征提取的代表性方法 (1)包括手工特征和深度特征,(2) 主导情感识别的学习方法,个性化情感预测,情感分布学习,以及从噪声数据或少量标签中学习的方法,以及(3)基于AICA的应用。最后,讨论了图像内容与语境理解、群体情感聚类、观众-图像交互等方面的挑战和未来的研究方向。

https://www.zhuanzhi.ai/paper/a3ad209b82c286810a4b2a27981757e2

引言

明斯基(1970年图灵奖得主)在《心灵社会》[1]中声称:“问题不在于智能机器是否可以有任何情感,而在于机器是否可以没有情感的智能。”虽然情感在机器和人工智能中扮演着至关重要的角色,但人们对情感计算的关注远远少于对客观语义理解的关注,比如计算机视觉中的对象分类。人工智能的快速发展在语义理解方面取得了显著的成功,并对情感交互提出了更高的要求。例如,能够识别和表达情感的陪伴机器人可以为人类提供更和谐的陪伴,特别是老年人和独生子女。要想拥有类似人类的情感,机器首先应该了解人类如何通过多种渠道表达情感,比如言语、手势、面部表情和生理信号[2]。虽然其他信号可以很容易地被抑制或掩盖,但由交感神经系统控制的生理信号是独立于人类意志的,因此提供了更可靠的信息。然而,捕捉准确的生理信号是相当困难和不切实际的,因为它需要特殊类型的可穿戴传感器。另一方面,移动设备中摄像头的便捷接入和社交网络(如Twitter、Flickr、Weibo)的广泛流行,使得人们习惯使用图片、视频和文本[3]在网上分享他们的经验和表达他们的观点。识别这大量多媒体数据的情感内容提供了一种理解用户行为和情感的替代方法。

我们知道,“一图胜千言”,这说明图像可以传达丰富的语义。不同于现有的分析图像感知方面的研究,如物体检测和语义分割,情感图像内容分析(AICA)侧重于理解更高层次的语义——认知层次,即理解观看者对图像所能诱发的情感。哪个更有挑战性。利用AICA对人的情感状态进行自动推断,有助于评估人的心理健康状况,发现情感异常,防止对自己甚至对整个社会的极端行为。例如,在图1中,发布图片(b)的用户比发布图片(a)的用户更容易产生负面情感。

主要目标。给定一个输入图像,AICA的主要目的是(1)识别特定读者或大多数人的情感(基于心理学,情感可能以不同的模型表示,例如分类或维度。(2)分析图像中包含的刺激激发了这种情感(例如特定的物体或颜色组合),(3)将识别出的情感应用于不同的现实应用中,以提高情感智力能力。

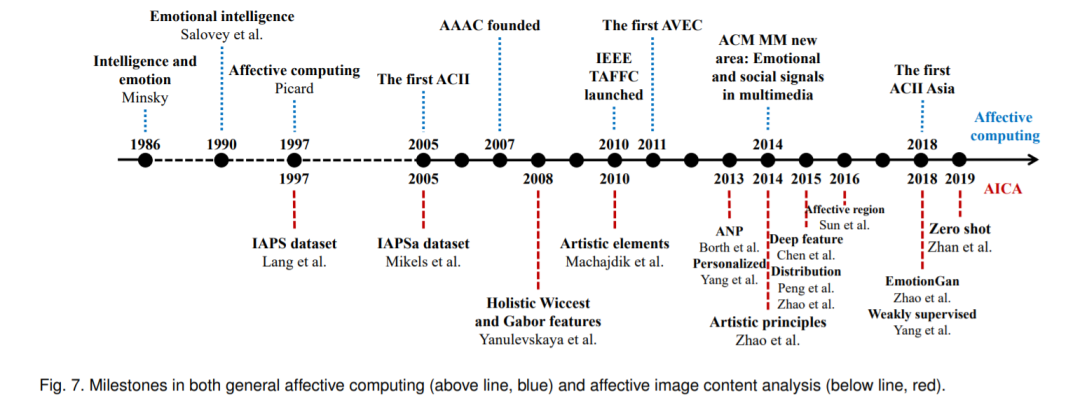

在这项综述中,我们集中回顾了最先进的方法,并概述了研究趋势。首先,我们介绍了1.3节的简要历史,以及与1.4节中其他相关主题的比较。其次,我们在第二节中描述了广泛使用的情感表征模型。第三,我们总结了在第3节中用于进行AICA评估的可用数据集,并定量比较了标签噪声和数据集偏差。第四,基于1.1节的主要目标和挑战,我们总结并比较了情感特征提取、学习方法(主导情感识别、个性化情感预测、情感分布学习、从嘈杂数据或少量标签中学习)等方面的代表性方法。第4、5、6部分分别基于AICA的应用,如图6所示。最后,我们在第7节讨论了可能的研究方向。