视觉提示工程是视觉和图像人工通用智能(AGI)领域的一种基本方法。随着大型视觉模型的发展,提示工程的重要性变得越来越明显。为特定的视觉任务设计合适的提示已经成为一个有意义的研究方向。本综述旨在总结计算机视觉领域中大型视觉模型和视觉提示工程所采用的方法,探索视觉提示工程的最新进展。我们介绍了在视觉领域中具有影响力的大型模型以及应用在这些模型上的一系列提示工程方法。希望本综述提供了基于大型视觉模型的提示工程方法的全面和系统的描述,为未来研究人员在探索这一领域时提供有价值的见解。

1. 引言

自从Vaswani等人引入了Transformer架构[1]以来,深度学习模型在参数规模和复杂性方面取得了显著的进展。随着时间的推移,这些模型的规模呈指数级增长。语言模型的早期示例包括BERT [2]、T5 [3]、GPT-1 [4]、GPT-2 [5]以及各种BERT变种 [6, 7]。此外,还存在大量针对特定领域的BERT变种,旨在优化在不同研究领域或行业的性能 [8–10]。最近,大型语言模型 [11, 12] 成为通用AI系统的构建模块,并通常通过自监督学习 [11–13] 在广泛数据集上进行训练。这些模型规模和复杂度的指数增长显著提高了它们理解自然语言的能力,使其能够适应各种下游任务 [14–19]。值得注意的例子包括GPT-3 [20]、ChatGPT [21]、GPT-4 [22]等等 [23],包括特定领域的大型语言模型 [24]。在没有显式训练的情况下跨多个下游任务进行泛化的能力,通常称为零样本泛化,代表了该领域的一个突破性进展 [13, 25–28]。受预训练语言模型在自然语言处理(NLP)领域的成功启发,研究人员开始探索在计算机视觉领域中预训练的视觉模型。这些视觉模型在大规模图像数据集上进行预训练,具备理解图像内容和提取丰富语义信息的能力。预训练视觉模型的例子包括ViT [29]、Swin Transformer [30]、VideoMAE V2 [31]等等 [32–41]。通过从大量数据中学习表示和特征,这些模型使计算机能够更有效地理解和分析图像,应用于多样的下游应用 [42–48]。此外,多模态视觉模型(如CLIP [49]和ALIGN [50])采用对比学习来对齐文本和视觉信息。这种对齐使得预训练模型能够有效地将学到的语义信息应用于视觉领域,在下游任务中实现高效的泛化。然而,尽管取得了显著的成就,这些模型在泛化能力方面仍然存在限制。

人工智能(AI)的快速发展催生了许多令人兴奋的技术突破,其中基于基础模型的AI系统的发展已成为研究的重要领域[51]。这一概念框架由AI专家提出和统一,代表了该领域的新兴范式[52]。这个概念的重要性延伸到了“出现”的概念,随着机器学习技术的兴起,这一点变得越来越明显。出现表现在诸如自动推理以及通过深度学习(如上下文学习)逐步出现先进特征和功能等任务的执行中。出现的概念强调系统行为是复杂诱导而非显式构建的,突出了基础模型在AI领域中动态性的本质。最近,Segment Anything Model(SAM)[53]引发了解决下游任务的新趋势。通过提示工程模块,具有提示工程能力的模型能够通过提示解决各种下游任务[11, 53, 54]。这些模型显著的零样本泛化能力凸显了提示工程在下游任务中的重要性[55]。然而,将大型视觉模型应用于特定任务需要一种有效的方法来引导模型的学习和推理过程[11, 12, 53],这就是视觉提示工程的作用。它是一种方法论,涉及设计和优化视觉提示,以引导大型模型生成所需的输出。

基础模型的出现释放了人工智能系统发展的巨大潜力,尤其在计算机视觉领域具有重要意义。视觉提示工程作为一种自适应接口和多功能工具包,与大型视觉模型无缝集成。通过将大型视觉模型的能力与视觉提示工程的创造力紧密结合,我们能够充分发挥基础模型的潜力,在图像分析和任务解决领域实现无与伦比的灵活性和效率。这种开创性的整合为探索人工智能应用的广阔前沿铺平了道路,揭示了许多前景,并带来了前所未有的机遇。

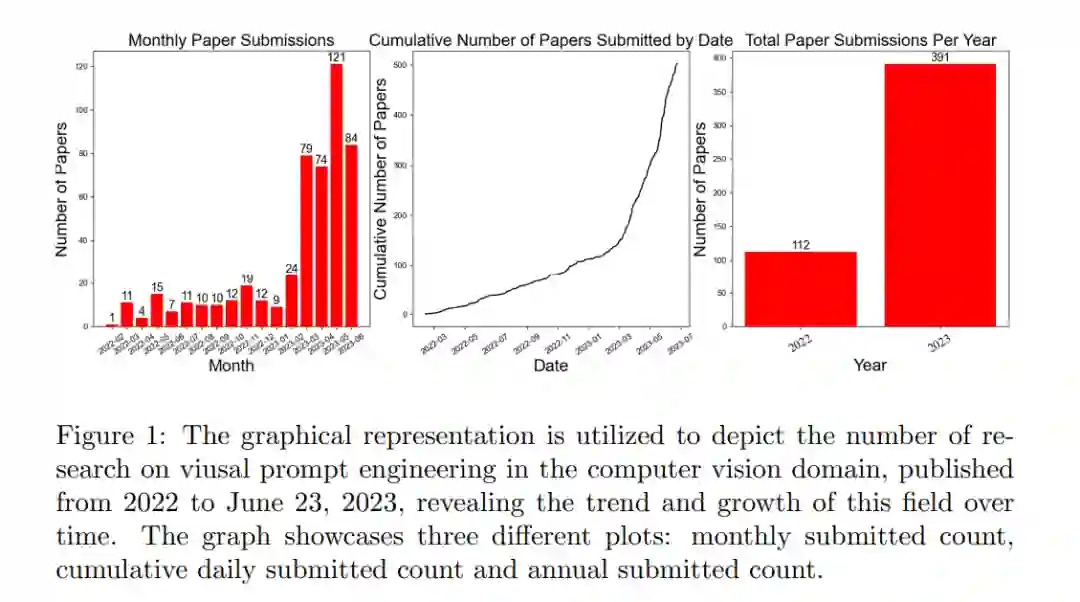

本综述主要关注计算机视觉中的提示工程方法。通过使用关键词"visual prompt"对arXiv进行网络爬虫,收集了一系列相关文献。如图1所示,使用ChatGPT筛选掉与计算机视觉无关的文章,最终得到了500篇论文。这些论文主要讨论与计算机视觉相关的提示算法,涵盖了从多模态视觉语言模型到视觉和通用人工智能模型的各个方面。提示可以采用多种形式,包括多模态设置下的文本提示、图像提示和文本-图像提示,每种形式对于不同任务需要具备独特的特点。本文全面回顾了计算机视觉中的提示工程,深入探讨了多模态提示设计、图像提示设计和文本-图像提示设计等不同方面,并考虑了不同任务的具体要求。旨在阐明计算机视觉中提示工程的进展和现状,从而促进该领域的进一步研究。

本综述全面概述了计算机视觉提示的最新进展,并总结了该领域现有的设计方法。综述的结构如下所示:引言部分追溯了基础AI模型的演进,从Transformer架构的诞生到大规模视觉模型的发展,强调了这些模型的增长和复杂性如何推动了提示(包括视觉提示)的创新应用。第二部分概述了对视觉提示和AGI的发展做出重要贡献的关键模型,包括Transformer、CLIP、Visual Prompt Tuning(VPT)和SAM。这些有影响力的模型作为基础参考,有助于理解后续关于AGI中提示学习和应用的讨论。第三部分深入探讨了视觉提示学习,重点关注多模态提示和视觉提示调优。探索了专门为多模态提示设计的不同模型及其变种,突出了该领域的不同方法和应用。此外,本节还讨论了使得视觉提示能够有效调优以提升特定任务或领域性能的模型及其变种,强调了为不同应用选择适当的提示模态的重要性,例如在医学图像分割中使用边界框提示和在自然图像理解中使用文本提示。第四部分重点介绍了视觉提示在AGI模型中的应用,突出了在AGI架构中集成提示的作用,并展示了它们对强泛化性能的贡献。呈现了视觉提示在AGI模型中的最新进展,说明适当的提示设计如何能够在不同领域和任务中实现性能的提升。第五部分探讨了视觉提示研究的未来方向和意义。我们讨论了该领域的潜在发展,同时考虑了AGI及相关领域的进展。除了进展,本节还讨论了视觉提示技术所面临的挑战和机遇,并对视觉提示的更广泛影响和潜在影响进行了深入探讨。结论部分对综述中讨论的主要观点进行了总结。强调了视觉提示在AGI中的关键作用以及其提升性能和泛化能力的潜力。重申了提示设计和不同应用的不同模态的重要性,并突出了该领域未来的研究前景。结论简洁地概括了视觉提示的重要性及其对AGI的意义,并作为结束语使读者对视觉提示的重要性有清晰的理解。

2. 多模态模型和提示

在多模态提示学习的研究领域受到了广泛关注,该领域涌现了一些显著的工作。包括CLIP、CoOP、DenseCLIP、MaPLe、Imagic、GALIP 、PTP。

在计算机视觉任务中,视觉提示的利用可以追溯到交互式分割技术,这种技术需要用户的输入,如点击[123–127]、边界框[128–130]或涂鸦[131–133],以引导算法准确地识别物体边界。这些视觉提示为分割过程提供了有价值的指导,使结果更加精确可靠。在少样本图像分割的情境中,标注的支持图像也可以被视为另一种形式的视觉提示[134–136]。通过利用支持图像及其对应的分割掩模中的信息,算法可以将其分割能力推广和适应到类似的目标图像上。

最近,受到提示工程在自然语言处理(NLP)中的成功启发,计算机视觉领域在利用提示方面取得了一系列的进展。研究人员开始探索将提示构建为针对特定视觉任务的连续向量的思路。这涉及将提示设计为计算机视觉模型的引导信号,帮助它们更有效地生成或分析视觉内容。通过使用特定任务的提示对模型进行微调,已经在包括图像分类、目标检测和图像生成在内的各种视觉任务中取得了显著的改进。

3. 视觉提示在AGI中

通过通用模型在各个领域展示出的令人印象深刻的泛化能力,大型计算机视觉模型也取得了显著的进展。通过在多样化的数据集上训练基础模型,这些模型能够通过提示学习来适应下游任务。这种方法不仅减轻了训练需求和优化资源利用,还为计算机视觉的发展开辟了新的途径。例如,创新的"segment anything model"通过使用适当的提示实现了强大的零样本传递能力,因此在各个领域具有多种应用。这种通用的人工智能模型能够学习通用概念,并在未知数据上展现出零样本传递能力,展示了通用人工智能的巨大潜力。然而,提示工程仍然对将模型推广到新任务至关重要,并且不能被其他因素所淹没。提示工程是指设计使模型能够适应和推广到不同任务的提示的过程。这个问题至关重要,因为适当设计的提示可以导致有效的表示学习,从而提高模型在各种任务上的性能。提示应该被强调为引导模型理解和适应所见或未见任务的上下文和要求的关键。许多其他模型也已经出现,包括OneFormer [141]、SegGPT [142]、SEEM [143]、Uni-Perceiver v2 [144]等值得注意的模型,它们在通用人工智能方面展示出强大的能力,并为解决各种任务提供了新的可能性。这些模型采用了零样本传递的方法,使得提示学习成为模型泛化能力的一个重要体现。在本节中,我们将详细解释基于即时、交互式模型的提示构建方法,涵盖关键要素,如目标检测、多模态融合和各种模型的结合。这些方法为利用大型模型的泛化能力提供了强大的工具,从而为实现下游任务提供可行的解决方案。

4. 未来方向和影响

随着强大的大型视觉模型的不断进步,提示在这些模型中的重要性变得更加突出。设计精心制作的提示以有效地指导下游任务已成为应对这个问题的新兴途径。然而,通用人工智能的性能仍然受限于其对领域特定知识的依赖。为了克服这个限制,未来的努力应该集中在扩大知识的广度上,通过整合多样化和全面的数据集、采用跨学科的方法论,并促进不同领域专家之间的富有成果的合作。这些努力将有助于提高AI系统的能力,并以更全面的方式应对利用提示所面临的挑战。

5. 结论

本综述论文全面评估了计算机视觉领域中提示工程取得的显著进展。它详细探讨了基于ViT网络架构的视觉提示设计以及利用AGI模型进行提示的应用。从模型为中心的角度,本研究深入探讨了提示对下游任务的积极影响,强调了它们激发和增强大型模型新兴能力的潜力。此外,本文对提示工程在不同场景和领域的重要性和性能进行了深入讨论,强调了它在计算机视觉领域的关键作用。本文强调了提示工程中潜在的巨大潜力,为这一学科的突破性进展带来了希望。最后,本文通过对未来研究方向的展望,突出了利用提示工程彻底改变计算机视觉的显著前景。这一技术具有改进现有模型和实现新应用的无与伦比的潜力,为进一步研究该领域提供了启示。鉴于提示在计算机视觉中在各个领域的日益重要,本研究的结果具有高度的相关性和及时性。