LLNL国家实验室《计算高效深度学习:算法趋势和机遇》,52页pdf

https://arxiv.org/abs/2210.06640

-

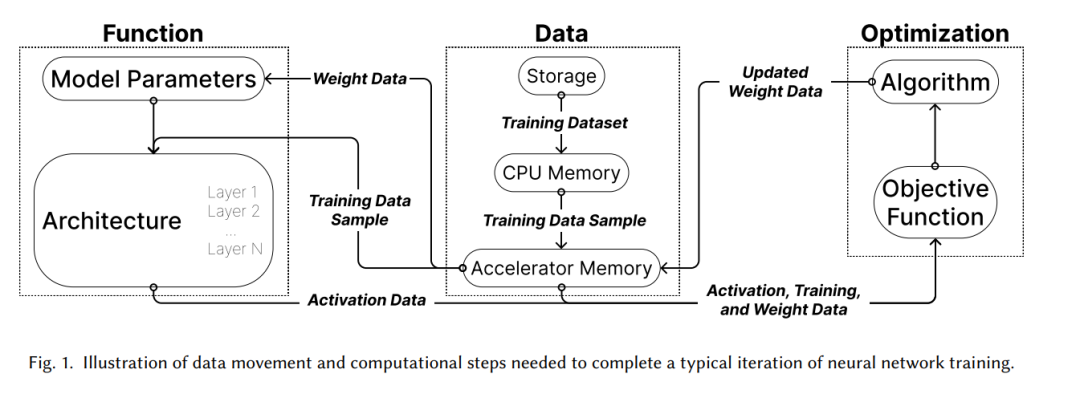

形式化加速:我们回顾DNN效率指标,然后形式化算法加速问题。 -

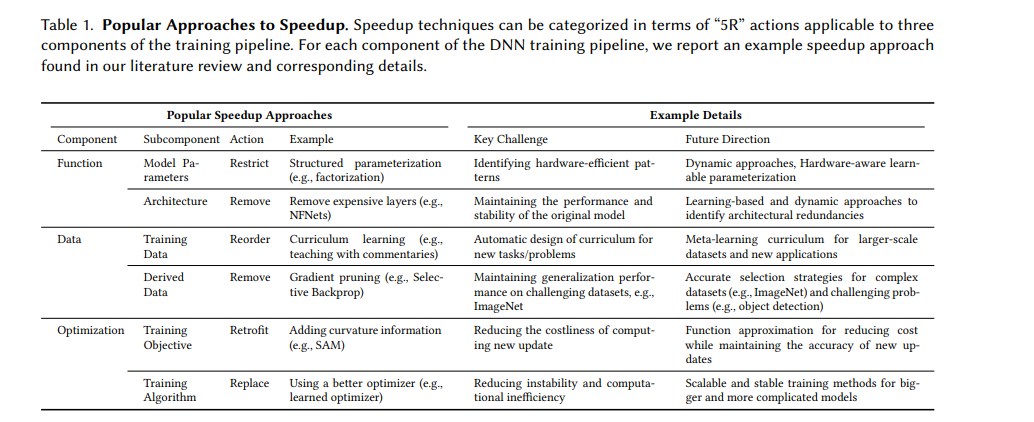

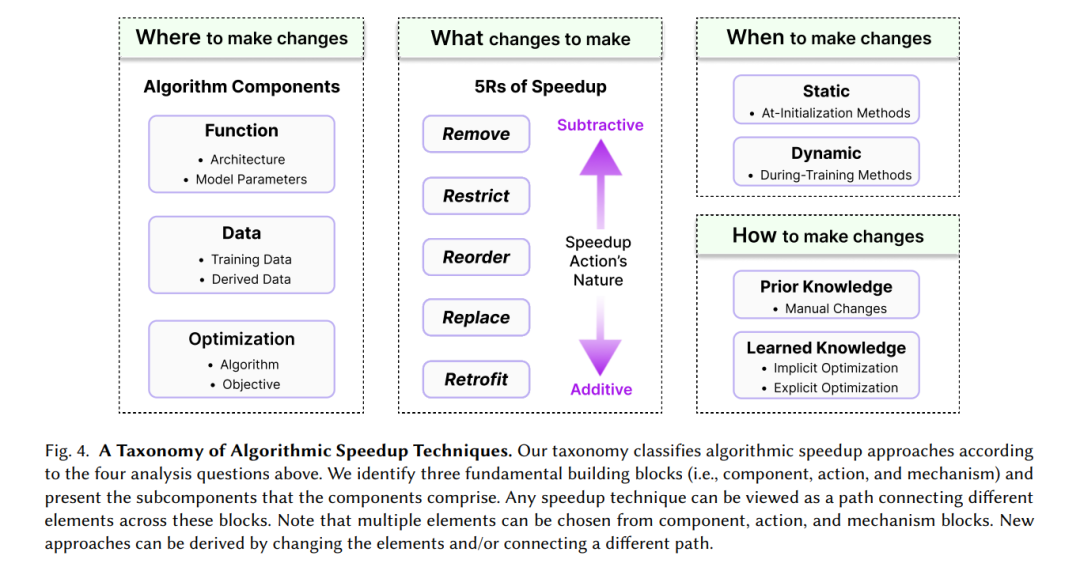

分类和调研:我们通过适用于3个培训管道组成部分的5个加速行动(5Rs)对200多篇论文进行分类(见表1和表3)。分类有助于为从业者选择方法,为读者消化文献,并为研究人员识别机会。 -

最佳评估实践:我们识别了文献中常见的评估陷阱,并相应地提出最佳评估实践,以实现对各种加速技术的全面、公平和可靠的比较。 -

从业者指南:我们讨论了影响加速方法有效性的计算平台瓶颈。根据训练管道中瓶颈的位置,提出适当的方法和缓解措施。

专知便捷查看

便捷下载,请关注专知公众号(点击上方蓝色专知关注)

后台回复“DL52” 就可以获取《 LLNL国家实验室《计算高效深度学习:算法趋势和机遇》,52页pdf》专知下载链接

登录查看更多

相关内容

The Decades Progress on Code-Switching Research in NLP: A Systematic Survey on Trends and Challenges

Arxiv

0+阅读 · 2022年12月19日

Arxiv

0+阅读 · 2022年12月19日