对抗样本是当前深度学习神经网络研究的热点问题.目前,对抗样本技术的研究主要分为2方 面:生成攻击、检测防御.在总结对抗样本生成攻击技术的基础上,面向图像数据的对抗样本检测与防御 技术综述从对抗样本的检测与防御的角度对面向图像数据的对抗样本防御技术进行了总结.综述从特 征学习、分布统计、输入解离、对抗训练、知识迁移及降噪6个方面将检测与防御技术进行归类,介绍检 测与防御技术的演进,分析其特点、性能,对比不同技术的优缺点,给出了检测效果和防御效果的综合评 价.最后对当前该领域的研究情况进行了总结与展望。 深度神经网络(deepneuralnetwork,DNN)能 处理复杂的科学问题,已成功应用于目标跟踪与检 测[1]、文字处理[2]、语音处理[3]、图像识别[4]等领域. 近期研究发现,DNN 模型很容易受到对抗样本的攻 击,将对抗样本输入高准确率的 DNN 模型后,模型 的准确率会明显降低[5]. 目前,对抗样本的研究主要分为2方面:1)对抗 样本生成技术;2)对抗样本检测与防御技术.由于对 抗样本生成技术的对抗攻击会对 DNN 模型造成负 面影响,尤其在医疗[6]、运输[7]等信息敏感领域,因 此,对抗样本的检测与防御技术成为目前 DNN 安 全的研究热点[8]. 本文重点关注对抗样本检测与防御技术,描述 其演进过程,并从特征学习、分布统计、输入解离、对 抗训练、知识迁移和降噪等6个方面对检测与防御 技术进行汇总归纳,分析对比每类技术的性能、优缺 点,使读者对对抗样本的检测与防御机制有直观的 了解. 鉴于当前对抗样本的研究大多选择图像数据作 为输入样本,本文的讨论也集中于图像处理领域.

1 对抗样本概述

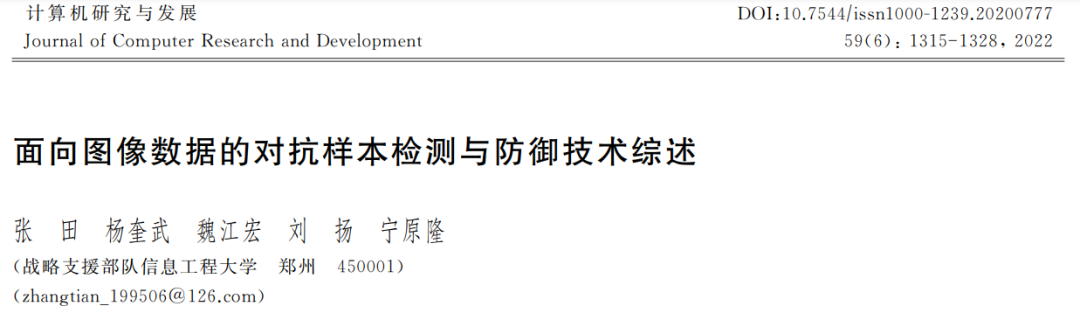

对抗样本是指在原始数据集中的样本中通过有 目的地添加少量的扰动信息,使得基于 DNN 模型 的系统出现误判的样本[5]. 理论上,输入空间的某个邻域可以从不同的角 度表征同一个对象,即输入空间的某邻域内的数据 应有相同的输入标签和统计分布. 对抗样本的发现否 定 了 这 一 推 测.Szegedy 等 人[5]发现,被神经网络正确分类的原始样本添加了 微小扰动后,神经网络对其的分类准确率显著下降. 图1左图为 Goodfellow 等人[9]在ImageNet数据集上训练了 GoogLeNet模型,中间图为快速生成 的对抗扰动,右图为添加扰动后的对抗样本,原模型 将图像x 以置信度57.7%判定为“熊猫”,在加入微小 扰动后,模型以置信度99.3%将其判定为“长臂猿”.对抗样本的成因主要有4种假说:盲区假说、线 性假说、决策面假说、流形假说[8].

2 对抗样本生成技术

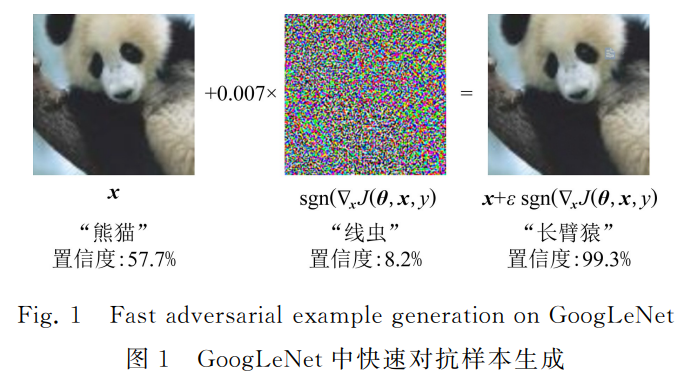

图2展示了对抗样本生成技术演进.对抗样本 生成技术可分为黑盒攻击和白盒攻击2类,目前白 盒攻击的成 果 更 多,但 以 对 抗 样 本 的 迁 移 性 为 基 础的黑盒攻击更具有实际意义.白盒攻击中,基于梯 度的算法为经典算法,随着神经网络的广泛应用,又 出现了基于对抗式生成网络(generativeadversarial network,GAN)、针对语义图像分割、对象检测模 型等生成技术.

3 对抗样本检测与防御技术

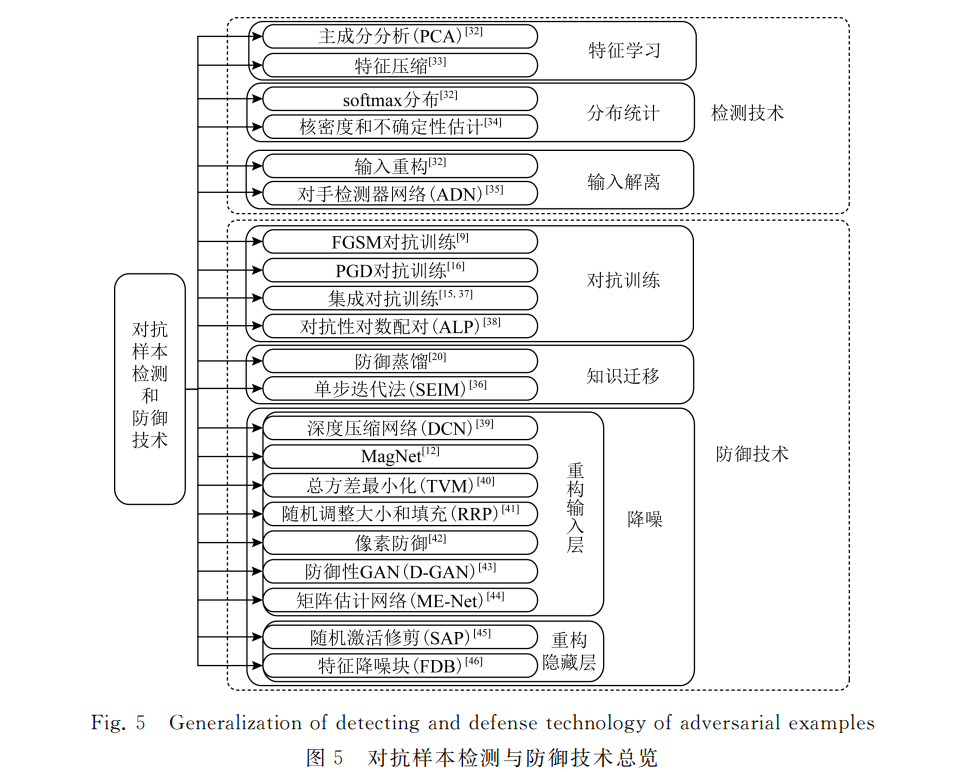

对抗样本检测与防御技术分为检测与防御2部 分,检测技术可以分为特征学习、分布统计、输入解 离这3类,防御技术可以分为对抗训练、知识迁移、 降噪这3类,如图5所示:

检测技术从早期的探索对抗样本与原始样本的 特征或数字特征之间的区别,到近期的与防御技术 相结合,通过解离输入将输入的某个特征或某部分 作为检测器的输入,从而检测出对抗样本. 最早的防御技术是对抗训练,但对抗训练依赖 于训练数据集,所以会产生过拟合问题,可以通过知 识迁移提升模型泛化能力.降噪是近期热门的防御 技术,但降噪依赖于梯度掩蔽,这一问题尚未得到 解决.

-

特征学习主要用于对抗样本检测,这种方法基 于对抗样本与原始样本的不同特征,通过降维将高 维的复杂数据转化为低维数据,从而降低检测难度.

-

分布统计的核心思想是利用对抗样本与原始样 本的不同数字特征,通过检测输入是否符合原始样 本的分布,从而判断输入是否具有对抗性.

-

输入解离是一种检测与防御相结合的方式,核 心思想是通过分解输入,将其的某个特征或某部分 作为检测器的输入,从而检测出对抗样本.

-

对抗训练法的核心思想在于将对抗样本加入模 型训练集,从而提升模型的鲁棒性.不同对抗训练之 间的差异主要在于生成训练数据的方式,因此产生 数据集依赖,可以通过知识迁移技术提升模型的泛 化能力.

-

知识迁移是一种能提升网络泛化能力的技术, 通过训练数据集以外的样本来平滑训练过程中学到 的模型.最早运用这种技术的是 Hinton等人[20]提 出的防御蒸馏网络[21],近期提出的SEIM 方法[37]也 用到了这一技术.

-

降噪的核心思想是:通过对对抗样本施加变换, 破坏添加的噪声,从而消除扰动的影响,提高分类器 的准确性.根据神经网络的结构,降噪法可以2次细 分为输入层降噪和隐藏层降噪2类,但无论是哪种 降噪方法,都依赖于梯度掩蔽,这也意味着目前基于 降噪技术的防御方法对 BPDA 等攻击方式都显示 出脆弱性.

4 对抗样本检测与防御技术评价

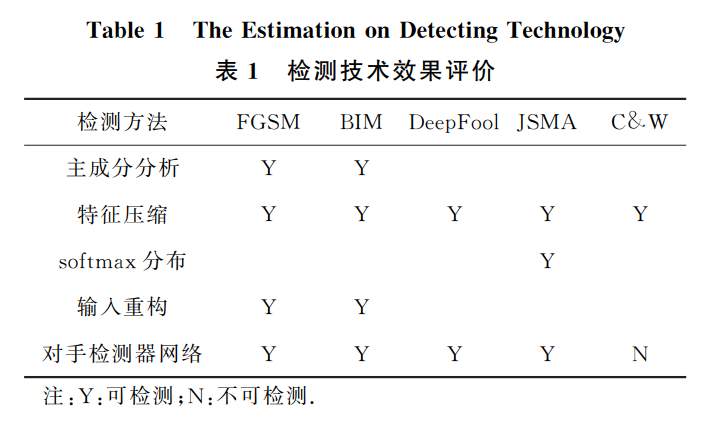

目前,检测技术的研究因在数理层面对对抗样 本缺乏共识而受限.除softmax分布[32]检测法以外, 目前检测技术的主要测试样本是 FGSM [9]或 BIM [13] 对抗样本,softmax分布仅适用于输入对抗样本后 立即停止的特定攻击.如表1所示,特征压缩[33]的 检测范围更广,但当攻击者完全了解检测机制时,可 以绕过特征压缩的检测

表3展示了不同检测与防御类别的比较.检测 方法更偏向于数据驱动,在攻击者了解检测机制的 条件下,能够通过对数据的处理绕过检测.因此,检 测、防御相结合的方式是研究趋势.防御方法围绕提 升模型准确率和降低攻击成功率这2方面展开,在 防御中降低数据依赖性、提升模型泛化能力以及提 升对高强度攻击的抵抗性依旧是亟待解决的问题

5 总结与展望

本文介绍了对抗样本生成攻击技术、检测与防 御技术,生成攻击倾向于黑盒攻击的研究,是因为黑 盒攻击更具有现实意义. 相比生成技术,检测与防御技术具有滞后性,因 此防御方法往往会受到特定的攻击.早期生成技术 基于梯度,现有的防御技术基于梯度掩蔽,而 BPDA 等引入近似性的生成技术则能够攻击基于梯度掩蔽 的防御技术. 鉴于检测与防御技术的滞后性,目前研究的难 点在于:首先是提升自适应性,现有的防御方法大都 针对已有的攻击,不能保证对未知攻击的鲁棒性.其 次是扩大防御范围,现有的防御方法无法防御多种 类型的攻击. 针对这个难点,有研究将其他现有的算法用来 进行 对 抗 攻 击 和 防 御,例 如:强 化 学 习[49]或 元 学 习[50]等.还有研究通过研究神经网络的特性来探寻 对抗样本的成因与防御[51G52].例如:Geirhos等人[51] 发现卷积神经网络强调纹理特征,增加形状权重能 够改善模型的鲁棒性.Zhang等人[52]的工作进一步 表明,对抗训练模型更强调形状特征或边缘特征而 非纹理特征. 本文重点关注了图像领域的对抗样本检测与防 御技术,但对抗样本在文字、语音等领域也存在,这 也是未来可能的研究方向.