【导读】国际万维网大会(The Web Conference,简称WWW会议)是由国际万维网会议委员会发起主办的国际顶级学术会议,创办于1994年,每年举办一届,是CCF-A类会议。WWW 2020将于2020年4月20日至4月24日在中国台湾台北举行。本届会议共收到了1129篇长文投稿,录用217篇长文,录用率为19.2%。上周专知小编提前整理了WWW 2020图神经网络(GNN)比较有意思的的论文,这期小编继续为大家奉上WWW 2020推荐相关论文供参考! WWW2020GNN

- Correcting for Selection Bias in Learning-to-rank Systems

作者:Zohreh Ovaisi, Ragib Ahsan, Yifan Zhang, Kathryn Vasilaky and Elena Zheleva

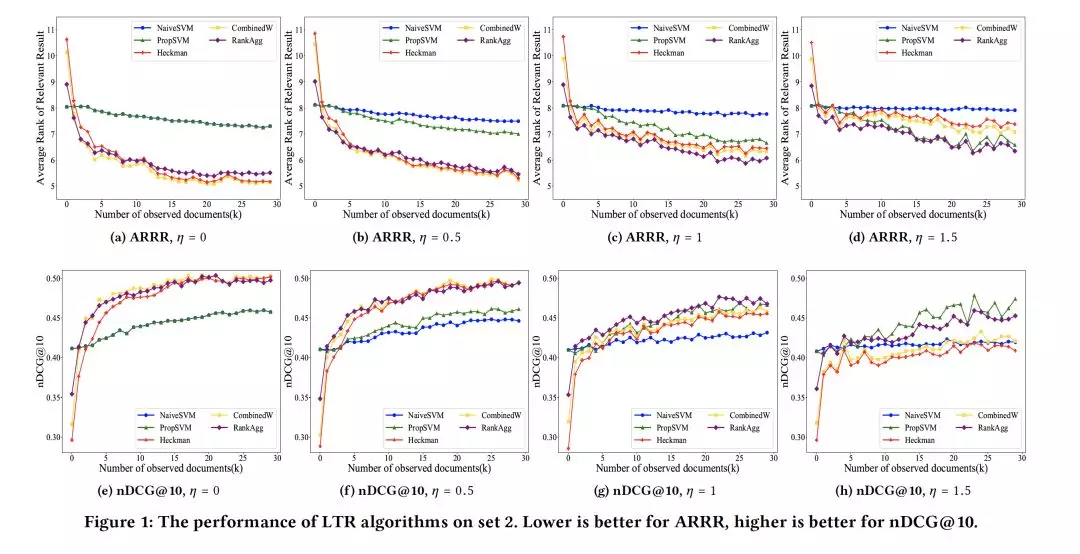

摘要:现代推荐系统收集到的点击数据是用来训练学习排名(LTR)系统的观察数据的重要来源。然而,这些点击数据会受到许多偏差(bias)的影响,这些偏差可能会导致LTR系统的性能变差。在此类系统中,最近的偏差校正(bias correction)方法主要集中在位置偏差上,即虽然不是用户查询最相关的,但排名较高的结果(例如,顶级搜索引擎结果)更可能被点击。由于所点击的文档反映了什么文档首先向用户展示,因此大部分方法对校正选择偏差的关注较少。在本文中,我们提出了新的方法,这些方法可以适应Heckman的两阶段方法,并考虑LTR系统中的选择偏差和位置偏差。我们的实验评估表明,与现有的无偏LTR算法相比,我们提出的方法对噪声的鲁棒性更高,并且具有更好的准确性,尤其是在存在中度偏差到无位置偏差的情况下。

网址: https://arxiv.org/abs/2001.11358

- Efficient Neural Interaction Function Search for Collaborative Filtering

作者:Quanming Yao, Xiangning Chen, James T. Kwok, Yong Li and Cho-Jui Hsieh

摘要:在协同过滤(CF)中,交互函数(IFC)扮演着捕获项目和用户之间交互的重要角色。最流行的交互函数(IFC)是内积,它已经成功地应用于低阶矩阵分解。然而,现实世界应用中的交互可能非常复杂。因此,可以提供更好性能的操作(例如:串联和级联)被提出。然而,现有的IFC仍然很难在不同的应用场景中保持一致的良好性能。受AutoML的启发,本文提出在CF中寻找简单神经交互函数(SIF)。通过对现有CF方法的研究和推广,设计了一种具有表现力的SIF搜索空间,并将其表示为结构化的多层感知机。我们提出了一种one-shot搜索算法,可以同时更新体系结构和学习参数。 实验结果表明,所提出的方法比流行的AutoML方法效率更高,比最新的CF方法可以获得更好的预测性能,并且可以针对不同的数据集和任务发现不同的IFC。

网址: https://arxiv.org/abs/1906.12091

- Influence Function based Data Poisoning Attacks to Top-N Recommender Systems

作者:Minghong Fang, Neil Zhenqiang Gong and Jia Liu

摘要:推荐系统是Web服务中吸引用户的重要组成部分。流行的推荐系统使用大量众包用户-项目交互数据(例如评级得分)对用户偏好和项目属性进行建模;然后,将与用户偏好最匹配的前N个项目推荐给用户。在这项工作中,我们展示了攻击者可以通过向虚假用户注入精心制作的用户-项目交互数据,对推荐系统发起数据中毒攻击,从而按照攻击者的意愿进行推荐。具体地说,攻击者可以诱导推荐系统向尽可能多的普通用户推荐目标项目。我们关注已经在行业中得到了广泛的应用的基于矩阵分解的推荐系统。给定攻击者可以注入的虚假用户数量,我们将虚假用户评分的制定过程描述为一个优化问题。但是,该优化问题是一个非凸整数规划问题,求解起来很有挑战性。为了解决这一挑战,我们开发了几种技术来近似解决优化问题。例如,我们利用影响函数(influence function)来选择对推荐有影响力的普通用户子集,并基于这些有影响力的用户来解决我们制定的优化问题。实验结果表明,我们的攻击是有效的,并且优于现有的方法。

网址: https://arxiv.org/abs/2002.08025

- Learning Multi-granular Quantized Embeddings for Large-Vocab Categorical Features in Recommender Systems

作者:Wang-Cheng Kang,Derek Zhiyuan Cheng, Ting Chen, Xinyang Yi, Dong Lin, Lichan Hong and Ed H. Chi

摘要:推荐系统模型通常通过嵌入来表示像用户、项目和分类特征这类的稀疏特征。标准方法是将每个唯一的特征值映射为嵌入向量。所产生的嵌入表的大小随着词汇表的大小线性增长。因此,大词汇量不可避免地会导致巨大的嵌入表,从而产生两个严重的问题:(I)使服务于资源紧张环境中的模型变得难以处理;(ii)造成过拟合的问题。在本文中,我们致力于学习用于推荐系统(recsys)中大型词汇稀疏特征的高度简洁的嵌入。首先,我们证明了新的可微积量化( Differentiable Product Quantization,DPQ)方法可以推广到Recsys问题。此外,为了更好地处理Recsys中常见的幂律数据分布,我们提出了一种多粒度量化嵌入(MGQE)技术,该技术对不频繁的项目学习更简单的嵌入。我们尝试以简单的模型规模为提高推荐性能提供一个新的角度。在三个推荐任务和两个数据集上的大量实验表明,我们可以用原始模型规模的20%的模型获得与原模型相当甚至更好的性能。

网址: https://arxiv.org/abs/2002.08530

- Beyond Clicks: Modeling Multi-Relational Item Graph for Session-Based Target Behavior Prediction

作者:Wen Wang, Wei Zhang, Shukai Liu, Bo Zhang, Leyu Lin and Hongyuan Zha

摘要:基于会话的目标行为预测旨在预测要与特定行为类型(例如,点击)进行交互的下一个项目。虽然现有的基于会话的行为预测方法利用强大的表示学习方法来编码项目在低维空间中的顺序相关性,但是它们受到一些限制。首先,它们侧重于只利用同一类型的用户行为进行预测,而忽略了将其他行为数据作为辅助信息的潜力。当目标行为稀疏但很重要(例如,购买或共享物品)时,这一点尤为重要。其次,项目到项目的关系是在一个行为序列中单独和局部建模的,缺乏一种规定的方法来更有效地全局编码这些关系。为了克服这些局限性,我们提出了一种新的基于会话的目标行为预测的多关系图神经网络模型MGNN-SPred。具体地说,我们基于来自所有会话的所有行为序列(涉及目标行为类型和辅助行为类型)构建多关系项目图(Multi-Relational Item Graph,MRIG)。在MRIG的基础上,MGNN-SPred学习全局项目与项目之间的关系,进而获得用户偏好。即分别为当前目标行为序列和辅助行为序列。最后,MGNN-SPred利用门控机制自适应地融合用户表示,以预测与目标行为交互的下一项目。在两个真实数据集上的广泛实验证明了MGNN-SPred与最新的基于会话的预测方法相比的优越性,验证了利用辅助行为和基于MRIG学习项目到项目关系的优点。

网址: https://arxiv.org/abs/2002.07993

- Towards Detection of Subjective Bias using Contextualized Word Embeddings

作者:Tanvi Dadu, Kartikey Pant and Radhika Mamidi

摘要:主观偏见检测(Subjective bias detection)对于宣传检测、内容推荐、情感分析和偏见消除等应用至关重要。这种偏见是在自然语言中通过煽动性的词语和短语引入的,使人对事实产生怀疑,并预设事实。在这项工作中,我们在维基中立性语料库(WNC)上使用基于BERT的模型进行了全面的主观偏见检测实验。数据集为36万个来自维基百科并删除了各种偏见的标记实例组成。我们进一步提出了基于BERT的集成,其性能优于BERT_large之类的最新方法5.6 F1 score。