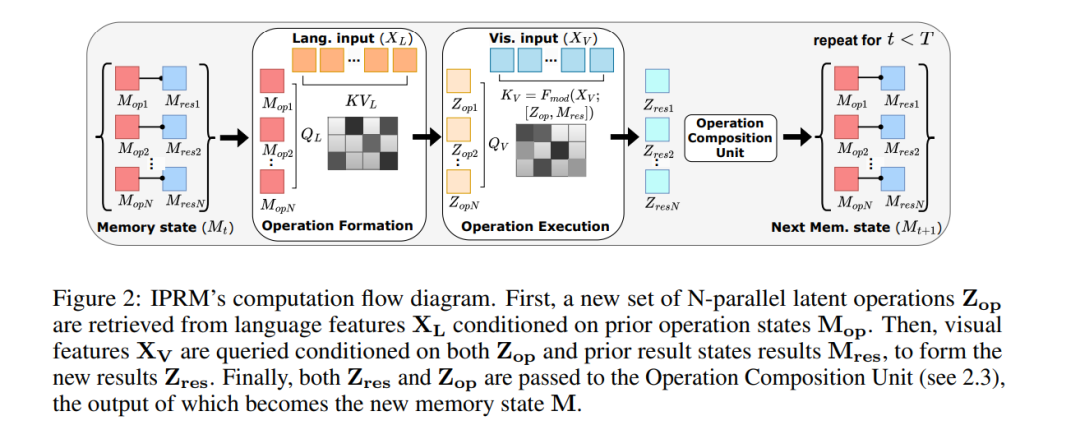

**复杂视觉推理与问题回答(VQA)是一个具有挑战性的任务,要求具备超越简单物体和事件识别与定位的组成性多步处理能力和更高层次的推理能力。**在本文中,我们提出了一种完全神经化的迭代与并行推理机制(IPRM),该机制结合了两种不同形式的计算——迭代计算和并行计算——以更好地解决复杂的VQA场景。具体来说,IPRM的“迭代”计算有助于在需要动态计算、存储和回忆个别操作的场景中进行逐步的组成性推理(例如,计算查询:“确定坐在白色桌子旁边穿红色T恤的孩子左侧的笔的颜色”)。与此同时,其“并行”计算允许同时探索不同的推理路径,并有利于独立操作的更强鲁棒性和高效执行(例如,在查询“确定所有T恤中出现频率最高的颜色”时计算每种颜色的数量)。我们将IPRM设计为一个轻量级、完全可微的神经模块,可以方便地应用于变换器(transformer)和非变换器的视觉-语言骨干网络。它在多个图像和视频VQA基准测试中,超越了先前的任务特定方法和基于变换器的注意力模块,测试了不同的复杂推理能力,如组成性时空推理(AGQA)、情境推理(STAR)、多跳推理泛化(CLEVR-Humans)和因果事件链接(CLEVRER-Humans)。此外,IPRM的内部计算可以在推理步骤中进行可视化,有助于提高其可解释性和错误诊断。源代码将发布于:https://github.com/shantanuj/IPRM_Iterative_and_Parallel_Reasoning_Mechanism

成为VIP会员查看完整内容

相关内容

Arxiv

42+阅读 · 2023年4月19日

Arxiv

84+阅读 · 2023年4月4日

Arxiv

151+阅读 · 2023年3月29日