虽然蜂群机器人具有不同程度的自主性,但人类操作员在执行任务之前和期间指挥和控制蜂群仍然非常重要。因此,必须开发出对操作员来说直观的人机交互界面,并能向大规模蜂群网络中的飞行和地面机器人传达准确的指令。此外,必须对蜂群收集的大量信息进行分类,并以减少认知负荷的方式呈现给用户,以便用户确定信息的相关性及其对任务的影响。在本文中,我们介绍了基于草图和增强现实的界面,这些界面既可用于指挥和控制(C2)无人地面和飞行器,也可用于处理蜂群在现场收集的数据。这些界面在两个实地实验中进行了测试,实验中部署了多个空中和地面机器人执行任务。最后,讨论了现场实验的结果、经验教训和未来工作领域。

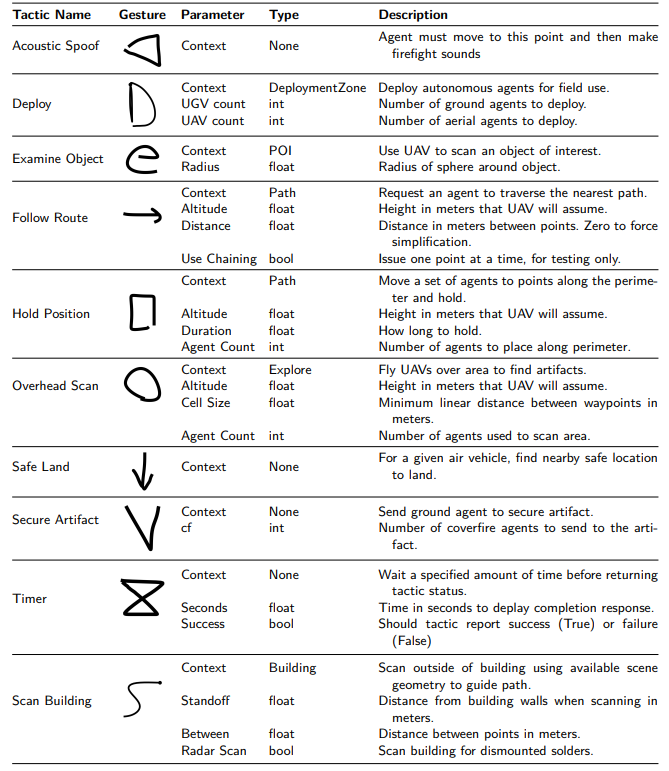

表 1. 操作员可以执行的直观草图子集以及相应的策略,以便将其分发到蜂群网络。

系统设计

设计了两个界面,以评估在大规模飞行和地面蜂群的指挥和控制应用中使用高级用户界面的情况。这些界面并不相互排斥,因为它们可以代表不同的操作员在不同的环境下执行相同的任务。第一个界面是一个基于草图的系统,可收集用户的二维数据,并将其转化为蜂群网络的指令。第二个界面利用增强现实技术在用户手上再现二维平板电脑,并允许执行三维草图数据。虽然这些界面是根据以前的研究(LaViola,2015;Sakamoto 等人,2009)中吸取的经验教训建立的,但它们被结合成一种独特的多模式方法,用于指挥和控制大规模蜂群网络。

用 python (pyc2) 编写了一个集中式服务器应用程序,用于处理界面和蜂群网络之间的数据分发。该系统还能跟踪机器人的健康状况和总体状态,从而决定哪些机器人有能力共同完成任务。该接口是进入蜂群网状网络的通道,能够向蜂群发布任务,由各个机器人竞标完成。

将详细介绍这两个界面向操作员传递信息的能力,以便操作员了解态势并指挥机器人群。我们还确定了每个界面中对导航和任务操作有用的关键功能。

图 1. 操作员在现场实验中使用的战术显示器。