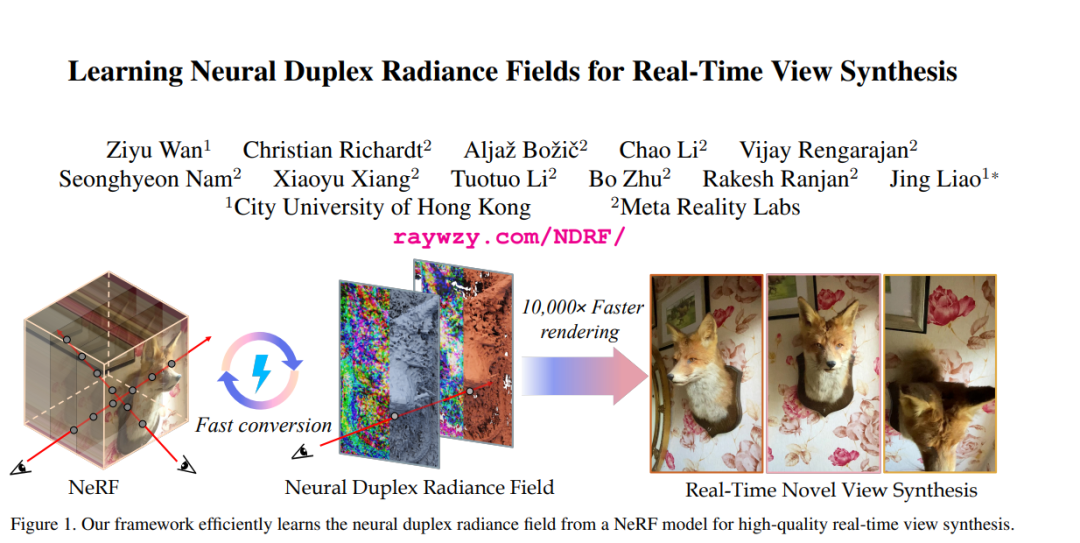

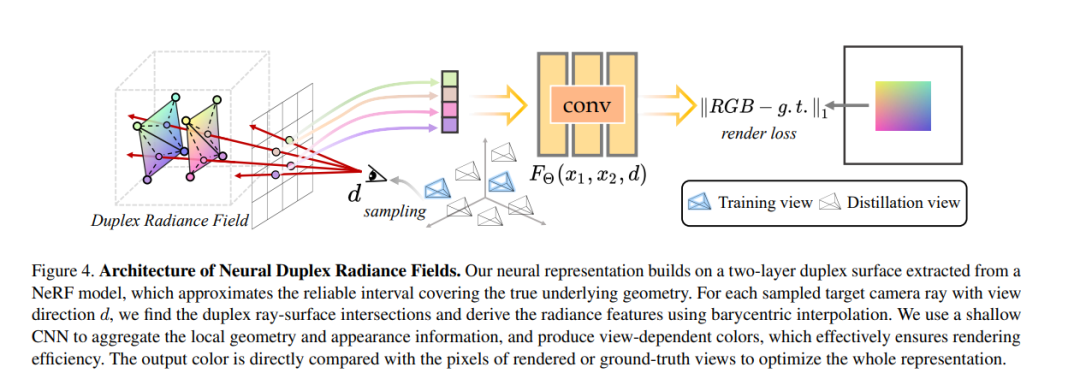

神经辐射场(NeRFs)能够以前所未有的视觉质量实现新视图合成。然而,为了渲染出逼真的图像,NeRFs需要对每个像素进行数百次深度多层感知器(MLP)评估。这在成本上是难以承受的,甚至在强大的现代GPU上也无法实现实时渲染。在本文中,我们提出了一种新颖的方法,将NeRFs提炼并烘焙到高效的基于网格的神经表示中,这种表示与大规模并行的图形渲染管道完全兼容。我们将场景表示为编码在双层复式网格上的神经辐射特征,通过学习来自可靠射线-表面交点区间的聚合辐射信息,有效地克服了3D表面重建中固有的不准确性。为了利用附近像素的局部几何关系,我们使用屏幕空间卷积代替NeRFs中使用的MLP来实现高质量的外观。最后,整个框架的性能通过一种新颖的多视图提炼优化策略得到进一步提升。我们通过在一系列标准数据集上进行广泛实验,证明了我们方法的有效性和优越性。

https://www.zhuanzhi.ai/paper/58116caa363c00c6b2d79f40b3f1de3e

成为VIP会员查看完整内容

相关内容

CVPR 2023大会将于 6 月 18 日至 22 日在温哥华会议中心举行。CVPR是IEEE Conference on Computer Vision and Pattern Recognition的缩写,即IEEE国际计算机视觉与模式识别会议。该会议是由IEEE举办的计算机视觉和模式识别领域的顶级会议,会议的主要内容是计算机视觉与模式识别技术。

CVPR 2023 共收到 9155 份提交,比去年增加了 12%,创下新纪录,今年接收了 2360 篇论文,接收率为 25.78%。作为对比,去年有 8100 多篇有效投稿,大会接收了 2067 篇,接收率为 25%。

Arxiv

0+阅读 · 2023年6月5日

Arxiv

0+阅读 · 2023年6月5日

Arxiv

0+阅读 · 2023年6月2日

Arxiv

0+阅读 · 2023年6月1日

Arxiv

42+阅读 · 2023年4月19日