自然语言理解(NLU)系统需要把人类产生的文本进行编码,然后在深层次的语义层面上进行推理。NLU系统通常都会包括到两个部分:第一个是编码器(encoder),它将语言中的单词组合在一起作为输入,编码产生一个新的表示,然后将这些表示作为第二部分--预测器(predictor)中的特征,然后在这些编码过的输入信息上进行推理并生成所需的输出。本文的研究目标是构建一个端到端的NLU系统,能够结合相关的背景知识对输入信息进行编码,然后在上下文的语境中对其进行推理。

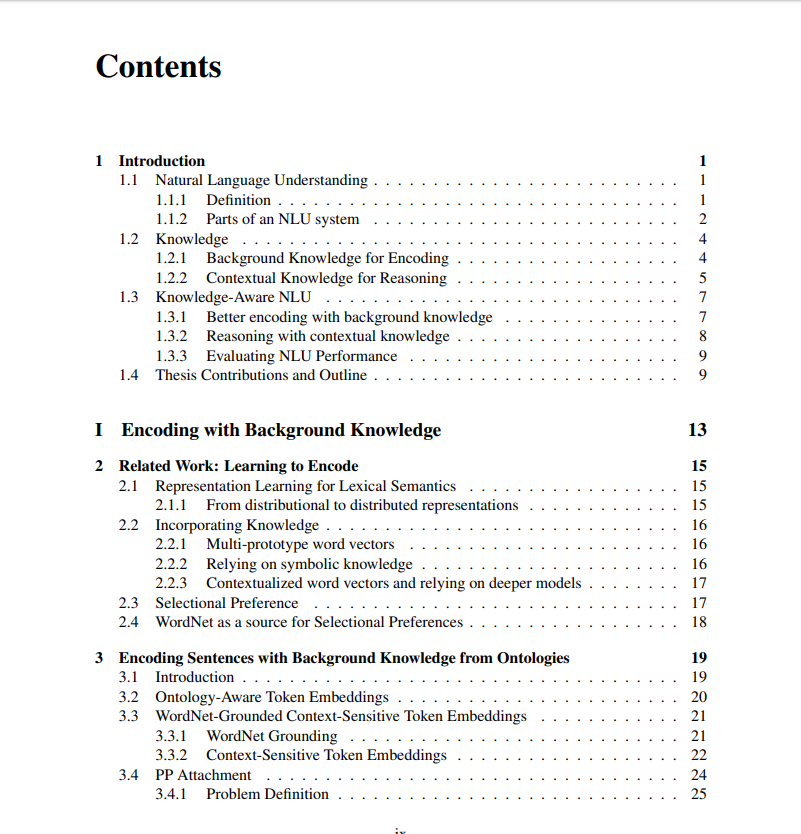

论文目录

Part I 背景知识编码

- 相关工作:学习编码

- 用本体论的背景知识来编码句子

- 将选择偏好作为编码事件的背景知识

Part II 用上下文知识进行推理

- 相关工作:学习推理

- 用于语义分析的解码约束

- 使用迭代覆盖引导搜索来训练语义分析器

成为VIP会员查看完整内容

相关内容

Pradeep Dasigi毕业于CMU(美国卡耐基梅隆大学),目前是Allen人工智能研究所的研究员。他的研究方向主要是构建知识注意力的自然语言理解系统(knowledge-aware Natural Language Understanding systems ),该系统能够充分利用知识库和其他来源的背景信息,也能够对结构化或者无结构化的上下文进行推理。

专知会员服务

104+阅读 · 2019年10月22日

Arxiv

12+阅读 · 2019年9月26日