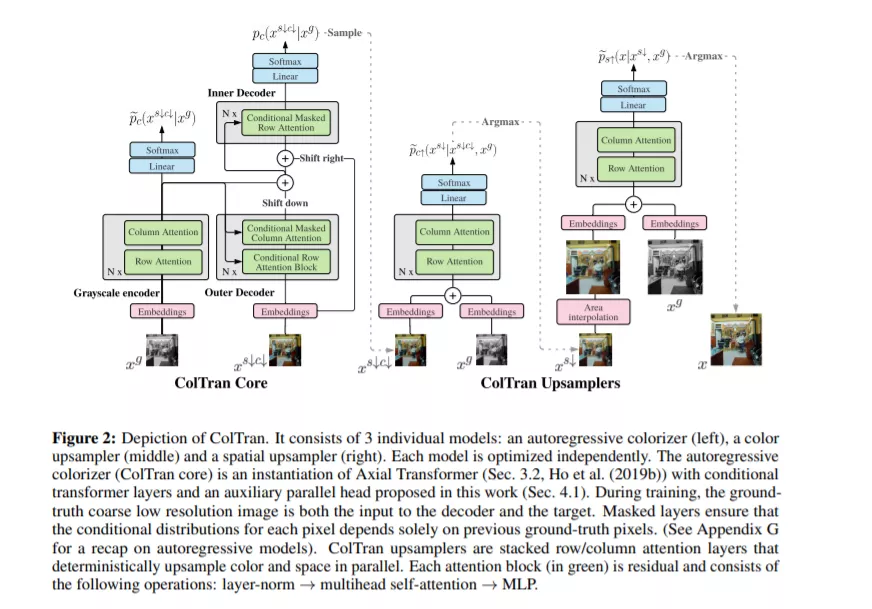

我们介绍了Colorization Transformer,这是一种基于自注意力,多样化的高保真图像着色的新颖方法。给定灰度图像,着色过程分三个步骤进行。我们首先使用条件自回归Transformer产生灰度图像的低分辨率粗色。我们的体系结构采用条件transformer层来有效调节灰度输入。随后的两个完全并行网络将粗糙的彩色低分辨率图像上采样为精细的彩色高分辨率图像。从Colorization Transformer进行采样可生成多种颜色,其保真度优于基于FID结果和在Mechanical Turk测试中的人工评估为ImageNet着色的最新技术。值得注意的是,在超过60%的情况下,人类评估师更喜欢三种生成的着色中评分最高的事实,而不是事实。

https://openreview.net/forum?id=5NA1PinlGFu

成为VIP会员查看完整内容

相关内容

Transformer是谷歌发表的论文《Attention Is All You Need》提出一种完全基于Attention的翻译架构