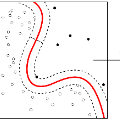

Group Anomaly Detection (GAD) reveals anomalous behavior among groups consisting of multiple member instances, which are, individually considered, not necessarily anomalous. This task is of major importance across multiple disciplines, in which also sequences like trajectories can be considered as a group. However, with increasing amount and heterogenity of group members, actual abnormal groups get harder to detect, especially in an unsupervised or semi-supervised setting. Recurrent Neural Networks are well established deep sequence models, but recent works have shown that their performance can decrease with increasing sequence lengths. Hence, we introduce with this paper GADFormer, a GAD specific BERT architecture, capable to perform attention-based Group Anomaly Detection on trajectories in an unsupervised and semi-supervised setting. We show formally and experimentally how trajectory outlier detection can be realized as an attention-based Group Anomaly Detection problem. Furthermore, we introduce a Block Attention-anomaly Score (BAS) to improve the interpretability of transformer encoder blocks for GAD. In addition to that, synthetic trajectory generation allows us to optimize the training for domain-specific GAD. In extensive experiments we investigate our approach versus GRU in their robustness for trajectory noise and novelties on synthetic and real world datasets.

翻译:组异常检测(GAD)揭示了多个成员实例组成的组中的异常行为,这些成员实例在单独考虑时不一定是异常的。这项任务在多个学科中都具有重要意义,其中序列如轨迹也可以被视为一组。然而,随着组成员的数量和异质性的增加,实际异常组的检测变得越来越困难,特别是在无监督或半监督设置中。递归神经网络是成熟的深度序列模型,但最近的研究表明,它们的性能会随着序列长度的增加而降低。因此,我们在本文中介绍GADFormer,这是一种GAD特定的BERT结构,能够在无监督和半监督设置中对轨迹进行基于注意力机制的组异常检测。我们正式和实验性地展示了如何将轨迹异常检测视为基于注意力机制的组异常检测问题。此外,我们引入了块注意异常分数(BAS),以提高GAD的转换器编码器块的可解释性。此外,合成轨迹生成使我们能够针对特定领域的GAD进行优化。在大量实验中,我们研究了我们的方法与GRU在轨迹噪声和合成数据集以及真实世界数据集上的鲁棒性。