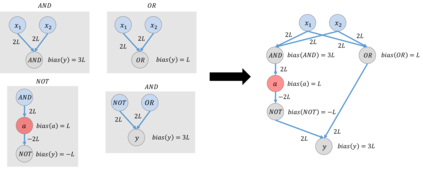

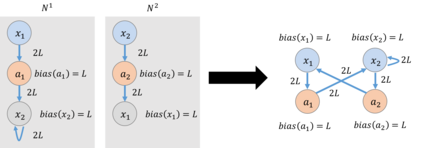

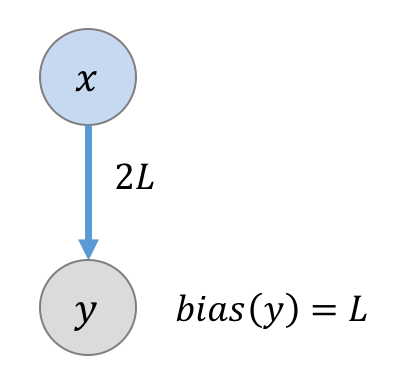

This paper is part of a project on developing an algorithmic theory of brain networks, based on stochastic Spiking Neural Network (SNN) models. Inspired by tasks that seem to be solved in actual brains, we are defining abstract problems to be solved by these networks. In our work so far, we have developed models and algorithms for the Winner-Take-All problem from computational neuroscience [LMP17a,Mus18], and problems of similarity detection and neural coding [LMP17b]. We plan to consider many other problems and networks, including both static networks and networks that learn. This paper is about basic theory for the stochastic SNN model. In particular, we define a simple version of the model. This version assumes that the neurons' only state is a Boolean, indicating whether the neuron is firing or not. In later work, we plan to develop variants of the model with more elaborate state. We also define an external behavior notion for SNNs, which can be used for stating requirements to be satisfied by the networks. We then define a composition operator for SNNs. We prove that our external behavior notion is "compositional", in the sense that the external behavior of a composed network depends only on the external behaviors of the component networks. We also define a hiding operator that reclassifies some output behavior of an SNN as internal. We give basic results for hiding. Finally, we give a formal definition of a problem to be solved by an SNN, and give basic results showing how composition and hiding of networks affect the problems that they solve. We illustrate our definitions with three examples: building a circuit out of gates, building an "Attention" network out of a "Winner-Take-All" network and a "Filter" network, and a toy example involving combining two networks in a cyclic fashion.

翻译:本文是开发大脑网络算法理论项目的一部分, 依据的是随机 Spiking NealNetwork (SNN) 模型。 受实际大脑中似乎解决的任务的启发, 我们正在定义由这些网络解决的抽象问题。 在迄今为止的工作中, 我们为计算神经科学[ LMP17a, Mus18] 的Winner-Take-All问题开发了模型和算法算法, 以及类似检测和神经编码的问题。 我们计划考虑许多其他问题和网络, 包括静态网络和学习的网络。 本文是关于SNNN模式模型的基本构成理论。 我们定义了一个模型的简单版本。 这个版本假定神经只是布利安的状态, 表明神经系统是否正在启动。 我们计划开发模型的变异的变体。 我们还给 SNNPs 定义了一个外部行为概念, 用来说明网络如何满足要求。 我们然后定义一个内部网络的构成操作者, 并且用一个外部行为模式来定义 SNNNF 。 我们定义一个外部行为 定义一个隐藏 SNNNW 的网络的外变体的变体。